GLM-4.6는 Z.ai(이전 명칭 Zhipu AI)의 GLM 패밀리 최신 메이저 릴리스로, 에이전트 기반 워크플로, 장문맥 추론 및 실무 코딩에 맞게 튜닝된 4세대 대규모 언어 MoE (Mixture-of-Experts) 모델입니다. 이번 릴리스는 실용적인 에이전트/도구 통합, 매우 큰 컨텍스트 윈도, 그리고 로컬 배포를 위한 오픈 웨이트 제공을 강조합니다.

주요 기능

- 긴 컨텍스트 — 기본 200K 토큰 컨텍스트 윈도(128K에서 확장). (docs.z.ai)

- 코딩 & 에이전트형 기능 — 실무 코딩 작업에서의 개선과 에이전트의 도구 호출 성능 향상이 홍보됨.

- 효율성 — Z.ai의 테스트에서 GLM-4.5 대비 약 ~30% 낮은 토큰 소비로 보고됨.

- 배포 & 양자화 — Cambricon 칩용 FP8 및 Int4 통합 최초 발표; vLLM을 통해 Moore Threads에서 네이티브 FP8 지원.

- 모델 크기 & 텐서 타입 — 공개 아티팩트에 따르면 Hugging Face에 약 ~357B 파라미터 모델(BF16 / F32 텐서)이 게시됨.

기술 세부 사항

모달리티 및 포맷. GLM-4.6은 텍스트 전용 LLM(입력 및 출력 모달리티: 텍스트)입니다. Context length = 200K tokens; max output = 128K tokens.

양자화 및 하드웨어 지원. 팀은 Cambricon 칩에서의 FP8/Int4 양자화와 vLLM을 사용한 Moore Threads GPU에서의 네이티브 FP8 추론 실행을 보고했으며 — 이는 추론 비용을 낮추고 온프레미스 및 국내 클라우드 배포를 가능하게 하는 데 중요합니다.

툴링 및 통합. GLM-4.6은 Z.ai의 API, 서드파티 제공자 네트워크(예: CometAPI)를 통해 배포되며, 코딩 에이전트(Claude Code, Cline, Roo Code, Kilo Code)에 통합됩니다.

기술 세부 사항

모달리티 및 포맷. GLM-4.6은 텍스트 전용 LLM(입력 및 출력 모달리티: 텍스트)입니다. Context length = 200K tokens; max output = 128K tokens.

양자화 및 하드웨어 지원. 팀은 Cambricon 칩에서의 FP8/Int4 양자화와 vLLM을 사용한 Moore Threads GPU에서의 네이티브 FP8 추론 실행을 보고했으며 — 이는 추론 비용을 낮추고 온프레미스 및 국내 클라우드 배포를 가능하게 하는 데 중요합니다.

툴링 및 통합. GLM-4.6은 Z.ai의 API, 서드파티 제공자 네트워크(예: CometAPI)를 통해 배포되며, 코딩 에이전트(Claude Code, Cline, Roo Code, Kilo Code)에 통합됩니다.

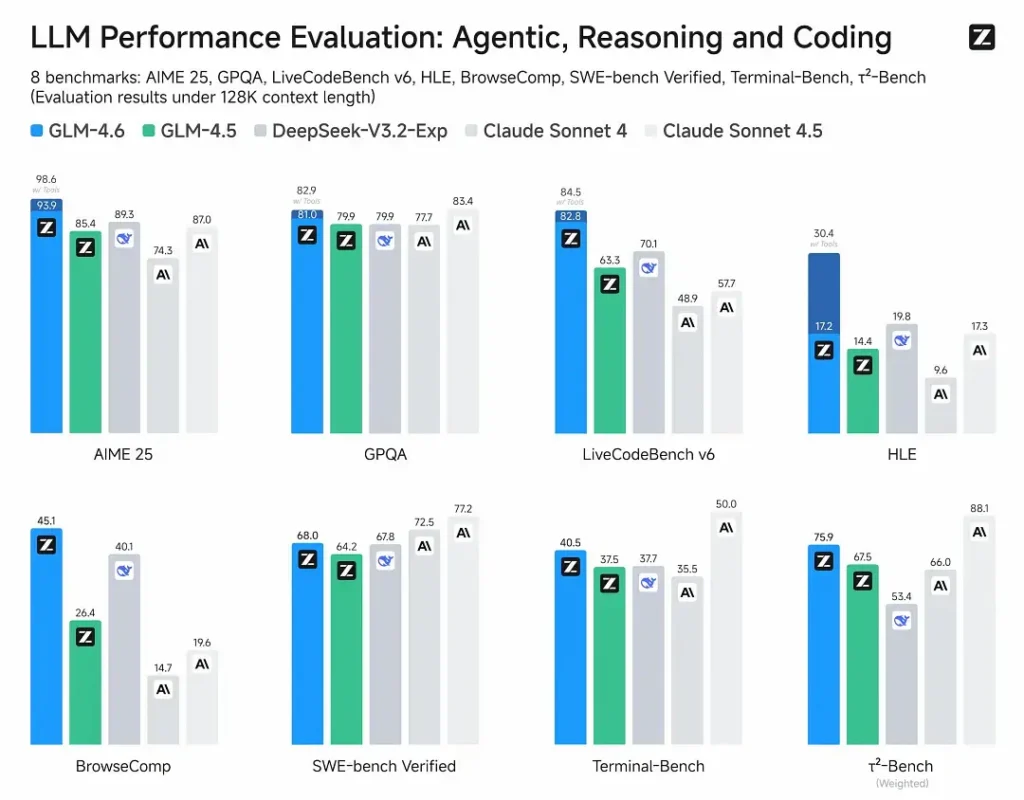

벤치마크 성능

- 공개된 평가: GLM-4.6은 에이전트, 추론 및 코딩을 다루는 8개 공개 벤치마크에서 테스트되며 GLM-4.5 대비 명확한 향상을 보여줍니다. 사람이 평가한 실무 코딩 테스트(확장 CC-Bench)에서 GLM-4.6은 GLM-4.5 대비 약 ~15% 적은 토큰을 사용하고 Anthropic의 Claude Sonnet 4 대비 약 ~48.6% 승률을 기록합니다(다수 리더보드에서 근접한 성능).

- 포지셔닝: 결과는 GLM-4.6이 국내외 선도 모델과 경쟁력이 있음을 주장합니다(예: DeepSeek-V3.1 및 Claude Sonnet 4).

제한 사항 및 위험

- 환각 및 오류: 현재의 모든 LLM과 마찬가지로 GLM-4.6도 사실 오류를 발생시킬 수 있습니다 — Z.ai 문서에서는 출력에 실수가 포함될 수 있음을 명시적으로 경고합니다. 중요한 콘텐츠에는 검증 및 검색/RAG를 적용해야 합니다.

- 모델 복잡성 및 서빙 비용: 200K 컨텍스트와 매우 큰 출력은 메모리 및 지연 요구를 크게 증가시키며 추론 비용을 높일 수 있습니다; 대규모 운영을 위해서는 양자화/추론 엔지니어링이 필요합니다.

- 도메인 격차: GLM-4.6이 에이전트/코딩 성능을 강하게 보고하지만, 일부 공개 보고에 따르면 특정 마이크로벤치마크에서 일부 버전의 경쟁 모델보다 뒤처지는 경우가 있습니다(예: Sonnet 4.5 대비 일부 코딩 지표). 프로덕션 모델 교체 전 작업별로 평가하십시오.

- 안전 및 정책: 오픈 웨이트는 접근성을 높이는 동시에 관리 책임에 대한 질문을 증가시킵니다(완화 조치, 가드레일, 레드팀링은 사용자 책임).

사용 사례

- 에이전트형 시스템 및 도구 오케스트레이션: 긴 에이전트 트레이스, 다중 도구 계획, 동적 도구 호출; 모델의 에이전트형 튜닝이 핵심 강점입니다.

- 실무 코딩 도우미: 다회전 코드 생성, 코드 리뷰 및 인터랙티브 IDE 어시스턴트( Z.ai 기준 Claude Code, Cline, Roo Code에 통합). 토큰 효율성 개선은 고사용량 개발자 플랜에 매력적입니다.

- 장문서 워크플로: 200K 윈도를 통한 요약, 다문서 종합, 장편 법률/기술 검토.

- 콘텐츠 제작 및 가상 캐릭터: 장시간 대화, 다회전 시나리오에서의 일관된 페르소나 유지.

GLM-4.6의 타 모델 대비

- GLM-4.5 → GLM-4.6: **컨텍스트 크기(128K → 200K)**와 **토큰 효율성( CC-Bench에서 약 ~15% 절감)**의 단계적 변화; 에이전트/도구 활용 개선.

- GLM-4.6 vs Claude Sonnet 4 / Sonnet 4.5: Z.ai는 여러 리더보드에서의 근접 성능과 CC-Bench 실무 코딩 과제에서의 약 ~48.6% 승률을 보고함(일부 마이크로벤치마크에서는 Sonnet이 여전히 우세). 많은 엔지니어링 팀에게 GLM-4.6은 비용 효율적 대안으로 포지셔닝됨.

- GLM-4.6 vs 기타 장문맥 모델(DeepSeek, Gemini 변형, GPT-4 계열): GLM-4.6은 대형 컨텍스트와 에이전트형 코딩 워크플로를 강조하며, 상대적 강점은 지표에 따라 다름(토큰 효율성/에이전트 통합 vs 순수 코드 합성 정확도 또는 안전 파이프라인). 경험적 선택은 작업 중심이어야 함.

Zhipu AI의 최신 플래그십 모델 GLM-4.6 출시: 총 파라미터 355B, 활성 32B. 모든 핵심 역량에서 GLM-4.5를 능가.

- 코딩: Claude Sonnet 4와 동급, 중국 내 최고.

- 컨텍스트: 200K로 확장(128K에서).

- 추론: 개선, 추론 중 도구 호출 지원.

- 검색: 도구 호출 및 에이전트 성능 강화.

- 작성: 스타일, 가독성, 롤플레잉 측면에서 인간 선호도에 더 잘 부합.

- 다국어: 언어 간 번역 강화.