DeepSeek telah rasmi memperkenalkan pratonton V4 sebagai famili model sumber terbuka, dan tajuk besarnya bukan sekadar “kemas kini model yang lain.” Syarikat memposisikan V4 sebagai sistem berkonteks panjang dan mesra ejen, dibina untuk beban kerja sebenar: analisis berat dokumen, pembantu pengkodan, ejen carian, dan automasi berbilang langkah. Keluaran ini tersedia secara langsung di web, aplikasi, dan API, dan siri V4 memperkenalkan tingkap konteks 1M token yang menjimatkan kos merentas perkhidmatan rasminya.

Apa yang menjadikan pelancaran ini khususnya menonjol ialah gabungan skala dan kecekapan. DeepSeek mengatakan V4-Pro mempunyai 1.6T jumlah parameter dengan 49B aktif, manakala V4-Flash mempunyai 284B jumlah parameter dengan 13B aktif. Dalam laporan teknikal, DeepSeek juga mendakwa seni bina V4 menggunakan perhatian hibrid, penghalaan MoE, dan pascalatihan yang direka untuk memperbaiki kelakuan agenik sambil mengurangkan beban pengiraan bagi konteks ultra-panjang.

Apakah DeepSeek V4?

DeepSeek-V4 ialah famili pratonton perdana terbaharu syarikat, dan keluaran ini merangkumi dua varian awam: V4-Pro dan V4-Flash. DeepSeek menerangkan V4-Pro sebagai model yang lebih kuat untuk pengetahuan dunia, matematik, STEM, pengkodan, dan pengkodan berasaskan ejen, manakala V4-Flash ialah pilihan lebih tangkas dan cekap kos yang masih mengekalkan banyak kualiti penaakulan dan keupayaan konteks panjang. V4-Pro mendahului model terbuka semasa dalam pengkodan agenik dan pengetahuan dunia, manakala V4-Flash direka untuk kelajuan dan pelaksanaan yang ekonomik.

V4 menggunakan seni bina perhatian hibrid yang menggabungkan Compressed Sparse Attention (CSA) dan Heavily Compressed Attention (HCA), serta Manifold-Constrained Hyper-Connections dan pengoptimum Muon. Syarikat itu juga menyatakan model dilatih awal pada lebih 32T token dan bahawa, pada konteks 1M, V4-Pro hanya memerlukan 27% FLOPs inferens per token dan 10% cache KV berbanding DeepSeek-V3.2. Kisah kecekapan itulah tajuk sebenar di sebalik keluaran ini.

DeepSeek-V4-Pro vs DeepSeek-V4-Flash

DeepSeek-V4-Pro

V4-Pro ialah model perdana untuk pengguna yang paling mementingkan kualiti. DeepSeek-V4-Pro menyampaikan prestasi pengkodan agenik yang lebih kuat, pengetahuan dunia yang lebih kaya, dan penaakulan bertaraf dunia, serta ia mendahului model terbuka semasa sambil hanya ketinggalan di belakang Gemini-3.1-Pro dalam pengetahuan dunia menurut halaman pelancaran. Dalam laporan teknikal, V4-Pro ialah model yang lebih besar dalam famili, dan DeepSeek-V4-Pro tersedia melalui antara muka serasi OpenAI dan serasi Anthropic yang sama seperti V4-Flash.

DeepSeek-V4-Flash

V4-Flash ialah model berkeutamaan kecekapan; keupayaan penaakulannya menghampiri V4-Pro, dan ia beraksi setanding dengan V4-Pro pada tugasan ejen yang ringkas, sambil menggunakan jejak parameter yang lebih kecil dan masa respons yang lebih pantas. Ia menyokong kedua-dua mod berfikir dan bukan berfikir, dengan panjang konteks 1M yang sama dan ciri teras yang sama seperti Pro, tetapi pada kos yang jauh lebih rendah.

Yang mana patut anda pilih?

Guna V4-Pro apabila tugasan berisiko tinggi, sarat pengetahuan, atau sukar disahkan: penyelidikan perusahaan, pengkodan kompleks, sokongan keputusan berbilang langkah, atau tugasan di mana anda mahukan jawapan paling kuat. Guna V4-Flash apabila kadar pemprosesan, kependaman, atau kos token lebih penting daripada memerah beberapa mata terakhir prestasi penanda aras. Pilihan itu selari dengan pemposisian rasmi dan jurang penanda aras yang dilaporkan antara kedua-dua model.

| Item | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| Jumlah parameter | 284B | 1.6T |

| Parameter aktif | 13B | 49B |

| Panjang konteks | 1M | 1M |

| Mod penaakulan | Tidak berfikir + Berfikir | Tidak berfikir + Berfikir |

| Kegunaan terbaik | Inferens pantas, aplikasi kadar tinggi, ejen sensitif kos | Penaakulan berkeupayaan tertinggi, pengkodan & pengetahuan sukar |

| Harga API rasmi | Cache hit $0.028 / cache miss $0.14 / output $0.28 per 1M token | Cache hit $0.145 / cache miss $1.74 / output $3.48 per 1M token |

| Output maksimum | 384K | 384K |

CometAPI menyediakan akses kepada Deepseek v4 Pro dan V4 Flash,—20% lebih murah daripada rasmi—serta pertukaran lancar antara 500+ model (GPT-5.4, Gemini 3.1, dll.) melalui satu titik akhir serasi OpenAI atau Anthropic Messages.

Penanda aras prestasi

DeepSeek-V3.2 vs V4-Flash vs V4-Pro

Dalam jadual perbandingan model asas, V4-Flash dan V4-Pro kedua-duanya mengatasi DeepSeek-V3.2 merentas penanda aras teras, dengan V4-Pro biasanya mendahului. Sebagai contoh, laporan menyenaraikan skor berikut: AGIEval 82.6 / 83.1 vs 80.1 V3.2; MMLU 88.7 / 90.1 vs 87.8; MMLU-Pro 68.3 / 73.5 vs 65.5; HumanEval 69.5 / 76.8 vs 62.8; dan LongBench-V2 44.7 / 51.5 vs 40.2 untuk V3.2, di mana nombor tengah ialah V4-Flash dan yang terakhir ialah V4-Pro.

| Penanda aras | DeepSeek-V3.2-Base | DeepSeek-V4-Flash-Base | DeepSeek-V4-Pro-Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU-Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench-V2 (EM) | 40.2 | 44.7 | 51.5 |

Sumber: Laporan teknikal DeepSeek-V4, Jadual 1.

Polanya jelas: Flash merapatkan jurang kepada Pro, tetapi Pro masih model umum yang lebih kuat. Itu menjadikan V4-Flash lalai praktikal untuk banyak sistem produksi, manakala V4-Pro ialah model yang patut dicapai apabila kualiti jawapan lebih penting daripada kos atau kependaman.

Perbandingan model Barat: di mana V4 berada

Dalam satu penilaian manusia pada tugasan kolar putih bahasa Cina, laporan menyatakan DeepSeek-V4-Pro-Max mengatasi Claude Opus 4.6-Max, dengan kadar tidak-kalah 63%. DeepSeek-V4-Pro “mengatasi dengan ketara” Claude Sonnet 4.5 dan menghampiri Claude Opus 4.5 pada penanda aras pengkodan R&D.

| Bidang penilaian | Keputusan DeepSeek | Perbandingan model Barat | Apa yang disyorkan |

|---|---|---|---|

| Tugasan kolar putih Cina | V4-Pro-Max, kadar tidak-kalah 63% | vs Claude Opus 4.6-Max | Tunjuk kuat dalam tugas gaya perniagaan praktikal |

| Penanda aras pengkodan R&D | Kadar lulus V4-Pro-Max 67 | vs Claude Sonnet 4.5 pada 47; Opus 4.5 pada 70; Opus 4.6 Thinking pada 80 | Kompetitif dengan model barisan hadapan terkemuka, khususnya berbanding sistem setara Sonnet |

Ia bukan “nombor satu dalam setiap aspek,” tetapi ia sudah pada tahap yang “mesti dinilai dengan serius.”

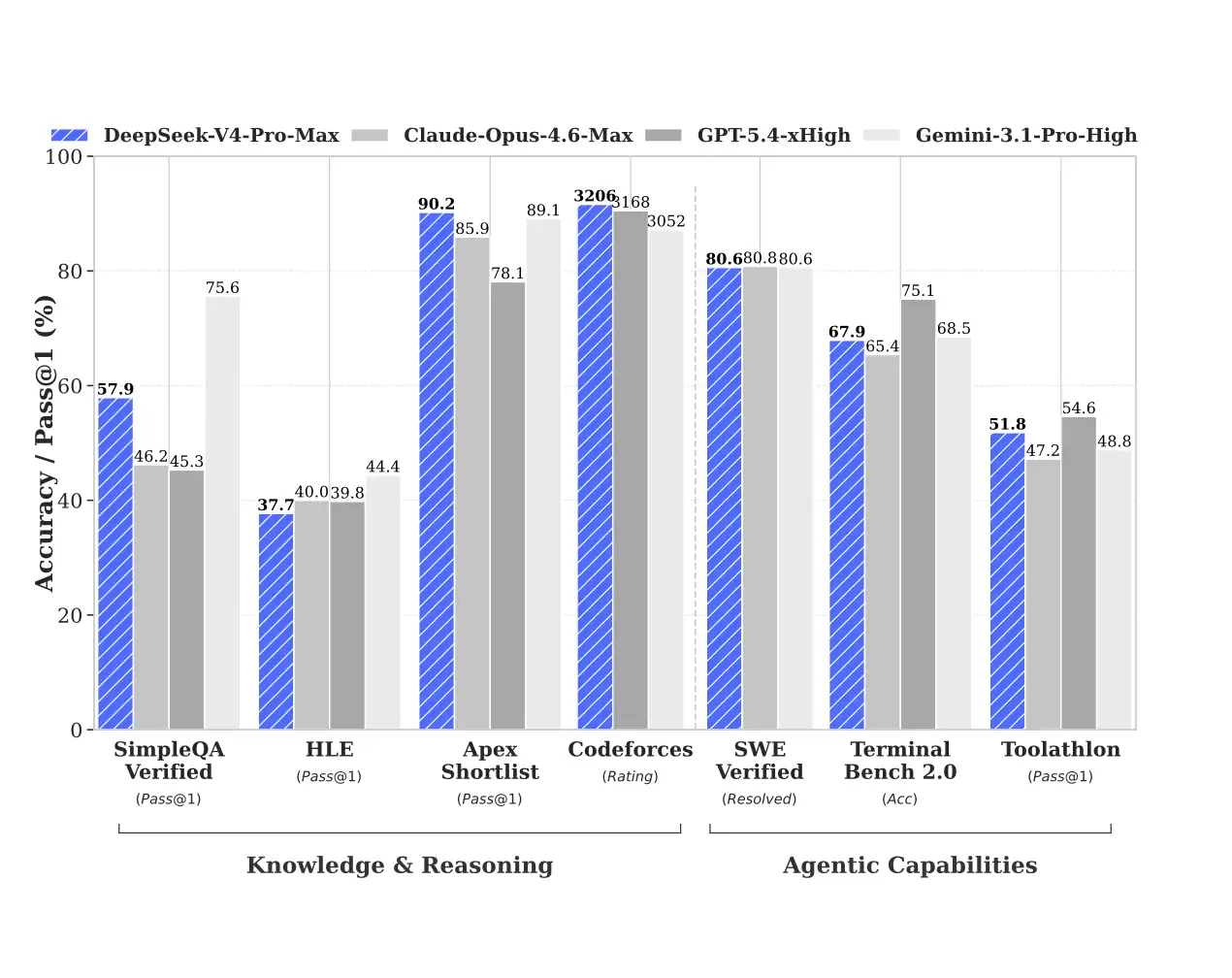

Laporan teknikal DeepSeek membandingkan V4-Pro-Max dengan Claude Opus 4.6 Max, GPT-5.4 xHigh, dan Gemini 3.1 Pro High dalam jadual yang sama. Keputusannya bukan ringkas: model tertutup Barat masih beraksi kuat dalam beberapa aspek pengetahuan dan inferens; walau bagaimanapun, V4-Pro-Max sangat menonjol dalam kod, konteks panjang, dan beberapa tugasan ejen. Dengan kata lain, ia bukan lagi naratif satu dimensi “alternatif domestik,” tetapi telah memasuki tahap “yang mana lebih sesuai untuk senario anda.”

Dari segi pengetahuan dan keupayaan penaakulan, ia setara dengan Opus 4.6 Max, GPT-5.4 xHigh, dan Gemini 3.1 ProHigh. Namun, ia sedikit ketinggalan dalam keupayaan agenik, walaupun perbezaannya tidak besar.

DeepSeek-V4-Pro-Max sangat kompetitif dalam senario berorientasikan kod dan konteks panjang, manakala model Barat masih kelihatan sangat kuat dalam beberapa penanda aras penaakulan tulen dan pengetahuan. Itulah cara yang betul untuk membaca keluaran ini: DeepSeek V4 benar-benar berada dalam perbincangan barisan hadapan, tetapi kepimpinan penanda aras kekal bergantung pada tugasan.

Cara mengakses DeepSeek V4

1) Guna web dan aplikasi rasmi

DeepSeek mengatakan V4 Preview tersedia sekarang pada web, aplikasi, dan API. Untuk pengguna biasa, laluan paling mudah masih antara muka sembang rasmi, di mana model boleh diakses melalui Expert Mode atau Instant Mode.

2) Guna API

Saya sangat mengesyorkan CometAPI untuk mengakses deepseek V4, kerana ia menawarkan harga terbaik dan kelebihan pengagregatan.

Nama model ialah:

deepseek-v4-flashdeepseek-v4-pro

DeepSeek juga mengatakan nama legasi

deepseek-chatdandeepseek-reasonerakan dinyahgunaan dan kini memetakan kepada mod bukan berfikir dan berfikir bagi V4-Flash sehingga 2026-07-24. Itu penting untuk perancangan migrasi jika anda sudah mempunyai integrasi lama dalam produksi.

- Daftar di CometAPI dan dapatkan kunci API anda.

- Guna SDK Python OpenAI standard (atau mana-mana klien serasi) dengan URL asas tersuai:

Berikut contoh ringkas menggunakan format serasi OpenAI rasmi:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "Anda ialah pembantu yang membantu."},

{"role": "user", "content": "Ringkaskan manfaat tingkap konteks sejuta token."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

Pola permintaan itu mengikuti panduan mula cepat: tetapkan URL asas, pilih deepseek-v4-pro atau deepseek-v4-flash, dan aktifkan thinking apabila anda memerlukan penaakulan yang lebih mendalam.

Cara menggunakan DeepSeek V4 dengan berkesan

Untuk aliran kerja dokumen panjang, corak terkuat ialah mengekalkan konteks yang bersih dan berstruktur. Tingkap konteks 1M token V4 ialah kelebihan besar, tetapi model masih beraksi terbaik apabila input diatur kepada seksyen, petikan sumber, arahan tugasan, dan kekangan output yang jelas. Itulah cara paling semula jadi untuk memanfaatkan keupayaan konteks panjang yang diiklankan DeepSeek.

Untuk aliran kerja kod dan ejen, mulakan dengan V4-Flash untuk iterasi pantas, kemudian naikkan ke V4-Pro untuk larian akhir atau langkah paling sukar. Pendekatan itu sesuai dengan pemposisian rasmi: Flash ialah pilihan cekap, Pro ialah model yang lebih kuat, dan kedua-duanya berkongsi permukaan API dan panjang konteks yang sama.

Kata akhir

DeepSeek-V4 menonjol kerana ia menggabungkan empat perkara yang diminta pasaran pada masa yang sama: konteks panjang, penaakulan yang kukuh, ketersediaan terbuka, dan harga agresif. Cerita sebenar bukan sekadar DeepSeek mengeluarkan satu lagi model. Ia adalah usaha syarikat untuk menjadikan AI gaya barisan hadapan boleh digunakan secara ekonomik dalam produksi. Bagi pasukan yang menilai di mana untuk meletakkan pertaruhan AI seterusnya, itu ialah isyarat yang wajar diuji, bukan diabaikan.

Bagi pasukan yang membina merentas pelbagai penyedia, inilah jenis keluaran yang wajar ditanda aras dalam timbunan anda sendiri. CometAPI boleh menjadi lapisan praktikal untuk membandingkan DeepSeek-V4 bersama model barisan hadapan lain tanpa memaksa pasukan produk anda membina semula integrasi setiap kali pasaran berubah.