Google DeepMind secara rasmi melancarkan Gemma 4 pada 2 April 2026, menandakan satu pencapaian penting dalam AI sumber terbuka. Keluarga model ini menyampaikan kecerdasan tahap termaju per parameter, dibina daripada penyelidikan dan teknologi yang sama yang memacu Gemini 3. Berbeza dengan versi Gemma terdahulu yang menggunakan lesen tersuai, Gemma 4 dihantar di bawah lesen Apache 2.0 yang sepenuhnya permisif, membolehkan penggunaan, pengubahsuaian dan pengedaran semula komersial tanpa sekatan.

Gemma 4 menonjol kerana keupayaan multimodalnya (input teks + imej merentas semua saiz, serta audio pada model tepi), sokongan asli untuk penaakulan lanjutan dan aliran kerja berasaskan ejen, tetingkap konteks panjang sehingga 256K token, dan pengoptimuman untuk segala-galanya daripada telefon pintar dan Raspberry Pi hingga GPU kelas atasan. Ia menyokong lebih 140 bahasa dan menekankan kecekapan, menjadikan AI berkuasa boleh diakses pada perkakasan pengguna dan tepi tanpa kebergantungan kepada awan.

CometAPI menyediakan API model sumber terbuka dan tertutup yang cemerlang.

Apakah Gemma 4?

Gemma 4 ialah keluarga terbaharu model bahasa besar multimodal sumber terbuka (LLM) daripada Google DeepMind, dibina khusus untuk penaakulan lanjutan, aliran kerja AI berasaskan ejen, dan penyebaran cekap pada peranti. Ia memaksimumkan “kecerdasan per parameter” dengan memanfaatkan cerapan daripada penyelidikan proprietari Gemini 3 sambil kekal open-weight dan sumber terbuka sepenuhnya.

Penambahbaikan utama berbanding model Gemma sebelumnya termasuk:

- Multimodaliti asli: Pemahaman teks + imej (semua model), dengan sokongan audio pada varian tepi yang lebih kecil.

- Mod berfikir boleh dikonfigur: Penaakulan langkah demi langkah dengan keluaran berstruktur <|think|>.

- Panggilan fungsi asli dan penggunaan alat: Sesuai untuk ejen autonomi.

- Konteks diperluas: Sehingga 256K token pada model lebih besar.

- Seni bina perhatian hibrid: Menggabungkan tetingkap gelongsor tempatan dan perhatian global untuk kecekapan dan prestasi konteks panjang.

- Per-Layer Embeddings (PLE) dalam model yang lebih kecil dan cache KV berkongsi untuk penjimatan memori.

- Sokongan berbilang bahasa yang luas: Pra-latih pada data merangkumi 140+ bahasa dengan kesedaran nuansa budaya.

Dikeluarkan di bawah Apache 2.0, Gemma 4 menghapuskan sekatan lesen terdahulu yang mengehadkan penerimaan perusahaan. Kini pembangun boleh memperhalus, menggunakan, dan mengkomersialkan tanpa geseran—menjadikannya pesaing langsung kepada ekosistem terbuka sepenuhnya seperti Llama dan Qwen.

Gemma 4 menyasarkan perkakasan pelbagai: peranti tepi (telefon, IoT, Raspberry Pi, Jetson Nano) untuk AI luar talian latensi rendah, dan stesen kerja/GPU untuk pelayan setempat berprestasi tinggi. Reka bentuk “mengutamakan setempat” ini mendahulukan privasi, penjimatan kos, dan inferens sifar latensi.

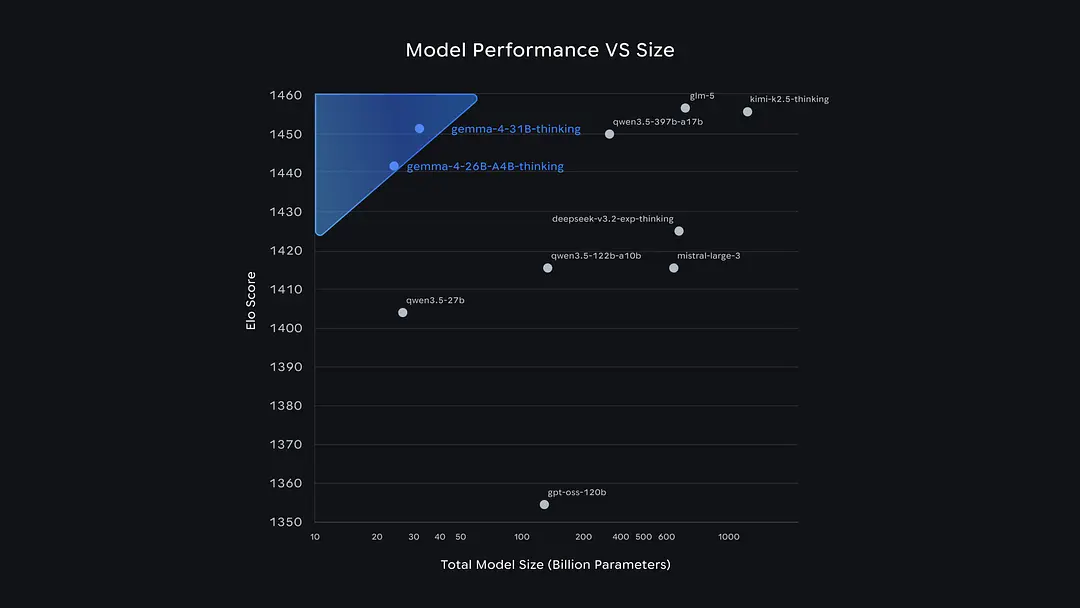

Model sumber terbuka yang mendahuluinya di papan pendahulu Arena kebanyakannya daripada pasukan China. Gemma 4 tidak banyak berbeza daripada Qwen 3.5 dan GLM-5, tetapi berbeza dengan ketara daripada GPT-OSS-120B OpenAI.

Pembangun kini boleh menemui GLM-5, Qwen 3.5, dan lain-lain di CometAPI.

Empat Versi Gemma 4

Google mengeluarkan Gemma 4 dalam empat saiz yang dioptimumkan dengan teliti, setiap satunya mengimbangi prestasi, kecekapan, dan senario penyebaran. Dua daripadanya menggunakan seni bina padat dengan Per-Layer Embeddings (PLE) inovatif untuk kecekapan tepi; satu ialah Mixture-of-Experts (MoE) untuk prestasi tinggi pada kos parameter aktif yang rendah; dan satu ialah model padat perdana.

| Model | Seni Bina | Jumlah Parameter | Parameter Aktif (MoE) | Parameter Berkesan | Panjang Konteks | Modaliti | Perkakasan Sasaran |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | Padat + PLE | ~5.1B (termasuk embedding) | N/A | 2.3B | 128K | Teks, Imej, Audio | Telefon pintar, Raspberry Pi, IoT tepi |

| Gemma 4 E4B | Padat + PLE | ~8B (termasuk embedding) | N/A | 4.5B | 128K | Teks, Imej, Audio | Peranti mudah alih, GPU ringan, Jetson |

| Gemma 4 26B A4B | MoE (8 aktif / 128 jumlah + 1 dikongsi) | 25.2B | 3.8B–4B | N/A | 256K | Teks, Imej | Stesen kerja, GPU pengguna, pelayan setempat |

| Gemma 4 31B | Padat | 30.7B | N/A | N/A | 256K | Teks, Imej | GPU kelas atasan (muat pada satu H100/A100 dalam FP16) |

Gemma 4 E2B dan E4B (dioptimumkan untuk tepi): Menggunakan PLE untuk menambah pengkhususan setiap lapisan dengan lebihan parameter minimum. Sesuai untuk peranti berkuasa bateri atau terhad memori. Pengekod audio (Conformer gaya USM, ~300M parameter) membolehkan pertuturan-ke-teks dan terjemahan.

Gemma 4 26B A4B (MoE): Mengaktifkan hanya ~4B parameter semasa inferens walaupun saiz keseluruhan 25B+. Menyampaikan prestasi hampir 31B pada kos pengiraan yang jauh lebih rendah—sesuai untuk penskalaan cekap kos.

Gemma 4 31B (Padat): Model perdana untuk keupayaan maksimum. Muat pada satu GPU 80GB dalam ketepatan penuh dan berada dalam kalangan model terbuka teratas di papan pendahulu.

Semua model menyertakan varian tala arahan (“-it”) yang dioptimumkan untuk sembang, penaakulan, dan penggunaan alat, serta versi asas pra-latih untuk penalaan halus. Dua model besar mengambil pendekatan berbeza: model Padat 31B mengejar kualiti tertinggi dan menjadi asas terbaik untuk penalaan halus; model MoE 26B mengutamakan kelajuan, mengaktifkan hanya 3.8 bilion parameter semasa inferens, menghasilkan penjanaan kata yang jauh lebih pantas, namun dengan kualiti keseluruhan sedikit lebih rendah.

Dua model kecil, E2B dan E4B, direka khusus untuk telefon mudah alih dan peranti IoT: ia boleh berjalan sepenuhnya luar talian, menjimatkan memori dan kuasa. Lebih-lebih lagi, model kecil ini memiliki keupayaan yang tiada pada model yang lebih besar: input audio asli, membolehkan pengecaman pertuturan secara langsung.

Keupayaan Teras Gemma 4

Gemma 4 cemerlang dalam aspek yang paling penting untuk aplikasi AI dunia sebenar:

1. Penaakulan Lanjutan & Mod Berfikir

Penaakulan langkah demi langkah yang boleh dikonfigur melalui gesaan sistem atau enable_thinking=True. Mengeluarkan tag berstruktur <|think|> diikuti jawapan akhir. Meningkatkan prestasi secara dramatik pada tugas kompleks tanpa penalaan tambahan.

2. Pemahaman Multimodal

- Visi: Pengesanan objek (kotak sempadan JSON), OCR (berbilang bahasa), penghuraian dokumen/PDF, pemahaman carta, pemahaman UI, pengecaman tulisan tangan, dan pengendalian imej resolusi berubah-ubah (bajet token: 70–1120 token).

- Video: Sehingga 60 saat (pemprosesan bingkai 1 fps).

- Audio (E2B/E4B sahaja): Pengecaman pertuturan automatik (ASR) dan pertuturan-ke-teks (maks 30s).

- Input berselang-seli: Campur teks, imej, dan audio dalam sebarang tertib.

3. Aliran Kerja Berasaskan Ejen & Panggilan Fungsi

Sokongan penggunaan alat asli membolehkan ejen autonomi untuk perancangan berbilang langkah, panggilan API, navigasi aplikasi, dan penyiapan tugas. Kukuh pada τ2-bench (penggunaan alat berasaskan ejen).

4. Pengkodan & Alat Pembangun

Penjanaan kod, pelengkapan, penyahpepijatan, dan pemahaman pada peringkat repositori yang cemerlang. Menyokong keluaran berstruktur JSON untuk integrasi lancar. Ia mencatat 80.0% (31B) pada LiveCodeBench v6, meletakkannya sebagai pembantu pengaturcaraan mengutamakan setempat yang sesuai untuk senario pembangunan luar talian.

5. Konteks Panjang & Berbilang Bahasa

Menangani 128K–256K token dengan boleh dipercayai (dijamin pada MRCR needle-in-haystack). Pra-dilatih pada data pelbagai sehingga tarikh potong Januari 2025, dengan prestasi rentas bahasa yang kukuh. Ini bukan sekadar terjemahan berbilang bahasa; ia dilatih secara asli dan merangkumi lebih 140 bahasa.

Data Penanda Aras: Pecahan Prestasi Gemma 4

Gemma 4 menetapkan piawaian baharu untuk model terbuka. Varian 31B dan 26B menyampaikan skor yang dahulu hanya dicapai oleh sistem proprietari yang jauh lebih besar, manakala model tepi mengatasi pendahulu Gemma 3 yang lebih besar.

Keputusan Penanda Aras Penuh (Model Ditala Arahan)

| Penanda Aras | Kategori | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (tanpa think) |

|---|---|---|---|---|---|---|

| MMLU Pro | Penaakulan & Pengetahuan | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (no tools) | Matematik | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | Sains peringkat Siswazah | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (purata) | Penggunaan Alat Berasaskan Ejen | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | Pengkodan | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | Pengkodan Kompetitif | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | Penaakulan Multimodal | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | Matematik + Visi | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8-needle, 128K) | Konteks Panjang | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

Wawasan Utama:

- Lonjakan besar daripada Gemma 3: Model 31B meningkatkan AIME matematik daripada 20.8% kepada 89.2% dan LiveCodeBench daripada 29.1% kepada 80.0%.

- Kecekapan MoE: 26B A4B hampir menyamai 31B sambil menggunakan pengiraan yang jauh lebih sedikit semasa inferens.

- Dominasi tepi: E4B dan E2B mengatasi Gemma 3 27B pada banyak metrik walaupun 6–10x lebih kecil.

- Kedudukan papan pendahulu: 31B mencatat ~1452 pada Arena AI (teks); 26B A4B ~1441. Varian 26B dilaporkan mengatasi model yang jauh lebih besar seperti Qwen 3.5 397B dalam pilihan pengguna dan pengkodan.

Penanda aras visi dan audio mengesahkan prestasi multimodal yang kukuh di luar kotak tanpa penalaan khusus.

Ekosistem dan Sokongan Alat

Gemma 4 menikmati integrasi ekosistem yang pantas dan meluas:

- Hugging Face: Sokongan hari pertama dengan

transformers,pipeline("any-to-any"), GGUF, ONNX, dan pemproses multimodal. - Masa Jalan Setempat: Ollama, Llama.cpp (LM Studio, Jan), MLX (Apple Silicon dengan TurboQuant), Mistral.rs (Rust), Transformers.js (inferens pelayar WebGPU).

- Penyetalaan Halus: TRL, Unsloth, PEFT, Vertex AI, dan sokongan set data multimodal penuh.

- Pengoptimuman Perkakasan: NVIDIA RTX/DGX Spark/Jetson (melalui TensorRT-LLM), Google AI Edge tools, dan penyebaran pada peranti Android/iOS.

- Kerangka Ejen: OpenClaw, Hermes, Pi, dan ujian simulasi CARLA.

- Awan/Studio: Google AI Studio untuk ujian pantas; Kaggle Models untuk muat turun.

Ekosistem ini menjadikan Gemma 4 boleh dikerahkan dalam beberapa minit pada komputer riba, pelayan, atau peranti tepi.

Had & Keselamatan:

- Tarikh potong data latihan: Januari 2025 (tiada pengetahuan masa nyata tanpa alat).

- Audio terhad kepada pertuturan (bukan muzik); video dihadkan 60s.

- Risiko halusinasi kekal—gunakan mod berfikir dan pengesahan.

- Keselamatan: Penapisan dan penilaian yang ketat mengikut Prinsip AI Google; pembangun harus menambah pengawal khusus aplikasi.

Mengapa Gemma 4 Penting pada 2026

Gemma 4 mendemokrasikan AI termaju. Dengan menggabungkan kecerdasan multimodal, keupayaan berasaskan ejen, dan kebebasan Apache 2.0 dengan kecekapan yang tidak bergantung pada perkakasan, ia memberdayakan pembangun dan perusahaan untuk membina penyelesaian AI yang selamat, peribadi, dan kos efektif pada skala. Terobosan “kecerdasan per parameter”—terutamanya jelas pada model tepi yang mengatasi model terbuka perdana semalam—menandakan peralihan ke arah AI yang benar-benar merata.

Sama ada menjalankan model 2B pada telefon atau sebuah 31B berkuasa tinggi secara setempat, Gemma 4 membuktikan AI sumber terbuka telah mengejar (dan dalam banyak kes mengatasi) alternatif tertutup dari segi kegunaan praktikal.