Pada 2025–2026, landskap alat AI terus mengalami konsolidasi: API gerbang (seperti CometAPI) berkembang untuk menyediakan akses gaya OpenAI kepada ratusan model, manakala aplikasi LLM untuk pengguna akhir (seperti AnythingLLM) terus memperbaiki penyedia “Generic OpenAI” mereka bagi membolehkan aplikasi desktop dan berkeutamaan setempat (local‑first) memanggil mana-mana titik akhir yang serasi dengan OpenAI. Ini menjadikan penghalaan trafik AnythingLLM melalui CometAPI kini mudah, sambil memperoleh faedah pilihan model, penghalaan kos dan pengebilan bersatu — sambil terus menggunakan UI setempat dan ciri RAG/ejen AnythingLLM.

Apakah AnythingLLM dan mengapa anda mahu menyambungkannya ke CometAPI?

Apakah AnythingLLM?

AnythingLLM ialah aplikasi AI sumber terbuka serba lengkap dan klien setempat/awan untuk membina pembantu sembang, aliran kerja retrieval-augmented generation (RAG) dan ejen dipacu LLM. Ia menyediakan UI yang kemas, API pembangun, ciri ruang kerja/ejen, serta sokongan untuk LLM setempat dan awan — direka agar peribadi secara lalai dan boleh diperluas melalui pemalam. AnythingLLM mendedahkan penyedia Generic OpenAI yang membolehkan ia berkomunikasi dengan API LLM yang serasi dengan OpenAI.

Apakah CometAPI?

CometAPI ialah platform pengagregatan API komersial yang mendedahkan 500+ model AI melalui satu antara muka REST gaya OpenAI dan pengebilan bersatu. Secara praktikalnya, ia membolehkan anda memanggil model daripada pelbagai vendor (OpenAI, Anthropic, varian Google/Gemini, model imej/audio, dll.) melalui titik akhir https://api.cometapi.com/v1 yang sama dan satu kunci API (format sk-xxxxx). CometAPI menyokong titik akhir standard gaya OpenAI seperti /v1/chat/completions, /v1/embeddings, dan sebagainya, yang memudahkan penyesuaian untuk alat yang sedia menyokong API serasi OpenAI.

Mengapa mengintegrasikan AnythingLLM dengan CometAPI?

Tiga sebab praktikal:

- Pilihan model & fleksibiliti vendor: AnythingLLM boleh menggunakan “mana-mana yang serasi OpenAI” melalui pembungkus Generic OpenAI. Menghala pembungkus itu ke CometAPI memberikan akses segera kepada ratusan model tanpa mengubah UI atau aliran AnythingLLM.

- Pengoptimuman kos/operasi: Menggunakan CometAPI membolehkan anda menukar model (atau beralih kepada model lebih murah) secara berpusat untuk kawalan kos, dan mengekalkan pengebilan bersatu tanpa mengurus berbilang kunci pembekal.

- Percubaan lebih pantas: Anda boleh A/B pelbagai model (contohnya

gpt-4o,gpt-4.5, varian Claude, atau model multimodal sumber terbuka) melalui UI AnythingLLM yang sama — berguna untuk ejen, respons RAG, penyeragaman, dan tugas multimodal.

Persekitaran dan syarat yang perlu anda sediakan sebelum integrasi

Keperluan sistem & perisian (peringkat tinggi)

- Desktop atau pelayan yang menjalankan AnythingLLM (Windows, macOS, Linux) — pemasangan desktop atau contoh hos sendiri. Sahkan anda menggunakan binaan terkini yang memaparkan tetapan LLM Preferences / AI Providers.

- Akaun CometAPI dan kunci API (rahsia gaya

sk-xxxxx). Anda akan menggunakan rahsia ini dalam penyedia Generic OpenAI AnythingLLM. - Kesambungan rangkaian daripada mesin anda ke

https://api.cometapi.com(tiada firewall yang menyekat HTTPS keluar). - Pilihan tetapi disyorkan: persekitaran Python atau Node moden untuk ujian (Python 3.10+ atau Node 18+), curl, dan klien HTTP (Postman / HTTPie) untuk semakan pantas CometAPI sebelum dihubungkan ke AnythingLLM.

Syarat khusus AnythingLLM

Penyedia LLM Generic OpenAI ialah laluan yang disyorkan untuk titik akhir yang meniru permukaan API OpenAI. Dokumentasi AnythingLLM memberi amaran bahawa penyedia ini berfokus pembangun dan anda harus memahami input yang dibekalkan. Jika anda menggunakan penstriman atau titik akhir anda tidak menyokong penstriman, AnythingLLM menyertakan tetapan untuk melumpuhkan penstriman bagi Generic OpenAI.

Senarai semak keselamatan & operasi

- Layan kunci CometAPI seperti rahsia lain — jangan komit ke repositori; simpan dalam rantai kunci OS atau pemboleh ubah persekitaran jika boleh.

- Jika anda merancang menggunakan dokumen sensitif dalam RAG, pastikan jaminan privasi titik akhir memenuhi keperluan pematuhan anda (semak dokumen/terma CometAPI).

- Tetapkan token maksimum dan had tetingkap konteks untuk mengelakkan bil melambung.

Bagaimana anda mengkonfigurasi AnythingLLM untuk menggunakan CometAPI (langkah demi langkah)?

Di bawah ialah urutan langkah konkrit — diikuti pemboleh ubah persekitaran contoh dan petikan kod untuk menguji sambungan sebelum anda menyimpan tetapan dalam UI AnythingLLM.

Langkah 1 — Dapatkan kunci CometAPI anda

- Daftar atau log masuk di CometAPI.

- Navigasi ke “API Keys” dan jana kunci — anda akan menerima rentetan seperti

sk-xxxxx. Simpan sebagai rahsia.

Langkah 2 — Sahkan CometAPI berfungsi dengan permintaan pantas

Gunakan curl atau Python untuk memanggil titik akhir chat completion ringkas bagi mengesahkan kesalinghubungan.

Contoh curl

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-xxxxx" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-4o",

"messages": ,

"max_tokens": 50

}'

Jika ini memulangkan 200 dan respons JSON dengan tatasusunan choices, kunci dan rangkaian anda berfungsi. (Dokumen CometAPI menunjukkan permukaan dan titik akhir gaya OpenAI).

Contoh Python (requests)

import requests

url = "https://api.cometapi.com/v1/chat/completions"

headers = {"Authorization": "Bearer sk-xxxxx", "Content-Type": "application/json"}

payload = {

"model": "gpt-4o",

"messages": ,

"max_tokens": 64

}

r = requests.post(url, json=payload, headers=headers, timeout=15)

print(r.status_code, r.json())

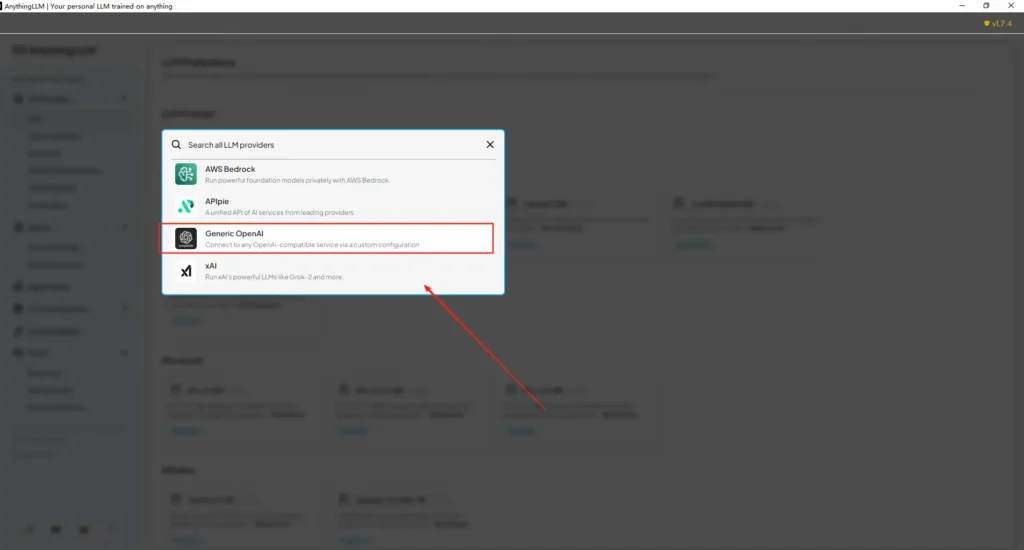

Langkah 3 — Konfigurasikan AnythingLLM (UI)

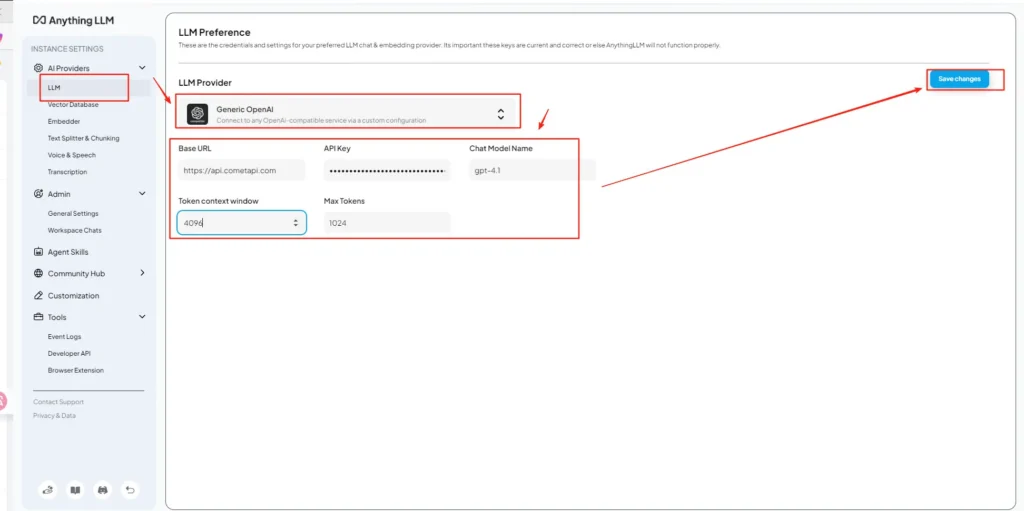

Buka AnythingLLM → Settings → AI Providers → LLM Preferences (atau laluan serupa dalam versi anda). Gunakan penyedia Generic OpenAI dan isi medan seperti berikut:

API Configuration (contoh)

• Masuk menu tetapan AnythingLLM, cari LLM Preferences di bawah AI Providers.

• Pilih Generic OpenAI sebagai penyedia model, masukkanhttps://api.cometapi.com/v1dalam medan URL.

• Tampalsk-xxxxxdaripada CometAPI dalam kotak input API key. Isikan Token context window dan Max Tokens mengikut model sebenar. Anda juga boleh menyesuaikan nama model pada halaman ini, seperti menambah modelgpt-4o.

Ini sejajar dengan panduan “Generic OpenAI” AnythingLLM (pembungkus pembangun) dan pendekatan URL asas yang serasi OpenAI CometAPI.

Langkah 4 — Tetapkan nama model & had token

Pada skrin tetapan yang sama, tambah atau sesuaikan nama model tepat seperti yang diterbitkan CometAPI (cth., gpt-4o, minimax-m2, kimi-k2-thinking) supaya UI AnythingLLM boleh memaparkan model tersebut kepada pengguna. CometAPI menerbitkan rentetan model untuk setiap vendor.

Langkah 5 — Uji dalam AnythingLLM

Mulakan sembang baharu atau gunakan ruang kerja sedia ada, pilih penyedia Generic OpenAI (jika anda mempunyai berbilang penyedia), pilih salah satu nama model CometAPI yang anda tambah, dan jalankan arahan ringkas. Jika anda menerima penyiapan yang koheren, integrasi anda berjaya.

Bagaimana AnythingLLM menggunakan tetapan tersebut secara dalaman

Pembungkus Generic OpenAI AnythingLLM membina permintaan gaya OpenAI (/v1/chat/completions, /v1/embeddings), jadi sebaik sahaja anda menetapkan URL asas dan membekalkan kunci CometAPI, AnythingLLM akan merutekan sembang, panggilan ejen dan permintaan embedding melalui CometAPI secara telus. Jika anda menggunakan ejen AnythingLLM (aliran @agent), ia akan mewarisi penyedia yang sama.

Apakah amalan terbaik dan kemungkinan perangkap?

Amalan terbaik

- Gunakan tetapan konteks yang sesuai dengan model: Padankan Token Context Window dan Max Tokens AnythingLLM dengan model yang anda pilih di CometAPI. Ketidakpadanan menyebabkan pemotongan tidak dijangka atau panggilan gagal.

- Lindungi kunci API anda: Simpan kunci CometAPI dalam pemboleh ubah persekitaran dan/atau pengurus rahsia/Kubernetes; jangan sekali-kali semak masuk ke git. AnythingLLM akan menyimpan kunci dalam tetapan setempat jika anda memasukkannya di UI — anggap storan hos sebagai sensitif.

- Mulakan dengan model lebih murah/kecil untuk aliran percubaan: Gunakan CometAPI untuk mencuba model lebih rendah kos bagi pembangunan, dan simpan model premium untuk produksi. CometAPI secara jelas mengiklankan pertukaran kos dan pengebilan bersatu.

- Pantau penggunaan & tetapkan amaran: CometAPI menyediakan papan pemuka penggunaan — tetapkan bajet/amaran untuk mengelakkan bil mengejut.

- Uji ejen dan alat secara berasingan: Ejen AnythingLLM boleh mencetuskan tindakan; uji dengan arahan selamat dan pada contoh staging terlebih dahulu.

Perangkap lazim

- Konflik UI vs

.env: Apabila menghos sendiri, tetapan UI boleh menimpa perubahan.env(dan sebaliknya). Semak/app/server/.envyang dijana jika tetapan kembali asal selepas mula semula. Isu komuniti melaporkanLLM_PROVIDERditetapkan semula. - Nama model tidak sepadan: Menggunakan nama model yang tiada pada CometAPI akan menyebabkan 400/404 daripada gerbang. Sentiasa sahkan model tersedia pada senarai model CometAPI.

- Had token & penstriman: Jika anda memerlukan respons penstriman, sahkan model CometAPI menyokong penstriman (dan versi UI AnythingLLM anda menyokongnya). Sesetengah pembekal berbeza dari segi semantik penstriman.

Apakah kes penggunaan dunia sebenar yang dibolehkan oleh integrasi ini?

Retrieval-Augmented Generation (RAG)

Gunakan pemuat dokumen + pangkalan data vektor AnythingLLM dengan LLM CometAPI untuk menjana jawapan berasaskan konteks. Anda boleh bereksperimen dengan embedding murah + model sembang mahal, atau kekalkan semuanya pada CometAPI untuk pengebilan bersatu. Aliran RAG AnythingLLM ialah ciri terbina utama.

Automasi ejen

AnythingLLM menyokong aliran kerja @agent (melayari halaman, memanggil alat, menjalankan automasi). Menghala panggilan LLM ejen melalui CometAPI memberikan anda pilihan model untuk langkah kawalan/interpretasi tanpa mengubah kod ejen.

Ujian A/B berbilang model dan pengoptimuman kos

Tukar model mengikut ruang kerja atau ciri (cth., gpt-4o untuk jawapan produksi, gpt-4o-mini untuk pembangunan). CometAPI memudahkan pertukaran model dan memusatkan kos.

Saluran multimodal

CometAPI menyediakan model imej, audio dan khusus. Sokongan multimodal AnythingLLM (melalui penyedia) ditambah model CometAPI membolehkan kapsyen imej, penyeragaman multimodal atau transkripsi audio melalui antara muka yang sama.

Kesimpulan

CometAPI terus memposisikan dirinya sebagai gerbang berbilang model (500+ model, API gaya OpenAI) — menjadikannya rakan semula jadi untuk aplikasi seperti AnythingLLM yang sudah menyokong penyedia Generic OpenAI. Begitu juga, penyedia Generic AnythingLLM dan pilihan konfigurasi terkini memudahkan sambungan ke gerbang sebegini. Konvergensi ini mempermudah percubaan dan migrasi produksi pada akhir 2025.

Cara untuk bermula dengan Comet API

CometAPI ialah platform API bersatu yang mengagregat lebih 500 model AI daripada penyedia terkemuka—seperti siri GPT OpenAI, Gemini Google, Claude Anthropic, Midjourney, Suno, dan banyak lagi—ke dalam satu antara muka yang mesra pembangun. Dengan menawarkan pengesahan konsisten, pemformatan permintaan dan pengendalian respons seragam, CometAPI banyak memudahkan integrasi keupayaan AI ke dalam aplikasi anda. Sama ada anda membina chatbot, penjana imej, penggubah muzik atau saluran analitik berasaskan data, CometAPI membolehkan anda beriterasi lebih pantas, mengawal kos dan kekal agnostik vendor—sambil memanfaatkan kemajuan terkini merentasi ekosistem AI.

Untuk bermula, terokai keupayaan modelCometAPI di Playground dan rujuk panduan API untuk arahan terperinci. Sebelum mengakses, pastikan anda telah log masuk ke CometAPI dan memperoleh kunci API. CometAPI menawarkan harga yang jauh lebih rendah daripada harga rasmi untuk membantu anda melakukan integrasi.

Sedia untuk bermula?→ Daftar CometAPI hari ini!

Jika anda mahu mengetahui lebih banyak tip, panduan dan berita tentang AI, ikuti kami di VK, X dan Discord!