Apakah GPT-5.2 API

GPT-5.2 API adalah sama seperti GPT-5.2 Thinking dalam ChatGPT. GPT-5.2 Thinking ialah varian peringkat pertengahan dalam keluarga GPT-5.2 yang direka untuk kerja yang lebih mendalam: penaakulan berbilang langkah, pemeringkasan dokumen panjang, penjanaan kod berkualiti, dan kerja pengetahuan profesional di mana ketepatan serta struktur yang boleh digunakan lebih penting berbanding kadar keluaran mentah. Dalam API, ia diakses sebagai model gpt-5.2 (Responses API / Chat Completions), dan ia berada di antara varian Instant berkelewatan rendah dan varian Pro yang berkualiti lebih tinggi tetapi lebih mahal.

Ciri utama

- Konteks sangat panjang & pemampatan: tetingkap berkesan 400K dan alat pemampatan untuk mengurus kerelevanan merentas perbualan dan dokumen yang panjang.

- Usaha penaakulan boleh dikonfigurasikan:

none | medium | high | xhigh(xhigh membolehkan pengiraan dalaman maksimum untuk penaakulan sukar).xhighdisediakan untuk varian Thinking/Pro. - Sokongan alat dan fungsi yang lebih kukuh: pemanggilan alat bertaraf pertama, tatabahasa (CFG/Lark) untuk mengehadkan keluaran berstruktur, dan tingkah laku berasaskan agen yang dipertingkat yang memudahkan automasi berbilang langkah yang kompleks.

- Pemahaman multimodal: kefahaman teks + imej yang lebih kaya dan penyepaduan ke dalam tugas berbilang langkah.

- Keselamatan / pengendalian kandungan sensitif yang ditambah baik: intervensi tersasar untuk mengurangkan respons yang tidak diingini dalam bidang seperti mencederakan diri dan konteks sensitif lain.

Keupayaan teknikal & spesifikasi (pandangan pembangun)

- Titik akhir API & ID model:

gpt-5.2untuk Thinking (Responses API),gpt-5.2-chat-latestuntuk aliran kerja chat/instant, dangpt-5.2-prountuk tier Pro; tersedia melalui Responses API dan Chat Completions seperti yang dinyatakan. - Token penaakulan & pengurusan usaha: API menyokong parameter eksplisit untuk memperuntukkan pengiraan (usaha penaakulan) bagi setiap permintaan; usaha lebih tinggi meningkatkan kependaman dan kos tetapi memperbaiki kualiti output untuk tugas yang kompleks.

- Alat keluaran berstruktur: sokongan untuk tatabahasa (Lark / CFG) bagi mengehadkan output model kepada DSL atau sintaks tepat (berguna untuk penjanaan SQL, JSON, DSL).

- Pemanggilan alat selari & koordinasi berasaskan agen: paralelisme yang dipertingkat dan orkestrasi alat yang lebih bersih mengurangkan keperluan untuk gesaan sistem yang rumit dan rangka kerja berbilang agen.

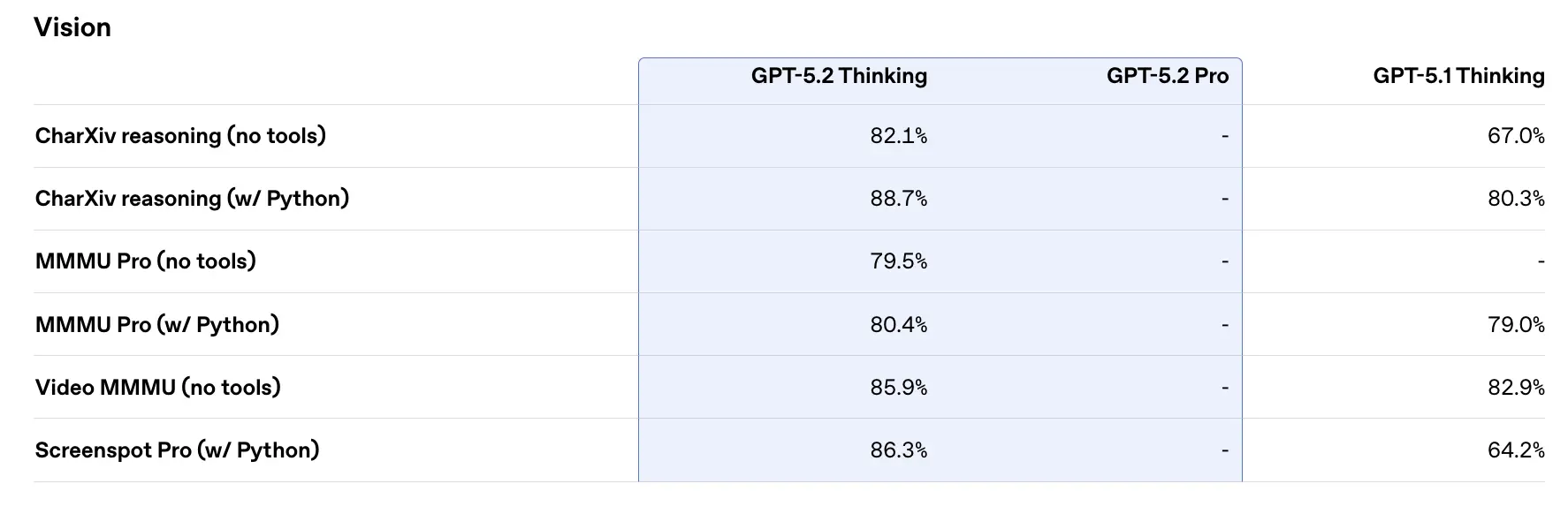

Prestasi penanda aras & data sokongan

OpenAI menerbitkan pelbagai keputusan penanda aras dalaman dan luaran untuk GPT-5.2. Sorotan terpilih (angka yang dilaporkan oleh OpenAI):

- GDPval (44 pekerjaan, kerja pengetahuan) — GPT-5.2 Thinking “mengatasi atau menyamai profesional industri terbaik dalam 70.9% perbandingan”; OpenAI melaporkan output dihasilkan pada >11× kelajuan dan <1% kos berbanding profesional pakar pada tugas GDPval mereka (anggaran kelajuan dan kos adalah berasaskan sejarah). Tugas ini termasuk model hamparan, pembentangan dan video pendek.

- SWE-Bench Pro (pengkodan) — GPT-5.2 Thinking mencapai ≈55.6% pada SWE-Bench Pro dan ~80% pada SWE-Bench Verified (hanya Python) menurut OpenAI, menetapkan keadaan seni baharu untuk penjanaan kod / penilaian kejuruteraan dalam ujian mereka. Ini diterjemahkan kepada penyahpepijatan yang lebih boleh dipercayai dan pembaikan hujung-ke-hujung dalam amalan, menurut contoh OpenAI.

- GPQA Diamond (Soal Jawab peringkat siswazah sains) — GPT-5.2 Pro: 93.2%, GPT-5.2 Thinking: 92.4% pada GPQA Diamond (tiada alat, penaakulan maksimum).

- Siri ARC-AGI — Pada ARC-AGI-2 (penanda aras penaakulan “fluid” yang lebih sukar), GPT-5.2 Thinking mencatat 52.9% dan GPT-5.2 Pro 54.2% (OpenAI menyatakan ini adalah tanda aras baharu untuk model gaya chain-of-thought).

- Konteks panjang (OpenAI MRCRv2) — GPT-5.2 Thinking menunjukkan ketepatan hampir 100% pada varian MRCR 4-needle sehingga 256k token dan peningkatan markah yang ketara berbanding GPT-5.1 merentas tetapan konteks panjang. (OpenAI menerbitkan carta dan jadual MRCRv2.)

Perbandingan dengan model kontemporari

- berbanding Google Gemini 3 (Gemini 3 Pro / Deep Think): Gemini 3 Pro telah dihebahkan dengan tetingkap konteks token ~1,048,576 (≈1M) dan input multimodal yang luas (teks, imej, audio, video, PDF) serta integrasi berasaskan agen yang kukuh melalui Vertex AI / AI Studio. Atas kertas, tetingkap konteks Gemini 3 yang lebih besar ialah pembeza untuk beban kerja sesi tunggal yang sangat besar; kompromi termasuk permukaan perkakas dan kesesuaian ekosistem.

- berbanding Anthropic Claude Opus 4.5: Opus 4.5 menekankan aliran kerja pengkodan/agen perusahaan dan melaporkan keputusan SWE-bench yang kukuh serta ketahanan untuk sesi agen yang panjang; Anthropic memposisikan Opus untuk automasi dan penjanaan kod dengan tetingkap konteks 200k dan integrasi agen/Excel khusus. Opus 4.5 ialah pesaing yang kuat dalam automasi perusahaan dan tugas kod.

Kesimpulan praktikal: GPT-5.2 menyasarkan set peningkatan yang seimbang (konteks 400k, output token tinggi, penaakulan/pengkodan dipertingkat). Gemini 3 menyasarkan konteks sesi tunggal terbesar (≈1M), manakala Claude Opus memberi tumpuan kepada kejuruteraan perusahaan dan kekukuhan berasaskan agen. Pilih dengan memadankan saiz konteks, keperluan modaliti, kesesuaian ciri/perkakas, serta kompromi kos/kependaman.

Cara mengakses dan menggunakan GPT-5.2 API

Langkah 1: Daftar untuk Kunci API

Log masuk ke cometapi.com. Jika anda belum menjadi pengguna kami, sila daftar terlebih dahulu. Log masuk ke CometAPI console. Dapatkan kunci API kelayakan akses untuk antara muka. Klik “Add Token” pada token API di pusat peribadi, dapatkan kunci token: sk-xxxxx dan hantar.

Langkah 2: Hantar Permintaan ke GPT-5.2 API

Pilih titik akhir “gpt-5.2” untuk menghantar permintaan API dan tetapkan badan permintaan. Kaedah permintaan dan badan permintaan diperoleh daripada dokumen API di laman web kami. Laman web kami juga menyediakan ujian Apifox untuk kemudahan anda. Gantikan <YOUR_API_KEY> dengan kunci CometAPI sebenar anda daripada akaun anda. Pembangun memanggil ini melalui Responses API / Chat endpoints.

Masukkan soalan atau permintaan anda ke dalam medan content—inilah yang akan dijawab oleh model. Proses respons API untuk mendapatkan jawapan yang dijana.

Langkah 3: Dapatkan dan Sahkan Keputusan

Proses respons API untuk mendapatkan jawapan yang dijana. Selepas pemprosesan, API membalas dengan status tugas dan data output.

Lihat juga Gemini 3 Pro Preview API