GLM-4.6 ialah keluaran utama terkini dalam keluarga GLM Z.ai (dahulu Zhipu AI): model MoE (Campuran Pakar) bahasa besar generasi ke-4 yang ditala untuk aliran kerja berasaskan agen, penaakulan konteks panjang dan pengkodan dunia sebenar. Keluaran ini menekankan integrasi agen/alat yang praktikal, tetingkap konteks yang sangat besar, dan ketersediaan pemberat terbuka untuk penggunaan setempat.

Ciri utama

- Konteks panjang — tetingkap konteks asli 200K token (dikembangkan daripada 128K). (docs.z.ai)

- Keupayaan pengkodan & agenik — penambahbaikan yang dipasarkan pada tugas pengkodan dunia sebenar dan pemanggilan alat yang lebih baik untuk agen.

- Kecekapan — dilaporkan ~30% penggunaan token lebih rendah berbanding GLM-4.5 pada ujian Z.ai.

- Penyebaran & kuantisasi — pengumuman pertama integrasi FP8 dan Int4 untuk cip Cambricon; sokongan FP8 asli pada Moore Threads melalui vLLM.

- Saiz model & jenis tensor — artifak yang diterbitkan menunjukkan model ~357B parameter (tensor BF16 / F32) di Hugging Face.

Perincian teknikal

Modaliti & format. GLM-4.6 ialah LLM berasaskan teks sahaja (modaliti input dan output: teks). Panjang konteks = 200K token; output maksimum = 128K token.

Kuantisasi & sokongan perkakasan. Pasukan melaporkan kuantisasi FP8/Int4 pada cip Cambricon dan FP8 asli pada GPU Moore Threads menggunakan vLLM untuk inferens — penting untuk menurunkan kos inferens dan membolehkan penggunaan di premis dan awan domestik.

Alatan & integrasi. GLM-4.6 diagihkan melalui API Z.ai, rangkaian penyedia pihak ketiga (cth., CometAPI), dan diintegrasikan ke dalam agen pengkodan (Claude Code, Cline, Roo Code, Kilo Code).

Perincian teknikal

Modaliti & format. GLM-4.6 ialah LLM berasaskan teks sahaja (modaliti input dan output: teks). Panjang konteks = 200K token; output maksimum = 128K token.

Kuantisasi & sokongan perkakasan. Pasukan melaporkan kuantisasi FP8/Int4 pada cip Cambricon dan FP8 asli pada GPU Moore Threads menggunakan vLLM untuk inferens — penting untuk menurunkan kos inferens dan membolehkan penggunaan di premis dan awan domestik.

Alatan & integrasi. GLM-4.6 diagihkan melalui API Z.ai, rangkaian penyedia pihak ketiga (cth., CometAPI), dan diintegrasikan ke dalam agen pengkodan (Claude Code, Cline, Roo Code, Kilo Code).

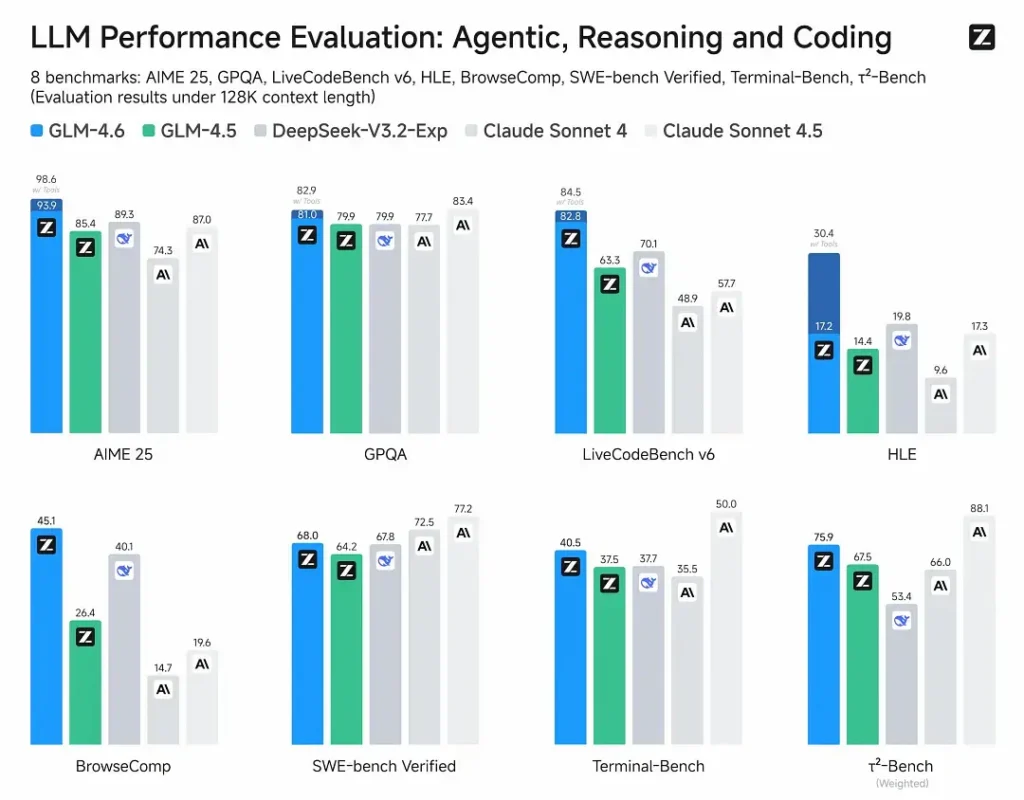

Prestasi penanda aras

- Penilaian diterbitkan: GLM-4.6 diuji pada lapan penanda aras awam meliputi agen, penaakulan dan pengkodan serta menunjukkan peningkatan jelas berbanding GLM-4.5. Pada ujian pengkodan dunia sebenar yang dinilai manusia (CC-Bench lanjutan), GLM-4.6 menggunakan ~15% token lebih sedikit berbanding GLM-4.5 dan mencatat kadar kemenangan ~48.6% berbanding Claude Sonnet 4 keluaran Anthropic (hampir setara pada banyak papan pendahulu).

- Kedudukan: keputusan mendakwa GLM-4.6 kompetitif dengan model terkemuka domestik dan antarabangsa (contoh yang disebut termasuk DeepSeek-V3.1 dan Claude Sonnet 4).

Batasan & risiko

- Halusinasi & kesilapan: seperti semua LLM semasa, GLM-4.6 boleh dan memang membuat kesilapan fakta — dokumen Z.ai secara jelas memberi amaran bahawa output mungkin mengandungi kesilapan. Pengguna harus menggunakan pengesahan & pengambilan/RAG untuk kandungan kritikal.

- Kerumitan model & kos penyajian: konteks 200K dan output yang sangat besar meningkatkan dengan ketara keperluan memori & kependaman dan boleh menaikkan kos inferens; kejuruteraan kuantisasi/inferens diperlukan untuk berjalan pada skala.

- Jurang domain: walaupun GLM-4.6 melaporkan prestasi agen/pengkodan yang kukuh, beberapa laporan awam menyatakan ia masih ketinggalan versi tertentu model bersaing dalam mikropenanda aras tertentu (cth., beberapa metrik pengkodan berbanding Sonnet 4.5). Nilai mengikut tugas sebelum menggantikan model produksi.

- Keselamatan & dasar: pemberat terbuka meningkatkan kebolehcapaian tetapi juga menimbulkan persoalan penjagaan (mitigasi, pagar pengaman, dan red-teaming kekal menjadi tanggungjawab pengguna).

Kes penggunaan

- Sistem berasaskan agen & orkestrasi alat: jejak agen panjang, perancangan berbilang alat, pemanggilan alat dinamik; penalaan berorientasikan agen ialah titik jualan utama model.

- Pembantu pengkodan dunia sebenar: penjanaan kod berbilang pusingan, semakan kod dan pembantu IDE interaktif (diintegrasikan dalam Claude Code, Cline, Roo Code — menurut Z.ai). Peningkatan kecekapan token menjadikannya menarik untuk pelan pembangun penggunaan berat.

- Aliran kerja dokumen panjang: pemingkasan, sintesis berbilang dokumen, ulasan undang-undang/teknikal yang panjang berkat tetingkap 200K.

- Penciptaan kandungan & watak maya: dialog lanjutan, penyelenggaraan persona yang konsisten dalam senario berbilang pusingan.

Cara GLM-4.6 dibandingkan dengan model lain

- GLM-4.5 → GLM-4.6: perubahan besar dalam saiz konteks (128K → 200K) dan kecekapan token (~15% token lebih sedikit pada CC-Bench); penggunaan agen/alat yang dipertingkat.

- GLM-4.6 vs Claude Sonnet 4 / Sonnet 4.5: Z.ai melaporkan hampir setara pada beberapa papan pendahulu dan kadar kemenangan ~48.6% pada tugas pengkodan dunia sebenar CC-Bench (iaitu persaingan rapat, dengan beberapa mikropenanda aras di mana Sonnet masih mendahului). Bagi banyak pasukan kejuruteraan, GLM-4.6 diposisikan sebagai alternatif berkecekapan kos.

- GLM-4.6 vs model konteks panjang lain (DeepSeek, varian Gemini, keluarga GPT-4): GLM-4.6 menekankan konteks besar & aliran kerja pengkodan berasaskan agen; kekuatan relatif bergantung pada metrik (kecekapan token/integrasi agen vs ketepatan sintesis kod mentah atau saluran keselamatan). Pemilihan empirikal harus dipacu oleh tugas.

Model utama terkini Zhipu AI GLM-4.6 dilancarkan: 355B jumlah parameter, 32B aktif. Mengatasi GLM-4.5 dalam semua keupayaan teras.

- Pengkodan: Sejajar dengan Claude Sonnet 4, terbaik di China.

- Konteks: Dikembangkan kepada 200K (daripada 128K).

- Penaakulan: Dipertingkat, menyokong pemanggilan alat semasa inferens.

- Carian: Pemanggilan alat dan prestasi agen yang dipertingkat.

- Penulisan: Lebih sejajar dengan keutamaan manusia dalam gaya, kebolehbacaan, dan lakon peranan.

- Berbilang bahasa: Dipertingkat untuk terjemahan rentas bahasa.