Pada 19–20 November 2025, OpenAI melancarkan dua naik taraf yang berkaitan tetapi berbeza: GPT-5.1-Codex-Max, model pengkodan beragensi baharu untuk Codex yang menekankan pengekodan jangka panjang, kecekapan token, dan “pemadatan” untuk mengekalkan sesi berbilang tetingkap; serta GPT-5.1 Pro, model ChatGPT peringkat Pro yang dikemas kini dan ditala untuk jawapan yang lebih jelas dan lebih berkeupayaan dalam kerja profesional yang kompleks.

Apakah GPT-5.1-Codex-Max dan masalah apa yang cuba diselesaikannya?

GPT-5.1-Codex-Max ialah model Codex khusus daripada OpenAI yang ditala untuk aliran kerja pengkodan yang memerlukan penaakulan dan pelaksanaan jangka panjang yang berterusan. Apabila model biasa boleh tergelincir oleh konteks yang sangat panjang — contohnya, refaktor berbilang fail, gelung agen yang kompleks, atau tugas CI/CD berterusan — Codex-Max direka untuk memadatkan dan mengurus keadaan sesi secara automatik merentasi berbilang tetingkap konteks, membolehkannya terus bekerja secara koheren apabila satu projek merentangi beribu-ribu (atau lebih) token. OpenAI memposisikan Codex-Max sebagai langkah seterusnya untuk menjadikan agen berkeupayaan kod benar-benar berguna bagi kerja kejuruteraan yang berpanjangan.

Apakah GPT-5.1-Codex-Max dan masalah apa yang cuba diselesaikannya?

GPT-5.1-Codex-Max ialah model Codex khusus daripada OpenAI yang ditala untuk aliran kerja pengkodan yang memerlukan penaakulan dan pelaksanaan jangka panjang yang berterusan. Apabila model biasa boleh tergelincir oleh konteks yang sangat panjang — contohnya, refaktor berbilang fail, gelung agen yang kompleks, atau tugas CI/CD berterusan — Codex-Max direka untuk memadatkan dan mengurus keadaan sesi secara automatik merentasi berbilang tetingkap konteks, membolehkannya terus bekerja secara koheren apabila satu projek merentangi beribu-ribu (atau lebih) token.

Ia digambarkan oleh OpenAI sebagai “lebih pantas, lebih pintar, dan lebih cekap token pada setiap peringkat kitaran pembangunan,” dan dengan jelas bertujuan menggantikan GPT-5.1-Codex sebagai model lalai dalam permukaan Codex.

Ciri pantas

- Pemadatan untuk kesinambungan berbilang tetingkap: memangkas dan mengekalkan konteks kritikal untuk bekerja secara koheren sepanjang berjuta-juta token dan jam. 0

- Kecekapan token yang dipertingkat berbanding GPT-5.1-Codex: sehingga ~30% lebih sedikit token pemikiran untuk usaha penaakulan yang serupa pada beberapa penanda aras kod.

- Ketahanan beragensi jangka panjang: diperhati secara dalaman dapat mengekalkan gelung agen berjam-jam/berhari-hari (OpenAI mendokumentasikan ujian dalaman >24 jam).

- Integrasi platform: tersedia hari ini dalam Codex CLI, sambungan IDE, awan, dan alat semakan kod; akses API akan datang.

- Sokongan persekitaran Windows: OpenAI secara khusus menyatakan Windows disokong buat pertama kali dalam aliran kerja Codex, memperluas jangkauan pembangun dunia sebenar.

Bagaimana ia dibandingkan dengan produk bersaing (cth., GitHub Copilot, AI pengkodan lain)?

GPT-5.1-Codex-Max diposisikan sebagai rakan kolaborasi autonomi jangka panjang berbanding alat pelengkapan per-permintaan. Sementara Copilot dan pembantu serupa cemerlang pada pelengkapan jangka dekat dalam editor, kekuatan Codex-Max adalah dalam mengorkestrakan tugas berbilang langkah, mengekalkan keadaan yang koheren merentas sesi, dan mengendalikan aliran kerja yang memerlukan perancangan, pengujian, dan iterasi. Begitu pun, pendekatan terbaik bagi kebanyakan pasukan ialah hibrid: gunakan Codex-Max untuk automasi kompleks dan tugas agen berterusan, dan gunakan pembantu lebih ringan untuk pelengkapan pada aras baris.

Bagaimanakah GPT-5.1-Codex-Max berfungsi?

Apakah “pemadatan” dan bagaimana ia membolehkan kerja jangka panjang?

Kemajuan teknikal teras ialah pemadatan — mekanisme dalaman yang memangkas sejarah sesi sambil mengekalkan bahagian konteks yang penting agar model dapat meneruskan kerja dengan koheren merentasi berbilang tetingkap konteks. Secara praktikalnya, ini bermaksud sesi Codex yang menghampiri had konteks akan dipadatkan (token lebih lama atau bernilai lebih rendah diringkaskan/diabadikan) supaya agen mendapat tetingkap baharu dan boleh terus beriterasi berulang kali sehingga tugas selesai. OpenAI melaporkan ujian dalaman di mana model bekerja pada tugas secara berterusan selama lebih daripada 24 jam.

Penaakulan adaptif dan kecekapan token

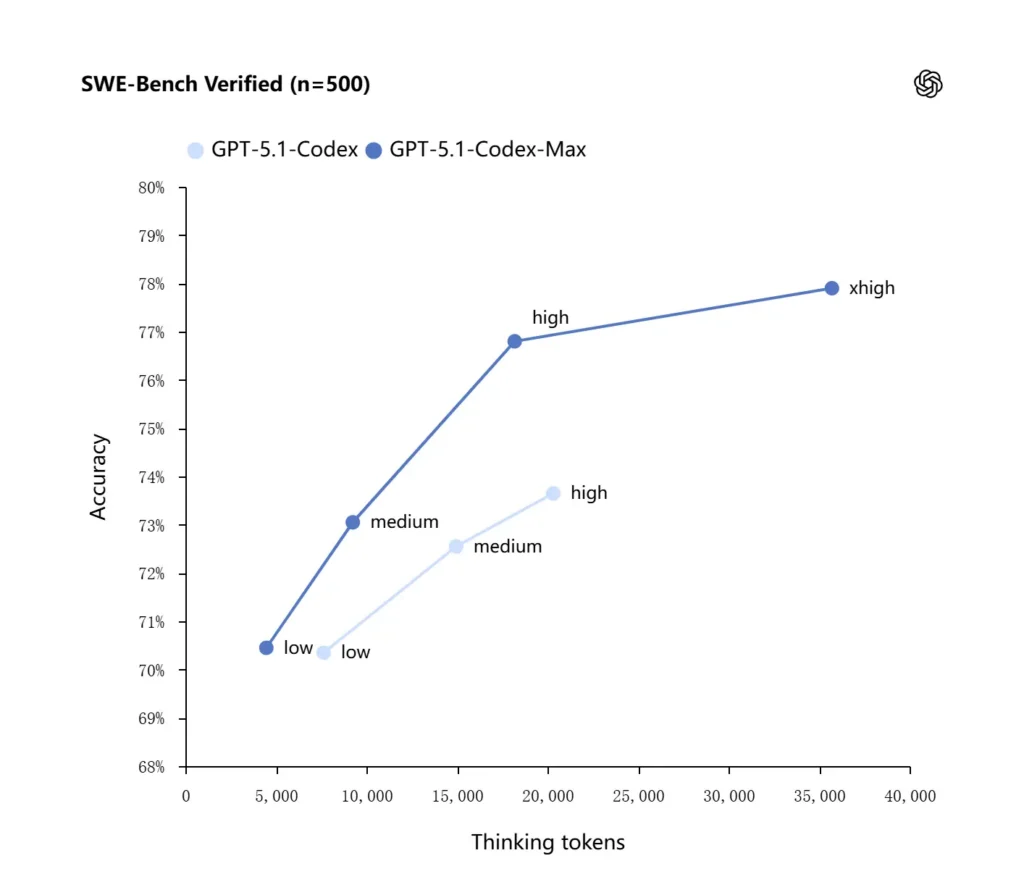

GPT-5.1-Codex-Max menggunakan strategi penaakulan yang dipertingkat yang menjadikannya lebih cekap token: dalam penanda aras dalaman yang dilaporkan OpenAI, model Max mencapai prestasi serupa atau lebih baik daripada GPT-5.1-Codex sambil menggunakan jauh lebih sedikit token “pemikiran” — OpenAI menyebut kira-kira 30% lebih sedikit token pemikiran pada SWE-bench Verified apabila dijalankan pada usaha penaakulan yang sama. Model ini juga memperkenalkan mod usaha penaakulan “Extra High (xhigh)” untuk tugas yang tidak sensitif kepada kependaman yang membolehkan ia membelanjakan lebih banyak penaakulan dalaman untuk menghasilkan output berkualiti lebih tinggi.

Integrasi sistem dan peralatan beragensi

Codex-Max diedarkan dalam aliran kerja Codex (CLI, sambungan IDE, awan, dan permukaan semakan kod) supaya ia boleh berinteraksi dengan rantaian alat pembangun sebenar. Integrasi awal termasuk Codex CLI dan agen IDE (VS Code, JetBrains, dsb.), dengan akses API yang dirancang menyusul. Matlamat reka bentuk bukan sahaja sintesis kod yang lebih bijak tetapi AI yang boleh menjalankan aliran kerja berbilang langkah: membuka fail, menjalankan ujian, membetulkan kegagalan, membuat refaktor, dan menjalankan semula.

Bagaimana prestasi GPT-5.1-Codex-Max pada penanda aras dan kerja sebenar?

Penaakulan berterusan dan tugas jangka panjang

Penilaian menunjukkan peningkatan yang boleh diukur dalam penaakulan berterusan dan tugas jangka panjang:

- Penilaian dalaman OpenAI: Codex-Max boleh bekerja pada tugas selama “lebih daripada 24 jam” dalam eksperimen dalaman dan bahawa pengintegrasian Codex dengan alat pembangun meningkatkan metrik produktiviti kejuruteraan dalaman (cth., penggunaan dan throughput pull request). Ini ialah dakwaan dalaman OpenAI dan menunjukkan penambahbaikan peringkat tugas dalam produktiviti dunia sebenar.

- Penilaian bebas (METR): Laporan bebas METR mengukur horizon masa 50% yang diperhatikan (statistik yang mewakili masa median model boleh mengekalkan tugas panjang secara koheren) untuk GPT-5.1-Codex-Max sekitar 2 jam 40 minit (dengan selang keyakinan yang luas), meningkat daripada 2 jam 17 minit untuk GPT-5 dalam ukuran sebanding — peningkatan bermakna yang menyokong naratif bahawa Codex-Max memperbaiki prestasi jangka panjang praktikal. Metodologi dan CI METR menekankan kebolehubahan, tetapi hasilnya menyokong naratif bahawa Codex-Max meningkatkan prestasi jangka panjang praktikal.

Penanda aras kod

OpenAI melaporkan hasil yang dipertingkat pada penilaian pengkodan frontier, terutamanya SWE-bench Verified di mana GPT-5.1-Codex-Max mengatasi GPT-5.1-Codex dengan kecekapan token yang lebih baik. Syarikat menekankan bahawa untuk usaha penaakulan “sederhana” yang sama, model Max menghasilkan keputusan yang lebih baik sambil menggunakan kira-kira 30% lebih sedikit token pemikiran; bagi pengguna yang membenarkan penaakulan dalaman lebih panjang, mod xhigh boleh lagi menaikkan jawapan dengan kos kependaman.

| GPT‑5.1-Codex (high) | GPT‑5.1-Codex-Max (xhigh) | |

| SWE-bench Verified (n=500) | 73.7% | 77.9% |

| SWE-Lancer IC SWE | 66.3% | 79.9% |

| Terminal-Bench 2.0 | 52.8% | 58.1% |

Bagaimanakah GPT-5.1-Codex-Max dibandingkan dengan GPT-5.1-Codex?

Perbezaan prestasi dan tujuan

- Skop: GPT-5.1-Codex ialah varian pengkodan berprestasi tinggi dalam keluarga GPT-5.1; Codex-Max jelas merupakan pengganti beragensi jangka panjang yang dimaksudkan untuk disyorkan sebagai lalai bagi persekitaran Codex dan seumpamanya.

- Kecekapan token: Codex-Max menunjukkan peningkatan ketara dalam kecekapan token (dakwaan OpenAI ~30% lebih sedikit token pemikiran) pada SWE-bench dan dalam penggunaan dalaman.

- Pengurusan konteks: Codex-Max memperkenalkan pemadatan dan pengendalian berbilang tetingkap secara natif untuk mengekalkan tugas yang melebihi satu tetingkap konteks; Codex tidak menyediakan keupayaan ini pada skala yang sama secara natif.

- Kesiapan peralatan: Codex-Max dihantar sebagai model Codex lalai merentas CLI, IDE, dan permukaan semakan kod, menandakan migrasi untuk aliran kerja pembangun produksi.

Bila patut menggunakan model yang mana?

- Gunakan GPT-5.1-Codex untuk bantuan pengkodan interaktif, suntingan pantas, refaktor kecil, dan kes penggunaan kependaman rendah di mana keseluruhan konteks berkaitan mudah muat dalam satu tetingkap.

- Gunakan GPT-5.1-Codex-Max untuk refaktor berbilang fail, tugas agen automatik yang memerlukan banyak kitaran iterasi, aliran kerja seperti CI/CD, atau apabila anda memerlukan model memegang perspektif peringkat projek merentasi banyak interaksi.

Corak prompt praktikal, dan contoh untuk hasil terbaik?

Corak pemasaan yang berkesan

- Nyatakan matlamat dan kekangan dengan jelas: “Refactor X, kekalkan API awam, kekalkan nama fungsi, dan pastikan ujian A,B,C lulus.”

- Sediakan konteks boleh dihasilkan semula yang minimum: pautkan ke ujian yang gagal, sertakan jejak tumpukan, dan serpihan fail berkaitan dan bukannya memuatkan keseluruhan repositori. Codex-Max akan memadatkan sejarah apabila perlu.

- Gunakan arahan berperingkat untuk tugas kompleks: pecahkan kerja besar kepada urutan subtugas, dan biarkan Codex-Max mengiterasinya (cth., “1) jalankan ujian 2) baiki 3 ujian gagal teratas 3) jalankan linter 4) ringkaskan perubahan”).

- Minta penjelasan dan diff: minta kedua-dua tampalan dan rasional ringkas supaya penyemak manusia boleh menilai keselamatan dan niat dengan cepat.

Templat prompt contoh

Tugas refaktor

“Refactor the

payment/module to extract payment processing intopayment/processor.py. Keep public function signatures stable for existing callers. Create unit tests forprocess_payment()that cover success, network failure, and invalid card. Run the test suite and return failing tests and a patch in unified diff format.”

Pembaikan pepijat + ujian

“A test

tests/test_user_auth.py::test_token_refreshfails with traceback . Investigate root cause, propose a fix with minimal changes, and add a unit test to prevent regression. Apply patch and run tests.”

Penjanaan PR beriterasi

“Implement feature X: add endpoint

POST /api/exportwhich streams export results and is authenticated. Create the endpoint, add docs, create tests, and open a PR with summary and checklist of manual items.”

Bagi kebanyakan ini, mulakan dengan usaha medium; tukar kepada xhigh apabila anda memerlukan model melakukan penaakulan mendalam merentasi banyak fail dan berbilang iterasi ujian.

Bagaimana untuk mengakses GPT-5.1-Codex-Max

Di mana ia tersedia hari ini

OpenAI telah mengintegrasikan GPT-5.1-Codex-Max ke dalam peralatan Codex hari ini: Codex CLI, sambungan IDE, awan, dan aliran semakan kod menggunakan Codex-Max secara lalai (anda boleh memilih Codex-Mini). Ketersediaan API sedang disediakan; GitHub Copilot mempunyai pratonton umum yang merangkumi model siri GPT-5.1 dan Codex.

Pembangun boleh mengakses GPT-5.1-Codex-Max dan GPT-5.1-Codex API melalui CometAPI. Untuk bermula, terokai keupayaan model CometAPI dalam Playground dan rujuk panduan API untuk arahan terperinci. Sebelum mengakses, pastikan anda telah log masuk ke CometAPI dan memperoleh kunci API. CometAPI menawarkan harga jauh lebih rendah daripada harga rasmi untuk membantu anda mengintegrasikan.

Sedia untuk bermula?→ Daftar untuk CometAPI hari ini!

Jika anda ingin mengetahui lebih banyak petua, panduan dan berita tentang AI ikuti kami di VK, X dan Discord!

Permulaan pantas (langkah demi langkah praktikal)

- Pastikan anda mempunyai akses: sahkan pelan produk ChatGPT/Codex anda (Plus, Pro, Business, Edu, Enterprise) atau pelan API pembangun anda menyokong model keluarga GPT-5.1/Codex.

- Pasang Codex CLI atau sambungan IDE: jika anda mahu menjalankan tugas kod secara setempat, pasang Codex CLI atau sambungan IDE untuk VS Code / JetBrains / Xcode yang berkenaan. Peralatan akan menetapkan GPT-5.1-Codex-Max sebagai lalai dalam seting yang disokong.

- Pilih usaha penaakulan: mulakan dengan usaha medium untuk kebanyakan tugas. Untuk penyahpepijatan mendalam, refaktor kompleks, atau apabila anda mahu model berfikir lebih keras dan anda tidak kisah tentang kependaman respons, tukar kepada mod high atau xhigh. Untuk pembaikan kecil yang pantas, low adalah munasabah.

- Sediakan konteks repositori: berikan model titik mula yang jelas — URL repo atau set fail dan arahan ringkas (cth., “refactor modul payment untuk menggunakan async I/O dan tambah ujian unit, kekalkan kontrak peringkat fungsi”). Codex-Max akan memadatkan sejarah apabila menghampiri had konteks dan meneruskan kerja.

- Ulang dengan ujian: selepas model menghasilkan tampalan, jalankan suit ujian dan maklumkan kegagalan sebagai sebahagian daripada sesi berterusan. Pemadatan dan kesinambungan berbilang tetingkap membolehkan Codex-Max mengekalkan konteks ujian gagal yang penting dan beriterasi.

Kesimpulan:

GPT-5.1-Codex-Max mewakili langkah besar ke arah pembantu pengkodan beragensi yang boleh mengekalkan tugas kejuruteraan yang kompleks dan berpanjangan dengan kecekapan dan penaakulan yang dipertingkat. Kemajuan teknikal (pemadatan, mod usaha penaakulan, latihan persekitaran Windows) menjadikannya sangat sesuai untuk organisasi kejuruteraan moden — dengan syarat pasukan memadankan model dengan kawalan operasi konservatif, dasar manusia-dalam-gelung yang jelas, dan pemantauan yang teguh. Bagi pasukan yang mengadopsinya dengan teliti, Codex-Max berpotensi mengubah cara perisian direka, diuji, dan diselenggara — mengubah kerja kejuruteraan berulang menjadi kolaborasi bernilai lebih tinggi antara manusia dan model.