GLM-5.1 mewakili perubahan penting dalam landskap AI. Ketika syarikat AI China mempercepatkan pengkomersialan sambil membuka sumber keupayaan termaju, model ini merapatkan jurang dengan peneraju proprietari seperti GPT-5.4 milik OpenAI, Claude Opus 4.6 milik Anthropic, dan Gemini 3.1 Pro milik Google—terutamanya dalam kejuruteraan perisian dunia nyata. Dilatih pada seni bina MoE 744B parameter yang sama seperti GLM-5 tetapi dioptimumkan secara mendalam untuk aliran kerja bergaya agen, ia cemerlang di tempat kebanyakan LLM gagal: tugas panjang, samar, dan beriterasi yang memerlukan perancangan, percubaan, penyahpepijatan, dan pembetulan diri merentas ribuan panggilan alat.

Kini, CometAPI mengintegrasikan GLM-5.1 dan GLM-5, dan pembangun juga boleh melihat model Barat teratas yang lain serta mengaksesnya pada harga API yang sangat rendah (yang juga merupakan kelebihan CometAPI berbanding pesaing lain).

Apakah GLM-5.1?

GLM-5.1 ialah model bahasa perdana terbaharu Z.ai dan dorongan terkini syarikat ke arah kerja perisian bergaya agen berjangka panjang. Menurut Z.ai sendiri, ia direka untuk tugas yang memerlukan pelaksanaan berterusan dan bukannya respons sekali gus, serta diposisikan sebagai model yang boleh merancang, melaksanakan, memperhalusi, dan menghantar dalam satu sesi lanjutan. Nota keluaran Z.ai menyatakan GLM-5.1 dibina dengan penalaan halus diawasi berbilang pusingan, pembelajaran peneguhan, dan rangka kerja penilaian kualiti proses, serta meningkatkan kestabilan, konsistensi, dan penggunaan alat merentasi tugas lanjutan.

Kedudukan itu penting kerana GLM-5.1 tidak dijual sebagai “sekadar satu lagi model sembang.” Ia disasarkan pada aliran kerja kejuruteraan di mana model perlu mengekalkan matlamat, mengendalikan langkah perantaraan, dan pulih daripada kesilapan tanpa kehilangan benang—sebagai model untuk perancangan autonomi, pelaksanaan berterusan, pembaikan pepijat, dan iterasi strategi, yang merupakan cerita produk yang sangat berbeza daripada pembantu kasual atau kopilot pengkodan konteks pendek.

Satu butiran praktikal yang berguna: GLM-5.1 hanya teks, ia disokong dalam GLM Coding Plan dan boleh digunakan dalam agen pengkodan popular seperti Claude Code dan OpenClaw, yang menjadikannya sangat relevan untuk pasukan yang mahu model berada dalam aliran kerja pembangun sedia ada dan bukannya menggantikannya.

Spesifikasi Teknikal Teras (Diwarisi dan Diperhalusi daripada GLM-5):

- Seni bina: Mixture-of-Experts (MoE) dengan 744 bilion jumlah parameter dan kira-kira 40 bilion parameter aktif bagi setiap inferens.

- Tetingkap Konteks: 203K–204.8K token (dengan sokongan sehingga 131K token output).

- Penambahbaikan Utama: DeepSeek Sparse Attention (DSA) untuk pengendalian konteks panjang yang cekap dan pengurangan kos penggelaran; prasarana pembelajaran peneguhan tak segerak lanjutan (melalui kerangka “slime” Z.ai) untuk pascapengajaran yang lebih berkesan.

- Ketersediaan: Open-weights (lesen MIT di Hugging Face melalui zai-org/GLM-5.1), akses API melalui platform Z.ai dan pengumpul seperti CometAPI, serta diintegrasikan ke dalam alat GLM Coding Plan (serasi dengan Claude Code / OpenClaw).

Tidak seperti model GLM terdahulu yang memfokuskan kecerdasan umum atau “vibe coding” pendek, GLM-5.1 menyasarkan agen autonomi gred produksi. Ia boleh merancang, melaksanakan, menanda aras, menyahpepijat, dan beriterasi pada projek kejuruteraan kompleks secara berdikari selama berjam-jam tanpa campur tangan manusia—keupayaan yang meletakkannya sebagai pesaing langsung kepada agen pengkodan khusus daripada Anthropic dan OpenAI.

Pelancaran ini bertepatan dengan kenaikan harga API ~10% (token input ~$0.54/M, output ~$4.40/M), namun masih jauh lebih murah berbanding setara seperti Opus 4.6 milik Anthropic (250–470% lebih mahal).

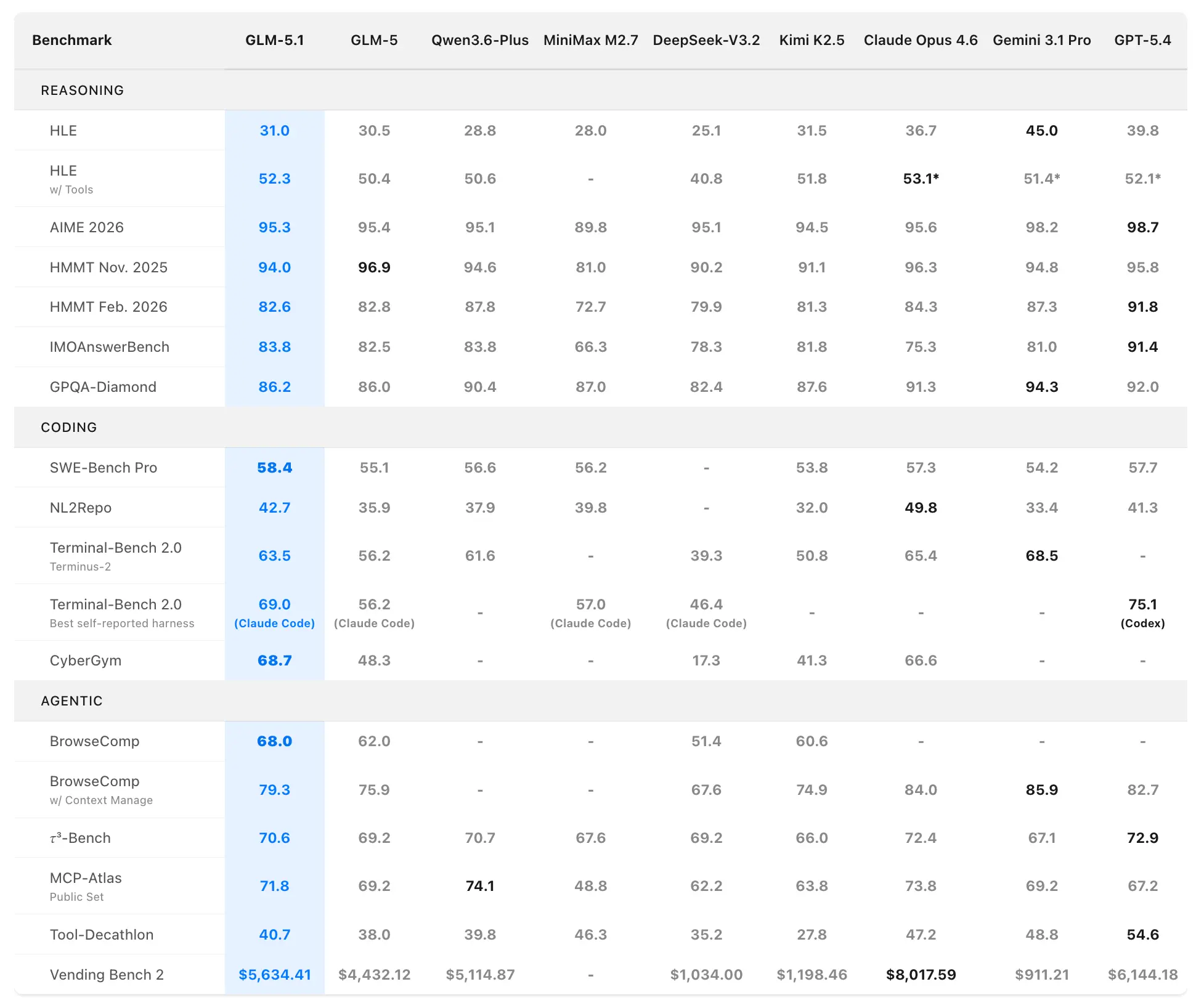

Prestasi Penanda Aras GLM-5.1

Z.ai memposisikan GLM-5.1 sebagai model sumber terbuka terkuat di dunia dan tiga teratas global dalam pengkodan bergaya agen. Data prestasi datang daripada penilaian rasmi pada SWE-Bench Pro, NL2Repo, Terminal-Bench 2.0, dan senario jangka panjang tersuai.

Penanda Aras Pengkodan dan Bergaya Agen

SWE-Bench Pro (tugas kejuruteraan perisian realistik yang memerlukan pelayaran repositori, penyuntingan kod, dan pengesahan fungsi):

- GLM-5.1: 58.4 (tahap terkini baharu)

- GLM-5: 55.1

- GPT-5.4: 57.7

- Claude Opus 4.6: 57.3

- Gemini 3.1 Pro: 54.2

GLM-5.1 ialah model domestik (China) dan sumber terbuka pertama yang menduduki tempat teratas pada penanda aras yang ketat ini, yang sangat mencerminkan aliran kerja pembangun profesional.

NL2Repo (bahasa semula jadi kepada penjanaan repositori penuh):

- GLM-5.1: 42.7 (jauh mendahului GLM-5 yang mencatat 35.9)

- Model kompetitif berada dalam julat 32.0–49.8 (pemimpin khusus berbeza mengikut harness).

Terminal-Bench 2.0 (tugas terminal dan sistem dunia nyata):

- Terminus-2 harness: GLM-5.1 63.5 (berbanding GLM-5 56.2)

- Laporan kendiri terbaik (Claude Code): Sehingga 69.0.

Dalam penilaian harness pengkodan berasingan (gaya Claude Code), GLM-5.1 mencatat 45.3—mencapai 94.6% daripada 47.9 milik Claude Opus 4.6 dan peningkatan 28% berbanding 35.4 milik GLM-5.

Kedudukan Komposit: #1 sumber terbuka, #1 model China, #3 global merentasi SWE-Bench Pro + NL2Repo + Terminal-Bench.

Prestasi Tugas Jangka Panjang: Pembeza Sebenar

Penanda aras standard mengukur prestasi sekali gus atau sesi pendek. GLM-5.1 menonjol dalam larian autonomi lanjutan:

- VectorDBBench Optimization (600+ iterasi, 6,000+ panggilan alat): Bermula daripada rangka Rust, GLM-5.1 secara beriterasi mereka semula pengindeksan, pemampatan, penghalaan, dan pemangkasan, mencapai 21.5k QPS (6× daripada rekod terbaik 50 pusingan sebelumnya iaitu 3,547 QPS oleh Claude Opus 4.6) sambil mengekalkan ≥95% recall pada SIFT-1M. Ia menunjukkan kemajuan “bertangga” dengan terobosan struktur setiap 100–200 iterasi.

- KernelBench Level 3 (pengoptimuman model ML penuh, 1,000+ pusingan): Pemecutan min geometri 3.6× merentasi 50 masalah kompleks (mengatasi 1.49× maksimum autotune torch.compile). GLM-5.1 terus bertambah baik lama selepas GLM-5 mendatar; hanya Claude Opus 4.6 mengatasinya pada 4.2×.

- Linux Desktop Web App Build (8+ jam, terbuka): Diberi hanya prom bahasa semula jadi tanpa kod permulaan, GLM-5.1 secara autonomi membina persekitaran desktop gaya Linux yang berfungsi—lengkap dengan bar tugas, tetingkap, interaksi, dan kemasan—di mana model sebelumnya hanya menghasilkan rangka asas.

Keputusan ini menunjukkan keupayaan GLM-5.1 untuk mengekalkan koheren, menilai diri, menyemak strategi, dan keluar daripada optima setempat merentasi ufuk yang sangat panjang—keupayaan yang Z.ai bina khusus untuk sistem agen dunia nyata.

Bagaimanakah GLM-5.1 berbeza daripada GLM-5?

GLM-5 dan GLM-5.1 berkait rapat, tetapi kedudukannya tidak sama. GLM-5 ialah model asas awal Z.AI untuk Agentic Engineering. Ia direka untuk kejuruteraan sistem kompleks dan tugas agen jarak jauh, dengan keupayaan pengkodan dan agen sumber terbuka SOTA, serta prestasi pengkodan yang menghampiri Claude Opus 4.5 dalam senario pengaturcaraan sebenar. Ia mencatat 77.8 pada SWE-bench Verified dan 56.2 pada Terminal Bench 2.0.

Sebaliknya, GLM-5.1 dibingkaikan sebagai langkah seterusnya ke arah tugas jangka panjang dan pelaksanaan berterusan yang lebih boleh dipercayai, meningkatkan kestabilan, konsistensi, dan penggunaan alat merentasi tugas lanjutan, serta lebih sejajar dengan Claude Opus 4.6 secara keseluruhan. Dengan kata lain, GLM-5 ialah model asas berorientasikan kejuruteraan yang terdahulu, manakala GLM-5.1 ialah perdana yang lebih tertumpu pada daya tahan tugas.

Terdapat juga perbezaan seni bina dan latihan dalam generasi GLM-5 yang membantu menerangkan lonjakan tersebut. GLM-5 berkembang daripada 355B parameter (32B diaktifkan) kepada 744B parameter (40B diaktifkan), meningkatkan data pralatih daripada 23T kepada 28.5T, menambah rangka kerja pembelajaran peneguhan tak segerak, dan mengintegrasikan DeepSeek Sparse Attention untuk mengekalkan kualiti teks panjang sambil meningkatkan kecekapan. Perincian tersebut terikat pada GLM-5, tetapi ia menjadi asas yang dibina oleh GLM-5.1.

GLM-5.1 vs Model Barisan Hadapan Lain

GLM-5.1 menonjol sebagai pesaing sumber terbuka terkuat sambil menawarkan nisbah harga/prestasi yang meyakinkan.

Jadual Perbandingan: Penanda Aras Pengkodan & Bergaya Agen Utama (April 2026)

| Model | SWE-Bench Pro | NL2Repo | Terminal-Bench 2.0 (Terminus-2) | Skor Harness Pengkodan | Berterusan Jangka Panjang? | Sumber Terbuka? | Anggaran Harga API (Input/Output per M token) |

|---|---|---|---|---|---|---|---|

| GLM-5.1 | 58.4 (SOTA) | 42.7 | 63.5 | 45.3 (94.6% daripada Opus) | Ya (600+ iter, 8 jam) | Ya | $0.54 / $4.40 |

| GLM-5 | 55.1 | 35.9 | 56.2 | 35.4 | Terhad | Ya | Lebih rendah (sebelum kenaikan) |

| GPT-5.4 | 57.7 | — | — | — | Kuat | Tidak | Lebih tinggi |

| Claude Opus 4.6 | 57.3 | — | — | 47.9 | Terkuat | Tidak | ~250–470% lebih mahal |

| Gemini 3.1 Pro | 54.2 | — | — | — | Baik | Tidak | Lebih tinggi |

Keputusan: GLM-5.1 menang pada kebolehcapaian sumber terbuka, kos, dan metrik pengkodan jangka panjang tertentu. Ia beradu dengan peneraju tertutup dalam senario bergaya agen sambil mendemokrasikan keupayaan termaju.

Senario aplikasi GLM-5.1

1) Kejuruteraan perisian autonomi

GLM-5.1 paling meyakinkan apabila tugas menyerupai pecutan kejuruteraan sebenar: baca kod pangkalan, rancang perubahan, laksanakannya, uji, baiki regresi, dan terus beriterasi sehingga hasilnya stabil. Nota keluaran Z.ai dengan jelas menekankan perancangan autonomi, pelaksanaan berterusan, pembaikan pepijat, dan iterasi strategi, yang menjadikan model ini terasa dibina khusus untuk agen pengkodan dan saluran penghantaran perisian.

2) Aliran kerja agen jangka panjang

Jika kes penggunaan anda melibatkan banyak panggilan alat, aliran kerja berbilang langkah yang panjang, atau pembetulan diri berulang, reka bentuk GLM-5.1 sangat sesuai. Dokumentasi menonjolkan pemanggilan alat, output berstruktur, integrasi MCP, dan sokongan penstriman alat—semuanya berguna apabila model bukan sekadar menjawab, tetapi beroperasi dalam sistem yang lebih besar.

3) Kerja pengetahuan perusahaan dan pelaporan

GLM-5.1 juga diposisikan untuk tugas produktiviti pejabat seperti aliran kerja PowerPoint, Word, PDF, dan Excel. Z.ai menyatakan ia meningkatkan pengaturan kandungan kompleks, reka letak, output berstruktur, dan sentuhan visual, yang menjadikannya sesuai untuk penjanaan laporan, bahan pengajaran, ringkasan penyelidikan, dan kerja dokumen berat yang lain.

4) Prototip front-end dan artifak

Z.ai menyatakan GLM-5.1 sesuai untuk penjanaan laman web, halaman interaktif, dan prototaip front-end, dengan struktur kurang bertemplat dan kualiti penyempurnaan tugas yang lebih baik. Ini menunjukkan padanan yang baik untuk pasukan produk yang memerlukan jambatan pantas daripada ringkasan kepada prototaip, terutamanya apabila prototaip mesti boleh digunakan dan bukan sekadar cantik.

5) Perbualan kompleks dan pematuhan arahan

Walaupun tajuk utamanya ialah pengkodan, GLM-5.1 juga digambarkan lebih kuat dalam Soal Jawab terbuka, arahan kompleks, dan interaksi berbilang pusingan. Ini menjadikannya berguna untuk aliran kerja gaya pembantu di mana model perlu menjejaki kekangan, menyemak output, dan mengekalkan konteks merentasi perbualan yang lebih panjang.

Kesimpulan: Mengapa GLM-5.1 Penting pada 2026

GLM-5.1 bukan sekadar satu lagi keluaran tambahan—ia menandakan ketibaan AI agen sumber terbuka yang benar-benar berkeupayaan. Dengan cemerlang dalam penanda aras kejuruteraan dunia nyata yang paling sukar sambil kekal mampu milik dan terbuka, Z.ai telah menaikkan penanda aras untuk seluruh industri. Sama ada anda pembangun solo, pasukan perusahaan, atau penyelidik, GLM-5.1 menawarkan autonomi tiada tandingan untuk tugas pengkodan jangka panjang pada sebahagian kecil kos proprietari.

Sedia mencubanya? Semak model GLM-5.1 di CometAPI, repositori di Hugging Face, atau GLM Coding Plan untuk akses segera.

.webp&w=3840&q=75)