MiniMax-M2.5 is een nieuw, op productiviteit gericht groot taalmodel van MiniMax dat is geoptimaliseerd voor programmeren, agentgedreven toolgebruik en kantoorworkflows. Je kunt het aanroepen via het eigen MiniMax‑platform of via API‑aggregators zoals CometAPI. Je hoeft alleen de CometAPI‑API‑sleutel te verkrijgen om de API te gebruiken, aangezien Minimax-M2.5 ook het chatformaat ondersteunt.

Wat is MiniMax‑M2.5?

MiniMax‑M2.5 is de nieuwste grote modelrelease van MiniMax: een evolutie van de M2‑familie die het bedrijf positioneert als een model voor algemeen gebruik, geschikt voor agents, met bijzonder sterke prestaties in codegeneratie, toolgebruik en meerstapsredeneren. De M2.5‑familie werd aangekondigd als een release in februari 2026 en omvat zowel de standaard M2.5‑variant als “highspeed”-varianten die zijn geoptimaliseerd voor lagere latentie met behoud van dezelfde kerncapaciteiten. De M2.5‑familie verbeterde de benchmarkscores in evaluaties van software‑engineering en vertoont beter gedrag bij interactie met externe tools (search, agents, enz.).

De leverancier positioneert M2.5 als een stap vooruit ten opzichte van eerdere M2.x‑releases, met sterker redeneren, betere codegeneratie en verbeterde betrouwbaarheid van toolaanroepen. De openbare releasenotes van MiniMax begin februari 2026 bestempelden M2.5 als een mijlpaal: verfijnde instructietuning, sterker codebegrip en meetbare winst op verschillende codegerichte benchmarks. De release omvat:

- Een standaard M2.5‑model (met nadruk op nauwkeurigheid en redeneren).

- Een M2.5‑highspeed‑variant met lagere latentie voor interactieve ontwikkelaarsworkflows.

- Expliciete richtlijnen en factureringsopties voor een “Coding Plan” gericht op intensief gebruik van codegeneratie.

Belangrijkste technische hoogtepunten

- Architectuur: MoE (grote totale aantal parameters met een veel kleinere actieve set tijdens inferentie), wat een gunstige kosten/prestatie‑sweetspot biedt voor zware taken.

- Sterke punten: toonaangevende codeprestaties, meerbeurtenredeneren, lang‑contextbeheer en integraties met agents/tools.

- Variants: MiniMax publiceert varianten (bijv.

MiniMax-M2.5enM2.5-highspeed) die zijn afgestemd op doorvoer versus latentie.

Waarom dit vandaag relevant is: veel teams die ontwikkelaarstools, programmeerassistenten en agentgedreven automatiseringen bouwen, waarderen een model dat over meerdere beurten kan redeneren, veilig tools kan aanroepen en code van hoge kwaliteit kan genereren. M2.5 — vanwege de architectuur‑ en trainingskeuzes — wordt expliciet in de markt gezet voor die scenario’s.

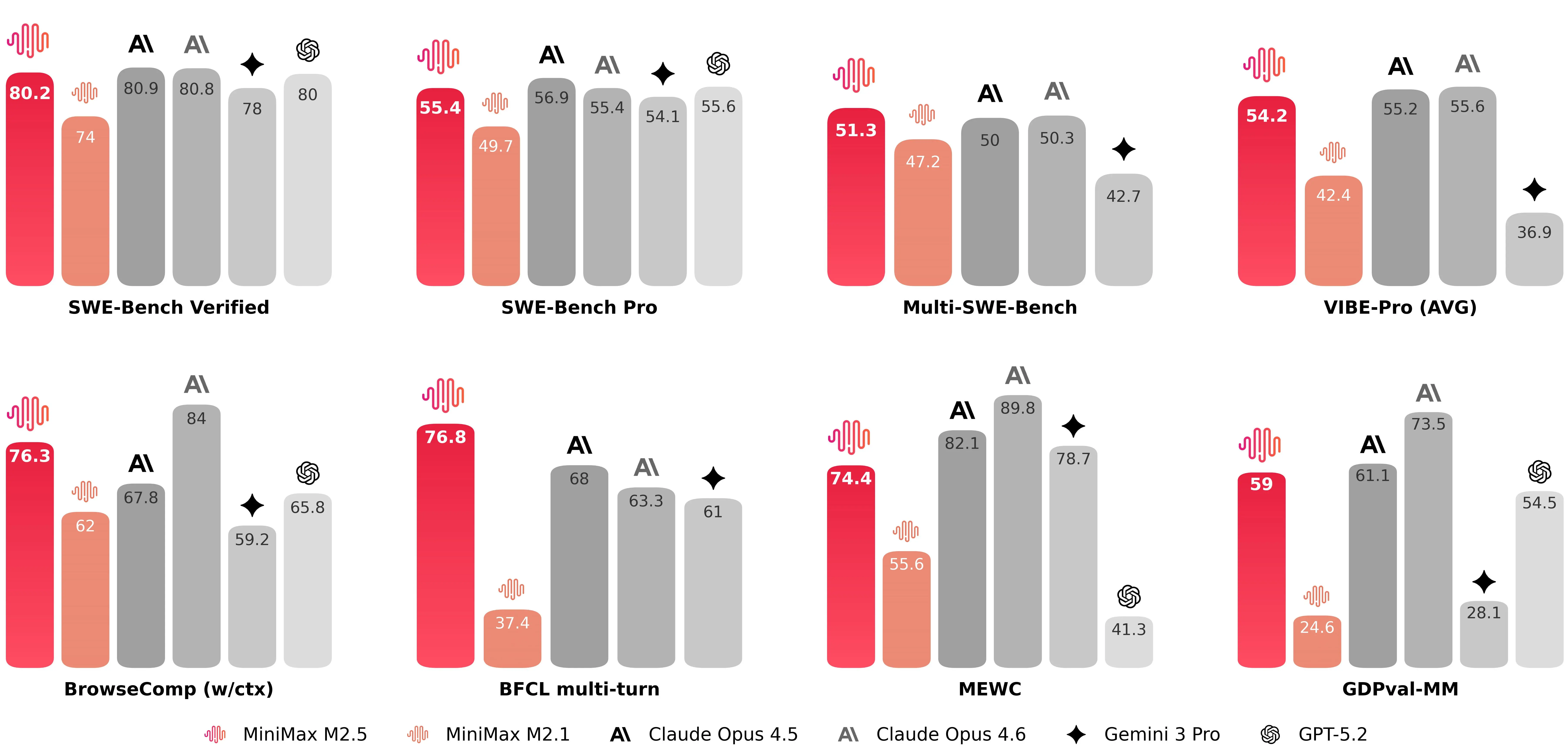

Benchmarking van MiniMax‑M2.5

Waar M2.5 uitkomt op code‑specifieke benchmarks

MiniMax‑M2.5 scoort 80.2% op SWE‑Bench Verified, samen met sterke resultaten op multitask‑coding en browsing‑augmented benchmarks (noemenswaardige cijfers van het bedrijf zijn onder meer 51.3% op Multi‑SWE‑Bench en 76.3% op BrowseComp wanneer contextbeheer is ingeschakeld). Deze cijfers positioneren M2.5 bij de best presterende openbaar beschikbare modellen voor codegeneratie en probleemoplossing bij lancering. De lancering van MiniMax‑M2.5 onderstreept dat M2.5 meedoet met de topklasse van codemodellen.

Voor ontwikkelaars is het voordeel tweeledig:

- Hoger succespercentage bij de eerste poging: minder rondes met fixes, minder handmatige debugging en lagere ‘babysitten’-overhead voor autonome codeeragents.

- Betere full‑stackdekking: M2.5 wordt beschreven als ondersteuning biedend voor full‑stack workflows over desktop‑apps, mobiel en cross‑platform toolchains, wat betekent dat het niet alleen snippets wil genereren maar samenhangende oplossingen met meerdere bestanden en buildscripts.

Gebouwd voor agentgedreven workflows

M2.5 wordt beschreven als “van nature ontworpen voor agent‑scenario’s.” In de praktijk betekent dit dat de architectuur en het trainingsregime prioriteit geven aan:

- Getrouwheid van toolaanroepen: API‑calls uitvoeren of shell/SQL‑commando’s draaien met correcte syntax en parameters.

- Contextwisseling en geheugen: een onderbroken meerstapsbewerking vervolgen zonder eerder berekende status te verliezen.

- Bestandsmanipulatie: gangbare kantoorformaten programmatisch produceren en bewerken (bijvoorbeeld een PowerPoint genereren en deze vervolgens herzien op basis van een vervolgverzoek).

Zoek- en browse‑augmentatie

Wanneer M2.5 wordt gekoppeld aan browse‑ of retrieval‑lagen, rapporteert MiniMax aanzienlijk verbeterde scores op browsebenchmarks, wat wijst op sterker presterende integratie van externe informatie en verwijzingen in de output. Dat maakt M2.5 geschikt voor tools die actuele inhoud moeten ophalen, API‑resultaten moeten verifiëren of codegeneratie moeten verrijken met real‑world data (bijvoorbeeld de nieuwste SDK‑documentatie ophalen en die correct gebruiken tijdens codegeneratie). Deze capaciteiten zijn belangrijk voor teams die agentgedreven features bouwen, zoals geautomatiseerde QA, CI‑toolchains of documentgestuurde assistenten.

Hoe gebruik ik de MiniMax‑2.5‑API (via CometAPI)?

CometAPI is een API‑aggregatieplatform dat honderden modellen ontsluit via één, OpenAI‑compatibele REST‑interface. Omdat de interface van CometAPI de OpenAI chat/completions‑endpoints weerspiegelt, kun je vaak bestaande OpenAI‑achtige clients hergebruiken door api_base en de API‑sleutel te wisselen. Als je liever niet rechtstreeks integreert met het platform van MiniMax (bijvoorbeeld vanwege uniforme facturatie, multi‑model A/B‑testen of leverancier‑abstractie), kun je MiniMax‑M2.5 aanroepen via CometAPI’s “chat”‑interface. Het CometAPI‑platform biedt een consistent aanvraagformaat, een SDK en een web‑playground — en het publiceert per‑model namen en parameters (zodat je de exacte provider/model‑string kunt selecteren bij het aanroepen).

Hieronder staat een beknopte, praktische gids voor het aanroepen van MiniMax‑M2.5 via CometAPI, met voorbeelden in curl en Python.

Wat zijn de basisstappen om te beginnen?

- Meld je aan voor een CometAPI‑account en verkrijg een API‑sleutel. (CometAPI biedt een playground en SDK’s om modellen te testen.)

- Controleer de modellijst van CometAPI of de CometAPI‑playground om de exacte modelnaam voor MiniMax‑M2.5 te vinden.

- Doe een geauthenticeerd POST‑verzoek met de parameter

modelingesteld op het geselecteerde MiniMax‑model en een payload die het chat/completion‑schema van CometAPI volgt. - Stem parameters af (temperature, max_tokens, system‑berichten, streaming) op je workflow.

Authenticatie & endpoint‑basis

- Basis‑URL:

https://api.cometapi.com/v1(OpenAI‑stijl paden zoals/chat/completionsworden ondersteund). - Header:

Authorization: Bearer YOUR_COMETAPI_KEY - Content‑Type:

application/json - Veld model: gebruik de exacte modelstring uit de modelcatalogus van CometAPI (voorbeelden:

"minimax-m2.5")

Voorbeeld 1 — Snelle curl (REST, OpenAI‑stijl)

# Vervang $COMETAPI_KEY door je CometAPI-sleutel

curl -s -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer $COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "minimax-m2.5",

"messages": [

{"role":"system","content":"Je bent een beknopte, veiligheidsbewuste codeerassistent."},

{"role":"user","content":"Herschrijf deze synchrone Python-functie naar async en voeg basale foutafhandeling toe:\n\n```\ndef fetch(user_id):\n resp = http_get(f\"https://api.example.com/users/{user_id}\")\n return resp.json()\n```"}

],

"max_tokens": 800,

"temperature": 0.0,

"stream": false

}'

Notities:

- Gebruik de modelstring exact zoals in de CometAPI‑catalogus.

stream: truewordt ondersteund voor streaming‑uitvoer (verwerk server‑sent events of gechunkte responses als je gedeeltelijke tokens wilt).

Voorbeeld 2 — Python (requests) voor een chatcompletion

import os, requests

COMET_KEY = os.environ.get("COMETAPI_KEY") # aanbevolen

URL = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "minimax-m2.5", # of "minimax/minimax-m2.5" — verifieer Comets modelpagina

"messages": [

{"role": "system", "content": "Je bent een behulpzame engineer die duidelijke, geteste code teruggeeft."},

{"role": "user", "content": "Schrijf een pytest voor de volgende functie die randgevallen controleert..."}

],

"temperature": 0.1,

"max_tokens": 1000,

}

r = requests.post(URL, json=payload, headers=headers, timeout=120)

r.raise_for_status()

out = r.json()

print(out["choices"][0]["message"]["content"])

Voorbeeld 3 — litellm / CometAPI‑integratie gebruiken (Python‑gemakkenlaag)

CometAPI wordt ondersteund door verschillende community‑SDK’s en adapters. De liteLLM‑documentatie toont een compacte flow waarbij je COMETAPI_KEY instelt en het model bij naam aanroept. Dit is ideaal voor prototyping:

import os

from litellm import completion

os.environ["COMETAPI_KEY"] = "your_cometapi_key_here"

messages = [{"role":"user", "content":"Leg async/await in Python uit in 3 bullets."}]

resp = completion(model="minimax-m2.5", messages=messages)

print(resp.choices[0].message.content)

Litellm/Comet‑integraties bieden handige utilities (streaming, async, expliciete api_key‑parameter) die veel bestaande OpenAI‑SDK‑patronen weerspiegelen.

Hoe ontwerp je prompts en system‑berichten voor M2.5

Wees expliciet over rol en beperkingen

Geef M2.5 een duidelijke systeemrol wanneer je om code vraagt. Voorbeeld:

{"role": "system","content": "Je bent MiniMax M2.5, een assistent die is gespecialiseerd in robuuste, leesbare en goed gedocumenteerde code. Gebruik Python 3.11-conventies, neem type hints op en geef korte unittests."}

Gebruik stapdecompositie voor complexe problemen

Wanneer je M2.5 vraagt complexe features te implementeren, gebruik dan een korte decompositie:

- Vraag om een ontwerpoverzicht.

- Vraag om interface‑signatures.

- Vraag om implementatie en tests.

Dit verkleint het risico op hallucinaties en levert modulaire, reviewbare outputs op.

Temperature, max_tokens en veiligheid

- Voor deterministische code: zet

temperaturedicht bij 0.0. - Voor exploratief ontwerp:

temperaturetussen 0.2–0.5 kan creatieve benaderingen opleveren. - Houd

max_tokensruim voor grote refactors of lange test suites.

Vraag om unittests en redenering

Wanneer je om code vraagt, vraag ook om unittests en een korte uitleg van het algoritme. Dat helpt subtiele bugs te detecteren en direct uitvoerbare artefacten te krijgen.

Long‑Task Inference en State Tracking

Het M2.5‑model heeft een uitstekend staatstrackingsmechanisme, dat de continuïteit en richting van het denkproces over lange tijdsreeksen effectief waarborgt door zich telkens op een beperkt aantal doelen te concentreren in plaats van alles parallel te verwerken. M2.5 is uitgerust met context‑bewuste functionaliteit, waardoor taken efficiënt worden uitgevoerd en contextbeheer wordt geoptimaliseerd.

Praktische M2.5‑gebruiktips voor productie

MiniMax‑M2.5 is afgestemd op meerstaps tooling en code. Hieronder staan praktische, ervaringsgestuurde tips om in productie de beste resultaten te behalen.

Prompt engineering & system‑berichten

- Gebruik expliciete systeemberichten voor rol en beperkingen. Voor code‑taken: vermeld de vereiste runtime/testframeworks (bijv. “Geef een pytest die compatibel is met Python 3.11”).

- Lever context: geef voor agentgedreven of meerstapsjobs stapmetadata en toolbeschrijvingen als gestructureerde JSON of bulletlijsten. M2.5 reageert goed op gestructureerde input omdat het is geoptimaliseerd voor toolgebruik.

Functie-/toolaanroepen

- Als je CometAPI gebruikt als gateway voor tool‑calling, zorg dan dat je extra velden (bijv.

function_callin OpenAI‑stijl) overeenkomen met de verwachtingen van CometAPI/model. Bevestig modelsupport op de Comet‑modelpagina, omdat toolsemantiek per provider kan verschillen. - Voor robuuste orkestratie: splits grote taken op in kleinere calls en onderhoud deterministische checkpoints. M2.5 is sterk in het volgen van meerstapsinstructies, maar je krijgt het meest betrouwbare gedrag door na elke stap te valideren.

Temperature, max_tokens en kostenbeheersing

- Voor codegeneratie of refactoring: zet

temperaturelaag (0.0–0.2) en stemmax_tokensaf op de verwachte outputgrootte. - Voor exploratieve prompts: verhoog

temperature, maar let op het toegenomen tokengebruik. Wanneer je via CometAPI routeert, vergelijk providerprijzen en fallbackregels — CometAPI vermeldt tokenprijzen per modelinstantie in de catalogus.

Contextvenster & lange documenten

- M2.5‑varianten ondersteunen vaak lange contexten (controleer de modelspecificatie voor de contextlengte). Chunk en vat samen voor zeer lange documenten — voer vervolgens de samenvattingen plus relevante chunks in, in plaats van volledige bestanden in één keer te versturen.

Veiligheid, toxische content en mitigatie van hallucinaties

- Gebruik vangrails: systeemberichten, externe validators en test suites (bijv. unittests voor gegenereerde code) verlagen risico’s.

- Valideer externe referenties: als het model feiten of code van het web citeert, verifieer dit programmatisch voordat je die resultaten vertrouwt of shipt.

Wat zijn veelvoorkomende valkuilen en hoe vermijd je ze

Valkuil: Te veel vertrouwen op één modeloutput

Mitigatie: Draai tests, statische checks en vraag voor kritieke logica meerdere onafhankelijke completions op en vergelijk. CometAPI maakt schakelen tussen meerdere modellen mogelijk, en je kunt op elk moment wisselen met het chatformaat van OpenAI.

Valkuil: Hoge temperature gebruiken voor productiekode

Mitigatie: Houd temperature laag; als je creatieve alternatieven nodig hebt, vraag meerdere varianten met lage temperature of vraag het model de verschillen uit te leggen.

Valkuil: Modelversionering negeren

Mitigatie: Houd modelnamen en providerstrings bij in je deploymentmanifesten. Wanneer je overschakelt van MiniMax-M2.5 naar MiniMax-M2.5-highspeed of naar een andere provider, behandel dit als een releasewijziging en voer regressietests uit.

Laatste aanbevelingen en realistische verwachtingen

MiniMax‑M2.5 is een opmerkelijke stap vooruit voor code‑centrische, agentgedreven LLM’s — het belooft sterke codegeneratie, meerbeurtenredeneren en tool‑veilig gedrag. Als de prioriteiten van je team liggen bij het bouwen van robuuste ontwikkelaarstools, agentframeworks of codeassistenten, verdient M2.5 een plek in je vergelijkingsmatrix. Het gebruik van CometAPI als uniforme gateway kan experimenten versnellen en je in staat stellen providers te wisselen of modellen te A/B‑testen zonder je gehele integratie te herwerken.

Enkele pragmatische conclusies:

- Prototyping snel in de playground van CometAPI, leg vervolgens modelidentifiers vast in code.

- Gebruik een lage temperature, vraag om tests en uitleg, en voer altijd geautomatiseerde validatie uit.

- Behandel het model als een krachtige mede‑ontwikkelaar — niet als een onfeilbare: pas human review, CI‑pipelines en telemetrie toe.

Ontwikkelaars hebben toegang tot MInimax‑M2.5 via CometAPI. Begin met het verkennen van de mogelijkheden van het model in de Playground en raadpleeg de API‑gids voor gedetailleerde instructies. Zorg ervoor dat je bent ingelogd bij CometAPI en een API‑sleutel hebt verkregen voordat je toegang krijgt. CometAPI biedt een prijs die veel lager is dan de officiële prijs om je te helpen integreren.

Klaar om te starten? → Meld je vandaag nog aan voor M2.5!

Wil je meer tips, gidsen en nieuws over AI? Volg ons op VK, X en Discord!