Het model "Kimi K2 Thinking" is een nieuwe variant van de redeneeragent, ontwikkeld door Moonshot AI (Beijing). Het behoort tot de bredere "Kimi K2"-familie van groottalige modellen, maar is specifiek afgestemd op het denken—dat wil zeggen, redeneren over een lange horizon, gereedschapsgebruik, planning en meerstapsinferentie. Versies zijn kimi-k2-denken-turbo,kimi-k2-denken.

Basis kenmerken

- Grootschalige parameterisatie: Kimi K2 Thinking is gebouwd op de K2-serie, die gebruikmaakt van een mix van experts (MoE)-architectuur met ongeveer 1 biljoen (1 T) totale parameters en over 32 miljard (32 B) geactiveerde parameters op het moment van de gevolgtrekking.

- Contextlengte en toolgebruik:Het model ondersteunt zeer lange contextvensters (rapporten geven tot 256 tokens aan) en is ontworpen om opeenvolgende toolaanroepen (tot 200-300) uit te voeren zonder menselijke tussenkomst.

- Agentisch gedrag:Het is speciaal ontwikkeld om te fungeren als een 'agent' in plaats van een conversationele LLM. Dit betekent dat het programma kan plannen, externe tools kan aanroepen (zoeken, code uitvoeren, web ophalen), redeneertrajecten kan bijhouden en complexe workflows kan orkestreren.

- Open gewicht & licentie:Het model wordt uitgebracht onder een gewijzigde MIT-licentie, die commercieel/afgeleid gebruik toestaat, maar een toeschrijvingsclausule bevat voor grootschalige implementaties.

Technische gegevens

architectuur:

- Ruggengraat van het MoE (Mixture-of-Experts).

- Totale parameters: ≈ 1 biljoen. Actieve parameters per gevolgtrekking: ≈ 32 miljard.

- Aantal experts: ~384, geselecteerd per token: ~8.

- Woordenschat en context: Woordenschatgrootte ongeveer 160K, contextvensters tot de laatste 256K tokens.

Training / optimalisatie:

- Vooraf getraind op ~15.5 biljoen tokens.

- Gebruikte optimalisatie: "Muon" of variant (MuonClip) om trainingsinstabiliteit op grote schaal aan te pakken.

- Na de training/fijnafstemming: Meerdere fasen, waaronder agentische datasynthese, reinforcement learning, training in het aanroepen van tools.

Inferentie en gebruik van hulpmiddelen:

- Ondersteunt honderden opeenvolgende toolaanroepen, waardoor workflows voor ketenredeneringen mogelijk worden.

- Claims van native INT4 gekwantiseerde inferentie om het geheugengebruik en de latentie te verminderen zonder grote nauwkeurigheidsdalingen, testtijdschaling en uitgebreide contextvensters.

Benchmarkprestaties

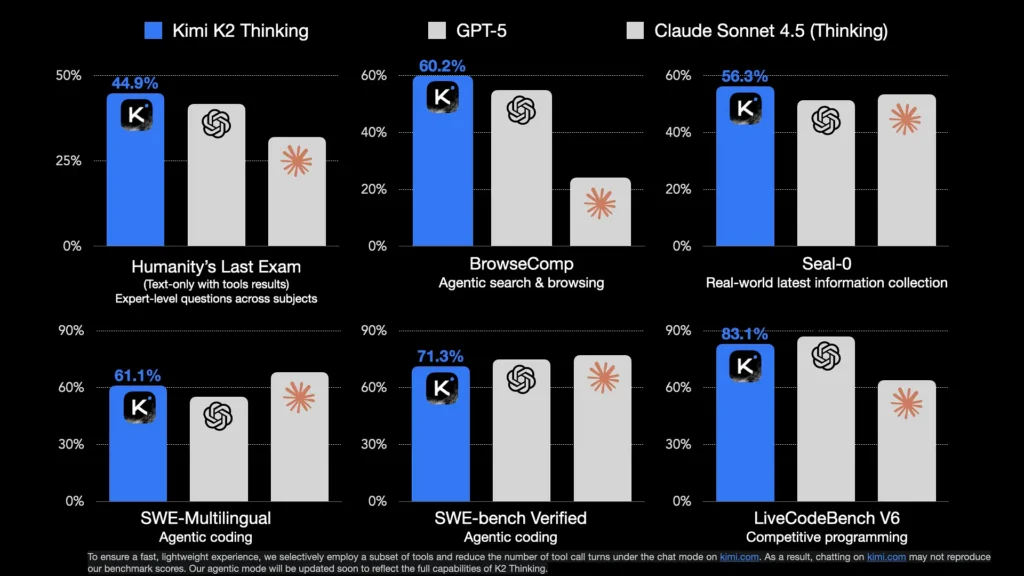

benchmarks: De gepubliceerde cijfers van Moonshot laten sterke resultaten zien op het gebied van agentische en redeneersuites: bijvoorbeeld 44.9% op het laatste examen van de mensheid (HLE) met gereedschap, 60.2% op BrowseComp, en hoge cijfers voor domeinsuites zoals SWE-Bench / SWE-Bench Geverifieerd en DOEL25 (wiskunde).

Beperkingen en risico's

- Berekenen en implementeren: ondanks 32B activeringsequivalentie, operationele kosten en engineering om Thinking op betrouwbare wijze te hosten (lange contexten, toolorkestratie, kwantificeringspijplijnen) blijven niet triviaal. Hardware vereisten (GPU-geheugen, geoptimaliseerde runtimes) en inferentietechniek vormen echte beperkingen.

- Gedragsrisico's: Net als andere LLM's kan Kimi K2 Thinking hallucinerende feiten, weerspiegelen dataset biases, of onveilige content produceren zonder passende beveiliging. De agentische autonomie (geautomatiseerde toolaanroepen in meerdere stappen) vergroot het belang van veiligheid door ontwerp: strikte toestemmingsregels voor gereedschappen, runtime-controles en beleid waarbij mensen bij de uitvoering betrokken zijn, worden aanbevolen.

- Vergelijkende rand versus gesloten modellenHoewel het model veel benchmarks evenaart of overtreft, kunnen gesloten modellen in sommige domeinen of 'zware modus'-configuraties nog steeds voordelen behouden.

Vergelijking met andere modellen

- Vergeleken met GPT-5 en Claude Sonnet 4.5: Kimi K2 Thinking claimt superieure scores op een aantal belangrijke benchmarks (bijv. agentisch zoeken, redeneren) ondanks het feit dat het een open-gewicht model is.

- Vergeleken met eerdere open-sourcemodellen: het overtreft eerdere open modellen zoals MiniMax‑M2 en andere op het gebied van agentische redeneringsmetriek en de mogelijkheid om tools aan te roepen.

- Architectonisch onderscheid: Sparse MoE met een hoog aantal actieve parameters versus veel dichte modellen of kleinschaligere systemen; focus op redeneren over de lange termijn, gedachteketen en orkestratie met meerdere tools in plaats van pure tekstgeneratie.

- Kosten- en licentievoordeel: een open, permissievere licentie (met toekenningsclausule) biedt potentiële kostenbesparingen ten opzichte van gesloten API's, maar de infrastructuurkosten blijven hetzelfde.

Gebruikers verhalen

Kimi K2 Thinking is met name geschikt voor scenario's waarbij het volgende vereist is:

- Workflows voor redeneren op lange termijn: bijvoorbeeld planning, probleemoplossing in meerdere stappen, projectopsplitsing.

- Orkestratie van agentische tools: web zoeken + code uitvoeren + gegevens ophalen + samenvattingen schrijven in één workflow.

- Coderen, wiskunde en technische taken:Gezien de benchmarksterkte in LiveCodeBench, SWE-Bench, enz., is dit een goede kandidaat voor ontwikkelaarsassistent, codegeneratie en geautomatiseerde gegevensanalyse.

- Workflows voor bedrijfsautomatisering:Waar meerdere hulpmiddelen aan elkaar gekoppeld moeten worden (bijvoorbeeld gegevens ophalen → analyseren → rapport schrijven → waarschuwen) met minimale menselijke tussenkomst.

- Onderzoeks- en open-sourceprojecten:Gezien het open gewicht is academische of onderzoeksinzet haalbaar voor experimenten en verfijning.

Hoe Kimi K2 Thinking API aan te roepen vanuit CometAPI

Kimi K2 Thinking API-prijzen in CometAPI, 20% korting op de officiële prijs:

| Model | Invoertokens | Uitvoertokens |

|---|---|---|

| kimi-k2-denken-turbo | $2.20 | $15.95 |

| kimi-k2-denken | $1.10 | $4.40 |

Vereiste stappen

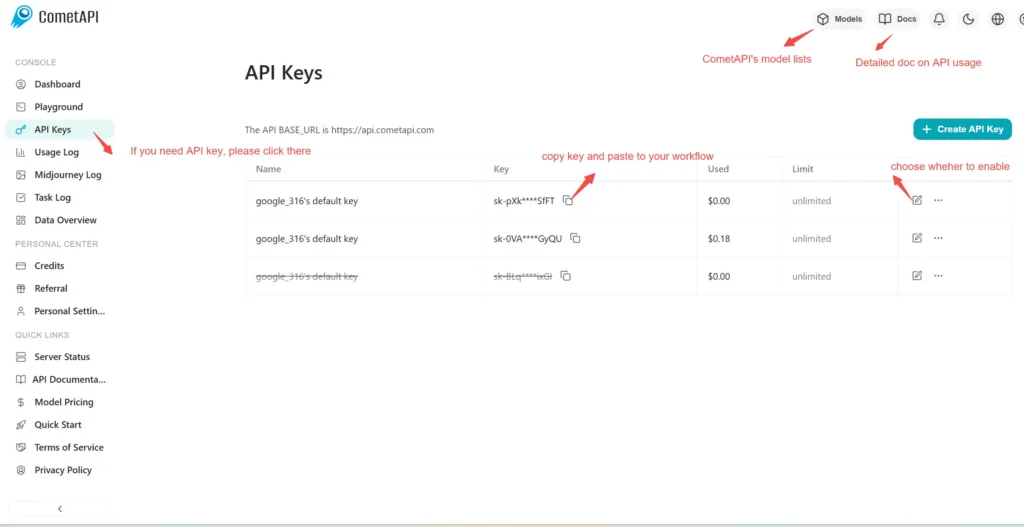

- Inloggen cometapi.comAls u nog geen gebruiker bent, registreer u dan eerst.

- Log in op uw CometAPI-console.

- Haal de API-sleutel voor de toegangsgegevens van de interface op. Klik op 'Token toevoegen' bij de API-token in het persoonlijke centrum, haal de tokensleutel op: sk-xxxxx en verstuur.

Gebruik methode

- Selecteer het eindpunt "kimi-k2-thinking-turbo,kimi-k2-thinking" om de API-aanvraag te versturen en de aanvraagbody in te stellen. De aanvraagmethode en de aanvraagbody zijn te vinden in de API-documentatie op onze website. Onze website biedt ook een Apifox-test voor uw gemak.

- Vervangen met uw werkelijke CometAPI-sleutel van uw account.

- Vul het inhoudsveld in en het model zal hierop reageren.

- Verwerk het API-antwoord om het gegenereerde antwoord te verkrijgen.

CometAPI biedt een volledig compatibele REST API voor een naadloze migratie. Belangrijke details voor API-document:

- Basis-URL: https://api.cometapi.com/v1/chat/completions

- Modelnamen: kimi-k2-thinking-turbo,kimi-k2-thinking

- authenticatie:

Bearer YOUR_CometAPI_API_KEYhoofd - Content-Type:

application/json.