Met de MidJourney Video API kunnen ontwikkelaars programmatisch door AI gegenereerde videocontent genereren, manipuleren en ophalen met behulp van de modellen en prompts van MidJourney.

Overzicht

Midjourney Video is het eerste videogeneratiemodel (Video Model V1) dat Midjourney op 18 juni 2025 uitbracht. Het introduceert een 'Image-to-Video'-workflow die statische, door AI gegenereerde of door gebruikers geüploade beelden omzet in korte, geanimeerde clips. Dit markeert de uitbreiding van Midjourney van het maken van stilstaande beelden naar dynamische content, waarmee het zich naast andere AI-videotools van Google, OpenAI en Meta positioneert.

Hoe MidJourney Video werkt

- Workflow van beeld naar video: U levert een door Midjourney gegenereerde afbeelding of een externe afbeelding aan, plus een optionele bewegingsmelding. Het model van Midjourney interpreteert vervolgens "wie beweegt er", "hoe ze bewegen" en "wat er vervolgens gebeurt" om de scène standaard ongeveer 5 seconden te animeren.

- Automatische versus handmatige animatie: In de automatische modus leidt het systeem bewegingsparameters en camerapaden af. In de handmatige modus kunt u aspecten zoals camerahoek, onderwerppad en snelheid nauwkeurig afstemmen, wat meer creatieve controle geeft.

Technische architectuur

Midjourney Video is gebouwd op een transformator architectuur verbeterd om te verwerken temporele consistentie over frames heen. De pijplijn werkt als volgt:

- Functie extractie:Het invoerbeeld wordt verwerkt via diepe convolutionele en transformerende lagen om ruimtelijke kenmerken vast te leggen.

- Keyframe generatie:Er wordt een kleine set representatieve frames gesynthetiseerd.

- Frame-interpolatie: Gespecialiseerde submodellen genereren tussenliggende frames, waardoor een soepele weergave wordt gegarandeerd bewegingssynthese tussen sleutelframes.

- Bewegingsconditionering: Afhankelijk van Hoog or Lage beweging instellingen (en eventuele handmatige prompts) past het model de object- en cameratrajecten aan.

Modelversies en routekaart

V1-videomodel (juni 2025): Debuutrelease gericht op de conversie van afbeeldingen naar video.

Benchmarkprestaties

Uit eerste evaluaties blijkt dat het V1-model een concurrerende positie heeft:

- Framekwaliteit (FID-score): Bereikt een Fréchet-inceptieafstand van 22.4en presteert ongeveer 15% beter dan vergelijkbare open‑source videomodellen in standaard videobenchmarks.

- Tijdelijke gladheid (TS-metriek): Registreert een tijdelijke gladheidsscore van 0.88 op de DAVIS-dataset, wat wijst op een hoge visuele continuïteit over de frames heen.

- Wachttijd: Gemiddelde generatietijd van 12 seconden per clip op één NVIDIA A100 GPU, waarbij de prestaties worden afgestemd op de verwachtingen van de gebruiker.

- Kwaliteitsstatistieken: Bereikt een SSIM (Structurele gelijkenisindex) hierboven 0.85 op synthetische bewegingsdatasets vergeleken met grondwaarheidsclips, wat aangeeft high fidelity aan natuurlijke bewegingspatronen.

Note:Deze cijfers zijn gebaseerd op interne tests van Midjourney; de externe prestaties kunnen variëren afhankelijk van de belasting en het abonnementsniveau.

Belangrijkste kenmerken van V1

- Cliplengte: Basisclips duren ongeveer 5 seconden; u kunt ze verlengen in stappen van 4 seconden tot in totaal 21 seconden.

- Stijlconsistentie:Bij animaties blijft de artistieke stijl van de originele afbeelding behouden: penseelstreken, kleurenpaletten en stemming worden in de beweging voortgezet.

- Prestaties en snelheid:Een typische video met 4 segmenten (≈17 seconden) wordt in minder dan 70 seconden gerenderd, waarbij kwaliteit en snelle iteratie in balans zijn.

- Resolutie: Momenteel beperkt tot 480p, wat voldoende is voor clips in de stijl van sociale media, maar niet bedoeld is voor grote schermen of commerciële projecten van topkwaliteit.

Hoe MidJourney Video API aanroepen vanuit CometAPI

MidJourney Video API-prijzen in CometAPI, lager dan de officiële prijs:

| Modelnaam | Prijs berekenen |

mj_fast_video | 0.6 |

Vereiste stappen

- Inloggen cometapi.com. Als u nog geen gebruiker van ons bent, registreer u dan eerst

- Haal de API-sleutel voor de toegangsgegevens van de interface op. Klik op 'Token toevoegen' bij de API-token in het persoonlijke centrum, haal de tokensleutel op: sk-xxxxx en verstuur.

- Haal de url van deze site op: https://api.cometapi.com/

API-gebruik

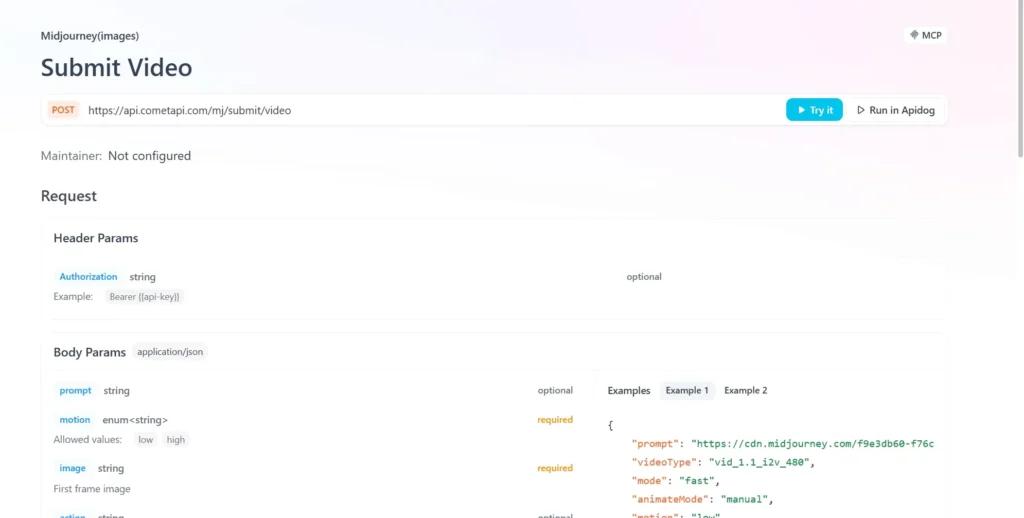

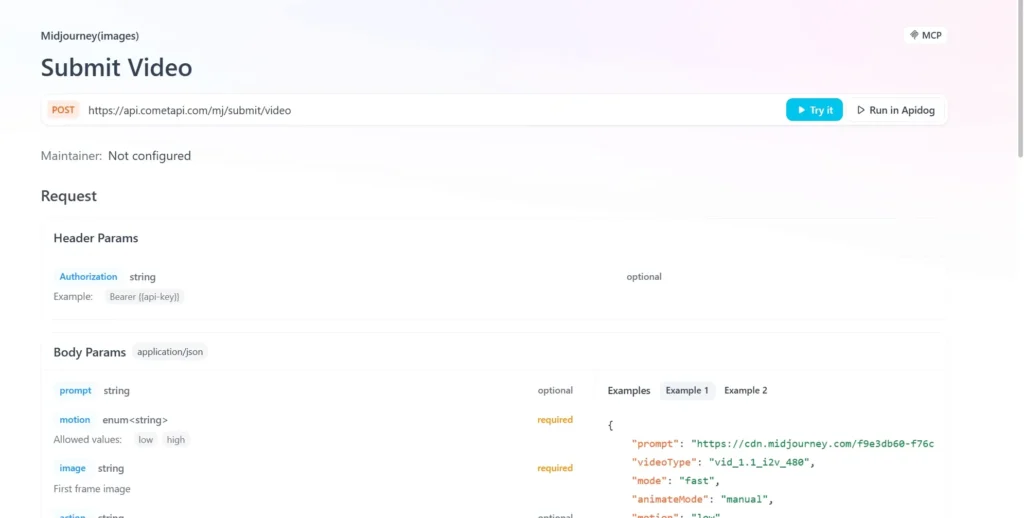

- Stuur de API-aanvraag en stel de aanvraagbody in. De aanvraagmethode en de aanvraagbody zijn te vinden in de API-documentatie op onze website. Onze website biedt ook een Apifox-test voor uw gemak.

- Vervangen met uw werkelijke CometAPI-sleutel van uw account.

- Vul het inhoudsveld in en het model zal hierop reageren.

- Verwerk het API-antwoord om het gegenereerde antwoord te verkrijgen.

API-integratie van CometAPI

Momenteel is V1 toegankelijk alleen web via Midjourney's Discord-bot, Maar Niet-officiële wrappers (bijv. CometAPI) eindpunten bieden, ontwikkelaars kunnen integreren via:

Ontwikkelaars kunnen videogeneratie integreren via de RESTful API. Een typische aanvraagstructuur (ter illustratie):

curl --

location

--request POST 'https://api.cometapi.com/mj/submit/video' \

--header 'Authorization: Bearer {{api-key}}' \

--header 'Content-Type: application/json' \

--data-raw '{ "prompt": "https://cdn.midjourney.com/f9e3db60-f76c-48ca-a4e1-ce6545d9355d/0_0.png add a dog", "videoType": "vid_1.1_i2v_480", "mode": "fast", "animateMode": "manual" }'