Wat is de GPT-5.2 API

De GPT-5.2 API is hetzelfde als GPT-5.2 Thinking in ChatGPT. GPT-5.2 Thinking is de mid-tier variant binnen OpenAI’s GPT-5.2-familie, ontworpen voor diepgaand werk: redeneren in meerdere stappen, samenvattingen van lange documenten, kwalitatieve codegeneratie en professioneel kenniswerk waarbij nauwkeurigheid en bruikbare structuur zwaarder wegen dan pure doorvoer. In de API wordt deze aangeboden als het model gpt-5.2 (Responses API / Chat Completions), en het bevindt zich tussen de low-latency Instant-variant en de variant Pro met hogere kwaliteit maar hogere kosten.

Belangrijkste kenmerken

- Zeer lange context en compactie: 400K effectief venster en compactietools om relevantie te beheren in lange gesprekken en documenten.

- Configureerbare redeneerinspanning:

none | medium | high | xhigh(xhigh maakt maximale interne rekenkracht mogelijk voor moeilijke redenering).xhighis beschikbaar voor de Thinking/Pro-varianten. - Sterkere ondersteuning voor tools en functies: eersteklas tool-aanroepen, grammatica's (CFG/Lark) om gestructureerde output te begrenzen, en verbeterd agentgedrag dat complexe meerstapsautomatisering vereenvoudigt.

- Multimodale begrip: rijker begrip van beeld en tekst en integratie in meerstapstaken.

- Verbeterde veiligheid / omgang met gevoelige inhoud: gerichte interventies om ongewenste reacties te verminderen in gebieden zoals zelfbeschadiging en andere gevoelige contexten.

Technische mogelijkheden & specificaties (ontwikkelaarsweergave)

- API-endpoints & model-ID's:

gpt-5.2voor Thinking (Responses API),gpt-5.2-chat-latestvoor chat-/instant-workflows, engpt-5.2-provoor de Pro-laag; beschikbaar via Responses API en Chat Completions waar aangegeven. - Redeneertokens & inspanningsbeheer: de API ondersteunt expliciete parameters om rekenkracht (redeneerinspanning) per aanvraag toe te wijzen; hogere inspanning verhoogt latentie en kosten maar verbetert de outputkwaliteit voor complexe taken.

- Tools voor gestructureerde output: ondersteuning voor grammatica's (Lark / CFG) om modeloutput te beperken tot een DSL of exacte syntaxis (nuttig voor SQL, JSON, DSL-generatie).

- Parallelle tool-aanroepen & agentcoördinatie: verbeterde paralleliteit en schonere tool-orkestratie verminderen de noodzaak van uitgebreide systeemprompts en multi-agent-scaffolding.

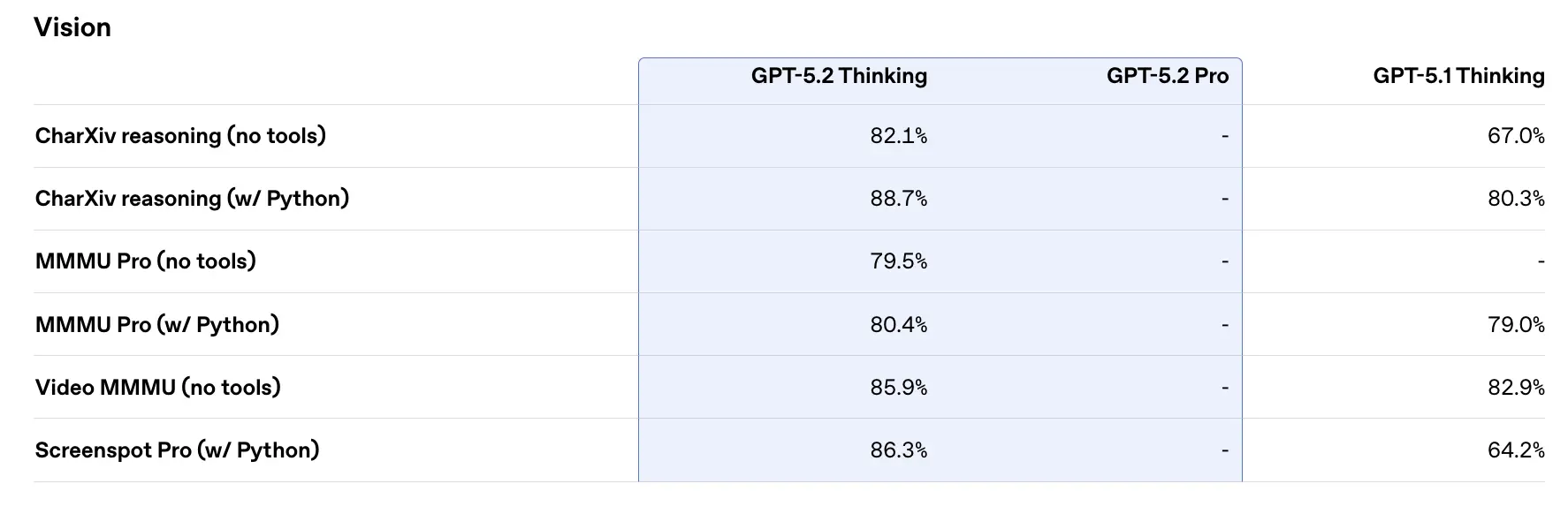

Benchmarkprestaties & ondersteunende gegevens

OpenAI publiceerde een verscheidenheid aan interne en externe benchmarkresultaten voor GPT-5.2. Geselecteerde highlights (door OpenAI gerapporteerde cijfers):

- GDPval (44 beroepen, kenniswerk) — GPT-5.2 Thinking “overtreft of evenaart topindustrieprofessionals in 70.9% van de vergelijkingen”; volgens OpenAI werden outputs geproduceerd met >11× de snelheid en <1% van de kosten van expertprofessionals op hun GDPval-taken (schattingen van snelheid en kosten zijn historisch gebaseerd). Deze taken omvatten spreadsheetmodellen, presentaties en korte video's.

- SWE-Bench Pro (coding) — GPT-5.2 Thinking behaalt ≈55.6% op SWE-Bench Pro en ~80% op SWE-Bench Verified (alleen Python) volgens OpenAI, wat een nieuwe state-of-the-art vestigt voor codegeneratie / engineering-evaluatie in hun tests. Dit vertaalt zich in de praktijk naar betrouwbaardere debugging en end-to-end fixes, volgens de voorbeelden van OpenAI.

- GPQA Diamond (science Q&A op graduate-niveau) — GPT-5.2 Pro: 93.2%, GPT-5.2 Thinking: 92.4% op GPQA Diamond (geen tools, maximale redenering).

- ARC-AGI-serie — Op ARC-AGI-2 (een moeilijkere benchmark voor vloeiende redenering) scoorde GPT-5.2 Thinking 52.9% en GPT-5.2 Pro 54.2% (OpenAI zegt dat dit nieuwe state-of-the-art-markeringen zijn voor chain-of-thought-stijlmodellen).

- Lang-context (OpenAI MRCRv2) — GPT-5.2 Thinking toont bijna 100% nauwkeurigheid op de 4-needle MRCR-variant tot 256k tokens en aanzienlijk verbeterde scores ten opzichte van GPT-5.1 in lang-contextinstellingen. (OpenAI publiceerde MRCRv2-grafieken en -tabellen.)

Vergelijking met hedendaagse alternatieven

- vs Google Gemini 3 (Gemini 3 Pro / Deep Think): Gemini 3 Pro is gepromoot met een ~1,048,576 (≈1M) token contextvenster en brede multimodale input (tekst, beeld, audio, video, PDF's) en sterke agentische integraties via Vertex AI / AI Studio. Op papier is het grotere contextvenster van Gemini 3 een onderscheidende factor voor extreem grote single-session workloads; afwegingen omvatten het tooling-aanbod en de geschiktheid binnen het ecosysteem.

- vs Anthropic Claude Opus 4.5: Anthropic’s Opus 4.5 legt de nadruk op enterprise coding/agent-workflows en rapporteert sterke SWE-bench-resultaten en robuustheid voor lange agent-sessies; Anthropic positioneert Opus voor automatisering en codegeneratie met een contextvenster van 200k en gespecialiseerde agent-/Excel-integraties. Opus 4.5 is een sterke concurrent in enterprise-automatisering en codetaken.

Praktische conclusie: GPT-5.2 richt zich op een evenwichtige set verbeteringen (400k context, hoge token-output, verbeterd redeneren/coderen). Gemini 3 richt zich op de absoluut grootste single-session contexten (≈1M), terwijl Claude Opus de nadruk legt op enterprise-engineering en agent-robustheid. Kies door te matchen op contextgrootte, modaliteitsbehoeften, feature/tooling-fit en afwegingen in kosten/latentie.

Toegang krijgen tot en gebruikmaken van de GPT-5.2 API

Stap 1: Aanmelden voor API-sleutel

Log in op cometapi.com. Als u nog geen gebruiker bent, registreer u dan eerst. Meld u aan bij uw CometAPI console. Verkrijg de toegangscertificaat-API-sleutel van de interface. Klik bij API-token in het persoonlijke centrum op “Add Token”, verkrijg de tokensleutel: sk-xxxxx en verzend.

Stap 2: Verzoeken verzenden naar de GPT-5.2 API

Selecteer het “gpt-5.2”-endpoint om het API-verzoek te verzenden en stel de request body in. De requestmethode en request body worden verkregen uit onze website-API-documentatie. Onze website biedt ook Apifox-test voor uw gemak. Vervang <YOUR_API_KEY> door uw daadwerkelijke CometAPI-sleutel uit uw account. Ontwikkelaars roepen deze aan via de Responses API / Chat endpoints.

Voeg uw vraag of verzoek in het content-veld in—hierop reageert het model. Verwerk de API-respons om het gegenereerde antwoord te verkrijgen.

Stap 3: Resultaten ophalen en verifiëren

Verwerk de API-respons om het gegenereerde antwoord te verkrijgen. Na verwerking reageert de API met de taakstatus en uitvoergegevens.

Zie ook Gemini 3 Pro Preview API