GLM-4.6 is de nieuwste grote release in Z.ai’s (voorheen Zhipu AI) GLM-familie: een vierde-generatie groot-taal-MoE (Mixture-of-Experts)-model afgestemd op agentgerichte workflows, redeneren met lange context en praktische code. Deze release legt de nadruk op praktische agent/tool-integratie, een zeer groot contextvenster, en de beschikbaarheid van open gewichten voor lokale inzet.

Belangrijkste kenmerken

- Lange context — native contextvenster van 200K tokens (uitgebreid van 128K). (docs.z.ai)

- Coderen & agentgerichte mogelijkheden — gecommuniceerde verbeteringen bij praktische programmeertaken en betere tool-aanroep voor agents.

- Efficiëntie — gerapporteerd ~30% lager tokenverbruik vs GLM-4.5 in Z.ai’s tests.

- Deployments & kwantisatie — eerst aangekondigde FP8- en Int4-integratie voor Cambricon-chips; native FP8-ondersteuning op Moore Threads via vLLM.

- Modelgrootte & tensortype — gepubliceerde artefacten duiden op een ~357B-parameter model (BF16 / F32-tensoren) op Hugging Face.

Technische details

Modaliteiten & formaten. GLM-4.6 is een alleen tekst LLM (invoer- en uitvoermodaliteiten: tekst). Contextlengte = 200K tokens; max. output = 128K tokens.

Kwantisatie & hardwareondersteuning. Het team meldt FP8/Int4-kwantisatie op Cambricon-chips en native FP8-uitvoering op Moore Threads-GPU’s met vLLM voor inferentie — belangrijk om de inferentiekosten te verlagen en on-premises en binnenlandse cloud-deployments mogelijk te maken.

Tooling & integraties. GLM-4.6 wordt verspreid via Z.ai’s API, netwerken van externe providers (bijv. CometAPI), en is geïntegreerd in coding agents (Claude Code, Cline, Roo Code, Kilo Code).

Technische details

Modaliteiten & formaten. GLM-4.6 is een alleen tekst LLM (invoer- en uitvoermodaliteiten: tekst). Contextlengte = 200K tokens; max. output = 128K tokens.

Kwantisatie & hardwareondersteuning. Het team meldt FP8/Int4-kwantisatie op Cambricon-chips en native FP8-uitvoering op Moore Threads-GPU’s met vLLM voor inferentie — belangrijk om de inferentiekosten te verlagen en on-premises en binnenlandse cloud-deployments mogelijk te maken.

Tooling & integraties. GLM-4.6 wordt verspreid via Z.ai’s API, netwerken van externe providers (bijv. CometAPI), en is geïntegreerd in coding agents (Claude Code, Cline, Roo Code, Kilo Code).

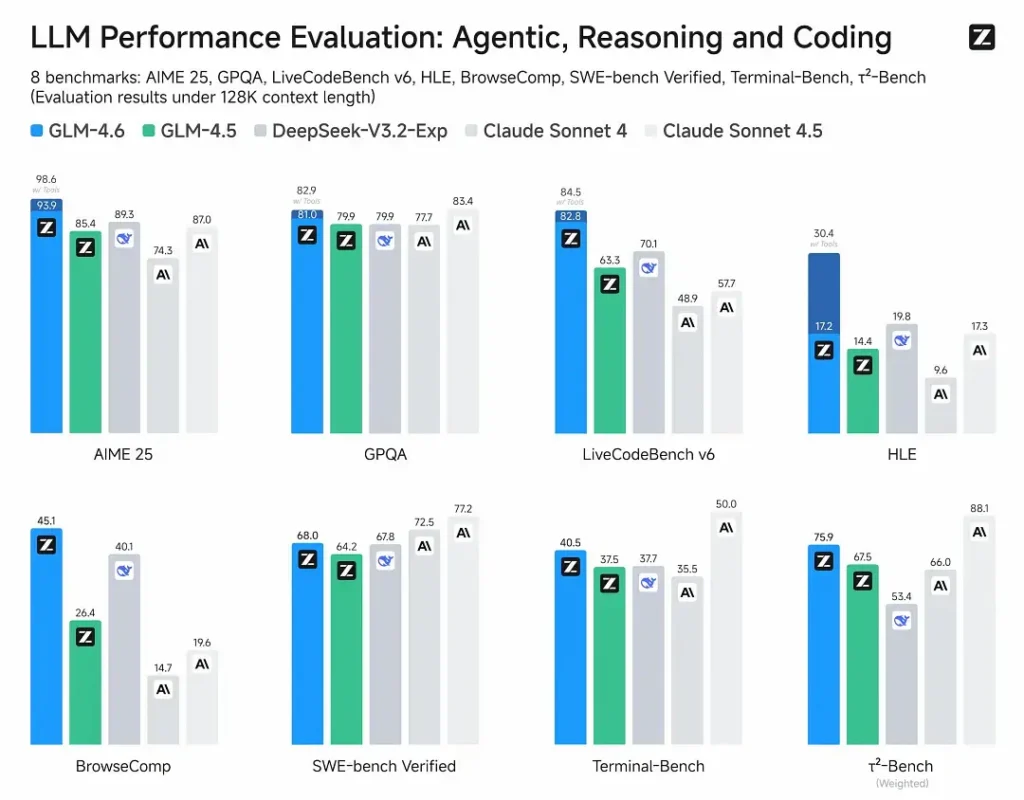

Benchmarkprestaties

- Gepubliceerde evaluaties: GLM-4.6 is getest op acht publieke benchmarks die agents, redeneren en coderen omvatten en vertoont duidelijke verbeteringen ten opzichte van GLM-4.5. In door mensen beoordeelde, praktijkgerichte coderingstests (uitgebreide CC-Bench) gebruikt GLM-4.6 ~15% minder tokens vs GLM-4.5 en noteert een ~48.6% winstpercentage vs Anthropic’s Claude Sonnet 4 (nagenoeg pariteit op veel ranglijsten).

- Positionering: resultaten stellen dat GLM-4.6 concurrerend is met toonaangevende binnenlandse en internationale modellen (voorbeelden zijn DeepSeek-V3.1 en Claude Sonnet 4).

Beperkingen & risico’s

- Hallucinaties & fouten: zoals alle huidige LLM’s maakt GLM-4.6 feitelijke fouten — Z.ai’s documentatie waarschuwt expliciet dat uitvoer fouten kan bevatten. Gebruikers moeten verificatie & retrieval/RAG toepassen voor kritieke inhoud.

- Modelcomplexiteit & servicekosten: 200K context en zeer grote uitvoer vergroten geheugen- en latentieverbruik aanzienlijk en kunnen de inferentiekosten verhogen; kwantisatie/inferentie-engineering is nodig om op schaal te draaien.

- Domeinleemtes: hoewel GLM-4.6 sterke agent/coderingsprestaties rapporteert, wijzen sommige openbare rapporten erop dat het nog steeds achterblijft bij bepaalde versies van concurrerende modellen in specifieke microbenchmarks (bijv. enkele coderingsmetrics vs Sonnet 4.5). Beoordeel per taak voordat productiemodellen worden vervangen.

- Veiligheid & beleid: open gewichten vergroten de toegankelijkheid maar brengen ook vragen over beheer met zich mee (mitigaties, guardrails en red-teaming blijven de verantwoordelijkheid van de gebruiker).

Use cases

- Agentgerichte systemen & tool-orkestratie: lange agenttraces, multi-toolplanning, dynamische tool-aanroep; de agentgerichte afstemming van het model is een belangrijk verkooppunt.

- Praktische code-assistenten: meerbeurten codegeneratie, code review en interactieve IDE-assistenten (geïntegreerd in Claude Code, Cline, Roo Code—per Z.ai). Verbeteringen in token-efficiëntie maken het aantrekkelijk voor intensief gebruik door ontwikkelaars.

- Workflows voor lange documenten: samenvatting, synthese van meerdere documenten, lange juridische/technische reviews dankzij het 200K-venster.

- Contentcreatie & virtuele personages: uitgebreide dialogen, consistent persona-behoud in multi-turn-scenario’s.

Hoe GLM-4.6 zich verhoudt tot andere modellen

- GLM-4.5 → GLM-4.6: stapverandering in contextgrootte (128K → 200K) en token-efficiëntie (~15% minder tokens op CC-Bench); verbeterd gebruik van agenten/tools.

- GLM-4.6 vs Claude Sonnet 4 / Sonnet 4.5: Z.ai meldt nagenoeg pariteit op meerdere ranglijsten en een ~48.6% winstpercentage op de CC-Bench praktijkgerichte coderingstaken (dus nauwe concurrentie, met enkele microbenchmarks waar Sonnet nog voorloopt). Voor veel engineeringteams wordt GLM-4.6 gepositioneerd als een kostenefficiënt alternatief.

- GLM-4.6 vs andere lang-contextmodellen (DeepSeek, Gemini-varianten, GPT-4-familie): GLM-4.6 legt de nadruk op grote context & agentgerichte code-workflows; relatieve sterktes hangen af van de metric (token-efficiëntie/agentintegratie vs ruwe code-synthese-nauwkeurigheid of safety-pipelines). Empirische selectie moet taakgedreven zijn.

Zhipu AI’s nieuwste vlaggenschipmodel GLM-4.6 uitgebracht: 355B totale parameters, 32B actief. Overtreft GLM-4.5 in alle kerncapaciteiten.

- Coderen: sluit aan bij Claude Sonnet 4, beste in China.

- Context: uitgebreid naar 200K (van 128K).

- Redeneren: verbeterd, ondersteunt tool-aanroep tijdens inferentie.

- Zoeken: verbeterde tool-aanroep en agentprestaties.

- Schrijven: sluit beter aan bij menselijke voorkeuren qua stijl, leesbaarheid en rollenspel.

- Meertalig: verbeterde vertaling tussen talen.