Kimi K2 Thinking is de nieuwe ‘denkende’ variant van de Kimi K2-familie van Moonshot AI: een triljoen-parameter, spaarzaam Mixture-of-Experts (MoE) model dat expliciet is ontworpen om denken terwijl je handelt — dat wil zeggen, om diepgaande gedachteketenredeneringen te combineren met betrouwbare tool calls, planning op lange termijn en geautomatiseerde zelfcontroles. Het combineert een grote, spaarzame backbone (≈1T totale parameters, ~32B geactiveerd per token), een native INT4-kwantificeringspijplijn en een ontwerp dat schaalbaar is inferentietijd redenering (meer ‘denktokens’ en meer rondes waarin tools worden aangeroepen) in plaats van alleen maar het verhogen van het aantal statische parameters.

In duidelijke bewoordingen: K2 Thinking behandelt het model als een probleemoplossend agent in plaats van een one-shot taalgenerator. Die verschuiving – van 'taalmodel' naar 'denkmodel' – maakt deze release opmerkelijk en is de reden waarom veel professionals het beschouwen als een mijlpaal in open-source agentische AI.

Wat is “Kimi K2 Thinking” precies?

Architectuur en belangrijkste specificaties

K2 Thinking is opgebouwd als een spaarzaam MoE-model (384 experts, 8 experts geselecteerd per token) met ongeveer 1 biljoen totale parameters en ~32B geactiveerde parameters per gevolgtrekking. Het maakt gebruik van hybride architectuurkeuzes (MLA-aandacht, SwiGLU-activaties) en is getraind met Moonshot's Muon/MuonClip-optimizer op grote tokenbudgetten, zoals beschreven in hun technisch rapport. De denkvariant breidt het basismodel uit met post-training kwantificering (native INT4-ondersteuning), een contextvenster van 256k en engineering om het interne redeneringsspoor van het model bloot te leggen en te stabiliseren tijdens echt gebruik.

Wat ‘denken’ in de praktijk betekent

'Denken' is hier een technisch doel: het model in staat stellen om (1) lange, gestructureerde ketens van interne redeneringen te genereren (gedachteketentokens), (2) externe tools (zoekmachines, Python-sandboxes, browsers, databases) aan te roepen als onderdeel van die redenering, (3) tussenliggende claims te evalueren en zelf te verifiëren, en (4) over vele van dergelijke cycli te itereren zonder de coherentie te verliezen. De documentatie en modelkaart van Moonshot tonen aan dat K2 Thinking expliciet getraind en afgestemd is om redeneringen en functieaanroepen te verweven, en om stabiel agentisch gedrag te behouden over honderden stappen.

Wat is het kerndoel?

De beperkingen van traditionele grootschalige modellen zijn:

- Het generatieproces is kortzichtig en mist stapsgewijze logica;

- Het gebruik van hulpmiddelen is beperkt (meestal kunnen alleen externe hulpmiddelen één of twee keer worden aangeroepen);

- Ze kunnen complexe problemen niet zelf oplossen.

Het belangrijkste ontwerpdoel van K2 Thinking is het oplossen van deze drie problemen. In de praktijk kan K2 Thinking, zonder menselijke tussenkomst: 200 tot 300 opeenvolgende tool calls uitvoeren; honderden stappen van logisch coherent redeneren bijhouden; complexe problemen oplossen door middel van contextuele zelfcontrole.

Herpositionering: taalmodel → denkmodel

Het K2 Thinking-project illustreert een bredere strategische verschuiving in het veld: de overstap van voorwaardelijke tekstgeneratie naar agentische probleemoplossersHet hoofddoel is niet primair om de perplexiteit of next-tokenvoorspelling te verbeteren, maar om modellen te maken die:

- Plannen hun eigen meerstappenstrategieën;

- Coördineren externe hulpmiddelen en effectoren (zoeken, code-uitvoering, kennisbanken);

- Controleren tussenresultaten en het corrigeren van fouten;

- Volhouden Coherentie over lange contexten en lange tool chains heen.

Door deze herformulering veranderen zowel de evaluatie (benchmarks leggen de nadruk op processen en resultaten, niet alleen op de kwaliteit van de tekst) als de techniek (structuren voor het routeren van gereedschappen, het tellen van stappen, zelfkritiek, etc.).

Werkwijzen: hoe denkmodellen werken

In de praktijk laat K2 Thinking verschillende werkwijzen zien die kenmerkend zijn voor de ‘thinking model’-aanpak:

- Blijvende interne sporen: Het model produceert gestructureerde tussenstappen (redeneersporen) die in context worden gehouden en later opnieuw gebruikt of gecontroleerd kunnen worden.

- Dynamische gereedschapsroutering: Op basis van elke interne stap beslist K2 welk hulpmiddel (zoekmachine, code-interpreter, webbrowser) moet worden aangeroepen en wanneer dat moet gebeuren.

- Testtijdschaling: Tijdens het redeneren kan het systeem zijn ‘denkdiepte’ uitbreiden (meer interne redeneertokens) en het aantal toolaanroepen verhogen om oplossingen beter te kunnen verkennen.

- Zelfverificatie en herstel: Het model controleert expliciet de resultaten, voert sanity-tests uit en maakt een nieuwe planning wanneer de controles mislukken.

Deze methoden combineren modelarchitectuur (MoE + lange context) met systeemtechniek (toolorkestratie, veiligheidscontroles).

Welke technologische innovaties maken Kimi K2 Thinking mogelijk?

Het redeneermechanisme van Kimi K2 Thinking ondersteunt verweven denken en het gebruik van hulpmiddelen. De redeneerlus van K2 Thinking:

- Het probleem begrijpen (parsen en abstraheren)

- Het genereren van een meerstappen-redeneringsplan (planketen)

- Gebruikmaken van externe hulpmiddelen (code, browser, wiskundige engine)

- Verifiëren en herzien van de resultaten (verifiëren en herzien)

- Redenering afronden (redenering afronden)

Hieronder introduceer ik drie belangrijke technieken die de redeneerlussen in xx mogelijk maken.

1) Testtijdschaling

Wat het is: Traditionele "schaalwetten" richten zich op het verhogen van het aantal parameters of data tijdens de training. De innovatie van K2 Thinking ligt in: het dynamisch uitbreiden van het aantal tokens (d.w.z. de diepgang van het denken) tijdens de "redeneerfase"; het gelijktijdig uitbreiden van het aantal tool calls (d.w.z. de breedte van de actie). Deze methode wordt test-time scaling genoemd en de kernveronderstelling is: "Een langere redeneerketen + meer interactieve tools = een kwalitatieve sprong in daadwerkelijke intelligentie."

Waarom het uitmaakt: K2 Thinking optimaliseert hier expliciet voor: Moonshot laat zien dat het uitbreiden van “thinking tokens” en het aantal/de diepte van tool calls meetbare verbeteringen oplevert in agentische benchmarks, waardoor het model beter presteert dan andere modellen van vergelijkbare of grotere omvang in FLOPs-gematchte scenario's.

2) Tool-Augmented Reasoning

Wat het is: K2 Thinking is ontworpen om toolschema's automatisch te parseren, autonoom te bepalen wanneer een tool moet worden aangeroepen en de resultaten van de tool te integreren in de doorlopende redeneerstroom. Moonshot trainde en optimaliseerde het model om de gedachteketen te verweven met functieaanroepen en stabiliseerde dit gedrag vervolgens over honderden opeenvolgende toolstappen.

Waarom het uitmaakt: Die combinatie (betrouwbaar parsen + stabiele interne status + API-tools) zorgt ervoor dat het model kan browsen op internet, code kan uitvoeren en workflows met meerdere fasen kan orkestreren als onderdeel van één sessie.

Binnen zijn interne architectuur vormt het model een uitvoeringstraject van een ‘gevisualiseerd denkproces’: prompt → redeneertokens → tool-aanroep → observatie → volgende redenering → definitief antwoord

3) Lange-horizon coherentie en zelfverificatie

Wat het is: Coherentie met een lange horizon is het vermogen van het model om een coherent plan en interne status te behouden over meerdere stappen en zeer lange contexten heen. Zelfverificatie betekent dat het model proactief de tussenliggende uitkomsten controleert en stappen opnieuw uitvoert of herziet wanneer een verificatie mislukt. Lange taken zorgen er vaak voor dat modellen afdwalen of hallucineren. K2 Thinking pakt dit aan met meerdere technieken: zeer lange contextvensters (256k), trainingsstrategieën die de status behouden over lange CoT-reeksen, en expliciete modellen voor getrouwheid/oordeel op zinsniveau om ongefundeerde beweringen te detecteren.

Waarom het uitmaakt: Het mechanisme van het "Recurrent Reasoning Memory" handhaaft de persistentie van de redeneringstoestand, waardoor het een menselijke "denkstabiliteit" en "contextuele zelfsupervisie"-kenmerken krijgt. Aangezien taken zich over meerdere stappen uitstrekken (bijvoorbeeld onderzoeksprojecten, codeertaken met meerdere bestanden, lange redactionele processen), wordt het essentieel om één samenhangende draad te behouden. Zelfverificatie vermindert stille fouten; in plaats van een plausibel maar onjuist antwoord te geven, kan het model inconsistenties detecteren en tools opnieuw raadplegen of een nieuwe planning maken.

Mogelijkheden:

- Contextuele consistentie: handhaaft semantische continuïteit over 10+ tokens;

- Foutdetectie en terugdraaien: identificeert en corrigeert logische afwijkingen in vroege denkprocessen;

- Zelfverificatielus: controleert automatisch de redelijkheid van het antwoord nadat de redenering is voltooid;

- Samenvoegen van multi-path-redenering: selecteert het optimale pad uit meerdere logische ketens.

Wat zijn de vier kerncompetenties van K2 Thinking?

Diep en gestructureerd redeneren

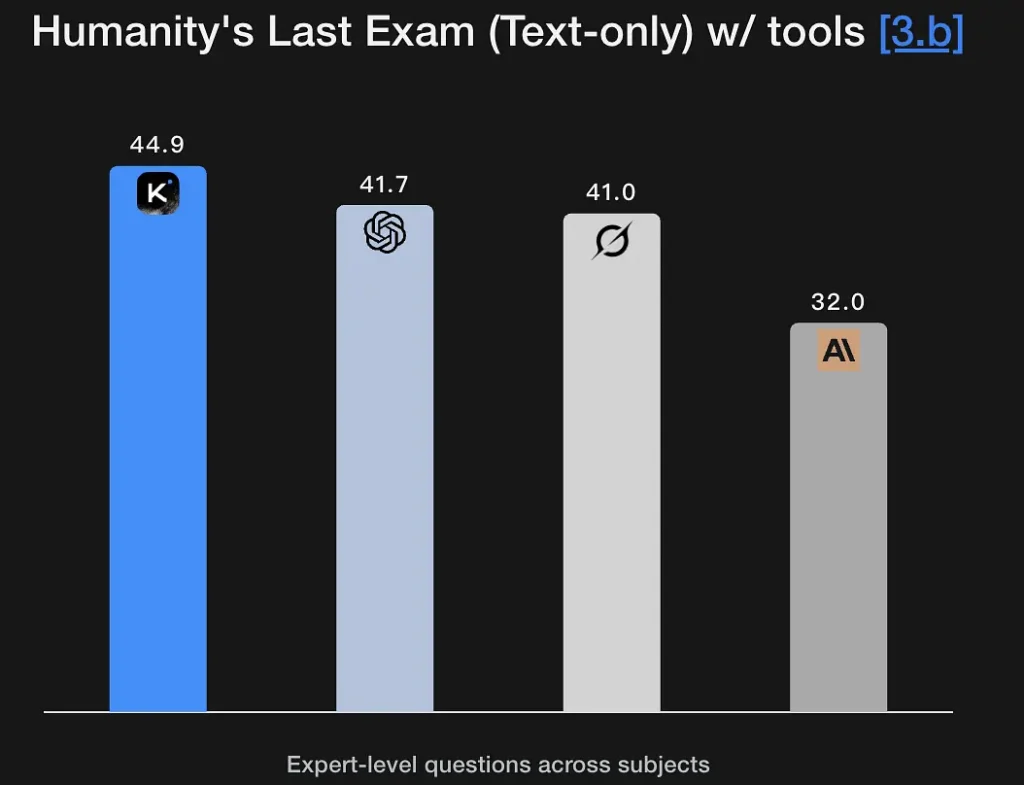

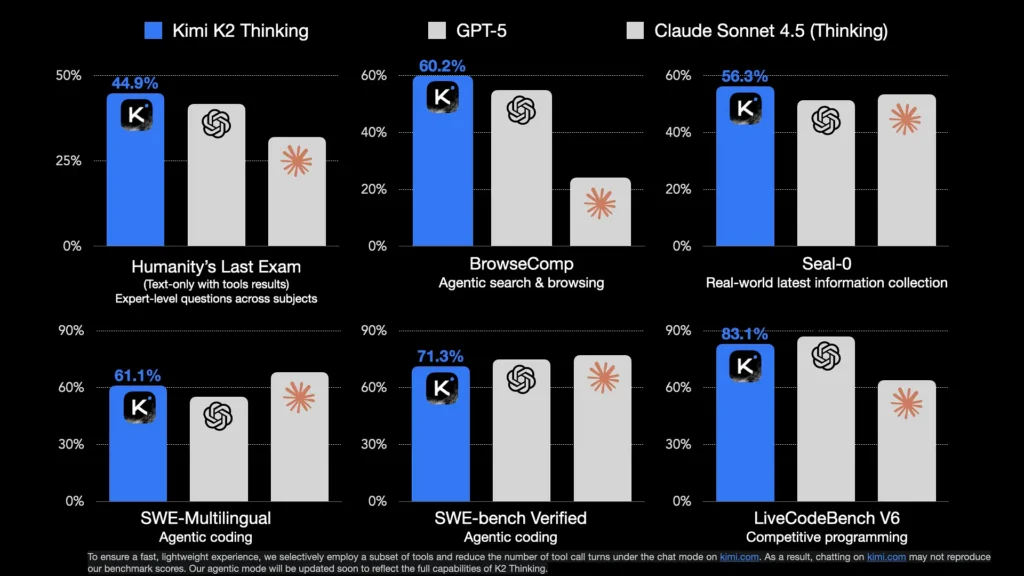

K2 Thinking is ontworpen om expliciete, meerstaps redeneerpatronen te genereren en deze te gebruiken om tot robuuste conclusies te komen. Het model scoort hoog op benchmarks voor wiskunde en rigoureus redeneren (GSM8K, AIME, IMO-stijl benchmarks) en toont het vermogen om redeneringen intact te houden gedurende lange reeksen – een basisvereiste voor probleemoplossing op onderzoeksniveau. De uitstekende score op Humanity's Last Exam (44.9%) toont analytische vaardigheden op expertniveau. Het kan logische kaders extraheren uit vage semantische beschrijvingen en redeneergrafieken genereren.

Belangrijkste kenmerken:

- Ondersteunt symbolisch redeneren: begrijpt en werkt met wiskundige, logische en programmeerstructuren.

- Bezit de capaciteiten om hypothesen te toetsen: kan spontaan hypothesen voorstellen en verifiëren.

- Kan probleemontleding in meerdere fasen uitvoeren: verdeelt complexe doelstellingen in meerdere subtaken.

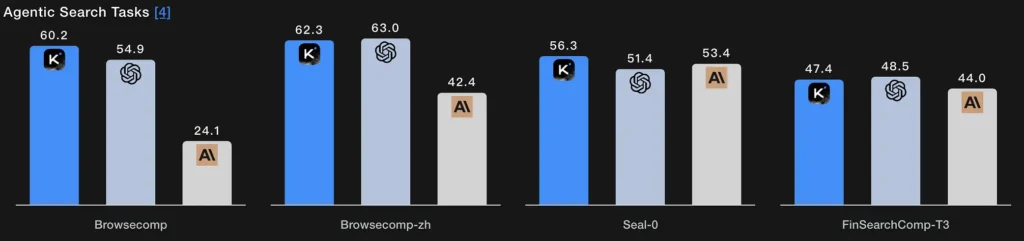

Agentisch zoeken

In plaats van één ophaalstap laat agentisch zoeken het model een zoekstrategie plannen (waarnaar gezocht moet worden), deze uitvoeren via herhaalde web-/toolaanroepen, de binnenkomende resultaten synthetiseren en de query verfijnen. De BrowseComp- en Seal-0-toolscores van K2 Thinking wijzen op sterke prestaties op dit gebied; het model is expliciet ontworpen om webzoekopdrachten met meerdere rondes en stateful planning te ondersteunen.

Technische essentie:

- De zoekmodule en het taalmodel vormen een gesloten lus: querygeneratie → webpagina-ophalen → semantische filtering → redeneerfusie.

- Het model kan zijn zoekstrategie adaptief aanpassen, bijvoorbeeld door eerst te zoeken naar definities, vervolgens naar gegevens en tot slot naar het verifiëren van hypothesen.

- In essentie is het een samengestelde intelligentie van ‘informatieopvraging + begrip + argumentatie’.

Agentische codering

Dit is het vermogen om schrijven, uitvoeren, testen en herhalen op code als onderdeel van een redeneerlus. K2 Thinking publiceert concurrerende resultaten op live coderings- en codeverificatiebenchmarks, ondersteunt Python-toolchains in zijn toolaanroepen en kan meerstaps debuglussen uitvoeren door een sandbox aan te roepen, fouten te lezen en code te repareren in herhaalde passes. De EvalPlus/LiveCodeBench-scores weerspiegelen deze sterke punten. Een score van 71.3% in de SWE-Bench Verified-test betekent dat het meer dan 70% van de echte softwarereparatietaken correct kan voltooien.

Het toont ook stabiele prestaties in de LiveCodeBench V6-competitieomgeving, waarbij de implementatie- en optimalisatiemogelijkheden van het algoritme worden getoond.

Technische essentie:

- Het maakt gebruik van een proces van ‘semantische parsing + AST-niveau refactoring + automatische verificatie’;

- Code-uitvoering en testen worden bereikt via tool-aanroepen op de uitvoeringslaag;

- Het realiseert een geautomatiseerde, gesloten ontwikkelingslus van het begrijpen van code → diagnosticeren van fouten → genereren van patches → verifiëren van succes.

Agentisch schrijven

Naast creatief proza is agentisch schrijven een gestructureerde, doelgerichte documentproductie die extern onderzoek, bronvermelding, tabelgeneratie en iteratieve verfijning (bijvoorbeeld een concept schrijven → feiten controleren → herzien) vereist. De lange context en tool-orkestratie van K2 Thinking maken het zeer geschikt voor schrijfworkflows met meerdere fasen (onderzoeksbrieven, samenvattingen van regelgeving, content over meerdere hoofdstukken). De open winstpercentages van het model op Arena-achtige tests en longform-schrijfstatistieken ondersteunen deze bewering.

Technische essentie:

- Genereert automatisch tekstsegmenten met behulp van agentische gedachteplanning;

- Controleert intern de tekstlogica via redeneertokens;

- Kan gelijktijdig hulpmiddelen zoals zoeken, berekenen en diagrammen genereren aanroepen om 'multimodaal schrijven' te bereiken.

Hoe kunt u K2 Thinking vandaag nog gebruiken?

Toegangswijzen

K2 Thinking is beschikbaar als open-source release (modelgewichten en checkpoints) en via platform-eindpunten en communityhubs (Hugging Face, Moonshot-platform). U kunt zelf hosten als u over voldoende rekenkracht beschikt, of gebruik maken van KomeetAPI's API/gehoste gebruikersinterface voor snellere onboarding. Het documenteert ook een reasoning_content veld dat, wanneer ingeschakeld, de interne gedachtentokens aan de aanroeper toont.

Praktische tips voor gebruik

- Begin met agentische bouwstenen: stel eerst een kleine set deterministische tools beschikbaar (zoeken, Python-sandbox en een betrouwbare feitendatabase). Bied duidelijke toolschema's zodat het model aanroepen kan parsen/valideren.

- Test-tijdberekening afstemmen: voor het oplossen van lastige problemen, houd rekening met langere denkbudgetten en meer tool-call rondes; meet hoe de kwaliteit verbetert ten opzichte van de latentie/kosten. Moonshot zet zich in voor het testen van tijdschaalvergroting als primaire hefboom.

- Gebruik INT4-modi voor kostenefficiëntie: K2 Thinking ondersteunt INT4-kwantificering, wat zinvolle versnellingen oplevert; maar valideert ook edge-case-gedrag op uw taken.

- Oppervlakte redeneerinhoud zorgvuldig: het blootleggen van interne ketens kan helpen bij het debuggen, maar vergroot ook de kans op fouten in het ruwe model. Behandel interne redeneringen als diagnostisch niet gezaghebbend; combineer het met automatische verificatie.

Conclusie

Kimi K2 Thinking is een doelbewust ontworpen antwoord op het volgende tijdperk van AI: niet alleen grotere modellen, maar agenten die denken, handelen en verifiërenHet combineert MoE-schaalbaarheid, test-time rekenstrategieën, native low-precision inference en expliciete toolorkestratie om duurzame, meerstaps probleemoplossing mogelijk te maken. Voor teams die meerstaps probleemoplossing nodig hebben en de technische discipline hebben om agentische systemen te integreren, te sandboxen en te monitoren, is K2 Thinking een grote, bruikbare stap voorwaarts – en een belangrijke stresstest voor hoe de industrie en de maatschappij steeds capabelere, actiegerichte AI zullen besturen.

Ontwikkelaars hebben toegang tot Kimi K2 Denken API via CometAPI, de nieuwste modelversie wordt altijd bijgewerkt met de officiële website. Om te beginnen, verken de mogelijkheden van het model in de Speeltuin en raadpleeg de API-gids voor gedetailleerde instructies. Zorg ervoor dat u bent ingelogd op CometAPI en de API-sleutel hebt verkregen voordat u toegang krijgt. KomeetAPI bieden een prijs die veel lager is dan de officiële prijs om u te helpen integreren.

Klaar om te gaan?→ Meld u vandaag nog aan voor CometAPI !

Als u meer tips, handleidingen en nieuws over AI wilt weten, volg ons dan op VK, X en Discord!