OpenAIs GPT-5 ble lansert tidlig i august 2025 og ble raskt tilgjengelig gjennom flere leveringskanaler. En av de raskeste måtene for team å eksperimentere med GPT-5 uten å bytte leverandør-SDK-er er CometAPI – en flermodell-gateway som eksponerer GPT-5 sammen med hundrevis av andre modeller. Denne artikkelen inneholder praktisk dokumentasjon for å forklare hva CometAPI tilbyr, hvordan å kalle GPT-5 gjennom den, avveiningene du bør evaluere, og praktisk styring og kostnadskontroll som må implementeres før du flytter kritiske arbeidsflyter til GPT-5.

Hva er GPT-5, og hva gjør den annerledes enn tidligere modeller?

GPT-5 er OpenAIs neste flaggskipfamilie av store språkmodeller, utgitt tidlig i august 2025. Den presenteres som et enhetlig, multimodalt resonneringssystem som kombinerer raske ikke-resonneringskomponenter, en dypere "resonnerings"-variant (ofte referert til som "GPT-5-tenkning") og en ruter som bestemmer hvilken delmodell som skal brukes basert på kompleksitet og nødvendige verktøy. Nettoeffekten som hevdes av OpenAI: bedre resonnering, større kontekstvinduer og forbedret støtte for koding og agentoppgaver.

Arkitektur og viktige funksjoner

- Flerkomponentsystem: GPT-5 beskrives som et system som ruter forespørsler til forskjellige interne delmodeller (rask vs. dyp resonnering) avhengig av behov; utviklere kan be om resonneringsmodellen via API-et for maksimal ytelse.

- Stor kontekst: Modellfamilien støtter ekstremt store kontekster (hundretusenvis av tokens), noe som muliggjør håndtering av lange dokumenter, kodebaser eller samtaler med flere filer i ett trinn.

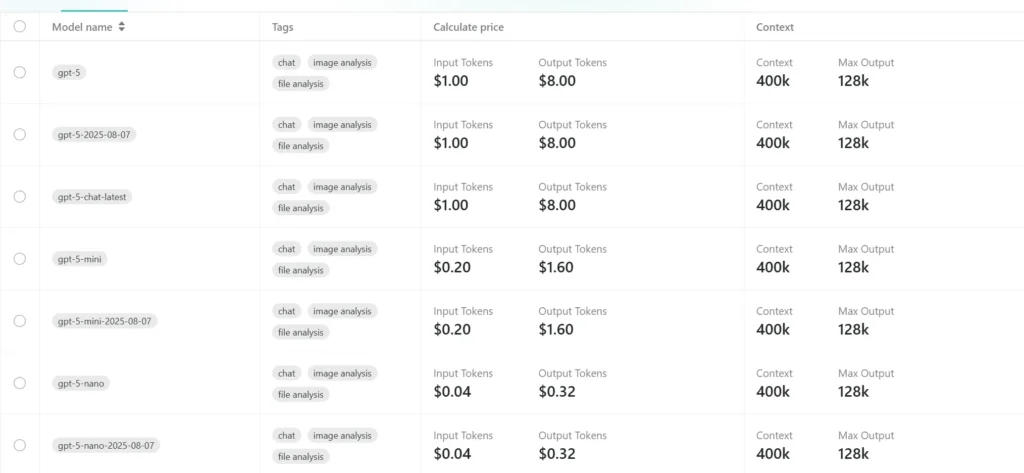

- Familie i flere størrelser: OpenAI ga ut GPT-5 i flere størrelser (vanlig

gpt-5,gpt-5-mini,gpt-5-nano) slik at team kan avveie latens, kostnad og resonneringsevne.

Hva er CometAPI, og tilbyr det faktisk GPT-5?

En rask definisjon

CometAPI er en API-aggregeringsplattform som annonserer enhetlig tilgang til hundrevis av AI-modeller (OpenAIs GPT-familier, Anthropic Claude, xAI Grok, bildemodeller og mer) gjennom et enkelt, OpenAI-kompatibelt REST-grensesnitt. Det betyr at utviklere kan bytte modellleverandører ved å endre en modellnavnstreng i stedet for å omskrive nettverkskoden. På produktsidene sine lister CometAPI eksplisitt opp GPT-5 og relaterte varianter (f.eks. gpt-5, gpt-5-chat-latest, gpt-5-mini) som tilgjengelige endepunkter.

Hvorfor team bruker gatewayer som CometAPI

Gateway-tjenester som CometAPI er attraktive fordi de lar deg:

- Bytt modeller raskt uten å endre store mengder integrasjonskode.

- Sammenligne priser og rute visse forespørsler til billigere eller raskere modellvarianter.

- Samlet fakturering og logging på tvers av flere modeller og leverandører.

CometAPIs dokumentasjon tilbyr en enkel migreringsvei og en klient i OpenAI-stil (så din eksisterende OpenAI- eller «openai-kompatible» kode trenger ofte bare mindre endringer).

Hvordan eksponerer CometAPI GPT-5 programmatisk?

CometAPI presenterer en OpenAI-kompatibel REST API overflate: en basis-URL, Authorization: Bearer <YOUR_KEY>, og forespørselstekster som ligner på OpenAIs chat-/fullføringsendepunkter. For GPT-5 Plattformen dokumenterer modellnavn som gpt-5, gpt-5-miniog gpt-5-nano og endepunkter som er nevnt inkluderer POST https://api.cometapi.com/v1/chat/completions for chat-lignende samtaler og /v1/responses for noen ikke-chat-varianter. Eksempler på konfigurasjonsdetaljer (basis-URL, headerformat og modellparameter) er publisert i CometAPI-dokumentasjon og hurtigstartguider.

Typisk endepunkt og autentiseringsmønster

- Grunnadresse:

https://api.cometapi.com/v1(eller den dokumenterte/v1/chat/completionsfor chat og/v1/responsesfor noen ikke-chat-varianter.). - Autorisasjonsoverskrift:

Authorization: Bearer sk-xxxxxxxxxxxx(CometAPI-problemersk-stiltokener i dashbordet). - Innholdstype:

application/json. - Modellparameter: sett

modeltilgpt-5, gpt-5-2025-08-07,gpt-5-chat-latest,gpt-5-minieller andre, se modellside.

Hvordan kommer jeg i gang med CometAPI og ber om GPT-5? (trinn for trinn)

Nedenfor finner du en kortfattet og pålitelig onboarding-prosess du kan følge i dag.

Trinn 1: Registrer deg og få en CometAPI-nøkkel

- Gå til cometapi.com og opprette en konto.

- Fra dashbordet ditt, gå til API-tokens or Personlig senter → Legg til tokenCometAPI utsteder en token i

sk-...format. Oppbevar dette sikkert (ikke legg inn nøkler i offentlige arkiver).

Trinn 2: Velg modellstrengen

- Velg modellnavnet som passer dine behov (f.eks.

gpt-5,gpt-5-nano-2025-08-07CometAPI publiserer ofte flere alias for hver modell, slik at du kan velge avveininger mellom nøyaktighet og kostnad.

Trinn 3: Gjør din første forespørsel (krøll)

En minimal curl eksempel som følger det OpenAI-kompatible mønsteret:

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-YOUR_COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-5",

"messages": [{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"Summarize the benefits of using a model aggregator."}],

"max_tokens": 500,

"temperature": 0.2

}'

Dette speiler OpenAIs chat-API-struktur, men peker til CometAPIs basis-URL og bruker Comet-tokenet ditt.

Trinn 4: Python-eksempel (forespørsler)

import requests, os

COMET_KEY = os.getenv("COMETAPI_KEY") # set this in your environment

url = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "gpt-5",

"messages": [

{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"List three concrete steps to reduce model hallucination in production."}

],

"max_tokens": 400,

"temperature": 0.1

}

resp = requests.post(url, json=payload, headers=headers, timeout=60)

resp.raise_for_status()

print(resp.json())

Erstatt model med gpt-5-nano eller det nøyaktige aliaset CometAPI-dokumenter for mindre, billigere varianter.

Pris i CometAPI

Hva er praktiske beste praksiser og avbøtende tiltak for bruk i produksjon?

Nedenfor finner du konkrete mønstre for å redusere risiko og forbedre påliteligheten når du bruker et mellomledd som CometAPI.

Start med et lite pilotprosjekt og kjør tester side om side

Kjør identiske forespørsler til OpenAI (hvis du har direkte tilgang) og CometAPI for å sammenligne utdata, latens og kostnader. Dette avslører eventuelle implisitte transformasjoner, innholdsfiltre eller avvik i modellalias.

Instrument for observerbarhet og kvalitetssikring

Loggfør prompter, returnerte tokener (tilslørt for PII), latenser og feilkoder. Implementer automatiserte tester for prompt-drift og hallusinasjonsrater. Spor bruk av modellalias slik at migreringer er reviderbare.

Beskytt nøklene og roter dem regelmessig

Behandle CometAPI-tokener som alle API-hemmeligheter: lagre i hemmelighetsbehandlere, roter med jevne mellomrom, og tildel tokener omfang til miljøer (utvikler/stage/produksjon).

Implementer lagdelt sikkerhet

Bruk en kombinasjon av:

- Rask prosjektering for å redusere hallusinasjoner (eksplisitte begrensninger, strukturert output).

- Etterbehandlingskontroller (faktaverifisering, blokkeringslister, regex-sjekker for personlig identifiserende informasjon).

- Menneske i løkka for høyrisikoutganger.

Disse er standard for GPT-5-implementeringer som håndterer kritisk eller lovlig innhold.

Hva er vanlige fallgruver, og hvordan feilsøker du tilgangsproblemer?

Fallgruve: «modellen finnes ikke / ingen tilgang». Noen utviklere rapporterer at modelltilgang kan begrenses av leverandørverifisering eller organisasjonsverifiseringstrinn når man bruker direkte leverandør-API-er. Lignende begrensninger kan oppstå når aggregatorer bruker en proxy for leverandørmodeller. Hvis du ser en «modellen finnes ikke»- eller tillatelsesfeil, sjekk: (a) om CometAPI-nøkkelen din er gyldig og ikke utløpt, (b) om det forespurte modellnavnet nøyaktig samsvarer med CometAPIs støttede liste, og (c) om det er ytterligere verifiserings- eller faktureringstrinn som kreves av den underliggende leverandøren. Eller verifiseringsrelaterte tilgangsfeil og tidsavbrudd/tillatelsesavvik – vær forberedt på å gi detaljer til kontaktpersonell for å løse dem (e-post: support@cometapi.com).

Fallgruve: uventet ventetid eller kostnad. Høyresonneringsmoduser og store kontekster forårsaker latens og tokenforbruk. max_tokens, redusere temperature der det er passende, og foretrekker mini varianter for arbeidsmengder med høy gjennomstrømning. Overvåk med logging og varsling.

Avsluttende notat

CometAPI gir team en rask rute til å eksperimentere med GPT-5-varianter samtidig som det sentraliserer modelltilgang, men produksjonsbruk krever samme disiplin som du ville brukt på enhver kraftig modell: sikre nøkler, nøye prompt-utvikling, overvåking av hallusinasjoner og gjennomgang av retningslinjer/juridisk informasjon for sensitive arbeidsbelastninger. Start med et lite pilotprosjekt, bruk CometAPIs dashbord til å måle tokenforbruk og latens, og eskaler til varianter med høyere begrunnelse bare etter å ha validert nøyaktighet og sikkerhet for domenet ditt.

Utviklere har tilgang GPT-5 , GPT-5 Nano og GPT-5 Mini gjennom CometAPI (CometAPI anbefaler /v1/responses), de nyeste modellversjonene som er oppført er per artikkelens publiseringsdato. For å begynne, utforsk modellens muligheter i lekeplass og se API-veiledningen for detaljerte instruksjoner. Før du får tilgang, må du sørge for at du har logget inn på CometAPI og fått API-nøkkelen. CometAPI tilby en pris som er langt lavere enn den offisielle prisen for å hjelpe deg med å integrere.

Se også Slik bruker du GPT-5s nye parametere og verktøy

Spørsmål og svar

1. Hvilken GPT-5-modellvariant bør du velge, og hva med tokens/priser?

CometAPI viser flere GPT-5-varianter (standard gpt-5, chat-øyeblikksbilder som gpt-5-chat-latestog mindre versjoner som f.eks. gpt-5-mini/gpt-5-nano). Velg etter dine behov:

gpt-5/gpt-5-chat-latest— full kapasitet for generell chat, best for kvalitet og resonnement.gpt-5-mini/gpt-5-nano— lavere kostnader og ventetid for oppgaver med høyt volum eller lavere kritiske punkter.

2. Hvordan bør du utforme samtaler for store kontekster og resonnement av høy kvalitet?

Lang kontekst: GPT-5 støtter svært store kontekstvinduer. Når du sender store dokumenter, bruk chunk-input bevisst, bruk henteforsterkning (vektor-DB + kontekstvinduer), og hold max_tokens for utganger begrenset for å kontrollere kostnader.

3. Hvilke sikkerhets-, personvern- og samsvarstiltak bør du bruke?

API-nøkkelhygiene. Oppbevar nøkler i miljøvariabler, roter dem regelmessig og bruk omfang når det er mulig. Ikke lagre nøkler i repositorier. (Beste praksis gjenspeiles i utviklerveiledninger.)

Datalagring og personvern. Les CometAPIs personvernregler og vilkår (og OpenAIs regler) før du sender sensitive personopplysninger, helseopplysninger eller regulerte data gjennom en tredjepartsaggregator. Noen bedrifter vil kreve direkte leverandørkontrakter eller private instanser.

Hastighetsgrenser og kvotebeskyttelse. Implementer effektbrytere, eksponentiell tilbakekobling og kvotekontroller i produksjon for å forhindre løpske kostnader og kaskadefeil. CometAPI-dashbord eksponerer bruk og kvoter – bruk dem til å håndheve programmatiske grenser.