ByteDances forskningsavdeling Seed har lansert Seed3D 1.0, en enkeltbilde-→ høykvalitets 3D-grunnmodell som produserer simuleringsklare masker, PBR-materialer og justerte teksturer – ressurser designet for å kobles direkte til fysikkmotorer og robotsimulatorer. Utgivelsen tar sikte på å lukke et smertefullt gap: skalerbar innholdsgenerering (mangfoldig visuelt innhold) kontra fysikkgjengivelse som kreves av kroppsliggjort AI og simulatortrening.

Hva er ByteDance Seed3D 1.0?

Seed3D 1.0 er en 3D-fundamentmodell bygget for å konvertere et enkelt RGB-bilde av et objekt eller miljø inn i en simuleringsklar 3D-ressurspakke – vanligvis et eksplisitt, vanntett nett, tilhørende UV-kartlagte teksturkart og fysisk baserte renderingsparametere (PBR). Modellen er ikke bare designet for å produsere visuelt trofast geometri og teksturer, men også for å generere ressurser som trenger minimal etterbehandling før de brukes i simulatorer som Isaac Sim, Unity eller Unreal Engine for robotikk, trening eller generering av virtuelle verdener.

Viktige mål på overordnet designnivå:

- EnkeltbildeinngangFjern behovet for maskinvare for opptak eller skanning av flere visninger.

- SimuleringsberedskapSørg for at topologi, skala og PBR-materialer er egnet for fysisk simulering.

- Scene skalerbarhet: tillater at genererte objekter automatisk settes sammen til sammenhengende scener.

- Integrasjonminimal tilpasning til vanlige fysikkmotorer og runtime-pipelines.

Hvilke funksjoner tilbyr Seed3D 1.0?

Høykvalitetsgeometri (vanntette nett)

Seed3D produserer lukket manifoldgeometri Utviklet for nøyaktig kollisjonshåndtering og pålitelig kontaktfysikk. Geometrikomponenten bruker en VAE + diffusjonstransformatorhybrid for å produsere nettinger som bevarer detaljnivået og som beholder fine strukturelle detaljer som tynne fremspring, hull og tekst. Nettingutvinningsrørledningen bruker en dobbel marsjerende kuber / hierarkisk iso-overflatestrategi for å effektivt utvinne overflater av høy kvalitet. ()

Fotorealistiske teksturer og PBR-materialer

Teksturpipelinen gir konsistente albedokart med flere visninger og fulle PBR-teksturer (albedo, metallisk, ruhet), og kan produsere teksturutganger med opptil 4K-oppløsning. Disse kartene er utformet slik at belysning oppfører seg fysisk plausibelt i renderingsmotorer. En UV-malingsmodul fullfører okkluderte områder og sikrer romlig koherens på tvers av UV-atlaset.

Simulering og pipelineberedskap

Utdata kan eksporteres til vanlige formater (OBJ/GLB). Genererte ressurser er bevisst simuleringsklarDe integreres i fysikksimulatorer der kollisjonsnett og friksjons-/stivhetsparametere kan automatisk utledes eller justeres, noe som muliggjør umiddelbar bruk i robotikk eller spillmotorer. Seed3D demonstrerer arbeidsflyter som plasserer genererte ressurser i Isaac Sim for manipulasjonseksperimenter.

Scenegenerering og faktorisert montering

Utover enkeltstående objekter bruker Seed3D en faktorisert scenegenereringstilnærming der visjonsspråklige modeller utleder layoutkart (posisjoner, skalaer, orienteringer) og Seed3D syntetiserer og plasserer objekter deretter, noe som muliggjør sammenhengende scenekomposisjon for interiør og urbane layouter.

Resultat av ytelsesevaluering

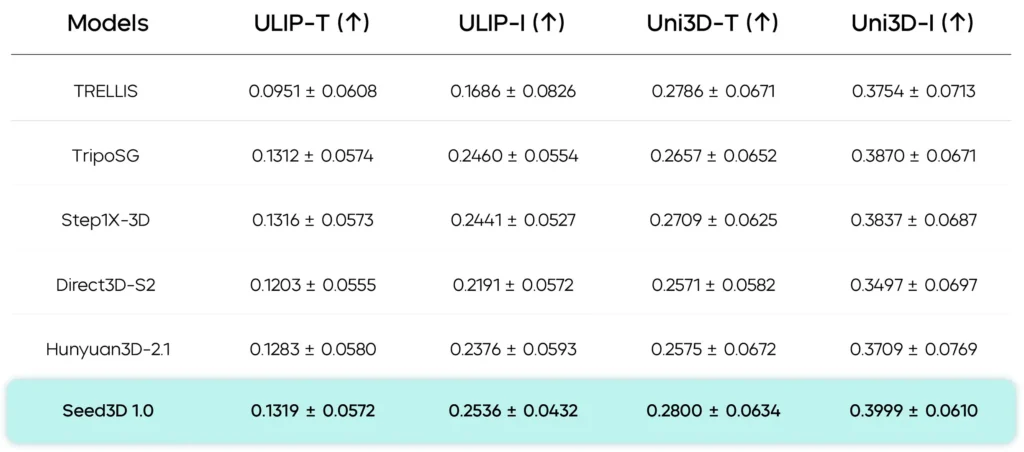

Geometrigenerering

På geometriske referansepunkter oppnår Seed3D 1.0s geometrimodell med 1.5 milliarder parametere (Seed3D-DiT + VAE) bedre strukturell nøyaktighet og finere detaljer sammenlignet med flere grunnlinjer (TRELLIS, TripoSG, Step1X-3D, Direct3D-S2 og store modeller som Hunyuan3D-2.1). Seed3Ds arkitektur – diffusjon av latent rom kombinert med nøye SDF-dekoding og hierarkisk nettutvinning – gir nettinger med færre artefakter og bedre bevaring av høyfrekvent geometri (tekst, små fremspring).

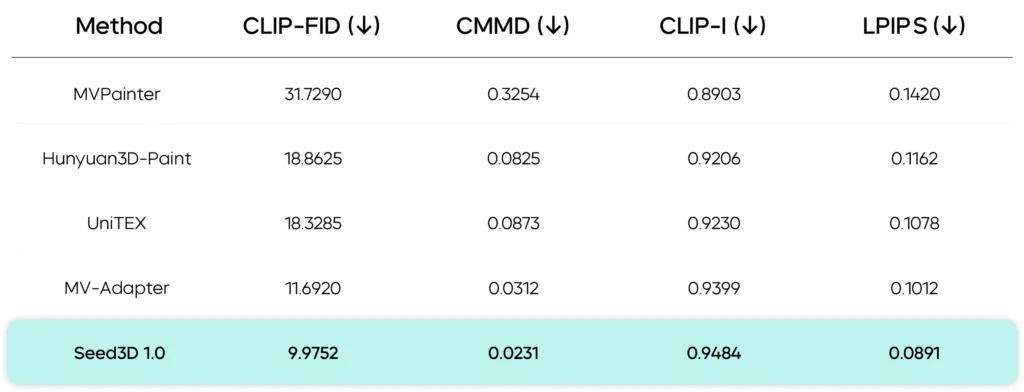

Teksturgenerering

For tekstur- og materialestimater rapporterer Seed3D betydelige gevinster i justering med referansebilder og i materialrealisme. Seed3D-PBR-dekomposisjonen og Seed3D-UV-innmalingen produserer sammen UV-atlasser som bevarer høyfrekvente teksturdetaljer og gir sammenhengende PBR-kart (albedo, metallisk, ruhet) som er egnet for fysisk gjengivelse.

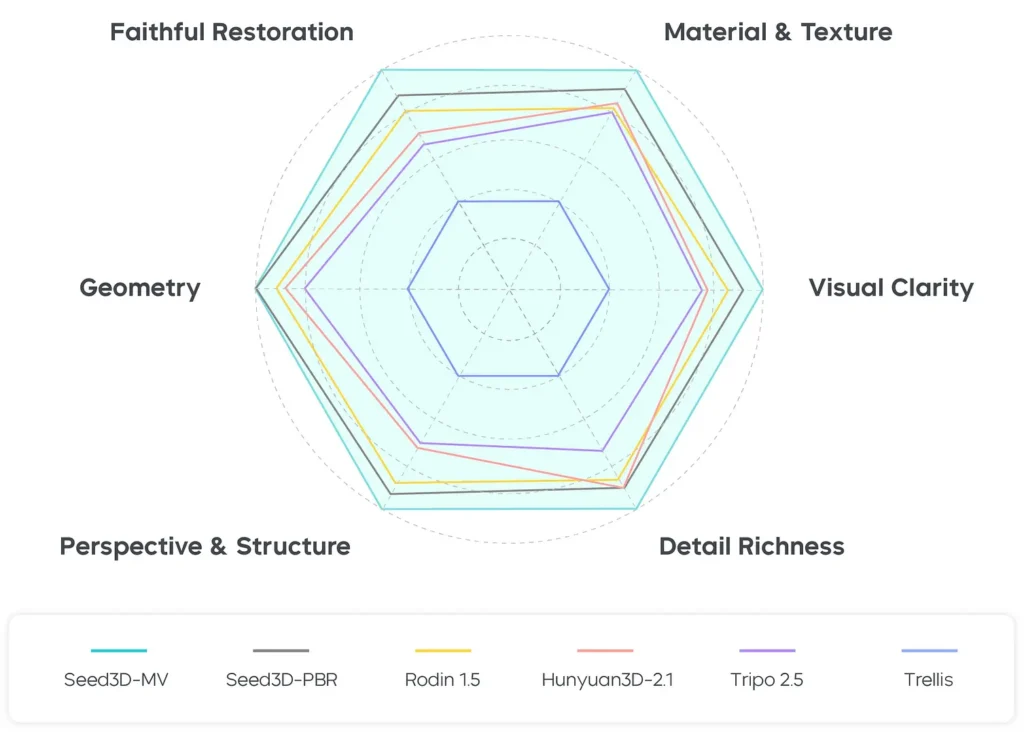

Menneskelig evaluering (brukerstudie)

Artikkelen rapporterer en brukerstudie med 14 menneskelige evaluatorer over et testsett med 43 bilder. Evaluatorene sammenlignet flere metoder på tvers av dimensjoner som visuell klarhet, naturtro restaurering, geometrisk nøyaktighet, perspektiv og struktur, material- og teksturrealisme og detaljrikdom. Seed3D 1.0 fikk gjennomgående høyere subjektive vurderinger på tvers av disse kategoriene, med de mest uttalte fordelene innen geometri og materialkvalitet. Den menneskelige studien bekrefter de kvantitative referansepunktene, og viser at opplevd realisme og simuleringsegnethet ble bedre i forhold til grunnlinjene.

Hvordan fungerer Seed3D 1.0 (arkitektur og pipeline)?

Seed3D 1.0 er utformet som et flerkomponentsystem som kombinerer representasjoner av lært latent geometri, transformatorbasert støyreduksjon i latent rom og flervisnings- og teksturkompletteringsmoduler. Designet er bevisst modulært, slik at hver komponent kan optimaliseres og oppgraderes uavhengig.

Hovedkomponenter

**Seed3D-VAE (latent geometri-koder/dekoder)**Lærer en kompakt latent representasjon for 3D-geometri (f.eks. TSDF/mesh latent). VAE er trent til å rekonstruere høyoppløselig, vanntett geometri fra komprimerte latente koder. Dette gir en effektiv flaskehals for genereringsstadiet.

**Seed3D-DiT (diffusjonstransformator for geometri)**En likerettet flyt-/støyfjerningstransformator (DiT-lignende) som opererer i det latente rommet for lært geometri. Betinget av en referansebildeinnbygging, støyfjernerer den iterativt latente tokener til en latent geometri som VAE dekoder til et eksplisitt nett.

**Seed3D-MV (flervisningssyntese) og Seed3D-UV (teksturfullføring)**Etter at den første geometrien er produsert, syntetiserer systemet flere visninger for å redusere okklusjonstvetydighet, og fullfører deretter UV-kart via en innmalings-/UV-forbedringsmodul for å produsere fullstendige, sammenhengende teksturer.

**Seed3D-PBR (materialnedbrytning)**Dekomponerer genererte teksturer til PBR-kart (metalliskhet, ruhet, normale kart osv.) slik at fysisk plausible skyggelegging og kontaktresponser bevares i simuleringen.

Visjons-språkmodell for scenefaktoriseringFor scenegenerering bruker pipelinen VLM-er til å oppdage objekter, forutsi romlige forhold og produsere layoutkart (posisjon, skala, orientering). Individuelle objekter genereres og settes deretter sammen til en scene i henhold til layoutkartet. ()

Høynivå inferensflyt

- Inndata: enkelt RGB-bilde → bildekoder trekker ut visuell innebygging.

- Geometrigenerering: Seed3D-DiT betinget av innebyggingens støydempende geometriske latenter → Seed3D-VAE dekoder mesh (vanntett).

- Flervisningssyntese: generer syntetiske visninger fra mesh + render-pipelinen for teksturfullføring.

- UV og tekstur: Seed3D-UV maler inn okklusjoner og produserer komplette UV-kart → Seed3D-PBR dekomponerer teksturer til materialkart.

- Eksport: produser .obj/.gltf med teksturer og materialkart, klargjort for fysikkmotorer (kollisjonsnett, skalaestimering av VLM).

Scenegenerering

Seed3D genererer ikke bare individuelle objekter, men genererer også automatisk komplette scener.

Generasjonsprosess:

- Input: Et bilde som inneholder flere objekter;

- VLM-modellen identifiserer objektene og de romlige forholdene i bildet;

- Seed3D genererer geometrien og teksturen for hvert objekt;

- Til slutt kombineres den romlige layouten for å danne en komplett 3D-scene.

Hva er begrensningene og åpne utfordringene?

Seed3D 1.0 er et stort steg, men det gjenstår flere begrensninger – både iboende for generering av enkeltbilder og spesifikke for simuleringskontekster:

- Enkeltsyns tvetydighetÅ utlede okkludert geometri og eksakt topologi fra ett perspektiv er fundamentalt feilaktig formulert; tidligere data og lært statistikk hjelper, men feil gjenstår for sterkt okkluderte områder.

- Fysisk korrekthet i skalaSelv om eiendeler er «simuleringsklare» basert på mange praktiske mål, krever finmasket masse-/treghetsestimering og ledddynamikk for komplekse artikulerte systemer fortsatt domenespesifikk justering.

- Sjeldne materialer og mikrostrukturSvært speilblanke, gjennomskinnelige eller anisotrope materialer (f.eks. børstede metaller, tekstiler med spredning under overflaten) er vanskeligere å reprodusere nøyaktig fra et enkelt bilde.

- DataskjevheterTreningsdatakilder påvirker hva modellen fanger opp godt – uvanlige objekter eller kulturspesifikke artefakter kan reproduseres dårlig.

- Immaterielle rettigheter og etikkSom med alle generative systemer, må skapere og organisasjoner vurdere IP og proveniens når de konverterer opphavsrettsbeskyttede bilder til 3D-ressurser.

Søknadsscenario

Seed3D er eksplisitt posisjonert for kroppsliggjort AI og simulering brukstilfeller, men implikasjonene spenner over flere bransjer:

- Robotikk og RL-treningRask innholdsgenerering for manipulasjonsbenchmarks, treningsplaner og domene-randomiserte datasett for overføring fra sim til reell. Eiendelenes fysikkklargjøring reduserer friksjon ved forhåndsbehandling.

- Spillutvikling og XRakselerert oppretting av ressurser for prototyper, bakgrunnsrekvisitter eller hele scener; PBR-arbeidsflyter og 4K-teksturer er spesielt nyttige for opplevelser med høy kvalitet.

- Virtuell produksjon og visualiseringRask generering av rekvisitter og miljøelementer for konseptualisering eller forhåndsvisualisering.

- InnholdsproduksjonsrørledningerDesignere kan iterere fra 2D-referanser (bilder, kunst) til 3D-prototyper mye raskere, noe som muliggjør hybride arbeidsflyter med mennesker og kunstig intelligens der kunstnere finjusterer resultatene. ()

- ForskningStorskala generering av mangfoldige 3D-treningsdata for visjon-språk-handlingsmodeller og annen multimodal forskning. Artikkelen rammer eksplisitt Seed3D inn som et verktøy for å fremme forskning på simulatorskala og kroppsliggjort intelligens i verdensklasse.

Seed3D kan konvertere et enkelt bilde til et detaljert 3D-objekt som er egnet for simulering og interaktiv bruk, noe som utvider tilgangen til produksjon av 3D-innhold av høy kvalitet.

Konklusjon

ByteDances Seed3D 1.0 representerer et betydelig skritt mot skalerbar 3D-generering i simuleringsklasse fra enkle 2D-inndata. Ved å kombinere en fokusert geometripipeline (VAE + DiT), robust tekstur-/PBR-estimering og UV-fullføring, produserer systemet ressurser som er både fotorealistiske og umiddelbart nyttige i fysikksimulatorer – en kombinasjon som adresserer en vedvarende flaskehals for forskning på kroppsliggjort AI og mange anvendte pipelines. Modellens rapporterte SOTA-ytelse (geometri og tekstur) og positive resultater fra menneskelig evaluering gjør den til en sterk aktør i det raskt utviklende 3D-generative landskapet.

Komme i gang

CometAPI er en enhetlig API-plattform som samler over 500 AI-modeller fra ledende leverandører – som OpenAIs GPT-serie, Googles Gemini, Anthropics Claude, Midjourney, Suno og flere – i ett enkelt, utviklervennlig grensesnitt. Ved å tilby konsistent autentisering, forespørselsformatering og svarhåndtering, forenkler CometAPI dramatisk integreringen av AI-funksjoner i applikasjonene dine. Enten du bygger chatboter, bildegeneratorer, musikkomponister eller datadrevne analysepipeliner, lar CometAPI deg iterere raskere, kontrollere kostnader og forbli leverandøruavhengig – alt samtidig som du utnytter de nyeste gjennombruddene på tvers av AI-økosystemet.

Utviklere kan få tilgang til 3D-modeller og andre ByteDance-modeller, for eksempel Seedream 4.0 API gjennom Comet API, den nyeste modellversjonen er alltid oppdatert med den offisielle nettsiden. For å begynne, utforsk modellens muligheter i lekeplass og konsulter API-veiledning for detaljerte instruksjoner. Før du får tilgang, må du sørge for at du har logget inn på CometAPI og fått API-nøkkelen. CometAPI tilby en pris som er langt lavere enn den offisielle prisen for å hjelpe deg med å integrere.

Klar til å dra? → Registrer deg for CometAPI i dag !

Hvis du vil vite flere tips, guider og nyheter om AI, følg oss på VK, X og Discord!