I slutten av august 2025 lanserte Google (DeepMind) Gemini 2.5 Flash-bilde – mye kalt «nano-banan» – en modell for generering og redigering av bilder med lav latens og høy kvalitet, integrert i Gemini-appen, Google AI Studio, Gemini API og CometAPI. Den er utviklet for å produsere fotorealistiske bilder, bevare tegnkonsistens på tvers av redigeringer, slå sammen flere inndatabilder og utføre fine, lokaliserte redigeringer gjennom ledetekster i naturlig språk. Modellen er tilgjengelig i forhåndsvisning / tidlig GA og topper allerede bildeledertavlene (LMArena), samtidig som den leveres med sikkerhetsmekanismer (SynthID-vannmerking og filtre på produktnivå).

Hva er Gemini 2.5 Flash Image (også kjent som «Nano Banana»)?

Gemini 2.5 Flash Image – lekent kallenavn Nano-banan — er Google DeepMinds nyeste modell for bildegenerering og redigering i Gemini-familien. Modellen ble annonsert sent i august 2025 og er posisjonert som en forhåndsvisningsversjon som bringer redigeringer med høyere kvalitet, flerbildefusjon, bedre karakterkonsistens (slik at samme person/kjæledyr/objekt blir gjenkjennelig på tvers av flere redigeringer) og bildegenerering med lav latens inn i Geminis multimodale verktøysett. Den er tilgjengelig via Gemini API, Google AI Studio, Gemini mobil-/nettapper og Vertex AI for bedriftskunder.

Opprinnelse og navngivning

Kallenavnet «nano banan» ble en viral forkortelse på sosiale medier og ledertavler i fellesskapet etter at tidlige testere og LMArena-bidrag brukte en frukt-tema-etikett. Google bekreftet forbindelsen og omfavnet det lekne håndtaket offentlig i sine utvikler- og produktinnlegg. Det offisielle produktnavnet er Gemini 2.5 Flash-bilde og du vil vanligvis se modellidentifikatoren som brukes i kode og API-kall (for forhåndsvisning vises den som f.eks. gemini-2.5-flash-image-preview).

Hva er hovedfunksjonene til Gemini 2.5 Flash Image?

Hva betyr egentlig «karakterkonsistens»?

En av de viktigste egenskapene er karakterkonsistensDu kan be modellen om å gjenbruke det samme motivet (en person, et kjæledyr, en maskot eller et produkt) på tvers av mange redigeringer eller nye scener, samtidig som identifiserende visuelle trekk (ansikt/form, fargepalett, kjennetegn) bevares. Dette adresserer en vanlig svakhet i tidligere bildemodeller der påfølgende redigeringer ville produsere visuelt troverdige, men merkbart forskjellige personer/objekter. Utviklere kan derfor bygge arbeidsflyter for produktkataloger, episodisk historiefortelling eller generering av merkevareressurser med mindre manuell korrigering.

Hvilke andre redigeringskontroller er inkludert?

Gemini 2.5 Flash Image støtter:

- Målrettede lokale redigeringer via enkle instruksjoner (fjerne et objekt, bytte antrekk, retusjere hud, fjerne bakgrunnselement).

- Flerbildefusjon: kombinere opptil tre inndatabilder til én sammenhengende komposisjon (f.eks. plassere et produkt fra bilde A i scene B samtidig som lyset bevares).

- Stil- og formatkontrollerfotorealistiske instruksjoner, kamera- og objektivattributter, sideforhold og stiliserte utganger (illustrasjon, klistremerke osv.).

- Kunnskap om den innfødte verdenModellen utnytter den bredere Gemini-familiens kunnskap til å gjøre semantisk bevisste redigeringer (f.eks. forstå hva «renessansebelysning» eller «Tokyo-fotgjengerovergang» innebærer).

Hva med hastighet, kostnad og tilgjengelighet?

Gemini 2.5 Flash Image er en del av Flash-nivået til Gemini 2.5 – optimalisert for lav latens og kostnad, samtidig som den opprettholder god kvalitet. Google har forhåndsvist priser for bildeutdatatokener og oppgitt tilgjengelighet via API og AI Studio. Bedriftskunder kan få tilgang til det via Vertex AI. Ved kunngjøringen var den publiserte prisen for Gemini 2.5 Flash Image-nivået 30 dollar per 1 million utdatatokener, med et eksempel på kostnad per bilde rapportert som 1290 utdatatokener ≈ $0.039 per bilde.

Hvordan fungerer Gemini 2.5 Flash Image under panseret?

Arkitektur og opplæringstilnærming

Gemini 2.5 Flash Image arver arkitekturen fra Gemini 2.5-familien: en sparsom blanding av eksperter (MoE) med multimodal trening som kombinerer tekst, bilde, lyd og andre data. Google trente Flash Image på svært store, filtrerte multimodale korpus og finjusterte modellen for bildeoppgaver (generering, redigering, fusjon) og sikkerhetsatferd. Treningen ble kjørt på Googles TPU-struktur og evaluert med både automatiske og menneskelige vurderingsmålinger.

Samtaledrevet redigering

På et overordnet nivå bruker modellen kontekstuell betinging: når du oppgir et bilde (eller flere bilder) pluss tekstmeldinger, koder modellen motivets visuelle identitet inn i sin interne representasjon. Under påfølgende redigeringer eller nye scener betinges genereringen av den representasjonen slik at ønskede visuelle attributter (ansiktsgeometri, viktige kles- eller produktidentifikatorer, fargepaletter) bevares. I praksis implementeres dette som en del av den multimodale innholdsprosessen som eksponeres av Gemini API: du sender referansebildene sammen med redigeringsinstruksjoner, og modellen returnerer redigerte bildeutganger (eller flere kandidatbilder) i ett svar.

Vannmerking og proveniens

Google integrerer sikkerhets- og innholdspolicyfiltre i Gemini 2.5 Flash Image. Versjonen legger vekt på evaluering og red-teaming, automatiserte filtreringstrinn, overvåket finjustering og forsterkende læring for å følge instruksjoner, samtidig som skadelige resultater minimeres. Resultatene inkluderer et usynlig SynthID-vannmerke, slik at bilder produsert eller redigert av modellen senere kan identifiseres som AI-genererte.

Hvor bra presterer den? (Referansedata)

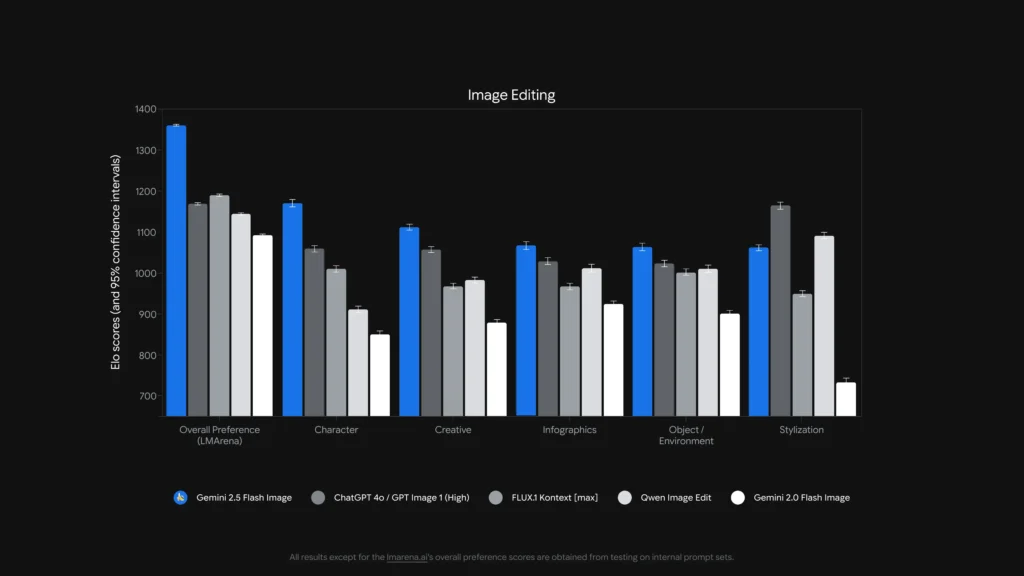

Gemini 2.5 Flash Image (markedsført som «nano-banan» i noen benchmarking-sammenhenger) nådde Nummer 1 på LMArenas ledertavler for bilderedigering og tekst-til-bilde per slutten av august 2025, med store Elo/preferanseledere over konkurrentene i de rapporterte sammenligningene. Jeg refererer til resultater fra menneskelige evalueringer av LMArena og GenAI-Bench som viser topp preferansepoeng for både tekst-til-bilde og bilderedigeringsoppgaver.

Tekst-til-bilde-sammenligning

| Evneverdi-benchmark | Gemini Flash 2.5-bilde | Imagen 4 Ultra 06-06 | ChatGPT 4o / GPT-bilde 1 (høyt) | FLUX.1 Kontekst | Gemini Flash 2.0-bilde |

|---|---|---|---|---|---|

| Totalpreferanse (LMArena) | 1147 | 1135 | 1129 | 1075 | 988 |

| Visuell kvalitet (GenAI-Bench) | 1103 | 1094 | 1013 | 864 | 926 |

| Tekst-til-bilde-justering (GenAI-Bench) | 1042 | 1053 | 1046 | 937 | 922 |

Bilderedigering

| Evneverdi-benchmark | Gemini Flash 2.5-bilde | ChatGPT 4o / GPT-bilde 1 (høyt) | FLUX.1 Kontekst | Qwen-bilderedigering | Gemini Flash 2.0-bilde |

|---|---|---|---|---|---|

| Totalpreferanse (LMArena) | 1362 | 1170 | 1191 | 1145 | 1093 |

| Character | 1170 | 1059 | 1010 | 911 | 850 |

| Kreativ | 1112 | 1057 | 968 | 983 | 879 |

| Infografikk | 1067 | 1029 | 967 | 1012 | 925 |

| Objekt / Miljø | 1064 | 1023 | 1002 | 1010 | 901 |

| Produktrekontekstualisering | 1128 | 1032 | 943 | 1009 | 888 |

| Stilisering | 1062 | 1165 | 949 | 1091 | 733 |

Hva betyr disse referansepunktene i praksis?

Referanseverdier forteller oss to ting: (1) modellen er konkurransedyktig ved fotorealistisk generering og (2) den skiller seg ut i redigering oppgaver der karakterkonsistens og rask overholdelse er viktig. Rangeringer av menneskelige preferanser indikerer at brukere som ser på resultatene, vurderte Gemini-resultatene høyt for realisme og samsvar med instruksjoner i mange evaluerte instruksjoner. Imidlertid er det eksplisitt om kjente begrensninger (hallusinasjonsrisiko på fine faktadetaljer, gjengivelse av lang tekst i bilder, tilfeller av stiloverføringskanter) – så referansetester er en veiledning, ikke en garanti.

Hva kan du gjøre med Gemini 2.5 Flash Image (brukstilfeller)?

Gemini 2.5 Flash Image er eksplisitt bygget for kreative, produktivitets- og anvendte bildebehandlingsscenarier. Typiske og nye bruksområder inkluderer:

Raske produktmodeller og e-handel

Dra produktbilder inn i scener, generer konsistente katalogbilder på tvers av miljøer, eller bytt farger/stoffer på tvers av en produktlinje – alt mens du bevarer produktets identitet. Funksjonene for flerbildefusjon og konsistensen av karakter/produkt gjør det attraktivt for katalogarbeidsflyter.

Fotoretusjering og målrettede redigeringer

Fjern gjenstander, fiks flekker, bytt klær/tilbehør eller juster belysning med instruksjoner i naturlig språk. Den lokaliserte redigeringsfunksjonen lar ikke-eksperter utføre profesjonell retusjering ved hjelp av samtalekommandoer.

Storyboarding og visuell historiefortelling

Plasser den samme karakteren på tvers av forskjellige scener og hold utseendet konsistent (nyttig for tegneserier, storyboards eller pitchdecks). Iterative redigeringer lar skapere finpusse stemning, innramming og narrativ kontinuitet uten å bygge opp ressurser fra bunnen av.

Utdanning, diagrammer og designprototyping

Fordi den kan kombinere tekstmeldinger og bilder og har «verdenskunnskap», kan modellen bidra til å generere kommenterte diagrammer, pedagogiske visuelle elementer eller raske mockups for presentasjoner. Google fremhever til og med maler i AI Studio for brukstilfeller som eiendomsmodeller og produktdesign.

Hvordan bruker du Nano Banana API?

Nedenfor er praktiske utdrag tilpasset fra CometAPI API-dokumentasjon og Googles API-dokumentasjon. De demonstrerer de vanlige flytene: tekst-til-bilde og bilde + tekst til bilde (redigering) ved hjelp av det offisielle GenAI SDK-et eller REST-endepunktet.

Merk: I CometAPIs dokumentasjon vises navnet på forhåndsvisningsmodellen som

gemini-2.5-flash-image-previewEksemplene nedenfor gjenspeiler de offisielle SDK-eksemplene (Python og JavaScript) og et REST curl-eksempel; tilpass nøkler og filstier til miljøet ditt.

REST-krølleksempel fra CometAPI

Bruk Gemini sin offisielle generateContent endepunkt for generering av tekst til bilde. Plasser tekstprompten i contents.parts[].text.Eksempel (Windows-skall, ved bruk av ^ for linjefortsettelse):

curl --location --request POST "https://api.cometapi.com/v1beta/models/gemini-2.5-flash-image-preview:generateContent" ^

--header "Authorization: sk-xxxx" ^

--header "User-Agent: Apifox/1.0.0 (https://apifox.com)" ^

--header "Content-Type: application/json" ^

--header "Accept: */*" ^

--header "Host: api.cometapi.com" ^

--header "Connection: keep-alive" ^

--data-raw "{ "contents": [{

"parts": [

{"text": "A photorealistic macro shot of a nano-banana on a silver fork, shallow depth of field"}

]

}]

}'}"

| grep -o '"data": "*"' \

| cut -d'"' -f4 \

| base64 --decode > gemini-generated.png

Svaret inneholder base64 bildebyte; pipelinen ovenfor trekker ut "data" streng og dekoder den til gemini-generated.png.

Dette endepunktet støtter generering av «bilde-til-bilde»: last opp et inndatabilde (som Base64) og motta et modifisert nytt bilde (også i Base64-format).Eksempel:

curl --location --request POST "https://api.cometapi.com/v1beta/models/gemini-2.5-flash-image-preview:generateContent" ^

--header "Authorization: sk-xxxx" ^

--header "User-Agent: Apifox/1.0.0 (https://apifox.com)" ^

--header "Content-Type: application/json" ^

--header "Accept: */*" ^

--header "Host: api.cometapi.com" ^

--header "Connection: keep-alive" ^

--data-raw "{ \"contents\": } ], \"generationConfig\": { \"responseModalities\": }}"

**Beskrivelse:**Først konverterer du kildebildefilen til en Base64-streng og plasserer den i inline_data.dataIkke bruk prefikser som data:image/jpeg;base64,Utgangen er også plassert i candidates.content.parts og inkluderer: En valgfri tekstdel (beskrivelse eller ledetekst). Bildedelen som inline_data (hvor data er Base64 for utdatabildet). For flere bilder kan du legge dem til direkte, for eksempel:

{

"inline_data": {

"mime_type": "image/jpeg",

"data": "iVBORw0KGgo...",

"data": "iVBORw0KGgo..."

}

}

Nedenfor finner du eksempler fra utviklere tilpasset fra Googles offisielle dokumenter og blogg. Erstatt legitimasjon og filstier med dine egne.

Python (offisiell SDK-stil)

from google import genai

from PIL import Image

from io import BytesIO

client = genai.Client()

prompt = "Create a picture of a nano banana dish in a fancy restaurant with a Gemini theme"

# Text-to-Image

response = client.models.generate_content(

model="gemini-2.5-flash-image-preview",

contents=,

)

for part in response.candidates.content.parts:

if part.text is not None:

print(part.text)

elif part.inline_data is not None:

image = Image.open(BytesIO(part.inline_data.data))

image.save("generated_image.png")

Dette er det kanoniske Python-utdraget fra Googles dokumenter (forhåndsvisningsmodell-ID vist). Det samme SDK-kallmønsteret støtter redigering av bilder + prompt (send et bilde som en av contents).Mer informasjon se Gemini-dokteren.

Konklusjon

Hvis produktet ditt trenger robust bildegenerering med lav latens, og spesielt pålitelig redigering med konsistens i emnetGemini 2.5 Flash Image er nå et alternativ i produksjonsklassen som er verdt å evaluere: det kombinerer toppmoderne bildekvalitet med API-er designet for utviklerintegrasjon (AI Studio, Gemini API og Vertex AI). Vurder modellens nåværende begrensninger nøye (fintekst i bilder, noen stiliseringstilfeller i kantene) og implementer sikkerhetstiltak for ansvarlig bruk.

Komme i gang

CometAPI er en enhetlig API-plattform som samler over 500 AI-modeller fra ledende leverandører – som OpenAIs GPT-serie, Googles Gemini, Anthropics Claude, Midjourney, Suno og flere – i ett enkelt, utviklervennlig grensesnitt. Ved å tilby konsistent autentisering, forespørselsformatering og svarhåndtering, forenkler CometAPI dramatisk integreringen av AI-funksjoner i applikasjonene dine. Enten du bygger chatboter, bildegeneratorer, musikkomponister eller datadrevne analysepipeliner, lar CometAPI deg iterere raskere, kontrollere kostnader og forbli leverandøruavhengig – alt samtidig som du utnytter de nyeste gjennombruddene på tvers av AI-økosystemet.

Utviklere har tilgang Gemini 2.5 Flash-bilde(Nano Banana Comet API-liste gemini-2.5-flash-image-preview/gemini-2.5-flash-image stiloppføringer i katalogen deres.) gjennom CometAPI, er de nyeste modellversjonene som er oppført per artikkelens publiseringsdato. For å begynne, utforsk modellens muligheter i lekeplass og konsulter API-veiledning for detaljerte instruksjoner. Før du får tilgang, må du sørge for at du har logget inn på CometAPI og fått API-nøkkelen. CometAPI tilby en pris som er langt lavere enn den offisielle prisen for å hjelpe deg med å integrere.