Google DeepMind lanserte offisielt Gemma 4 2. april 2026, og markerte en viktig milepæl innen åpen kildekode-AI. Denne modellfamilien leverer toppnivå intelligens per parameter, bygget på den samme forskningen og teknologien som driver Gemini 3. I motsetning til tidligere Gemma-versjoner med egendefinerte lisenser, leveres Gemma 4 under en fullt tillatende Apache 2.0-lisens, som muliggjør ubegrenset kommersiell bruk, modifikasjon og redistribusjon.

Gemma 4 skiller seg ut med sine multimodale evner (tekst + bildeinput på tvers av alle størrelser, samt lyd på edge-modellene), innebygd støtte for avansert resonnering og agentiske arbeidsflyter, lange kontekstvinduer på opptil 256K tokens, og optimalisering for alt fra smarttelefoner og Raspberry Pi til high-end GPU-er. Den støtter over 140 språk og vektlegger effektivitet, noe som gjør kraftig AI tilgjengelig på forbruker- og edge-maskinvare uten avhengighet av skyen.

CometAPI tilbyr fremragende API-er for både åpne og lukkede modeller.

Hva er Gemma 4?

Gemma 4 er Google DeepMinds nyeste familie av åpne, multimodale store språkmodeller (LLM-er), spesialbygd for avansert resonnering, agentiske AI-arbeidsflyter og effektiv lokal kjøring på enheter. Den maksimerer “intelligens-per-parameter” ved å utnytte innsikter fra proprietær Gemini 3-forskning, samtidig som den forblir fullt åpen med åpne vekter og åpen kildekode.

Viktige fremskritt sammenlignet med tidligere Gemma-modeller inkluderer:

- Innebygd multimodalitet: Tekst + bildeforståelse (alle modeller), med lydstøtte på mindre edge-varianter.

- Konfigurerbar tenkemodus: Trinnvis resonnering med strukturert <|think|>-utdata.

- Innebygd funksjonskalling og verktøybruk: Ideelt for autonome agenter.

- Utvidet kontekst: Opptil 256K tokens på større modeller.

- Hybrid oppmerksomhetsarkitektur: Kombinerer lokal skyvevindu- og global oppmerksomhet for effektivitet og langkontekstytelse.

- Per-Layer Embeddings (PLE) i mindre modeller og delt KV-cache for minnebesparelser.

- Bred flerspråklig støtte: Forhåndstrent på data som dekker 140+ språk med bevissthet om kulturelle nyanser.

Utgitt under Apache 2.0, fjerner Gemma 4 tidligere lisensbegrensninger som hemmet bedriftsadopsjon. Utviklere kan nå finjustere, distribuere og kommersialisere uten friksjon—og posisjonerer den som en direkte konkurrent til fullt åpne økosystemer som Llama og Qwen.

Gemma 4 retter seg mot variert maskinvare: edge-enheter (telefoner, IoT, Raspberry Pi, Jetson Nano) for lavlatens offline-AI, og arbeidsstasjoner/GPU-er for høyytelses lokale servere. Denne «lokal-først»-designen prioriterer personvern, kostnadsbesparelser og null-latens inferens.

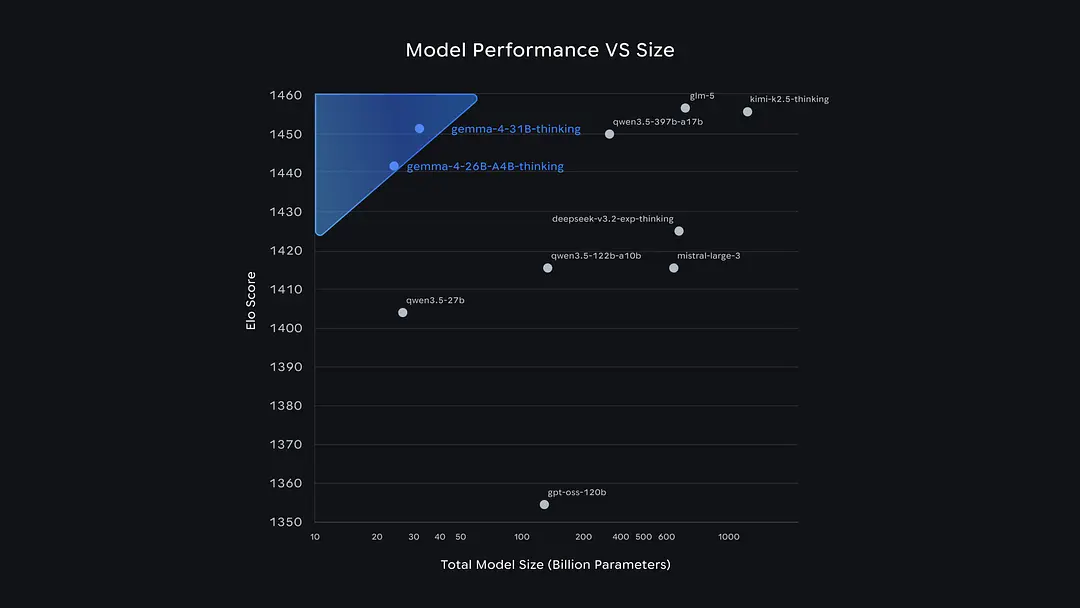

De åpne modellene som rangerer foran den på Arena-ledertavlen, er hovedsakelig fra kinesiske team. Gemma 4 er ikke så ulik Qwen 3.5 og GLM-5, men den er betydelig forskjellig fra OpenAIs GPT-OSS-120B.

Utviklere kan nå finne GLM-5, Qwen 3.5, osv. på CometAPI.

De fire versjonene av Gemma 4

Google lanserte Gemma 4 i fire nøye optimaliserte størrelser, hver med en balanse mellom ytelse, effektivitet og distribusjonsscenarier. To bruker tette arkitekturer med innovative Per-Layer Embeddings (PLE) for edge-effektivitet; én er en Mixture-of-Experts (MoE) for høy ytelse til lav aktiv-parameterkost; og én er en tett flaggskipmodell.

| Modell | Arkitektur | Totale parametre | Aktive parametre (MoE) | Effektive parametre | Kontekstlengde | Modaliteter | Målmaskinvare |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | Dense + PLE | ~5.1B (inkl. embeddings) | N/A | 2.3B | 128K | Tekst, bilde, lyd | Smarttelefoner, Raspberry Pi, edge-IoT |

| Gemma 4 E4B | Dense + PLE | ~8B (inkl. embeddings) | N/A | 4.5B | 128K | Tekst, bilde, lyd | Mobile enheter, lettvekts GPU-er, Jetson |

| Gemma 4 26B A4B | MoE (8 aktive / 128 totale + 1 delt) | 25.2B | 3.8B–4B | N/A | 256K | Tekst, bilde | Arbeidsstasjoner, forbruker-GPU-er, lokale servere |

| Gemma 4 31B | Dense | 30.7B | N/A | N/A | 256K | Tekst, bilde | High-end GPU-er (får plass på én H100/A100 i FP16) |

Gemma 4 E2B og E4B (edge-optimaliserte): Bruker PLE for å legge til per-lags spesialisering med minimal parameterkost. Ideelle for batteridrevne eller minnebegrensede enheter. Lydkoder (USM-stil Conformer, ~300M parametere) muliggjør tale-til-tekst og oversettelse.

Gemma 4 26B A4B (MoE): Aktiverer kun ~4B parametere under inferens til tross for 25B+ total størrelse. Leverer nær 31B-ytelse til dramatisk lavere beregningskost—perfekt for kostnadseffektiv skalering.

Gemma 4 31B (Dense): Flaggskipet for maksimal kapasitet. Får plass på én 80GB GPU i full presisjon og rangerer blant de beste åpne modellene på topplistene.

Alle modellene inkluderer instruksjonstilpassede (“-it”) varianter optimalisert for chat, resonnering og verktøybruk, samt forhåndstrente basisversjoner for finjustering. De to store modellene går ulike veier: 31B Dense-modellen jakter høyeste kvalitet og er det beste fundamentet for finjustering; 26B MoE-modellen prioriterer hastighet ved å aktivere kun 3.8 milliarder parametere under inferens, noe som gir mye raskere ordgenerering, men med litt lavere total kvalitet.

De to mindre modellene, E2B og E4B, er spesifikt designet for mobiltelefoner og IoT-enheter: de kan kjøre helt offline og spare både minne og strøm. Dessuten har disse mindre modellene en kapasitet som de større mangler: innebygd lydinput som muliggjør direkte talegjenkjenning.

Kjernekapabiliteter i Gemma 4

Gemma 4 utmerker seg på områder som er avgjørende for virkelige AI-applikasjoner:

1. Avansert resonnering og tenkemodus

Konfigurerbar trinnvis resonnering via systemprompter eller enable_thinking=True. Gir strukturert <|think|>-tagget utdata etterfulgt av endelige svar. Forbedrer ytelsen betydelig på komplekse oppgaver uten ekstra finjustering.

2. Multimodal forståelse

- Visjon: Objektgjenkjenning (JSON-avgrensningsbokser), OCR (flerspråklig), dokument/PDF-parsing, diagramforståelse, UI-forståelse, håndskriftgjenkjenning og variabel oppløsning av bilder (token-budsjetter: 70–1120 tokens).

- Video: Opptil 60 sekunder (1 fps rammeprosessering).

- Lyd (kun E2B/E4B): Automatisk talegjenkjenning (ASR) og tale-til-tekst-oversettelse (maks 30 s).

- Interleavede innspill: Bland tekst, bilder og lyd i vilkårlig rekkefølge.

3. Agentiske arbeidsflyter og funksjonskalling

Innebygd verktøystøtte muliggjør autonome agenter for flerstegs planlegging, API-kall, app-navigasjon og oppgavefullføring. Sterk på τ2-bench (agentisk verktøybruk).

4. Koding og utviklerverktøy

Enestående kodegenerering, -fullføring, -feilsøking og forståelse på repositorienivå. Støtter JSON-strukturert utdata for sømløs integrasjon. Oppnår 80.0% (31B) på LiveCodeBench v6, og posisjonerer seg som en lokal-først AI-programmeringsassistent egnet for offline utviklingsscenarioer.

5. Lang kontekst og flerspråklig

Håndterer 128K–256K tokens pålitelig (testet på MRCR needle-in-haystack). Forhåndstrent på mangfoldige data opp til kunnskapsstopp januar 2025, med sterk tverrspråklig ytelse. Dette er ikke bare flerspråklig oversettelse; den er nativt trent og dekker over 140 språk.

Benchmark-data: Gemma 4-ytelsesfordeling

Gemma 4 setter nye standarder for åpne modeller. 31B- og 26B-variantene leverer resultater som tidligere var forbeholdt langt større proprietære systemer, mens edge-modellene overgår Gemma 3 sin større forgjenger.

Fullstendige benchmark-resultater (instruksjonstilpassede modeller)

| Benchmark | Kategori | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (no think) |

|---|---|---|---|---|---|---|

| MMLU Pro | Resonnering og kunnskap | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (no tools) | Matematikk | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | Vitenskap på masternivå | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (avg) | Agentisk verktøybruk | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | Koding | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | Konkurransekoding | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | Multimodal resonnering | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | Matematikk + visjon | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8-needle, 128K) | Lang kontekst | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

Nøkkelinnsikter:

- Massivt hopp fra Gemma 3: 31B-modellen forbedrer AIME-matte fra 20.8% til 89.2% og LiveCodeBench fra 29.1% til 80.0%.

- MoE-effektivitet: 26B A4B matcher nesten 31B, samtidig som den bruker langt mindre beregning under inferens.

- Edge-dominans: E4B og E2B overgår Gemma 3 27B på mange målinger til tross for at de er 6–10x mindre.

- Topplisterangeringer: 31B scorer ~1452 på Arena AI (tekst); 26B A4B ~1441. 26B-varianten rapporteres å overgå langt større modeller som Qwen 3.5 397B i brukerpreferanse og koding.

Visjons- og lydbenchmarker bekrefter sterk multimodal ytelse ut av boksen uten spesialisert finjustering.

Økosystem- og verktøystøtte

Gemma 4 nyter umiddelbar, bred økosystemintegrasjon:

- Hugging Face: Støtte fra dag én med

transformers,pipeline("any-to-any"), GGUF, ONNX og multimodale prosessorer. - Lokale kjøremiljøer: Ollama, Llama.cpp (LM Studio, Jan), MLX (Apple Silicon med TurboQuant), Mistral.rs (Rust), Transformers.js (WebGPU-nettleserinferens).

- Finjustering: TRL, Unsloth, PEFT, Vertex AI og full støtte for multimodale datasett.

- Maskinvareoptimalisering: NVIDIA RTX/DGX Spark/Jetson (via TensorRT-LLM), Google AI Edge-verktøy og Android/iOS on-device-distribusjon.

- Agent-rammeverk: OpenClaw, Hermes, Pi og CARLA-simuleringstesting.

- Sky/Studio: Google AI Studio for rask testing; Kaggle Models for nedlasting.

Dette økosystemet gjør at Gemma 4 kan distribueres på minutter på bærbare PC-er, servere eller edge-enheter.

Begrensninger og sikkerhet:

- Treningsdata-kutt: januar 2025 (ingen sanntidskunnskap uten verktøy).

- Lyd begrenset til tale (ikke musikk); video begrenset til 60 s.

- Hallusinasjonsrisiko består—bruk tenkemodus og verifisering.

- Sikkerhet: Streng filtrering og evaluering i tråd med Google AI-prinsippene; utviklere bør legge til applikasjonsspesifikke sikringer.

Hvorfor Gemma 4 betyr noe i 2026

Gemma 4 demokratiserer frontlinje-AI. Ved å kombinere multimodal intelligens, agentiske kapabiliteter og Apache 2.0-frihet med maskinvareagnostisk effektivitet, gir den utviklere og virksomheter mulighet til å bygge sikre, private og kostnadseffektive AI-løsninger i skala. Gjennombruddet i intelligens-per-parameter—særlig tydelig i edge-modellene som overgår gårsdagens flaggskip-åpne modeller—varsler et skifte mot virkelig allestedsnærværende AI.

Enten du kjører en 2B-modell på en telefon eller en 31B-kraftpakke lokalt, viser Gemma 4 at åpen kildekode-AI har tatt igjen (og i mange tilfeller overgått) lukkede alternativer i praktisk nytte.