GPT 5.1 API er det GPT-5.1 Thinking er den avanserte resonneringsvarianten av OpenAIs GPT-5.1-familie. Den prioriterer adaptiv resonnering av høyere kvalitet, samtidig som den gir utviklere eksplisitt kontroll over avveiningen mellom latens og beregning.

Grunnleggende funksjoner

- Adaptiv resonneringModellen justerer dynamisk tankedybden per forespørsel – raskere på rutineoppgaver, mer vedvarende på komplekse. Dette reduserer ventetid og tokenbruk for vanlige spørringer. Den tildeler eksplisitt mer resonneringstid for komplekse spørsmål, og er mer vedvarende på problemer med flere trinn; kan være tregere for vanskelige oppgaver, men gir dypere svar.

- Resonneringsmåter:

none/low/medium/high(GPT-5.1 er som standard satt tilnonefor tilfeller med lav latens; velg høyere nivåer for mer krevende oppgaver). Responses API eksponerer enreasoningparameter for å kontrollere dette. - Standard tone og stil: skrevet for å være tydeligere om komplekse emner (mindre sjargong), mer forklarende og «tålmodig».

- Kontekstvindu (tokens / lang kontekst) Tenkning: mye større — 400K tokenkontekst for betalte nivåer.

Viktige tekniske detaljer

- Adaptiv beregningsallokering — Trenings- og inferensdesign fører til at modellen bruker færre resonnementstokener på trivielle oppgaver og proporsjonalt mer på vanskelige oppgaver. Dette er ikke en separat «tenkemotor», men en dynamisk allokering innenfor resonnementsprosessen.

- Resonnementparameter i Responses API — klienter passerer en

reasoningobjekt (for eksempelreasoning: { "effort": "high" }) å be om dypere intern resonnement; innstillingreasoning: { "effort": "none" }deaktiverer effektivt den utvidede interne resonneringspasningen for lavere latens. Responses API returnerer også resonnerings-/token-metadata (nyttig for kostnader og feilsøking). - Verktøy og parallelle verktøykall — GPT-5.1 forbedrer parallell verktøykalling og inkluderer navngitte verktøy (som

apply_patch) som reduserer feilmoduser for programmatiske redigeringer; parallellisering øker ende-til-ende-gjennomstrømningen for verktøytunge arbeidsflyter. - Spør hurtigbuffer og utholdenhet -

prompt_cache_retention='24h'støttes på endepunkter for svar og chatfullføringer for å beholde kontekst på tvers av flertursøkter (reduserer gjentatt tokenkoding).

Benchmark ytelse

Eksempler på latens/tokeneffektivitet (levert av leverandør): På rutinespørringer rapporterer OpenAI dramatiske reduksjoner i tokener/tid (eksempel: en npm-listekommando som tok ~10s / ~250 tokener på GPT-5 tar nå ~2s / ~50 tokener på GPT-5.1 i sin representative test). Tredjeparts tidlige testere (f.eks. kapitalforvaltere, kodefirmaer) rapporterte 2–3 ganger hastighetsøkninger på mange oppgaver og tokeneffektivitetsgevinster i verktøytunge flyter.

OpenAI og tidlige partnere publiserte representative referanseindekser og målte forbedringer:

| Evaluering | GPT-5.1 (høy) | GPT-5 (høy) |

| SWE-benk Verifisert (alle 500 oppgavene) | 76.3% | 72.8% |

| GPQA diamant (ingen verktøy) | 88.1% | 85.7% |

| TID 2025 (ingen verktøy) | 94.0% | 94.6% |

| FrontierMath (med Python-verktøyet) | 26.7% | 26.3% |

| MMMU | 85.4% | 84.2% |

| Tau2-benk flyselskap | 67.0% | 62.6% |

| Tau2-benk Telecom* | 95.6% | 96.7% |

| Tau2-benk Detaljhandel | 77.9% | 81.1% |

| BrowseComp Lang kontekst 128k | 90.0% | 90.0% |

Begrensninger og sikkerhetshensyn

- Risikoen for hallusinasjoner vedvarer. Adaptiv resonnering hjelper med komplekse problemer, men eliminerer ikke hallusinasjoner; høyere

reasoning_effortforbedrer kontrollene, men garanterer ikke at de er korrekte. Valider alltid resultater med høy innsats. - Avveininger mellom ressurser og kostnader: Selv om GPT-5.1 kan være langt mer token-effektiv på enkle flyter, kan det å muliggjøre høy resonneringsinnsats eller langvarig bruk av agentverktøy øke tokenforbruket og latensen. Bruk rask mellomlagring for å redusere gjentatte kostnader der det er passende.

- Verktøysikkerhet:

apply_patchogshellVerktøy øker automatiseringskraften (og risikoen). Produksjonsdistribusjoner bør kontrollere verktøykjøring (gjennomgå differanser/kommandoer før utførelse), bruke færrest rettigheter og sikre robuste CI/CD- og driftsrekkverk.

Sammenligning med andre modeller

- mot GPT-5GPT-5.1 forbedrer adaptiv resonnering og instruksjonsfølelse; OpenAI rapporterer raskere responstider på enkle oppgaver og bedre utholdenhet på vanskelige oppgaver. GPT-5.1 legger også til

noneresonneringsalternativ og utvidet hurtiglagring av prompter. - mot GPT-4.x / 4.1GPT-5.1 er utviklet for mer agentbaserte, verktøytunge og kodende oppgaver; OpenAI og partnere rapporterer forbedringer innen kodebenchmarks og flertrinnsresonnement. For mange standard samtaleoppgaver kan GPT-5.1 Instant være sammenlignbar med tidligere GPT-4.x chatmodeller, men med forbedret styrbarhet og forhåndsinnstillinger for personligheter.

- vs Antropisk / Claude / andre LLM-erChatGPT 5.1s MoA-arkitektur gir den et tydelig fortrinn i oppgaver som krever kompleks, flertrinns resonnering. Den scoret enestående 98.20 på HELM-referanseindeksen for kompleks resonnering, sammenlignet med Claude 4s 95.60 og Gemini 2.0 Ultras 94.80.

Typiske brukstilfeller

- Agentiske kodeassistenter / PR-anmeldelser / kodegenerering — forbedret

apply_patchpålitelighet og bedre kodestyrbarhet. - Kompleks flertrinns resonnement — tekniske forklaringer, matematiske bevis, utkast til juridiske sammendrag der modellen må kjede trinn og kontrollere arbeidet.

- Automatiserte agenter med verktøybruk — arbeidsflyter for kunnskapsinnhenting + verktøykall (database / søk / skall), der parallelle verktøykall og mer vedvarende resonnement øker gjennomstrømning og robusthet.

- Kundesupportautomatisering for komplekse saker — der det er behov for trinnvis diagnose og bevisinnsamling over flere omganger, og modellen kan balansere hastighet og innsats.

Slik kaller du GPT-5.1 API fra CometAPI

gpt-5.1 API-priser i CometAPI, 20 % rabatt på den offisielle prisen:

| Skriv inn tokens | $1.00 |

| Output tokens | $8.00 |

Nødvendige trinn

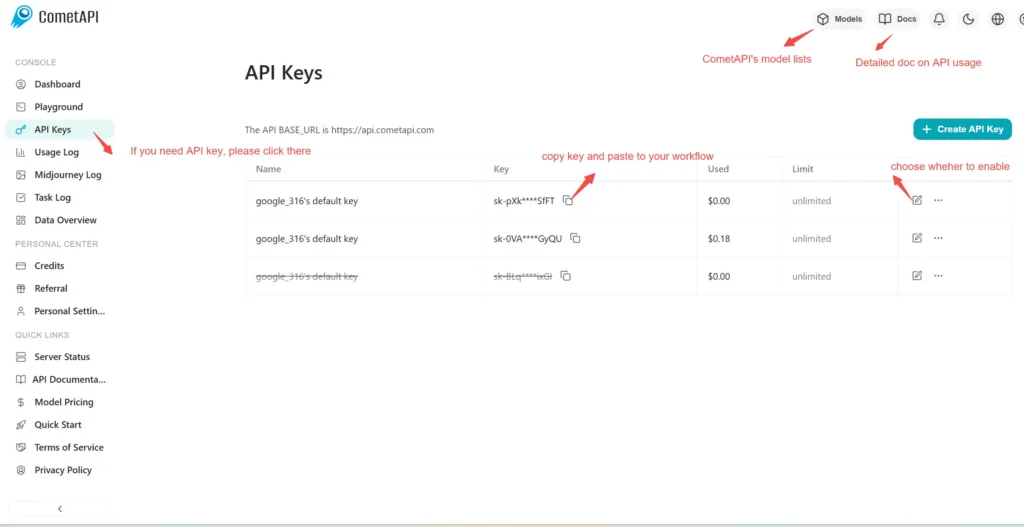

- Logg på cometapi.com. Hvis du ikke er vår bruker ennå, vennligst registrer deg først.

- Logg inn på din CometAPI-konsoll.

- Få tilgangslegitimasjons-API-nøkkelen til grensesnittet. Klikk "Legg til token" ved API-tokenet i det personlige senteret, hent tokennøkkelen: sk-xxxxx og send inn.

Bruk metoden

- Velg "

gpt-5.1” endepunkt for å sende API-forespørselen og angi forespørselsteksten. Forespørselsmetoden og forespørselsteksten er hentet fra vårt API-dokument for nettstedet vårt. Vårt nettsted gir også Apifox-test for din bekvemmelighet. - Erstatt med din faktiske CometAPI-nøkkel fra kontoen din.

- Sett inn spørsmålet eller forespørselen din i innholdsfeltet – det er dette modellen vil svare på.

- . Behandle API-svaret for å få det genererte svaret.

CometAPI tilbyr et fullt kompatibelt REST API – for sømløs migrering. Viktige detaljer for Chat og Svar:

- Grunnadresse: https://api.cometapi.com/v1/chat/completions / https://api.cometapi.com/v1/responses

- Modellnavn:

gpt-5.1 - Autentisering:

Bearer YOUR_CometAPI_API_KEYheader - Innholdstype:

application/json.