per 15. desember 2025 viser offentlige fakta at både Googles Gemini 3 Pro (forhåndsvisning) og OpenAIs GPT-5.2 setter nye grenser for resonnering, multimodalitet og arbeid med lang kontekst — men de tar ulike ingeniørmessige veier (Gemini → sparse MoE + enorm kontekst; GPT-5.2 → tette/“routing”-design, kompaktering og xhigh-resonneringsmodi) og bytter derfor mellom toppresultater på benchmarker vs. ingeniørmessig forutsigbarhet, verktøy og økosystem. Hvilken som er “best” avhenger av ditt primærbehov: ekstrem-kontekst, multimodale agentiske applikasjoner heller mot Gemini 3 Pro; stabile utviklerverktøy for virksomheter, forutsigbare kostnader og umiddelbar API-tilgjengelighet favoriserer GPT-5.2.

Hva er GPT-5.2 og hva er hovedfunksjonene?

GPT-5.2 er OpenAIs 11. desember 2025-utgivelse i GPT-5-familien (varianter: Instant, Thinking, Pro). Den er posisjonert som selskapets mest kapable modell for “profesjonelt kunnskapsarbeid” — optimalisert for regneark, presentasjoner, resonnering med lang kontekst, verktøykalling, kodegenerering og visjonsoppgaver. OpenAI gjorde GPT-5.2 tilgjengelig for betalende ChatGPT-brukere og via OpenAI API (Responses API / Chat Completions) under modellnavn som gpt-5.2, gpt-5.2-chat-latest og gpt-5.2-pro.

Modellvarianter og tiltenkt bruk

- gpt-5.2 / GPT-5.2 (Thinking) — best for kompleks, flertrinns resonnering (standardvarianten “Thinking” brukt i Responses API).

- gpt-5.2-chat-latest / Instant — lavere ventetid for daglig assistanse og chat-bruk.

- gpt-5.2-pro / Pro — høyest presisjon / pålitelighet for de vanskeligste problemene (ekstra compute, støtter

reasoning_effort: "xhigh").

Viktige tekniske funksjoner (brukervendte)

- Forbedringer i visjon og multimodalitet — bedre romlig resonnering på bilder og forbedret videoforståelse når den kombineres med kodeverktøy (Python-verktøy), samt støtte for verktøy i stil med kodeinterpreter for å kjøre snippets.

- Konfigurerbar resonneringsinnsats (

reasoning_effort: none|minimal|low|medium|high|xhigh) for å avveie latens/kostnad mot dybde.xhigher nytt for GPT-5.2 (og støttes på Pro). - Forbedret håndtering av lang kontekst og kompakteringsfunksjoner for å resonnere over hundretusener av tokens (OpenAI rapporterer sterke MRCRv2 / lang-kontekst-metrikker).

- Avansert verktøykalling og agentiske arbeidsflyter — sterkere fleromgangskoordinering, bedre orkestrering av verktøy over en “single mega-agent”-arkitektur (OpenAI fremhever Tau2-bench verktøyprestasjoner).

Hva er Gemini 3 Pro Preview?

Gemini 3 Pro Preview er Googles mest avanserte generative AI-modell, lansert som del av den bredere Gemini 3-familien i november 2025. Modellen er bygget med vekt på multimodal forståelse—i stand til å forstå og syntetisere tekst, bilder, video og lyd—og har et stort kontekstvindu (~1 million tokens) for håndtering av omfattende dokumenter eller kodebaser.

Google posisjonerer Gemini 3 Pro som state-of-the-art i resonneringsdybde og nyanse, og den fungerer som motoren for flere utvikler- og bedriftsverktøy, inkludert Google AI Studio, Vertex AI og agentiske utviklingsplattformer som Google Antigravity.

Per nå er Gemini 3 Pro i forhåndsvisning—det vil si at funksjonalitet og tilgang fortsatt utvides, men modellen scorer allerede høyt på logikk, multimodal forståelse og agentiske arbeidsflyter.

Viktige tekniske og produktfunksjoner

- Kontekstvindu: Gemini 3 Pro Preview støtter et 1 000 000-token inndata-kontekstvindu (og opptil 64k token utdata), som er en stor praktisk fordel for å ta inn ekstremt store dokumenter, bøker eller videotranskripsjoner i én forespørsel.

- API-funksjoner:

thinking_level-parameter (low/high) for å avveie latens og resonneringsdybde;media_resolution-innstillinger for å styre multimodal kvalitet og tokenbruk; søkegrunnlag, fil/URL-kontekst, kodekjøring og funksjonskalling støttes. Thought signatures og kontekstbuffering hjelper med å opprettholde tilstand på tvers av fler-kall-arbeidsflyter. - Deep Think-modus / høyere resonnering: Et “Deep Think”-alternativ gir en ekstra resonnementspass for å presse poeng på krevende benchmarker. Google publiserer Deep Think som en egen høyytelsesvei for komplekse problemer.;

- Egen multimodal støtte: Tekst-, bilde-, lyd- og videoinndata med tett forankring til søk og produktintegrasjoner (Video-MMMU-poeng og andre multimodale benchmarker fremheves).

Hurtigoversikt — GPT-5.2 vs Gemini 3 Pro

Kompakt sammenligningstabell med de viktigste fakta (kilder sitert).

| Aspekt | GPT-5.2 (OpenAI) | Gemini 3 Pro (Google / DeepMind) |

|---|---|---|

| Leverandør / posisjonering | OpenAI — flaggskipoppgradering i GPT-5.x med fokus på profesjonelt kunnskapsarbeid, koding og agentiske arbeidsflyter. | Google DeepMind / Google AI — flaggskip i Gemini-generasjonen med fokus på ultralang-kontekst multimodal resonnering og verktøyintegrasjon. |

| Hovedvarianter | Instant, Thinking, Pro (og Auto som bytter mellom dem). Pro gir høyere resonneringsinnsats. | Gemini 3-familie inkludert Gemini 3 Pro og Deep-Think-moduser; multimodal / agentisk fokus. |

| Kontekstvindu (input / output) | ~400 000 tokens total inndata-kapasitet; opptil 128 000 output-/resonneringstokens (laget for svært lange dokumenter og kodebaser). | Opptil ~1 000 000 tokens inndata/kontekstvindu (1M) med opptil 64K tokens utdata |

| Nøkkelstyrker / fokus | Lang-kontekst resonnering, agentisk verktøykalling, koding, strukturerte arbeidsoppgaver (regneark, presentasjoner); sikkerhet/systemkort-oppdateringer vektlegger pålitelighet. | Multimodal forståelse i stor skala, resonnering + bildekombinasjon, svært stor kontekst + “Deep Think”-resonneringsmodus, sterke verktøy-/agentintegrasjoner i Google-økosystemet. |

| Multimodal- og bildekapabiliteter | Forbedret visjon og multimodal forankring; tunet for verktøybruk og dokumentanalyse. | Høyoppløselig bildegenerering + resonneringsforbedret komposisjon, multi-referanse bildeediting og lesbar tekstrendering. |

| Latens / interaktivitet | Leverandøren fremhever raskere inferens og prompt-respons (lavere latens enn tidligere GPT-5.x-modeller); flere nivåer (Instant / Thinking / Pro). | Google fremhever optimalisert “Flash”/serving og sammenlignbare interaktive hastigheter for mange flyter; Deep Think-modus bytter latens mot dypere resonnering. |

| Merkbare funksjoner / differensiatorer | Resonneringsinnsatsnivåer (medium/high/xhigh), forbedret verktøykalling, kodegenerering av høy kvalitet, høy tokeneffektivitet for bedriftsarbeidsflyter. | 1M token-kontekst, sterk innfødt multimodal inntak (video/lyd), “Deep Think”-resonneringsmodus, tette Google-produktintegrasjoner (Docs/Drive/NotebookLM). |

| Typiske beste bruksområder (kort) | Langdokumentanalyse, agentiske arbeidsflyter, komplekse kodeprosjekter, bedriftsautomatisering (regneark/rapporter). | Ekstremt store multimodale prosjekter, langsiktige agentiske arbeidsflyter som trenger 1M-token kontekst, avanserte bilde + resonneringspipeliner. |

Hvordan sammenlignes GPT-5.2 og Gemini 3 Pro arkitektonisk?

Kjernearkitektur

- Benchmarker / virkelighetsnære evalueringer: GPT-5.2 Thinking oppnådde 70,9 % seire/uavgjort på GDPval (44-yrkes kunnskapsarbeids-evaluering) og store gevinster på ingeniør- og mattebenchmarker vs. tidligere GPT-5-varianter. Betydelige forbedringer i koding (SWE-Bench Pro) og domenespørsmål (GPQA Diamond).

- Verktøy og agenter: Dyp innebygd støtte for verktøykalling, Python-kjøring og agentiske arbeidsflyter (dokumentsøk, filanalyse, data science-agenter). 11x hastighet / <1 % kostnad vs. menneskelige eksperter for noen GDPval-oppgaver (mål på potensiell økonomisk verdi, 70,9 % vs. tidligere ~38,8 %), og viser konkrete gevinster i regnearkmodellering (f.eks. +9,3 % på en junior investment banking-oppgave vs. GPT-5.1).

- Gemini 3 Pro: Sparse Mixture-of-Experts Transformer (MoE). Modellen aktiverer et lite sett eksperter per token, som muliggjør ekstremt stor total parameterkapasitet med sublineær per-token-beregning. Google publiserer et modelkort som tydeliggjør at Sparse MoE-designet er en kjernebidragsyter til den forbedrede ytelsesprofilen. Denne arkitekturen gjør det mulig å presse modellkapasiteten mye høyere uten lineær inferenskostnad.

- GPT-5.2 (OpenAI): OpenAI fortsetter å bruke transformer-baserte arkitekturer med routing/kompaktering-strategier i GPT-5-familien (en “router” utløser ulike modi — Instant vs. Thinking — og selskapet dokumenterer kompaktering og token-håndteringsteknikker for lange kontekster). GPT-5.2 vektlegger trening og evaluering for å “tenke før den svarer” og kompaktering for langtidsoppgaver fremfor å annonsere klassisk sparse-MoE i skala.

Implikasjoner av arkitekturene

- Latens- og kostnadsavveininger: MoE-modeller som Gemini 3 Pro kan tilby høyere toppkapabilitet per token samtidig som inferenskostnaden holdes lavere for mange oppgaver fordi kun et delsett av eksperter kjøres. De kan imidlertid øke kompleksitet i serving og planlegging (kaldstart-ekspertbalansering, IO). GPT-5.2s tilnærming (tett/rutet med kompaktering) favoriserer forutsigbar latens og utviklervennlighet — spesielt når det er integrert i etablerte OpenAI-verktøy som Responses, Realtime, Assistants og batch-API-er.

- Skalering av lang kontekst: Geminis 1M inndata-token-kapasitet lar deg gi ekstremt lange dokumenter og multimodale strømmer nativt. GPT-5.2s ~400k kombinert kontekst (inndata+utdata) er fortsatt massiv og dekker de fleste bedriftsbehov, men er mindre enn Geminis 1M-spesifikasjon. For svært store korpus eller flertimers videotranskripsjoner gir Geminis spesifikasjon en tydelig teknisk fordel.

Verktøy, agenter og multimodal grunnstruktur

- OpenAI: dyp integrasjon for verktøykalling, Python-kjøring, “Pro”-resonneringsmodi og betalte agentøkosystemer (ChatGPT Agents / bedriftsverktøy-integrasjoner). Sterkt fokus på kode-sentriske arbeidsflyter og generering av regneark / lysbilder som førsteklasses utdata.

- Google / Gemini: innebygd forankring til Google Søk (valgfri fakturert funksjon), kodekjøring, URL- og filkontekst, og eksplisitte medieoppløsningskontroller for å bytte tokens mot visuell kvalitet. API-et tilbyr

thinking_levelog andre knotter for å fininnstille kost/latens/kvalitet.

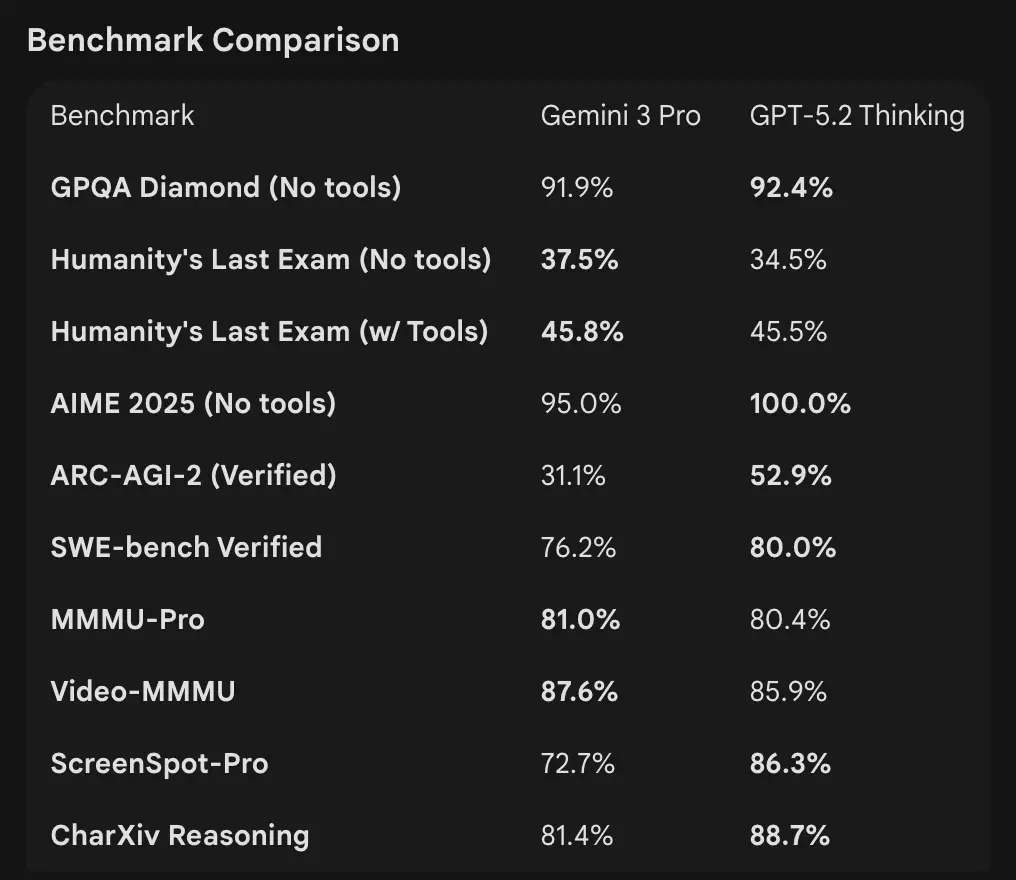

Hvordan sammenlignes benchmark-tallene?

Kontekstvinduer og token-håndtering

- Gemini 3 Pro Preview: 1 000 000 inndata-tokens / 64k utdata-tokens (Pro preview modelkort). Kunnskapsavgrensning: januar 2025 (Google).

- GPT-5.2: OpenAI demonstrerer sterk lang-kontekst-ytelse (MRCRv2-poeng på tvers av 4k–256k “needle”-oppgaver med >85–95 % i mange innstillinger) og bruker kompakteringsfunksjoner; OpenAIs offentlige konteksteksempler indikerer robust ytelse selv ved svært store kontekster, men OpenAI oppgir variantspesifikke vinduer (og vektlegger kompaktering fremfor et enkelt 1M-tall). For API-bruk er modellnavn

gpt-5.2,gpt-5.2-chat-latest,gpt-5.2-pro.

Resonnerings- og agent-benchmarker

- OpenAI (utvalg): Tau2-bench Telecom 98,7 % (GPT-5.2 Thinking), sterke gevinster i flertrinns verktøybruk og agentiske oppgaver (OpenAI fremhever kollapsing av multi-agent-systemer til en “mega-agent”). GPQA Diamond og ARC-AGI viste sprang sammenlignet med GPT-5.1.

- Google (utvalg): Gemini 3 Pro: LMArena 1501 Elo, MMMU-Pro 81 %, Video-MMMU 87,6 %, høy GPQA og Humanity’s Last Exam-poeng; Google demonstrerer også sterk langtidsplanlegging via agentiske eksempler.

Verktøy og agenter:

GPT-5.2: Dyp innebygd støtte for verktøykalling, Python-kjøring og agentiske arbeidsflyter (dokumentsøk, filanalyse, data science-agenter). 11x hastighet / <1 % kostnad vs. menneskelige eksperter for noen GDPval-oppgaver (mål på potensiell økonomisk verdi , 70,9 % vs. tidligere ~38,8 %), og viser konkrete gevinster i regnearkmodellering (f.eks. +9,3 % på en junior investment banking-oppgave vs. GPT-5.1).

Tolkning: benchmarkene er komplementære — OpenAI vektlegger virkelighetsnære kunnskapsarbeids-benchmarker (GDPval) som viser at GPT-5.2 utmerker seg i produksjonsoppgaver som regneark, lysbilder og lange agentiske sekvenser. Google vektlegger rå resonneringsledertabeller og ekstremt store kontekstvinduer for enkeltforespørsler. Hva som betyr mest avhenger av arbeidslasten din: agentiske, langdokument-baserte bedriftsrørledninger favoriserer GPT-5.2s dokumenterte GDPval-ytelse; inntak av massiv rå kontekst (f.eks. hele videokorpus / hele bøker i ett pass) favoriserer Geminis 1M inndata-vindu.

Hvordan sammenlignes multimodale kapabiliteter?

Inndata og utdata

- Gemini 3 Pro Preview: støtter tekst, bilde, video, lyd, PDF som inndata og tekst som utdata; Google tilbyr granulære

media_resolution-kontroller og enthinking_level-parameter for å fininnstille kost vs. kvalitet for multimodalt arbeid. Utdata-token-tak 64k; inndata opptil 1M tokens. - GPT-5.2: støtter rike visjons- og multimodale arbeidsflyter; OpenAI fremhever forbedret romlig resonnering (bildekomponent-bokser med estimerte etiketter), videoforståelse (Video MMMU-poeng) og verktøyaktivert visjon (Python-verktøy på visjonsoppgaver forbedrer poeng). GPT-5.2 understreker at komplekse visjon + kode-oppgaver drar stort nytte av at verktøystøtte (Python-kodekjøring) er aktivert.

Praktiske forskjeller

Granularitet vs. bredde: Gemini eksponerer en rekke multimodale knotter (media_resolution, thinking_level) som lar utviklere justere avveininger per medietype. GPT-5.2 vektlegger integrert verktøybruk (kjør Python i loopen) for å kombinere visjon, kode og datatransformasjonsoppgaver. Hvis bruken din er tung på video + bildeanalyse med ekstremt store kontekster, er Geminis 1M-kontekst påfallende; hvis arbeidsflytene krever kodekjøring i loopen (datatransformasjoner, regnearkgenerering), kan GPT-5.2s kodeverktøy og agentvennlighet være mer praktisk.

Hva med API-tilgang, SDK-er og prising?

OpenAI GPT-5.2 (API og prising)

- API:

gpt-5.2,gpt-5.2-chat-latest,gpt-5.2-provia Responses API / Chat Completions. Etablerte SDK-er (Python/JS), kokebokguider og et modent økosystem. - Prising (offentlig): $1.75 / 1M inndata-tokens og $14 / 1M utdata-tokens; cache-rabatter (90 % for bufrede inndata) reduserer effektiv kostnad for gjentatt data. OpenAI vektlegger tokeneffektivitet (høyere pris per token men lavere total kost for å nå en kvalitetsgrense).

Gemini 3 Pro Preview (API og prising)

- API:

gemini-3-pro-previewvia Google GenAI SDK og Vertex AI/GenerativeLanguage-endepunkter. Nye parametere (thinking_level,media_resolution) og integrasjon med Googles grunnlag og verktøy. - Prising (offentlig forhåndsvisning): Omtrent $2 / 1M inndata-tokens og $12 / 1M utdata-tokens for forhåndsvisningsnivåer under 200k tokens; tilleggskostnader kan gjelde for Search-grunnlag, Maps eller andre Google-tjenester (Search-grunnlagsfakturering starter 5. jan. 2026).

Bruk GPT-5.2 og Gemini 3 via CometAPI

CometAPI er et gateway-/aggregator-API: ett, OpenAI-stil REST API-endepunkt som gir deg enhetlig tilgang til hundrevis av modeller fra mange leverandører (LLM-er, bilde-/videomodeller, embedding-modeller, etc.). I stedet for å integrere mange leverandør-SDK-er lar CometAPI deg kalle kjente OpenAI-format-endepunkter (chat/completions/embeddings/images) mens du bytter modeller eller leverandører under panseret.

Utviklere kan bruke flaggskipmodeller fra to forskjellige selskaper samtidig via CometAPI uten å bytte leverandører, og API-prisene er rimeligere, vanligvis 20 % lavere.

Eksempel: raske API-snutter (kopier og lim inn for å prøve)

Nedenfor er minimale eksempler du kan kjøre. De reflekterer leverandørenes publiserte hurtigstarter (OpenAI Responses API + Google GenAI-klient). Bytt ut $OPENAI_API_KEY / $GEMINI_API_KEY med dine nøkler.

GPT-5.2 — Python (OpenAI Responses API, reasoning satt til xhigh for dype problemer)

# Python (requires openai SDK that supports responses API)from openai import OpenAIclient = OpenAI(api_key="YOUR_OPENAI_API_KEY")resp = client.responses.create( model="gpt-5.2-pro", # gpt-5.2 or gpt-5.2-pro input="Summarize this 50k token company report and output a 10-slide presentation outline with speaker notes.", reasoning={"effort": "xhigh"}, # deeper reasoning max_output_tokens=4000)print(resp.output_text) # or inspect resp to get structured outputs / tokens

Merknader: reasoning.effort lar deg avveie kostnad vs. dybde. Bruk gpt-5.2-chat-latest for Instant chat-stil. OpenAI-dokumentasjonen viser eksempler for responses.create.

GPT-5.2 — curl (enkelt)

curl https://api.openai.com/v1/responses \ -H "Authorization: Bearer $OPENAI_API_KEY" \ -H "Content-Type: application/json" \ -d '{ "model": "gpt-5.2", "input": "Write a Python function that converts a PDF with tables into a normalized CSV with typed columns.", "reasoning": {"effort":"high"} }'

(Inspiser JSON for output_text eller strukturerte utdata.)

Gemini 3 Pro Preview — Python (Google GenAI-klient)

# Python (google genai client) — example from Google docsfrom google import genaiclient = genai.Client(api_key="YOUR_GEMINI_API_KEY")response = client.models.generate_content( model="gemini-3-pro-preview", contents="Find the race condition in this multi-threaded C++ snippet: <paste code here>", config={ "thinkingConfig": {"thinking_level": "high"} })print(response.text)

Merknader: thinking_level kontrollerer modellens interne overveielse; media_resolution kan settes for bilder/videoer. REST- og JS-eksempler finnes i Googles Gemini utviklerguide.;

Gemini 3 Pro — curl (REST)

curl "https://generativelanguage.googleapis.com/v1beta/models/gemini-3-pro-preview:generateContent" \ -H "x-goog-api-key: $GEMINI_API_KEY" \ -H "Content-Type: application/json" \ -X POST \ -d '{ "contents": [{ "parts": [{"text": "Explain the race condition in this C++ code: ..."}] }], "generationConfig": {"thinkingConfig": {"thinkingLevel": "high"}} }'

Googles dokumentasjon inkluderer multimodale eksempler (bildedata inline, media_resolution).

Hvilken modell er “best” — praktisk veiledning

Velg GPT-5.2 hvis:

- Du trenger tett integrasjon med kodeeksekveringsverktøy (OpenAIs interpreter-/verktøyøkosystem) for programmatisk datapipelining, regnearkgenerering eller agentiske kodearbeidsflyter. OpenAI fremhever forbedringer i Python-verktøyet og bruk av agentisk mega-agent.

- Du prioriterer tokeneffektivitet per leverandørens påstander og ønsker eksplisitt, forutsigbar OpenAI per-token-prising med store rabatter på bufrede inndata (hjelper batch-/produksjonsarbeidsflyter).

- Du vil ha OpenAI-økosystemet (ChatGPT-produktintegrasjon, Azure / Microsoft-partnerskap, og verktøy rundt Responses API og Codex).

Velg Gemini 3 Pro hvis:

- Du trenger ekstreme multimodale inndata (video + bilder + lyd + pdf) og ønsker en enkelt modell som nativt aksepterer alle disse inndataene med et 1 000 000 token inndata-vindu. Google markedsfører dette eksplisitt for lange videoer, store dokument + video-pipelines og interaktive Search/AI Mode-brukstilfeller.&

- Du bygger på Google Cloud / Vertex AI og vil ha tett integrasjon med Google søkegrunnlag, Vertex-provisjonering og GenAI-klient-API-ene. Du vil dra nytte av Google-produktintegrasjoner (Search AI Mode, AI Studio, Antigravity agent-verktøy).

Konklusjon: Hvilken er best i 2026?

I GPT-5.2 vs. Gemini 3 Pro Preview-duellen er svaret kontekstavhengig:

- GPT-5.2 leder i profesjonelt kunnskapsarbeid, analytisk dybde og strukturerte arbeidsflyter.

- Gemini 3 Pro Preview utmerker seg i multimodal forståelse, integrerte økosystemer og oppgaver med stor kontekst.

Ingen av modellene er universelt “best”—i stedet utfyller styrkene deres ulike reelle behov. Smarte brukere bør matche modellvalg til spesifikke brukstilfeller, budsjettbegrensninger og økosystemtilpasning.

Det som er tydelig i 2026 er at AI-fronten har avansert betydelig, og både GPT-5.2 og Gemini 3 Pro flytter grensene for hva intelligente systemer kan oppnå i virksomheter og utover.

Hvis du vil prøve med en gang, utforsk GPT-5.2 og Gemini 3 Pro sine kapabiliteter via CometAPI i Playground og se API-guiden for detaljerte instruksjoner. Før du får tilgang, må du sørge for at du er logget inn på CometAPI og har skaffet deg API-nøkkelen. CometAPI tilbyr en pris langt under offisiell pris for å hjelpe deg å integrere.

Ready to Go?→ Gratis prøve av GPT-5.2 og Gemini 3 Pro !

Hvis du vil