Qwen2.5-Max representerer et betydelig fremskritt innen storskala språkmodeller, og viser frem bemerkelsesverdige evner innen naturlig språkforståelse og -generering. Utviklet av Qwen-teamet, utnytter denne modellen banebrytende teknikker for å levere overlegen ytelse på tvers av ulike benchmarks.

Hva er Qwen2.5-Max?

Qwen2.5-Max er en state-of-the-art storskala språkmodell designet for å flytte grensene for naturlig språkforståelse og generering. Utviklet med en Mixture-of-Experts (MoE)-arkitektur, skalerer den effektivt beregninger samtidig som den gir overlegen ytelse på tvers av ulike AI-benchmarks. Modellen er forhåndstrent på et omfattende datasett med over 20 billioner tokens, noe som sikrer en bred og dyp forståelse av flere språk, emner og tekniske disipliner.

Nøkkelfunksjoner til Qwen2.5-Max

- Blanding av eksperter (MoE) arkitektur: Optimaliserer beregningen ved å velge spesifikke eksperter per spørring, noe som øker effektiviteten.

- Omfattende fortrening: Opplært på et massivt datasett for overlegen forståelse og kunnskapsrepresentasjon.

- Forbedret resonnement og forståelse: Utkonkurrerer andre modeller i matematisk problemløsning, logisk resonnement og kodingsoppgaver.

- Finjustert med overvåket og forsterkende læring: Inkorporerer forsterkende læring fra menneskelig tilbakemelding (RLHF) for å avgrense svarene og forbedre brukervennligheten.

Hvordan fungerer Qwen2.5-Max?

1. Blanding av eksperter (MoE) arkitektur

Qwen2.5-Max bruker et Mixture-of-Experts-system, som dynamisk velger et undersett av nevrale ekspertnettverk for hver spørring. Denne tilnærmingen sikrer høy effektivitet og skalerbarhet, ettersom bare relevante eksperter aktiveres for spesifikke oppgaver, noe som reduserer beregningsoverhead samtidig som nøyaktigheten opprettholdes.

2. Omfattende fortrening

Modellen har blitt trent på et mangfoldig datasett som spenner over flere domener, inkludert litteratur, koding, vitenskap og samtalespråk. Denne omfattende opplæringen lar Qwen2.5-Max forstå og generere tekst med bemerkelsesverdig flyt og kontekstuell nøyaktighet.

3. Overvåket og forsterkende læringsoptimalisering

Etter forhåndstrening gjennomgår Qwen2.5-Max finjustering ved hjelp av menneskemerkede data og Reinforcement Learning from Human Feedback (RLHF). Dette forbedrer tilpasningen til menneskelige forventninger, noe som gjør den mer pålitelig for ulike applikasjoner.

4. Benchmark ytelse

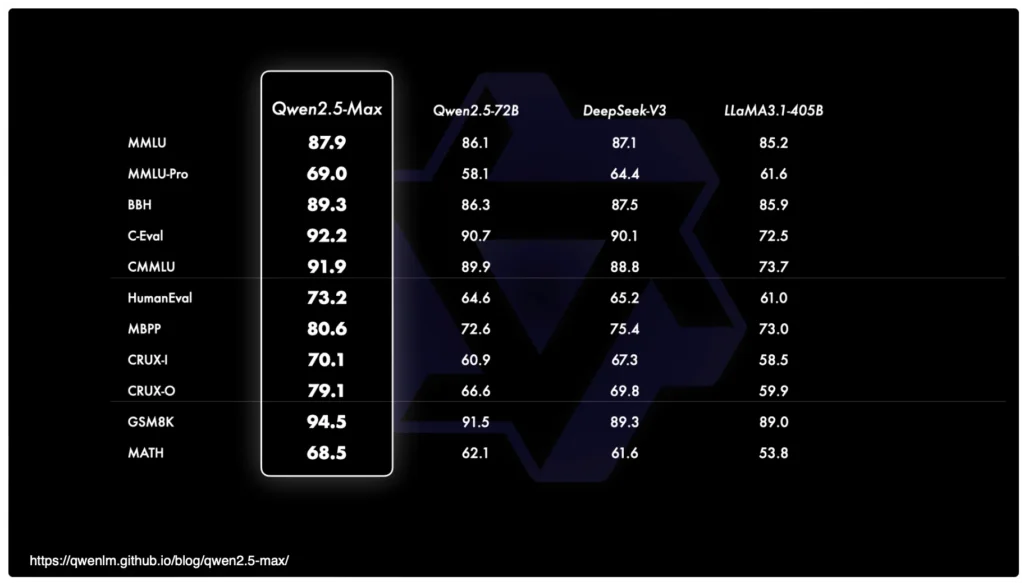

Qwen2.5-Max har utkonkurrert ledende AI-modeller i flere industristandarder:

- Arena-Hard, LiveBench, LiveCodeBench og GPQA-Diamond: Rangerer konsekvent øverst i disse AI-evalueringsplattformene.

- Matematikk og programmering: Har den første posisjonen for beregningsresonnement og kodingsutfordringer.

- Kompleks oppgavehåndtering: Oppnår andreplass i å takle nyanserte og flertrinnsproblemer.

Slik bruker du Qwen2.5-Max

1. Få tilgang til Qwen2.5-Max

Qwen2.5-Max er tilgjengelig via flere tilgangspunkter. Nedenfor er de detaljerte trinnene for å få tilgang til den:

Tilgang via offisiell nettside

Den raskeste måten å oppleve Qwen2.5-Max på er gjennom Qwen Chat plattform. Dette er et nettbasert grensesnitt som lar deg samhandle med modellen direkte i nettleseren din – akkurat som du ville brukt ChatGPT i nettleseren din.

- Besøk det offisielle nettstedet til Qwen2.5-Max.

- Registrer deg eller logg på med legitimasjonen din.

- Naviger til delen "Kom i gang".

- Velg mellom gratis tilgang (hvis tilgjengelig) eller abonnementsbaserte planer.

- Følg introduksjonsveiledningen for å begynne å bruke modellen.

Bruker Qwen2.5-Max API

- Gå til den offisielle Qwen API-dokumentasjonssiden.

- Registrer deg for en API-nøkkel ved å registrere en konto.

- Når du er verifisert, logger du på og henter API-legitimasjonen din.

- Bruk API ved å sende forespørsler til de angitte endepunktene med riktig autentisering.

- Integrer API-en i applikasjonene dine ved å bruke Python, JavaScript eller et hvilket som helst foretrukket programmeringsspråk.

Tilgang via skyplattformer

- Besøk en skyleverandør som er vert for Qwen 2.5-Max, for eksempel Alibaba Cloud eller Hugging Face.

- Opprett en konto hvis du ikke allerede har en.

- Søk etter "Qwen2.5-Max" i AI/ML-delen.

- Velg modell og konfigurer tilgangsinnstillingene (datakraft, lagring osv.).

- Distribuer modellen og begynn å bruke den via et interaktivt miljø eller API-kall.

Distribuerer Qwen2.5-Max lokalt

- Se etter en åpen kildekode eller nedlastbar versjon på GitHub eller den offisielle nettsiden.

- Sørg for at systemet ditt oppfyller maskinvarekravene (GPUer, minne, lagring).

- Følg installasjonsinstruksjonene i dokumentasjonen.

- Installer nødvendige avhengigheter og konfigurer miljøet.

- Kjør modellen lokalt og test funksjonene.

Bruke CometAPI (tredjeparts AI-plattformer)

CometAPI tilbyr en pris som er langt lavere enn den offisielle prisen for å hjelpe deg med å integrere qwen 2.5 max API, og du vil få $1 på kontoen din etter registrering og pålogging!

CometAPI gir tilgang til over 500 AI-modeller, inkludert åpen kildekode og spesialiserte multimodale modeller for chat, bilder, kode og mer. Dens primære styrke ligger i å forenkle den tradisjonelt komplekse prosessen med AI-integrasjon. Velkommen til å registrere deg og oppleve CometAPI.

- Logg inn til cometapi.com. Hvis du ikke er vår bruker ennå, vennligst registrer deg først

- Få tilgangslegitimasjons-API-nøkkelen av grensesnittet. Klikk "Legg til token" ved API-tokenet i det personlige senteret, hent tokennøkkelen: sk-xxxxx og send inn.

- Få tilgang til Qwen2.5-Max (modellnavn: qwen-max) via deres nettgrensesnitt, API eller chatbot-tjenester.

- Bruk innebygde verktøy for å generere tekst, kode eller analysere data.

2. Praktiske bruksområder

- Samtale AI: Brukes for chatbots og virtuelle assistenter.

- Kodehjelp: Hjelper utviklere å generere og feilsøke kode effektivt.

- Utdanningsstøtte: Forbedrer veiledningssystemer med resonneringsevner på høyt nivå.

- Content Creation: Genererer artikler, sammendrag og markedsføringskopier med høy nøyaktighet.

2. Praktiske bruksområder

- Samtale AI: Brukes for chatbots og virtuelle assistenter.

- Kodehjelp: Hjelper utviklere å generere og feilsøke kode effektivt.

- Utdanningsstøtte: Forbedrer veiledningssystemer med resonneringsevner på høyt nivå.

- Content Creation: Genererer artikler, sammendrag og markedsføringskopier med høy nøyaktighet.

Sammenligning med andre AI-modeller

Qwen2.5-Max vs. GPT-4

| Trekk | Qwen2.5-Max | GPT-4 |

|---|---|---|

| arkitektur | Blanding av eksperter | Tett transformator |

| Data før trening | 20+ billioner tokens | ~13 billioner tokens |

| Effektivitet: | Høy (aktiverer kun nødvendige eksperter) | Nedre (behandler hele modellen) |

| Kodeforståelse | Sterk (topp i kodingsreferanser) | Sterk (yter bra, men lavere enn Qwen2.5-Max) |

| Matematisk resonnement | Avansert | Moderat |

Qwen2.5-Max vs. DeepSeek-V3

| Trekk | Qwen2.5-Max | DeepSeek-V3 |

|---|---|---|

| Kunnskapsdekning | Bred (flere domener) | Fokusert (teknisk og vitenskapelig basert) |

| Logisk resonnement | Høyt | Moderat |

| API-tilgjengelighet | Ja | Begrenset |

| Modelltilpasningsevne | Finjustert for flere applikasjoner | Spesialisert på færre domener |

Andre Modeller

Framtidige mål

Qwen2.5-Max forventes å utvikle seg videre med integrering av multimodale muligheter, slik at den kan behandle bilder, videoer og strukturerte data. Fremtidige iterasjoner kan inkludere bedre sanntidslæring og forbedret interaksjonshåndtering, noe som gjør det til et enda kraftigere verktøy for AI-drevne løsninger.

Konklusjon

Qwen 2.5-Max representerer et stort fremskritt innen kunstig intelligens, og overgår eksisterende modeller i resonnement, forståelse og oppgaveutførelse. Med sin innovative Mixture-of-Experts-arkitektur, omfattende opplæring og overlegne benchmark-ytelse, er den klar til å revolusjonere applikasjoner på tvers av bransjer, fra programvareutvikling til kundestøtte og utdanning. Ettersom AI fortsetter å utvikle seg, er Qwen 2.5-Max godt posisjonert til å lede an i å levere banebrytende AI-drevne løsninger.