Anthropic lanserte Claude Opus 4.5 i slutten av november 2025 som en mer kapabel og mer effektiv modell i Opus-klassen, rettet mot profesjonell programvareutvikling, agentiske arbeidsflyter og langsiktige oppgaver. Den er tilgjengelig gjennom Anthropics utviklerplattform og via CometAPI, og den introduserer nye API-kontroller (særlig parameteren effort), forbedret verktøystøtte for datamaskinbruk, utvidet tenkning og forbedringer i tokeneffektivitet som er viktige i produksjon.

Nedenfor følger en praktisk, profesjonell gjennomgang: hva som er endret, hvordan du får tilgang, hvordan du bruker de nye kontrollene (effort, utvidet tenkning, verktøybruk, filer/datamaskinbruk), veiledning om kostnad og optimalisering, hensyn til sikkerhet og styring, samt integrasjonsmønstre fra virkeligheten.

Hva er egentlig Claude Opus 4.5, og hvorfor er det viktig?

Claude Opus 4.5 er Anthropics nyeste medlem i Opus-modellfamilien (lansert 24.–25. november 2025) som fokuserer på maksimal resonnerings- og kodekapasitet, samtidig som den forbedrer tokeneffektiviteten og tilbyr nye API-kontroller for å balansere kostnad mot grundighet. Anthropic posisjonerer Opus 4.5 som den «mest intelligente modellen» de har lansert, med mål om komplekse programvareutviklingsoppgaver, langvarige agenter, regneark-/Excel-automatisering og oppgaver som krever vedvarende resonnement over flere steg.

Hva er de viktigste oppdateringene i Opus 4.5?

Anthropic har utviklet Opus 4.5 for å forbedre dybden i resonnering og agentisk atferd, samtidig som utviklere får bedre kontroll over avveiningene mellom kostnad og ventetid. Høydepunktene i lanseringen er:

effort-parameter (beta): en førsteklasses API-kontroll som styrer hvor mye «tenkebudsjett» Claude bruker på en forespørsel (vanligvislow,medium,high). Den påvirker resonnering, verktøykall og interne «thinking»-tokens, slik at du kan justere hastighet mot grundighet per kall i stedet for å bytte modell. Dette er en signaturkapasitet i Opus 4.5.- Bedre agent- og verktøyorkestrering: forbedret nøyaktighet i valg av verktøy, bedre strukturerte verktøykall og en mer robust arbeidsflyt for verktøyresultater ved bygging av agenter og flerstegspipelines. Anthropic leverer dokumentasjon og SDK-veiledning for arbeidsflyten for «tool use».

- Token- / kostnadseffektivitet — Anthropic rapporterer opptil ~50 % reduksjon i tokenbruk for enkelte arbeidsflyter sammenlignet med Sonnet 4.5, i tillegg til færre feil i verktøykall og færre iterasjoner for komplekse ingeniøroppgaver.

- Forbedrede multimodale egenskaper: omfattende forbedringer i visuell, resonneringsmessig og matematisk ytelse.

- Kontekstvinduet er utvidet til 200K tokens, som støtter dype, lange samtaler og kompleks dokumentanalyse.

Hvilke praktiske egenskaper er forbedret?

Ytelsesoppgradering

- Bedre agent- og verktøyorkestrering: forbedret nøyaktighet i valg av verktøy, bedre strukturerte verktøykall og en mer robust arbeidsflyt for verktøyresultater ved bygging av agenter og flerstegspipelines. Anthropic leverer dokumentasjon og SDK-veiledning for arbeidsflyten for «tool use». Forbedret håndtering av kontekst, komprimeringshjelpere for lange agentkjøringer og førsteklasses tool-SDK-er for registrering og validering av verktøy gjør at Opus 4.5 er bedre egnet til å bygge agenter som kan kjøre uten tilsyn i mange steg.

- Forbedrede multimodale egenskaper: omfattende forbedringer i visuell, resonneringsmessig og matematisk ytelse.

- Kontekstvinduet er utvidet til 200K tokens, som støtter dype, lange samtaler og kompleks dokumentanalyse.

Koding og langsiktig arbeid

Opus 4.5 fortsetter å være benchmark-drevet for kodingsoppgaver; den reduserer antallet iterasjoner og feil i verktøykall under lange jobber (kodemigrering, refaktorering, feilsøking over flere steg). Tidlige rapporter og Anthropics systemkort peker på forbedret vedvarende ytelse på ingeniørbenchmarks og dramatiske effektivitetsgevinster i verktøydrevne pipelines.

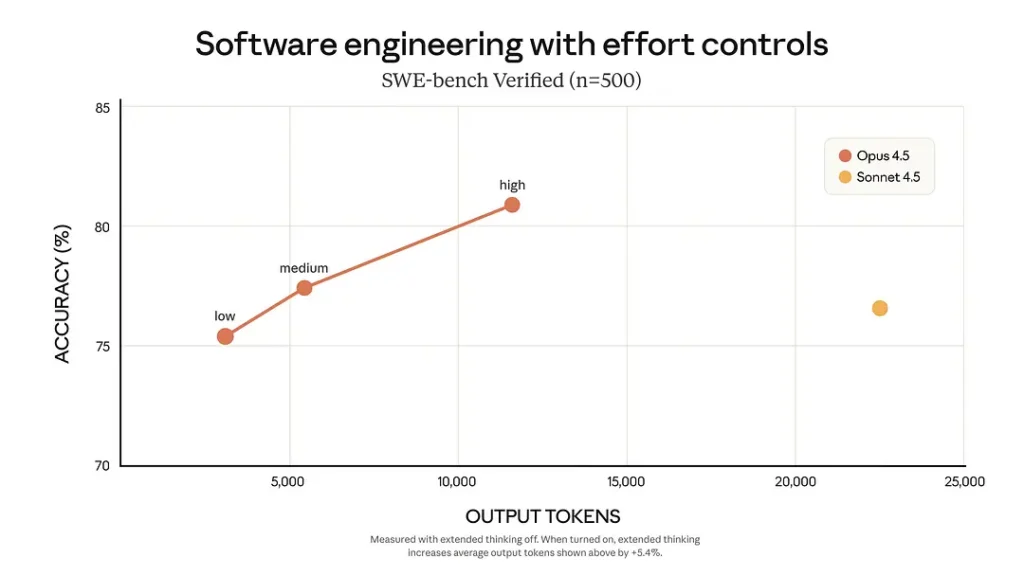

I SWE-bench rapporterer Opus 4.5 ledende resultater på benchmarks for programvareutvikling (Anthropic oppgir 80,9 % på SWE-bench Verified i lanseringsmaterialet), og kunder rapporterer forbedringer innen feilsøking, redigering i flere filer og kodeoppgaver med lang horisont.

Kostnad og effektivitet

Anthropic utviklet Opus 4.5 for å forbedre dybden i resonnering og agentisk atferd, samtidig som utviklere får bedre kontroll over avveiningene mellom kostnad og ventetid:

- Prisreduksjon sammenlignet med Opus 4.1: $5 (input) / $25 (output) per million tokens.

- Forbedring i tokenbruk: gjennomsnittlig reduksjon på 50–75 % i forbruk samtidig som ytelsen opprettholdes.

- en førsteklasses API-kontroll som styrer hvor mye «tenkebudsjett» Claude bruker på en forespørsel (vanligvis

low,medium,high). Den påvirker resonnering, verktøykall og interne «thinking»-tokens, slik at du kan justere hastighet mot grundighet per kall i stedet for å bytte modell. Dette er en signaturkapasitet i Opus 4.5 (sammenlignet med Sonnet 4.5: Medium Effort → 76 % færre tokens, sammenlignbar ytelse; High Effort → 4,3 % forbedring i ytelse, 48 % reduksjon i tokenbruk).

Hvordan får jeg tilgang til og bruker Claude Opus 4.5 API?

Hvordan kan jeg få tilgang og nøkler?

- Opprett en Anthropic / Claude Developer-konto. Registrer deg i utviklerportalen til Claude/Anthropic og opprett en API-nøkkel via Console (organisasjons-/adminflyter finnes for team). Messages API er det primære endepunktet for chat-/assistentlignende interaksjoner.

- Skypartnere: Opus 4.5 er også tilgjengelig gjennom store skymarkedsplasser som Google Vertex AI, CometAPI(en plattform for aggregering av AI-API-er, som krever bruk av egen autentisering)). I CometAPI kan du få tilgang til Claude opus 4.5 API via Anthropic Messages-format og Chat-format.

Hvordan bør jeg autentisere forespørslene mine?

Bruk standard bearer-tokens: inkluder en Authorization: Bearer $_API_KEY-header i hvert API-kall. Forespørsler er JSON over HTTPS; Messages API godtar en liste over strukturerte meldinger (system + bruker + assistent).

Hurtigstart — Python (offisiell SDK)

Installer SDK-en:

pip install anthropic

Minimalt eksempel (synkront):

import os

from anthropic import Anthropic

# forventer ANTHROPIC_API_KEY i miljøet

client = Anthropic(api_key=os.environ)

resp = client.messages.create(

model="claude-opus-4-5-20251101",

messages=,

max_tokens=512,

)

print(resp.content.text) # SDK-en returnerer strukturerte innholdsblokker

Dette kallet bruker den kanoniske modellidentifikatoren for Opus 4.5. For leverandørstyrte endepunkter (Vertex, CometAPI, Foundry) følger du leverandørens dokumentasjon for å opprette klienten og oppgi leverandørens URL og nøkkel (f.eks. https://api.cometapi.com/v1/messages for CometAPI).

Hurtigstart — Python (CometAPI)

Du må logge inn på CometAPI og hente en nøkkel.

curl

--location

--request POST 'https://api.cometapi.com/v1/messages' \

--header 'Authorization: Bearer ' \

--header 'Content-Type: application/json' \

--data-raw '{ "model": "claude-opus-4-5-20251101", "max_tokens": 1000, "thinking": { "type": "enabled", "budget_tokens": 1000 }, "messages": }'

Hvordan bruker jeg den nye parameteren effort og utvidet tenkning?

Hva er parameteren effort, og hvordan setter jeg den?

Parameteren effort er en førsteklasses API-kontroll introdusert med Opus 4.5 som justerer hvor mye intern beregning og tokenbudsjett modellen bruker på å produsere svaret. Typiske verdier er low, medium og high. Bruk den for å balansere ventetid og tokenkostnad mot grundighet:

low— raske, tokeneffektive svar for automatisering med høyt volum og rutineoppgaver.medium— balansert kvalitet/kostnad for bruk i produksjon.high— dyp analyse, resonnering i flere steg, eller når nøyaktighet er viktigst.

Anthropic introduserte effort for Opus 4.5 (beta). Du må inkludere en beta-header (f.eks. effort-2025-11-24) og angi output_config: { "effort": "low|medium|high" } (eksempel vist nedenfor). high er standardatferden. Å senke effort reduserer tokenbruk og ventetid, men kan i noen grad redusere grundigheten. Bruk den for oppgaver med høy gjennomstrømning eller følsomhet for ventetid.

Eksempel:

# Eksempel som bruker beta messages API vist i Anthropics dokumentasjon

from anthropic import Anthropic

import os

client = Anthropic(api_key=os.getenv("ANTHROPIC_API_KEY"))

response = client.beta.messages.create(

model="claude-opus-4-5-20251101",

betas=, # påkrevd beta-header

messages=,

max_tokens=1500,

output_config={"effort": "medium"} # low | medium | high

)

print(response)

Når bør du bruke hva: bruk low for automatiserte pipelines (f.eks. kategorisering av e-post), medium for standardassistenter og high for kodegenerering, dyp research eller risikosensitive oppgaver. Anthropic fremhever denne parameteren som en nøkkelkontroll for Opus 4.5.

I SWE-bench-testen:

- I Medium Effort-modus: ytelsen er sammenlignbar med Sonnet 4.5, men output-tokens reduseres med 76 %;

- I High Effort-modus: ytelsen overgår Sonnet 4.5 med omtrent 4,3 prosentpoeng, og tokenbruken reduseres med 48 %.

Hva er Extended Thinking, og hvordan aktiverer jeg det?

Extended Thinking (også kalt «extended thinking» eller «thinking blocks») lar modellen utføre mellomliggende tankerekker eller stegvis resonnering, samtidig som de interne tanke-blokkene eventuelt kan bevares eller oppsummeres. Messages API støtter denne atferden, og Anthropic har lagt til kontroller for å bevare tidligere tanke-blokker slik at flerrundeagenter kan gjenbruke tidligere resonnering uten å gjenta kostbar rekalkulering. Bruk utvidet tenkning når oppgaven krever planlegging i flere steg, problemløsning med lang horisont eller verktøyorkestrering.

Hvordan integrerer jeg verktøy og bygger agenter med Opus 4.5?

En av de største styrkene til Opus 4.5 er forbedret tool use: definer verktøy i klienten din, la Claude avgjøre når de skal kalles, utfør verktøyet og returner tool_result — Claude vil bruke disse resultatene i sitt endelige svar. Anthropic tilbyr Agent SDK-er som lar deg registrere typede verktøyfunksjoner (f.eks. run_shell, call_api, search_docs) som Claude kan oppdage og bruke under utvidet tenkning. Plattformen konverterer verktøydefinisjoner til kallbare funksjoner som modellen kan kalle og motta resultater fra. Slik bygger du agentiske arbeidsflyter på en trygg måte (med kontrollerte input/output).

Nedenfor er et praktisk mønster og et komplett Python-eksempel.

Mønster for verktøybruk (konseptuelt)

- Klienten leverer

tools-metadata med navn, beskrivelse og JSON-skjema (input_schema). - Modellen returnerer en

tool_use-blokk (modellens strukturerte instruksjon om å kalle et bestemt verktøy med spesifikke input).stop_reasoni API-responsen kan væretool_use. - Klienten utfører verktøyet (koden din kaller det eksterne API-et eller en lokal funksjon).

- Klienten sender en oppfølgingsmelding med

role:"user"og entool_result-innholdsblokk som inneholder verktøyets output. - Modellen bruker verktøyresultatet og returnerer endelig svar eller flere verktøykall.

Denne flyten muliggjør trygg kontroll på klientsiden over hva modellen faktisk utfører (modellen foreslår verktøykall; du kontrollerer utførelsen).

Komplett eksempel — Python (enkelt værverktøy)

# 1) Definer verktøymetadata og send første forespørsel

from anthropic import Anthropic

import os, json

client = Anthropic(api_key=os.environ)

tools = [

{

"name": "get_weather",

"description": "Returner gjeldende vær for en gitt by.",

"input_schema": {"type":"object","properties":{"city":{"type":"string"}},"required":}

}

]

resp = client.messages.create(

model="claude-opus-4-5-20251101",

messages=,

tools=tools,

max_tokens=800,

)

# 2) Sjekk om Claude ønsker et verktøykall

stop_reason = resp.stop_reason # SDK-felt

if stop_reason == "tool_use":

# Hent ut verktøykallet (formatet varierer etter SDK; dette er skjematisk)

tool_call = resp.tool_calls # f.eks. {"name":"get_weather", "input":{"city":"Tokyo"}}

tool_name = tool_call

tool_input = tool_call

# 3) Utfør verktøyet på klientsiden (her: stub)

def get_weather(city):

# Erstatt denne stubben med et ekte vær-API-kall

return {"temp_c": 12, "condition": "Delvis skyet"}

tool_result = get_weather(tool_input)

# 4) Send tool_result tilbake til Claude

follow_up = client.messages.create(

model="claude-opus-4-5-20251101",

messages=[

{"role":"user", "content":[{"type":"tool_result",

"tool_use_id": resp.tool_use_id,

"content": json.dumps(tool_result)}]}

],

max_tokens=512,

)

print(follow_up.content.text)

else:

print(resp.content.text)

Hvordan bør du strukturere agenter for pålitelighet?

- Rens verktøyinput (unngå injeksjon via prompts).

- Valider verktøyoutput før du sender dem tilbake til modellen (skjemakontroller).

- Begrens verktøyomfanget (minste privilegiums prinsipp).

- Bruk komprimeringshjelpere (fra Anthropics SDK-er) for å holde konteksten håndterbar under lange kjøringer.

Hvordan bør jeg utforme prompts og strukturere meldinger for Opus 4.5?

Hvilke meldingsroller og prefill-strategier fungerer best?

Bruk et tredelt mønster:

- System (

role: system): globale instruksjoner — tone, rekkverk, rolle. - Assistant (valgfritt): forhåndsdefinerte eksempler eller priming-innhold.

- User (

role: user): den umiddelbare forespørselen.

Forhåndsutfyll systemmeldingen med begrensninger (format, lengde, sikkerhetspolicy, JSON-skjema hvis du ønsker strukturert output). For agenter bør du inkludere verktøyspesifikasjoner og brukseksempler slik at Opus 4.5 kan kalle disse verktøyene riktig.

Hvordan bruker jeg kontekstkomprimering og prompt-caching for å spare tokens?

- Kontekstkomprimering: komprimer eldre deler av en samtale til korte oppsummeringer som modellen fortsatt kan bruke. Opus 4.5 støtter automatisering for å komprimere kontekst uten å miste kritiske resonneringsblokker.

- Prompt-caching: cach modelleresponser for gjentatte prompts (Anthropic tilbyr mønstre for prompt-caching for å redusere ventetid/kostnad).

Begge funksjonene reduserer tokenfotavtrykket i lange interaksjoner og anbefales for langvarige agentiske arbeidsflyter og assistenter i produksjon.

Feilhåndtering og beste praksis

Nedenfor er pragmatiske anbefalinger for pålitelighet og sikkerhet ved produksjonsintegrasjon med Opus 4.5.

Pålitelighet og forsøk på nytt

- Håndter hastighetsgrenser (HTTP 429) med eksponentiell backoff og jitter (start på 500–1000 ms).

- Idempotens: for ikke-muterende LLM-kall kan du trygt prøve igjen, men vær forsiktig i arbeidsflyter der modellen utløser eksterne sideeffekter (verktøykall) — dedupliser ved å spore

tool_use_ideller dine egne forespørsels-ID-er. - Stabilitet ved strømming: håndter delvise strømmer og koble til igjen på en robust måte; hvis det oppstår et avbrudd, er det ofte best å prøve hele forespørselen på nytt eller gjenoppta ved hjelp av tilstand på applikasjonsnivå for å unngå inkonsistente verktøyinteraksjoner.

Sikkerhet og trygghet

- Prompt injection og verktøysikkerhet: aldri la modellen kjøre vilkårlige shell-kommandoer eller kode direkte uten validering. Valider alltid verktøyinput og rens output. Modellen foreslår verktøykall; koden din avgjør om de skal kjøres. Anthropics systemkort og dokumentasjon beskriver tilpasningsbegrensninger og sikkerhetsnivåer — følg dem for høyrisikodomener.

- Datahåndtering og compliance: behandle prompts og verktøyinput/output som inneholder PII eller regulerte data i henhold til juridiske/compliance-policyer. Bruk leverandørens VPC-/enterprise-kontroller hvis du har strenge krav til dataresidens eller revisjon (Bedrock / Vertex / Foundry tilbyr bedriftsalternativer).

Observerbarhet og kostnadskontroll

- Logg metadata for forespørsel/svar (ikke rått sensitivt innhold med mindre det er tillatt) — antall tokens,

effort-nivå, ventetid, modell-ID og leverandør. Disse målingene er avgjørende for kostnadsallokering og feilsøking. - Bruk effort for å kontrollere kostnad per kall: foretrekk

loweffort for rutinemessig oppsummering eller endepunkter med høy QPS; brukhigheffort for dyp feilsøking eller undersøkelser. Overvåk kvalitet mot tokenforbruk for å velge standardverdier for ulike endepunkter.

Konklusjon — Når (og hvordan) bør du velge Opus 4.5?

Claude Opus 4.5 er et naturlig valg når produktet ditt trenger:

- dyp resonnering i flere steg (lange logiske kjeder, research eller feilsøking),

- robust agent-/verktøyorkestrering (komplekse arbeidsflyter som kaller eksterne API-er), eller

- produksjonsklar kodeassistanse på tvers av store kodebaser.

Operasjonelt bør du bruke effort til å justere budsjett per kall; stole på mønsteret for verktøybruk for å opprettholde sikker utførelse; og velge en skypartner (eller Anthropic API direkte) ut fra dine krav til compliance. Benchmark med ditt eget korpus: leverandørtall (SWE-bench osv.) er nyttige signaler, men det er din faktiske oppgave og dine data som avgjør ROI. For sikkerhet bør du følge systemkortet for Opus 4.5 og sette opp rekkverk rundt verktøykjøring og håndtering av PII.

Utviklere kan få tilgang til Claude Opus 4.5 API gjennom CometAPI. For å komme i gang kan du utforske modellkapasitetene til CometAPI i Playground og se i API-veiledningen for detaljerte instruksjoner. Før du får tilgang, må du sørge for at du har logget inn på CometAPI og hentet API-nøkkelen. CometAPI tilbyr en pris som er langt lavere enn den offisielle prisen for å hjelpe deg med integrasjonen.

Klar til å komme i gang?→ Registrer deg for CometAPI i dag!

Hvis du vil ha flere tips, guider og nyheter om AI, følg oss på VK, X og Discord!

![There isn’t a model called “Claude Opus 4.5.” You likely mean Claude 3 Opus. Below is a quick guide to calling Anthropic’s Messages API with Claude 3 Opus.

Quick start

- Get an API key: create it in the Anthropic console.

- Endpoint: POST https://api.anthropic.com/v1/messages

- Required headers:

- x-api-key: YOUR_API_KEY

- anthropic-version: 2023-06-01

- content-type: application/json

- Choose a model:

- claude-3-opus-20240229 (or claude-3-opus-latest)

- Basic request fields:

- model: the model ID above

- messages: array of { role: "user" | "assistant", content: "…" } or content blocks

- max_tokens: upper bound for response tokens (e.g., 1024)

- temperature/top_p: sampling controls (optional)

- system: optional system prompt

- stream: true for server-sent events (optional)

cURL example

- Non-streaming:

curl https://api.anthropic.com/v1/messages \

-H "x-api-key: $ANTHROPIC_API_KEY" \

-H "anthropic-version: 2023-06-01" \

-H "content-type: application/json" \

-d '{

"model": "claude-3-opus-latest",

"max_tokens": 1024,

"messages": [

{"role":"user","content":"Explain transformers in 3 sentences."}

]

}'

- Streaming (SSE):

curl https://api.anthropic.com/v1/messages \

-H "x-api-key: $ANTHROPIC_API_KEY" \

-H "anthropic-version: 2023-06-01" \

-H "content-type: application/json" \

-d '{

"model": "claude-3-opus-latest",

"max_tokens": 1024,

"stream": true,

"messages": [

{"role":"user","content":"Stream a short poem about the ocean."}

]

}'

Python example

import os

import requests

API_KEY = os.environ["ANTHROPIC_API_KEY"]

url = "https://api.anthropic.com/v1/messages"

headers = {

"x-api-key": API_KEY,

"anthropic-version": "2023-06-01",

"content-type": "application/json",

}

data = {

"model": "claude-3-opus-latest",

"max_tokens": 1024,

"messages": [

{"role": "user", "content": "Write a haiku about debugging."}

],

"temperature": 0.7

}

resp = requests.post(url, headers=headers, json=data, timeout=60)

resp.raise_for_status()

out = resp.json()

# out["content"] is an array of blocks; extract text blocks

text = "".join(block.get("text","") for block in out.get("content", []) if block.get("type") == "text")

print(text)

Node.js example

import fetch from "node-fetch";

const API_KEY = process.env.ANTHROPIC_API_KEY;

const resp = await fetch("https://api.anthropic.com/v1/messages", {

method: "POST",

headers: {

"x-api-key": API_KEY,

"anthropic-version": "2023-06-01",

"content-type": "application/json",

},

body: JSON.stringify({

model: "claude-3-opus-latest",

max_tokens: 1024,

messages: [{ role: "user", content: "Give me a list of 5 creative icebreaker questions." }],

}),

});

const json = await resp.json();

const text = (json.content || [])

.filter(b => b.type === "text")

.map(b => b.text)

.join("");

console.log(text);

Tool use (function calling) overview

- Add a tools array describing callable functions:

- tools: [{ name, description, input_schema }]

- The model may respond with a tool_use block (name + input).

- You run the tool in your code, then send another request including a new user message with a tool_result block that references the tool_use_id and contains the tool’s output.

- Continue until the model returns a final text answer.

Multimodal (images) overview

- In a user message, content can be blocks like:

- { "type": "text", "text": "Describe this image." }

- { "type": "image", "source": { "type": "base64", "media_type": "image/png", "data": "..." } }

Best practices

- Use claude-3-opus-latest unless you need a pinned version.

- Set reasonable max_tokens to control cost.

- Prefer streaming for long outputs or interactive UIs.

- Implement retries with exponential backoff on 429/5xx.

- Keep conversation history concise; send only what the model needs.

If you actually meant Claude 3.5 Sonnet (often the strongest general model as of mid‑2024), swap the model to claude-3-5-sonnet-latest and the rest stays the same.](/_next/image/?url=https%3A%2F%2Fresource.cometapi.com%2Fblog%2Fuploads%2F2025%2F11%2FClaude-Opus-4.5.webp&w=3840&q=75)