Doubao Seed 1.8 — en del av ByteDance sin Doubao-familie og Seed-forskningslinjen — vekker oppmerksomhet for å være konstruert som en «agentisk» multimodal modell med svært stor konteksthåndtering og forbedret støtte for verktøy/agenter.

For utviklere og virksomheter er det umiddelbare spørsmålet ikke lenger «Hvor smart er den?» men «Hvordan bygger vi med den?» Jeg vil gå dypt inn i de tekniske spesifikasjonene, prisstrukturer og praktiske implementeringsstrategier for Doubao Seed 1.8 API i artikkelen.

Hva er Doubao Seed 1.8?

Doubao Seed 1.8 er den nyeste flaggskipsmodellen i ByteDance sin «Doubao» (tidligere Skylark) familie. I motsetning til forgjengerne, som primært fokuserte på samtaleflyt og innholdsgenerering, ble Seed 1.8 trent med et spesifikt mål: autonom oppgaveutførelse.

Modellen introduserer en enhetlig arkitektur som integrerer multimodal persepsjon (visjon, lyd, video) med handlingsutførelse (verktøybruk, GUI-navigasjon). Dette lar modellen fungere som en digital medarbeider som kan navigere operativsystemer, surfe på nettet og håndtere komplekse arbeidsflyter uten konstant menneskelig overvåking.

«Seed»-filosofien

Betegnelsen «Seed» i versjonsnavnet fremhever dens rolle som et grunnleggende «frø» for agentiske applikasjoner. Den er designet for å vokse inn i spesifikke brukstilfeller — enten som en kodeassistent som kan debugge et live-miljø eller en kundeservicemedarbeider som kan navigere en CRM-database for å behandle refusjoner.

Hvilke «quality of life»- og utviklerfunksjoner finnes?

- Kontekst-caching og prefill/fortsettelse for å holde lengre arbeidsflyter billigere og raskere.

- Streaming-utdata for progressive svar (nyttig for chat-UI-er eller sanntids agenttilbakemelding).

- Agent-/verktøykall: rikere primitive for å kalle verktøy, interagere med GUI-er og orkestrere flertrinnsforløp (inkludert «previous_response_id»-stil kontekstlenking).

- Langsiktig planlegging: tunet for oppgaver som krever mange sekvensielle trinn (f.eks. skrape flere nettsteder og konsolidere resultater), med forbedret stabilitet og resonnementstrajektorier.

Viktige utgivelsesdata (jan. 2026):

- Utgivelsesdato: 18. desember 2025

- Model ID:

doubao-seed-1-8-251228 - Arkitektur: Sparsom Mixture-of-Experts (MoE) med innebygd agentisk optimalisering

- Tilgang: CometAPI

Hvorfor bygde ByteDance / Volcengine Seed1.8, og hva gjør den annerledes?

Hvilket problem forsøker den å løse?

Seed1.8 retter seg mot et reelt gap: modeller som kan handle på tvers av flere modaliteter og miljøer (nettsider, videoer, GUI-er, verktøy-API-er) heller enn bare å svare på isolerte prompt. De prioriteringene som er rapportert av teamet er (1) robust multimodal persepsjon, (2) pålitelig verktøy/instrument-kalling og (3) effektivt resonnement for lange, flertrinnsoppgaver (f.eks. planlegging, multiside dataaggregasjon eller GUI-navigasjon). Seed1.8 fullfører komplekse, flertrinnsoppgaver som krever kjeding av visuell forståelse, søk og verktøybruk.

Hvordan skiller dette seg fra tidligere Doubao/Seed-versjoner?

I stedet for bare å raffinere rå modellskala, introduserer Seed1.8 arkitektoniske og systemmessige endringer som forbedrer «agentisk» ytelse: bedre konteksthåndtering, forbedret forståelse av lange videoer med lav bildefrekvens (støtte for svært lange videohorisonter med verktøyassistert høytfrekvent inspeksjon), og optimaliseringer som gir tilsvarende resonnementskraft med færre tokens i noen nivåer (ifølge tidlige community-skrivinger). Disse avveiningene gjør modellen mer kostnadseffektiv for vedvarende agent-arbeidsbelastninger.

3 nøkkelfunksjoner og multimodale kapabiliteter

Doubao Seed 1.8 skiller seg ut gjennom tre kjernepilarer: ekstrem multimodalitet, agentisk resonnement og innebygd konteksthåndtering.

1. Høyfidelitets video- og visuell forståelse

Mens mange modeller sliter med «blinde flekker» i videoanalyse, introduserer Seed 1.8 et gjennombrudd i langvideo-forståelse.

- Analyse av 1280 rammer: Modellen kan prosessere opptil 1280 videorammer i én passering, dobbelt kapasiteten til den forrige V1.5 Vision-modellen. Dette lar den «se» en 30-minutters møtereferering eller en sikkerhetsstrøm og hente ut spesifikke detaljer (f.eks. «Ved hvilken tidskode byttet presentatøren til finanssliden?»).

- Logikk for lav bildefrekvens: For ekstremt lange videoer bruker modellen en optimalisert sparsom samplingsteknikk for å beholde kontekst uten at tokenkostnaden eksploderer.

2. «Thinking»-modus (dyp resonnement)

I tråd med industritrenden satt av OpenAI sin o1/o3-serie, inkluderer Seed 1.8 en konfigurerbar «Thinking Mode.»

Når den aktiveres via API-et, engasjerer modellen seg i en «Chain of Thought»-prosess før den leverer et endelig svar. Dette er særlig effektivt for:

- Kompleks matematikk: Løse flertrinns kalkulus- eller statistikkproblemer.

- Kodearkitektur: Planlegge en mikrotjenestearkitektur før man skriver spesifikk funksjonskode.

- Logiske puslespill: Håndtere forespørsler som krever ulike begrensninger (f.eks. skiftplanlegging for 50 ansatte med motstridende tilgjengelighet).

3. UI-TARS og GUI-interaksjon

En unik funksjon ved Seed 1.8 er dens native integrasjon med UI-TARS (User Interface Tool-Augmented Reasoning System). Dette gir modellen «øyne» og «hender» for grensesnitt.

- Visuell forankring: Modellen kan se på et skjermbilde av et programvaregrensesnitt og identifisere koordinater for knapper, inndatafelt og menyer.

- Handlinggenerering: Den kan generere spesifikke OS-nivå kommandoer (klikk, dra, skrive) for å operere programvare, og utgjør motoren bak ByteDance sine nye «Auto-operate»-funksjoner i verktøy for virksomheter.

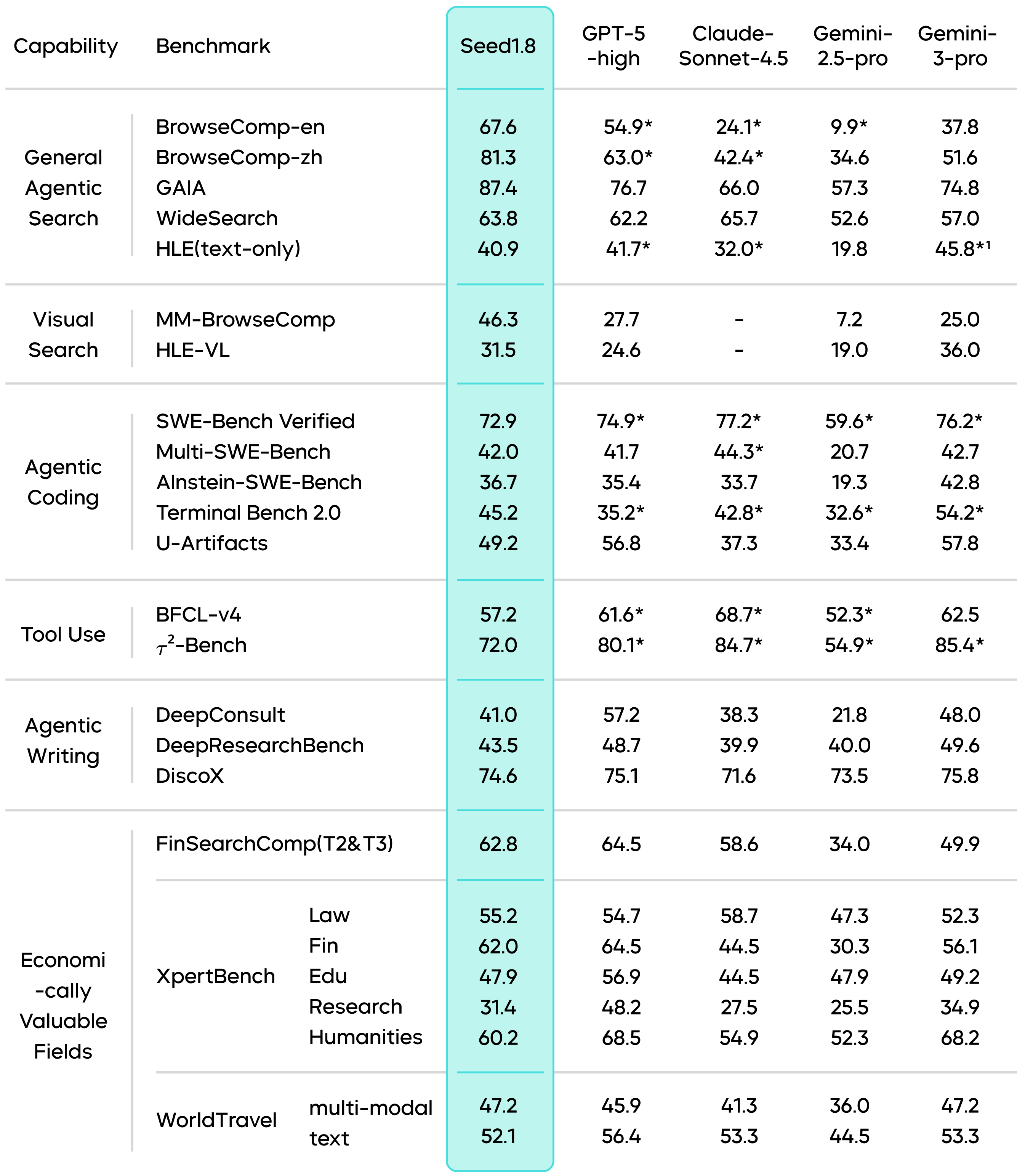

Hvordan presterer den i benchmarktester?

AI-miljøet har vært grundig i å teste Seed 1.8 siden betalanseringen. Tidlige benchmarker tegner et bilde av en modell som leverer over forventning, spesielt i verktøybruk og koding.

Agentiske benchmarktester

- BrowseComp-en: I denne benchmarken, som evaluerer en AI sin evne til å surfe på nettet og syntetisere informasjon, scoret Seed 1.8 67,6 %, angivelig bedre enn standard GPT-4o og med et lite forsprang på Claude 3.5 Sonnet i navigeringseffektivitet.

- SWE-bench (Software Engineering): Seed 1.8 har vist høy bestått-rate i å løse GitHub-issues. Dens evne til å «lese» filstrukturen i et repository og forstå avhengigheter gjør at den kan foreslå rettelser som er syntaktisk korrekte og kontekstuelt gyldige.

Sammenlignende analyse

| Metrikk | Doubao Seed 1.8 | Gemini 3 Flash | GPT-4o |

|---|---|---|---|

| Kontekstvindu | 256k | 1M+ | 128k |

| Videoforståelse | 1280 rammer | Høy | Moderat |

| Resonnement (matte/logikk) | Svært høy («Thinking Mode») | Høy | Svært høy |

| GUI-operasjon | Native (UI-TARS) | Verktøybasert | Verktøybasert |

| Prising (input) | ~¥0.80 / 1M | Lav | Høy |

Merk: Benchmark-resultater er basert på rapporterte tall fra Force Conference og uavhengige tester per januar 2026.

Seed1.8 oppnår state-of-the-art score på flere agentiske og søk-benchmarker (f.eks. topp GAIA-score i deres sammenligning; sterk BrowseComp og WideSearch-ytelse), og demonstrerer beslutningsevne i virkelige scenarier.

Hvordan kan utviklere få tilgang til og bruke API-et?

Tilgang til Doubao Seed 1.8 er enkel, primært via CometAPI-plattformen.

Nedenfor er en trinnvis veiledning for å integrere API-et i arbeidsflyten din.

Trinn 1: Opprett en CometAPI-konto

Naviger til CometAPI-nettstedet og registrer en konto. Seed 1.8-siden beskriver selve modellen.

Trinn 2: Gå til CometAPI-konsollen

I CometAPI-konsollen, aktiver modelltjenesten og opprett en API Key / Access Key med tillatelser for modellkall. Gå til API Key Management i konsollen og generer en ny nøkkel. Hold den sikker; den starter med sk-... (eller tilsvarende).

Trinn 3: Velg modellen og opprett endepunkt

I skjermbildet for modellvalg:

- Model: Velg

Doubao-Seed-1.8(se etter taggendoubao-seed-1-8-251228). - Endpoint Name: Gi endepunktet et unikt navn (f.eks.

ep-20260112-xyz).

Trinn 4: Send din første forespørsel

Doubao API er fullt kompatibel med OpenAI SDK-formatet, noe som gjør migrering enkel.

Du trenger bare å endre base_url- og model-parameterne.

Python-eksempel (med OpenAI SDK):

python

from openai import OpenAI

# [...](asc_slot://start-slot-53)Initialize client with Volcano Engine config

client = OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.cometapi.com/v1"

)

# Call the model

response = client.chat.completions.create(

model="doubao-seed-1-8-251228",

messages=[

{

"role": "system",

"content": "You are Doubao Seed 1.8, an expert AI agent."

},

{

"role": "user",

"content": "Analyze the attached video context and explain the user's intent."

}

],

# Enable Thinking Mode (if available for your endpoint)

# extra_body={"thinking_mode": "enable"}

)

print(response.choices[0].message.content)

Avansert bruk: verktøykall og multimodalt

For å bruke de agentiske kapabilitetene definerer du verktøy i standard JSON-skjema.

For bilde-/videoinngang kan du sende base64-kodede strenger eller URL-er i content-listen, likt GPT-4 Vision.

python

# Multimodal Input Example

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "What is happening in this image?"},

{

"type": "image_url",

"image_url": {

"url": "https://example.com/image.jpg"

}

}

]

}

]

Konklusjon:

Seed 1.8 bringer seriøs kapasitet for agentiske, multimodale og langkontekst applikasjoner — det er et sterkt valg når arbeidsbelastningen din krever integrert persepsjon, planlegging og handling på tvers av lange dokumenter eller medier. Verdien i virkelig ingeniørarbeid avhenger imidlertid av bruksmønstre: latensbehov, tokenvolumer, og evnen til å orkestrere caching, innhenting og verktøykjeder effektivt.

Utviklere oppfordres til å logge inn på CometAPI i dag, hente gratis tokens og begynne å plante frøene til neste generasjon av AI-applikasjoner.

Utviklere kan få tilgang til Doubao seed 1.8 API modellen via CometAPI. For å komme i gang, utforsk modellkapabilitetene til CometAPI i Playground og konsulter API-guiden for detaljerte instruksjoner. Før tilgang, vennligst sørg for at du har logget inn på CometAPI og fått API-nøkkelen. CometAPI tilbyr en pris som er langt lavere enn den offisielle prisen for å hjelpe deg å integrere.

Klar til å begynne?→ Gratis prøve av Doubao seed 1.8!