MiniMax-M2.5 er en ny, produktivitetsfokusert stor språkmodell fra MiniMax som er optimalisert for koding, agentbasert verktøybruk og kontorarbeidsflyter. Du kan bruke den via den egne MiniMax-plattformen eller via API-aggregatorer som CometAPI. Du trenger bare å skaffe CometAPI-API-nøkkelen for å bruke API-et, ettersom MiniMax-M2.5 også støtter chat-formatet.

Hva er MiniMax-M2.5?

MiniMax-M2.5 er den siste store modellutgivelsen fra MiniMax: en videreutvikling av M2-familien som selskapet posisjonerer som en generell, agentkapabel modell med spesielt sterk ytelse i kodegenerering, verktøybruk og flerstegsresonnering. M2.5-familien ble annonsert for februar 2026 og inkluderer både standard M2.5 og “highspeed”-varianter optimalisert for lavere latens samtidig som de beholder de samme kjernekapabilitetene. M2.5-familien forbedret benchmark-score i programvareingeniør-evalueringer og bedre atferd ved interaksjon med eksterne verktøy (søk, agenter, osv.).

Leverandøren posisjonerer M2.5 som et steg opp fra tidligere M2.x-utgivelser med sterkere resonnering, bedre kodegenerering og forbedret pålitelighet ved verktøykall. MiniMaxs offentlige utgivelsesnotater for tidlig februar 2026 flagget M2.5 som en milepæl: raffinert instruksjonstuning, sterkere kodeforståelse og målbare gevinster på flere kodefokuserte benchmarks. Utgivelsen inkluderer:

- En standard M2.5-modell (med vekt på nøyaktighet og resonnering).

- En M2.5-highspeed-variant med lavere latens for interaktive utviklerarbeidsflyter.

- Eksplisitt veiledning og faktureringsalternativer for en “Coding Plan” rettet mot tung kodegenerering.

Viktige tekniske høydepunkter

- Arkitektur: MoE (stort totalt antall parametere med et mye mindre aktivt sett under inferens), som muliggjør en god balanse mellom kostnad og ytelse for tunge oppgaver.

- Styrker: topp moderne kodeytelse, flersamtale-resonnering, langt kontekstvindu og integrasjoner mot agenter/verktøy.

- Varianter: MiniMax publiserer varianter (f.eks.

MiniMax-M2.5ogM2.5-highspeed) tunet for gjennomstrømning vs. latens.

Hvorfor dette er viktig i dag: Mange team som bygger utviklerverktøy, programmeringsassistenter og agentiske automasjoner verdsetter en modell som kan resonnerer over flere turer, kalle verktøy trygt og generere kode av høy kvalitet. M2.5—i kraft av arkitektur og treningsvalg—markedsføres eksplisitt for disse scenariene.

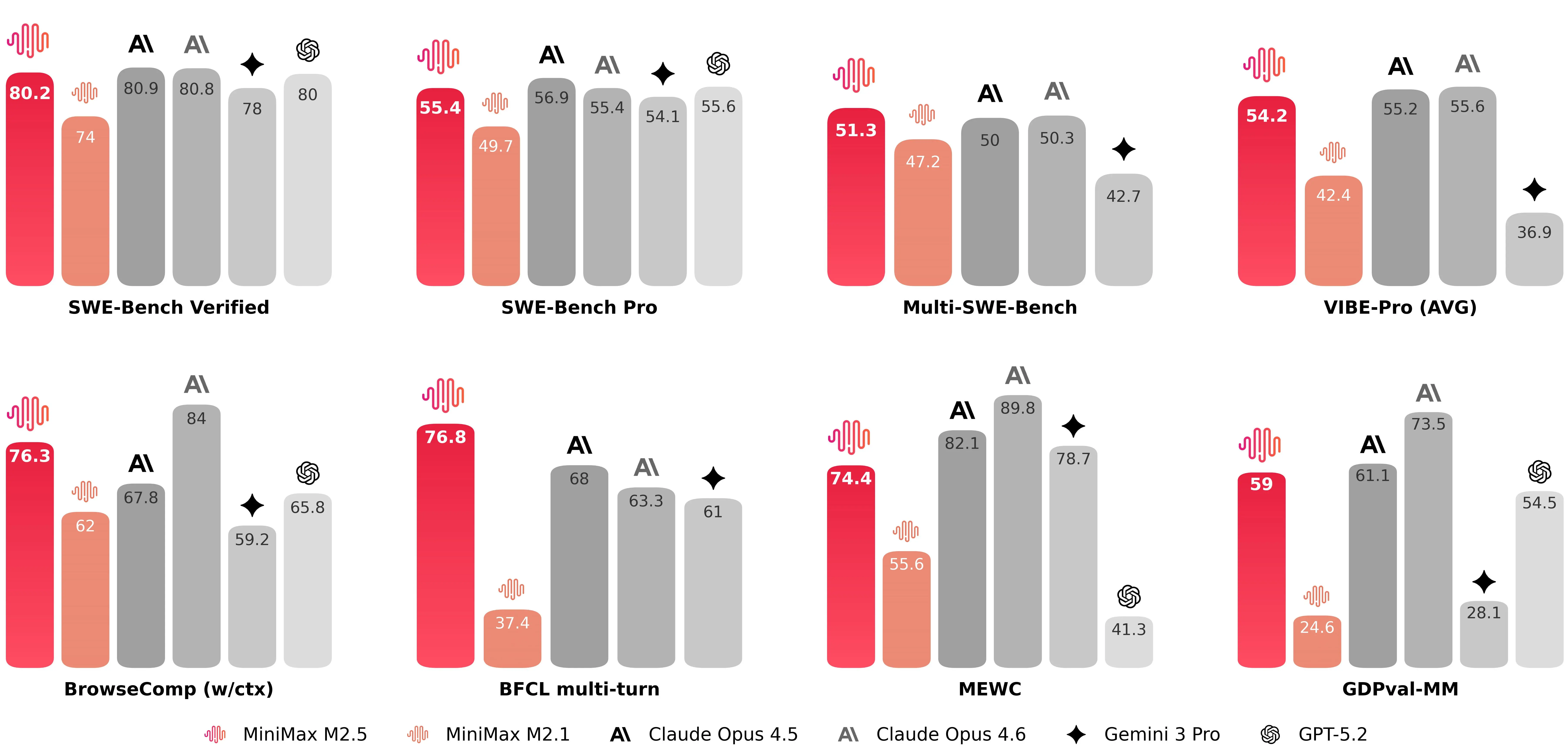

Benchmarking av MiniMax-M2.5

Hvor M2.5 ligger på kode-spesifikke benchmarks

MiniMax-M2.5 scorer 80,2 % på SWE-Bench Verified, sammen med sterke resultater på multi-oppgave-koding og nettlesingsforsterkede benchmarks (bemerkelsesverdige tall publisert av selskapet inkluderer 51,3 % på Multi-SWE-Bench og 76,3 % på BrowseComp når konteksthåndtering er aktivert). Disse tallene plasserer M2.5 blant de høyest ytende offentlig tilgjengelige modellene for kodegenerering og problemløsing ved lansering. MiniMax-M2.5s lansering bekrefter at M2.5 konkurrerer med toppsjiktet av kodemodeller.

For utviklere er fordelene tosidige:

- Høyere suksessrate ved første forsøk: færre runder med rettelser, mindre menneskelig debugging og lavere “barnevakt”-overhead for autonome kodeagenter.

- Bedre fullstack-dekning: M2.5 beskrives som støttende for fullstack-arbeidsflyter på tvers av skrivebordsapper, mobil og kryssplattform-verktøykjeder, noe som betyr at den sikter mot å generere ikke bare snutter, men koherente løsninger på tvers av flere filer og byggeskript.

Bygget for agentbaserte arbeidsflyter

M2.5 beskrives som “nativt designet for agent-scenarier.” I praksis betyr det at arkitekturen og treningsopplegget prioriterer:

- Fidelitet i verktøykall: utstedelse av API-kall eller kjøring av shell/SQL-kommandoer med korrekt syntaks og parametere.

- Kontekstbytte og hukommelse: fortsette en avbrutt, flerstegs operasjon uten å miste tidligere beregnet tilstand.

- Filmanipulasjon: generere og redigere vanlige kontorformater programmessig (for eksempel generere en PowerPoint og deretter revidere den basert på en oppfølgingsforespørsel).

Søk- og nettlesingsforsterkning

Når M2.5 pares med nettlesing eller innhentingslag, rapporterer MiniMax markant forbedrede score på nettlesingsbenchmarks, noe som reflekterer sterkere ytelse i å integrere ekstern informasjon og sitater i utdata. Det gjør M2.5 egnet for verktøy som må hente oppdatert innhold, kryss-sjekke API-resultater eller forsterke kodegenerering med data fra virkeligheten (for eksempel hente siste SDK-dokumentasjon og bruke den korrekt under kodegenerering). Disse kapasitetene er viktige for team som bygger “agentiske” funksjoner som automatisert QA, CI-verktøykjeder eller dokumentdrevne assistenter.

Hvordan kan jeg bruke MiniMax-2.5 API (via CometAPI)?

CometAPI er en API-aggregasjonsplattform som eksponerer hundrevis av modeller via en enkelt, OpenAI-kompatibel REST-overflate. Fordi CometAPIs grensesnitt speiler OpenAIs chat/completions-endepunkter, kan du ofte gjenbruke eksisterende OpenAI-stilklienter ved å bytte api_base og API-nøkkelen. Hvis du foretrekker å ikke integrere direkte med MiniMax sin plattform (av grunner som samlet fakturering, multi-modell A/B-testing eller leverandørabstraksjon), kan du kalle MiniMax-M2.5 via CometAPIs “chat”-overflate. CometAPI-plattformen tilbyr et konsistent forespørselsformat, en SDK og en web-playground — og den eksponerer per-modell-navn og parametere (slik at du velger nøyaktig leverandør-/modellstreng ved kall).

Nedenfor er en kort, praktisk guide til å kalle MiniMax-M2.5 via CometAPI, med eksempler i curl og Python.

Hva er de grunnleggende trinnene for å komme i gang?

- Registrer deg for en CometAPI-konto og skaff en API-nøkkel. (CometAPI tilbyr en playground og SDK-er for å teste modeller.)

- Sjekk CometAPIs modelliste eller CometAPI-playground for å finne det eksakte modellnavnet for MiniMax-M2.5.

- Gjør en autentisert POST-forespørsel med

model-parameteren satt til den valgte MiniMax-modellen og en payload som følger CometAPIs chat/completion-schema. - Juster parametere (temperature, max_tokens, systemmeldinger, streaming) etter arbeidsflyten din.

Grunnleggende om autentisering og endepunkt

- Base URL:

https://api.cometapi.com/v1(OpenAI-sti-er som/chat/completionsstøttes). - Header:

Authorization: Bearer YOUR_COMETAPI_KEY - Content-Type:

application/json - Model-felt: bruk den eksakte modellstrengen fra CometAPIs modellkatalog (eksempler:

"minimax-m2.5")

Eksempel 1 — Rask curl (REST, OpenAI-stil)

# Replace $COMETAPI_KEY with your CometAPI key

curl -s -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer $COMETAPI_KEY" \

-H "Content-Type: "application/json" \

-d '{

"model": "minimax-m2.5",

"messages": [

{"role":"system","content":"You are a concise, safety-conscious coding assistant."},

{"role":"user","content":"Refactor this synchronous Python function to async and add basic error handling:\n\n```\ndef fetch(user_id):\n resp = http_get(f\"https://api.example.com/users/{user_id}\")\n return resp.json()\n```"}

],

"max_tokens": 800,

"temperature": 0.0,

"stream": false

}'

Notater:

- Bruk modellstrengen nøyaktig som vist i CometAPIs katalog.

stream: truestøttes for strømmende utdata (håndter server-sent events eller oppdelte responser hvis du ønsker delvise tokens).

Eksempel 2 — Python (requests) for en chat completion

import os, requests

COMET_KEY = os.environ.get("COMETAPI_KEY") # recommended

URL = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "minimax-m2.5", # or "minimax/minimax-m2.5" — verify Comet's model page

"messages": [

{"role": "system", "content": "You are a helpful engineer who returns clear, tested code."},

{"role": "user", "content": "Write a pytest for the following function that asserts edge cases..."}

],

"temperature": 0.1,

"max_tokens": 1000,

}

r = requests.post(URL, json=payload, headers=headers, timeout=120)

r.raise_for_status()

out = r.json()

print(out["choices"][0]["message"]["content"])

Eksempel 3 — Bruke litellm / CometAPI-integrasjon (praktisk Python-lag)

CometAPI støttes av flere fellesskaps-SDK-er og adaptere. LiteLLM-dokumentasjonen viser en kompakt flyt der du setter COMETAPI_KEY og kaller modellen ved navn. Dette er flott for prototyping:

import os

from litellm import completion

os.environ["COMETAPI_KEY"] = "your_cometapi_key_here"

messages = [{"role":"user", "content":"Explain async/await in Python in 3 bullets."}]

resp = completion(model="minimax-m2.5", messages=messages)

print(resp.choices[0].message.content)

Litellm-/Comet-integrasjoner tilbyr nyttige verktøy (streaming, async, eksplisitt api_key-parameter) som speiler mange eksisterende OpenAI SDK-mønstre.

Hvordan du bør utforme forespørsler og systemmeldinger for M2.5

Vær eksplisitt om rolle og begrensninger

Gi M2.5 en klar systemrolle når du ber om kode. Eksempel:

{"role": "system","content": "You are MiniMax M2.5, an assistant specialized in robust, readable, and well-documented code. Use Python 3.11 conventions, include type hints, and provide brief unit tests."}

Bruk stegvis nedbryting for komplekse problemer

Når du ber M2.5 implementere komplekse funksjoner, bruk en kort nedbryting:

- Be om en designskisse.

- Be om grensesnittsignaturer.

- Be om implementasjon og tester.

Dette reduserer risiko for hallusinasjoner og gir modulære, lettere gjennomgåelige svar.

Temperatur, max_tokens og sikkerhet

- For deterministisk kode: sett

temperaturenær 0,0. - For utforskende design:

temperaturepå 0,2–0,5 kan bringe frem kreative tilnærminger. - Hold

max_tokensromslig for store refaktoriseringer eller lange testpakker.

Be om enhetstester og forklaring

Når du ber om kode, be også om enhetstester og en kort forklaring av algoritmen. Det hjelper deg å oppdage subtile feil og få kjørbare artefakter på første forsøk.

Langvarig inferens og tilstandssporing

M2.5-modellen har en utmerket mekanisme for tilstandssporing, som effektivt sikrer kontinuitet og retning i tenkningen over lange tidssekvenser ved å fokusere på et begrenset antall mål om gangen fremfor å prosessere alt parallelt. M2.5 er utstyrt med kontekstsensitive funksjoner, som muliggjør effektiv oppgaveutførelse og optimalisert konteksthåndtering.

Praktiske tips for bruk av M2.5 i produksjon

MiniMax-M2.5 er finjustert for flerstegs verktøybruk og kode. Nedenfor er praktiske, erfaringsbaserte tips for å få best resultater i produksjon.

Prompt-engineering og systemmeldinger

- Bruk eksplisitte systemmeldinger for rolle og begrensninger. For kodeoppgaver, inkluder påkrevd runtime/test-rammeverk (f.eks. “Returner en pytest kompatibel med Python 3.11”).

- Gi kontekst: for agentiske eller flerstegs jobber, inkluder stegmetadata og verktøybeskrivelser som strukturert JSON eller punktlister. M2.5 responderer godt på strukturerte inndata fordi den er optimalisert for verktøybruk.

Funksjons-/verktøykall

- Hvis du bruker CometAPI som gateway for verktøykall, sørg for at ekstra felt (f.eks.

function_calli OpenAI-stil) samsvarer med CometAPI-/modellforventninger. Bekreft modellstøtte på Comets modellsider siden verktøysemantikk kan variere per leverandør. - For robust orkestrering, bryt store oppgaver i mindre kall og oppretthold deterministiske sjekkpunkter. M2.5 er sterk i å følge flerstegsinstruksjoner, men du får mest pålitelig atferd ved å validere etter hvert steg.

Temperatur, max_tokens og kostnadskontroll

- For kodegenerering eller refaktorering, sett

temperaturelavt (0,0–0,2) og brukmax_tokenstilpasset forventet utstørrelse. - For utforskende forespørsler, øk

temperature, men følg med på økt token-bruk. Når du ruter via CometAPI, sammenlign leverandørpriser og fallback-regler — CometAPI lister tokenpriser per modellinstans i katalogen.

Kontekstvindu og lange dokumenter

- M2.5-varianter støtter ofte lange kontekster (sjekk modellspec for kontektslengde). For svært lange dokumenter, del opp og summer — mat deretter inn sammendragene pluss relevante biter, i stedet for å sende hele filer i én forespørsel.

Sikkerhet, skadelig innhold og mitigering av hallusinasjoner

- Bruk rekkverk: systemmeldinger, eksterne validatorer og testpakker (f.eks. enhetstester for generert kode) reduserer risiko.

- Valider eksterne referanser: hvis modellen siterer fakta eller kode fra nettet, verifiser programmatisk før du stoler på eller leverer resultatene.

Vanlige fallgruver og hvordan du unngår dem

Fallgruve: Å stole for mye på ett enkelt modellutslag

Tiltak: Kjør tester, statiske sjekker, og for kritisk logikk, be om flere uavhengige completions og sammenlign. CometAPI tillater bytte mellom flere modeller, og du kan bytte når som helst ved å bruke OpenAIs chat-format.

Fallgruve: Høy temperatur for produksjonskode

Tiltak: Hold temperature lav; hvis du trenger kreative alternativer, be om flere lavtemperatur-varianter eller be modellen forklare forskjellene.

Fallgruve: Ignorere modellversjonering

Tiltak: Spor modellnavn og leverandørstrenger i deploy-manifestene dine. Når du bytter fra MiniMax-M2.5 til MiniMax-M2.5-highspeed eller til en annen leverandør, behandle det som en release-endring og kjør regresjonstester.

Endelige anbefalinger og realistiske forventninger

MiniMax-M2.5 er et merkbart steg fremover for kode-sentriske, agentiske LLM-er — den lover sterk kodegenerering, flersamtale-resonnering og verktøysikker atferd. Hvis teamets prioritet er å bygge robuste utviklerverktøy, agentrammeverk eller kodeassistenter, fortjener M2.5 en plass i sammenligningsmatrisen din. Å bruke CometAPI som en samlet gateway kan akselerere eksperimentering og la deg bytte leverandører eller A/B-teste modeller uten å måtte omarbeide hele integrasjonen.

Noen pragmatiske hovedpoenger:

- Prototyp raskt i CometAPIs playground, lås deretter modellidentifikatorer i koden.

- Bruk lav temperatur, be om tester og forklaringer, og kjør alltid automatisert validering.

- Behandle modellen som en kraftig med-utvikler — ikke en ufeilbarlig en: bruk menneskelig gjennomgang, CI-pipelines og telemetri.

Utviklere kan få tilgang til MiniMax-M2.5 via CometAPI nå. For å begynne, utforsk modellens kapabiliteter i Playground og se API-veiledningen for detaljerte instruksjoner. Før du får tilgang, må du forsikre deg om at du er logget inn på CometAPI og har skaffet API-nøkkelen. CometAPI tilbyr en pris som er langt lavere enn den offisielle prisen for å hjelpe deg å integrere.

Klar til å starte?→ Registrer deg for M2.5 i dag!

Hvis du vil ha flere tips, guider og nyheter om AI, følg oss på VK, X og Discord!