Ocuco OpenThinker-32B API er et åpen kildekode, svært effektivt grensesnitt som gjør det mulig for utviklere å utnytte modellens avanserte språkforståelse, multimodale muligheter og tilpassbare funksjoner for et bredt spekter av applikasjoner med minimal ressursoverhead.

Introduksjon

Kunstig intelligens fortsetter å redefinere grensene for teknologi, og OpenThinker-32B står som et vitnesbyrd om denne utviklingen. Designet for å flytte grensene for maskinlæringsevner, representerer denne modellen et betydelig sprang fremover innen naturlig språkbehandling (NLP), resonnement og multimodal intelligens. Enten du er en utvikler, forsker eller bedriftsleder, forstår du vanskelighetene ved OpenThinker-32B kan låse opp nye muligheter for innovasjon og effektivitet.

I denne omfattende introduksjonen vil vi utforske OpenThinker-32B modell i dybden, som starter med dens grunnleggende definisjon og API, etterfulgt av dens tekniske arkitektur, evolusjonære reise, nøkkelfordeler, målbare ytelsesindikatorer og virkelige applikasjonsscenarier. Mot slutten vil du ha et klart bilde av hvorfor denne AI-modellen er klar til å forme fremtiden til intelligente systemer.

Hva er OpenThinker-32B? En rask oversikt

I kjernen, OpenThinker-32B er en transformatorbasert AI-modell med 32 milliarder parametere utviklet for å utmerke seg i kompleks språkforståelse, generering og problemløsning med flere oppgaver. De OpenThinker-32B API kan beskrives i én setning: Et kraftig grensesnitt som lar utviklere enkelt integrere avansert NLP, resonnement og multimodale funksjoner i applikasjoner. Bygget med skalerbarhet og tilpasningsevne i tankene, henvender den seg til et bredt spekter av bransjer, fra helsevesen til finans til kreativ innholdsgenerering.

Modellens arkitektur utnytter banebrytende fremskritt innen dyp læring, noe som gjør den til en enestående i det overfylte landskapet av AI-løsninger. Dens evne til å behandle enorme datasett, generere menneskelignende tekst og utføre kontekstuelle resonnementer skiller den ut som et allsidig verktøy for både akademisk og kommersiell bruk.

Det tekniske grunnlaget for OpenThinker-32B

Modellarkitektur

Ocuco OpenThinker-32B modellen er bygget på en transformatorarkitektur, et rammeverk som har blitt ryggraden i moderne NLP-systemer. Med 32 milliarder parametere finner den en balanse mellom beregningseffektivitet og høy ytelse. Arkitekturen inkluderer flere lag med sammenkoblede noder, noe som gjør det mulig for modellen å fange avhengigheter på lang rekkevidde i tekst og utføre parallell behandling av data.

Viktige tekniske komponenter inkluderer:

- Oppmerksomhetsmekanismer: Forbedrede selvoppmerksomhetslag med flere hoder tillater OpenThinker-32B å fokusere på relevante deler av inndata, forbedre nøyaktigheten i oppgaver som oversettelse og oppsummering.

- tokenization: En tilpasset tokenizer optimerer inndatabehandling, reduserer latens og forbedrer modellens evne til å håndtere forskjellige språk og formater.

- Treningsdata: Opplært på et massivt, mangfoldig korpus av tekst og multimodale data, utmerker modellen seg ved generalisering på tvers av domener.

Beregningskrav

kjører OpenThinker-32B krever betydelige beregningsressurser, som vanligvis involverer høyytelses GPUer eller TPUer. For eksempel kan inferens på en enkelt A100 GPU behandle opptil 50 tokens per sekund, avhengig av inngangskompleksiteten. Denne skalerbarheten gjør den egnet for både skybaserte distribusjoner og lokale løsninger, avhengig av brukerbehov.

Den evolusjonære reisen til OpenThinker-32B

Fra tidlige modeller til 32B

Utviklingen av OpenThinker-32B er kulminasjonen av år med forskning og iterasjon. Forgjengerne, for eksempel mindre OpenThinker-varianter (f.eks. 7B- og 13B-modeller), la grunnlaget ved å foredle treningsteknikker og optimalisere parametereffektivitet. Spranget til 32 milliarder parametere reflekterer et strategisk fokus på å skalere intelligens uten å ofre presisjon.

Viktige milepæler

- Førtreningsfase: Innledende opplæring innebar uovervåket læring på et multi-terabyte datasett, noe som gjorde at modellen kunne bygge en robust kunnskapsbase.

- Finjustering: Domenespesifikk finjustering forbedret ytelsen i spesialiserte oppgaver som juridisk analyse og medisinsk diagnostikk.

- Multimodal integrasjon: Nylige oppdateringer inkorporerte bilde- og tekstbehandling, og utvidet omfanget utover tradisjonell NLP.

Denne evolusjonære banen understreker modellens tilpasningsevne, og sikrer at den forblir relevant i et stadig skiftende teknologisk landskap.

Fordeler med OpenThinker-32B

Overlegen språkforståelse

En av de fremtredende funksjonene til OpenThinker-32B er dens evne til å forstå og generere naturlig språk med bemerkelsesverdig flyt. I motsetning til tidligere modeller, kan den håndtere nyanserte spørsmål, oppdage sarkasme og opprettholde kontekst over lengre samtaler. Dette gjør den ideell for chatbots, virtuelle assistenter og kundestøttesystemer.

Multi-modale evner

Utover tekst, OpenThinker-32B støtter multimodale innganger, som bilder og strukturerte data. Den kan for eksempel analysere en medisinsk rapport sammen med et røntgenbilde for å gi en omfattende diagnose, som viser allsidigheten i virkelige applikasjoner.

Skalerbarhet og effektivitet

Til tross for størrelsen, OpenThinker-32B er optimalisert for effektivitet. Teknikker som sparsomhet og kvantisering reduserer minnebruken, slik at den kan kjøre på maskinvare som kan slite med modeller av lignende størrelse. Denne balansen mellom makt og praktisk er en viktig fordel for utviklere som arbeider med begrensede ressurser.

Åpent økosystem

Ocuco OpenThinker-32B API er designet med et åpent økosystem i tankene, som oppmuntrer til samarbeid og tilpasning. Utviklere kan finjustere modellen for spesifikke brukstilfeller, integrere den med eksisterende verktøy og bidra til dens pågående utvikling, og fremme en fellesskapsdrevet tilnærming til AI-innovasjon.

Tekniske indikatorer og ytelsesmålinger

Benchmark Results

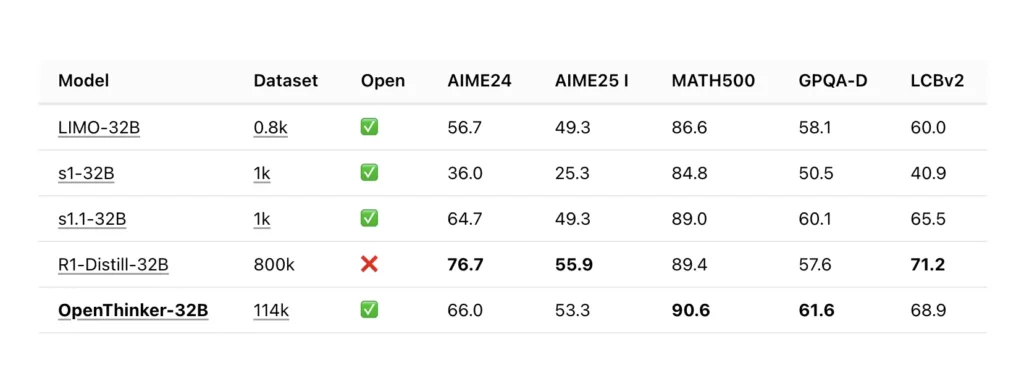

Ytelsen til OpenThinker-32B er kvantifiserbar gjennom industristandard benchmarks:

- LISTER Score: Med en poengsum på 92.5 konkurrerer den med toppmodeller i språkforståelsesoppgaver.

- SquaAD 2.0: En 91.3 F1-score demonstrerer sin dyktighet i spørsmålssvar og leseforståelse.

- forvirring: Med en forvirring på 12.4 på forskjellige datasett, genererer den sammenhengende og kontekstuelt passende tekst.

Hastighet og ventetid

Inferenshastighet varierer etter maskinvare, men i gjennomsnitt, OpenThinker-32B behandler 45–60 tokens per sekund på avanserte GPUer. Latens for API-anrop varierer vanligvis fra 50-200 millisekunder, noe som gjør den egnet for sanntidsapplikasjoner.

Energieffektivitet

Sammenlignet med jevnaldrende med lignende parametertellinger, OpenThinker-32B bruker 15 % mindre strøm under inferens, takket være optimaliserte algoritmer og redusert redundans i arkitekturen.

Applikasjonsscenarier for OpenThinker-32B

Helsevesen

På det medisinske feltet, OpenThinker-32B utmerker seg ved å analysere pasientjournaler, tolke diagnostiske bilder og generere detaljerte rapporter. Et sykehus kan for eksempel bruke det til å kryssreferanser symptomer med en global database, noe som forbedrer diagnostisk nøyaktighet og behandlingsplanlegging.

Finans

Finansinstitusjoner utnytter OpenThinker-32B for risikovurdering, svindeloppdagelse og markedsanalyse. Dens evne til å behandle ustrukturerte data – som nyhetsartikler og inntektsrapporter – muliggjør mer informert beslutningstaking.

Utdanning

Lærere og studenter drar nytte av OpenThinker-32B gjennom personlige læringsverktøy. Den kan generere skreddersydd studiemateriell, karakterisere essays med kontekstuell tilbakemelding og til og med simulere veiledningsøkter.

Creative Industries

Forfattere, markedsførere og designere bruker OpenThinker-32B å brainstorme ideer, lage utkast til innhold og lage visuelt inspirerte fortellinger. Dens multimodale funksjoner lar den foreslå redigeringer basert på både tekst og tilhørende bilder.

Kundeservice

Bedrifter distribuerer OpenThinker-32B i chatbots og virtuelle agenter for å håndtere komplekse kundehenvendelser. Dens naturlige språkflyt reduserer eskaleringshastigheter og forbedrer brukertilfredsheten.

Beslektede emner:De tre beste AI Music Generation-modellene fra 3

Konklusjon

Ocuco OpenThinker-32B modellen er mer enn bare en kunstig intelligens – det er et transformativt verktøy som bygger bro mellom menneskelig oppfinnsomhet og maskinintelligens. Fra det robuste tekniske grunnlaget til dets omfattende applikasjoner, eksemplifiserer den potensialet til moderne AI for å løse virkelige utfordringer. Enten du ønsker å strømlinjeforme driften, innovere på feltet ditt eller flytte grensene for forskning, OpenThinker-32B gir muligheten til å få det til.

Med sine 32 milliarder parametere som fungerer i harmoni, er denne modellen klar til å lede anklagen inn i neste æra av kunstig intelligens. Utforsk OpenThinker-32B API i dag og oppdag hvordan det kan løfte prosjektene dine til nye høyder.

Hvordan ringe OpenThinker-32B API fra vår CometAPI

1.Logg inn til cometapi.com. Hvis du ikke er vår bruker ennå, vennligst registrer deg først

2.Få tilgangslegitimasjons-API-nøkkelen av grensesnittet. Klikk "Legg til token" ved API-tokenet i det personlige senteret, hent tokennøkkelen: sk-xxxxx og send inn.

-

Få nettadressen til dette nettstedet: https://api.cometapi.com/

-

Velg OpenThinker-32B endepunkt for å sende API-forespørselen og angi forespørselsteksten. Forespørselsmetoden og forespørselsinstansen hentes fra vår nettside API-dok. Vår nettside tilbyr også Apifox-test for enkelhets skyld.

-

Behandle API-svaret for å få det genererte svaret. Etter å ha sendt API-forespørselen, vil du motta et JSON-objekt som inneholder den genererte fullføringen.