Qwen-bilde er en bildegenerering og bilderedigering grunnmodell i Qwen-familien designet for tekstgjengivelse med høy kvalitet, presis redigering, og generell tekst-til-bilde-generering. Den er designet for å utføre tekstbevisst generering, tospråklig tekstgjengivelse (spesielt sterk i kinesisk og engelsk), og finkornet redigering i kontekstPressemeldingen legger vekt på en kombinert forstå + generere designfilosofi (oppgaver med bildeforståelse og generative oppgaver trent i en enhetlig pipeline).

Nøkkelegenskaper

- Innebygd/høykvalitets tekstgjengivelse i bilder – utmerker seg ved å produsere lesbar, semantisk nøyaktig tekst i genererte bilder (plakater, emballasje, skjermbilder) – et område mange tidligere bildemodeller slet med.

- Høy-kvalitets multimodal utgang — produserer fotorealistiske og stiliserte bilder med gode detaljer og språkbevisst layout.

- Stiloverføring og detaljforbedring — kan anvende konsistente kunstneriske stiler eller forbedre lokale detaljer samtidig som scenesammenheng bevares.

Tekniske detaljer – hvordan Qwen-Image fungerer

Arkitektur og komponenter (nøkkelord: MMDiT, Qwen2.5-VL). Modellen bruker en MMDiT-basert diffusjonstransformator for bildesyntese kombinert med en visuell språkkoder (Qwen2.5-VL) for å tolke instruksjoner og visuell kontekst. Denne separasjonen lar modellen behandle semantisk veiledning og pikselutseende annerledes, noe som forbedrer tekstgjengivelsen og redigeringskonsistensen. Det offisielle arkivet og den tekniske rapporten bemerker en 20B-parameter-ryggrad for hoved-T2I-modellen.

Opplæringspipeline (nøkkelord: læreplanlæring, datapipeline). For å løse vanskelig tekstgjengivelse bruker Qwen-Image en progressiv læreplan: den starter med enklere bilder som ikke er tekst, og trener gradvis på mer komplekse tekstrike eksempler opp til inndata på avsnittsnivå. Teamet konstruerte en omfattende prosess som inkluderer storskala innsamling, nøye filtrering, syntetisk forstørrelse og balansering for å sikre at modellen ser mange realistiske tekst-/bildekomposisjoner under trening. Denne strategiske læreplanen er en viktig grunn til at modellen utmerker seg i flerspråklig tekstgjengivelse.

Redigeringsmekanisme (nøkkelord: dobbelkoding, VAE + VL-koder). For redigering, systemet mater originalbildet to ganger: én gang inn i Qwen2.5-VL-koderen for semantisk kontroll og en gang inn i en VAE-koder for informasjon om rekonstruktivt utseendeDesignet med dobbel koding gjør at redigeringsmodulen bevarer identitet og visuell gjengivelse, samtidig som det tillater semantiske modifikasjoner – for eksempel å erstatte et objekt eller endre tekstinnhold uten å forringe urelaterte områder.

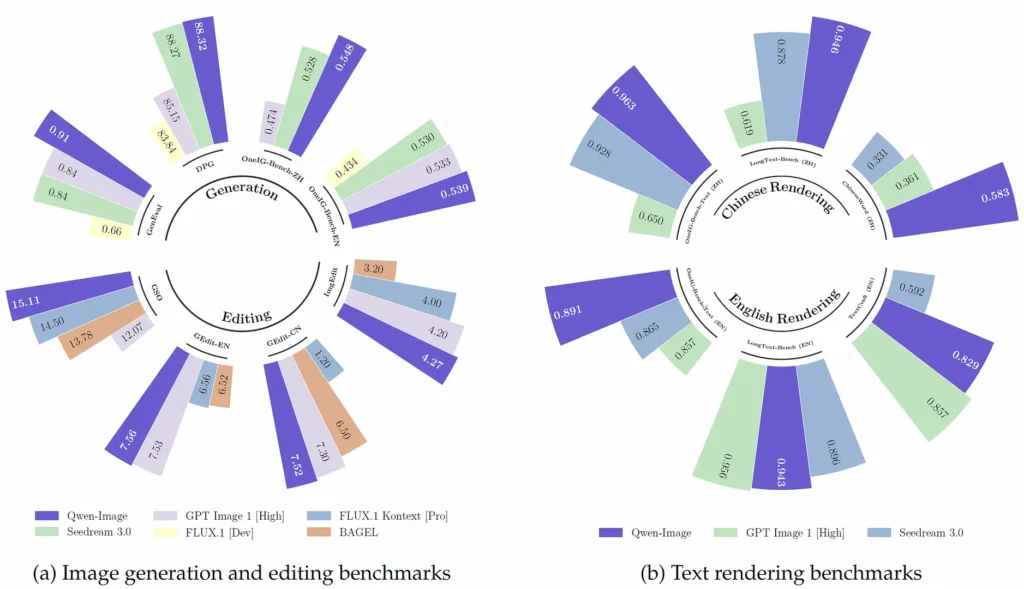

Benchmark ytelse

Qwen-Image oppnår SOTA- eller nær-SOTA-ytelse på tvers av flere offentlige benchmarks for både generering og redigering, med spesielt sterke resultater i tekstgjengivelsesoppgaver og komposisjonsbenchmarks i den virkelige verden (f.eks. T2I-CoreBench og kuraterte bilderedigeringspakker).

Hvordan Qwen-Image sammenlignes med andre ledende modeller

Relative styrker: tekstgjengivelse og tospråklig tekstnøyaktighet er modellens særegne fordeler kontra mange generative konkurrenter (f.eks. DALL·E 3, SDXL, Midjourney), som ofte er sterkere i rent kunstnerisk komposisjon eller stilistisk mangfold, men svakere ved tett flerlinjers eller kinesisk tekstlayout. Flere fellesskapssammenligninger og modellforfatternes referansetabeller støtter denne karakteriseringen.

Relative avveininger: Sammenlignet med lukkede, tungt innstilte kommersielle systemer, kan Qwen-Image kreve post-prosessering eller hurtig/adapter-justering for å oppnå identisk realisme i noen sammenhenger (buet overflateforvridning, fotorealistisk komposisjon), per uavhengige tester. For brukere som prioriterer malbaserte design, emballasjemodeller eller tospråklige tekstoppsett, Qwen-Image pleier å være å foretrekke.

Typiske og verdifulle brukstilfeller

- Emballasje- og produktmodeller: nøyaktig tekst og flerlinjeoppsett for etiketter og emballasjetester.

- Reklame- og designutkast: rask prototyping der tekstgjengivelse er viktig (plakater, bannere).

- Dokumentert bildegenerering: generere bilder som må inneholde lesbart innhold (menyer, skilt, grensesnitt).

- Bilderedigeringsrørledninger: målrettede redigeringer (tekstutskifting, legge til/fjerning av objekter) som bevarer stil og perspektiv.

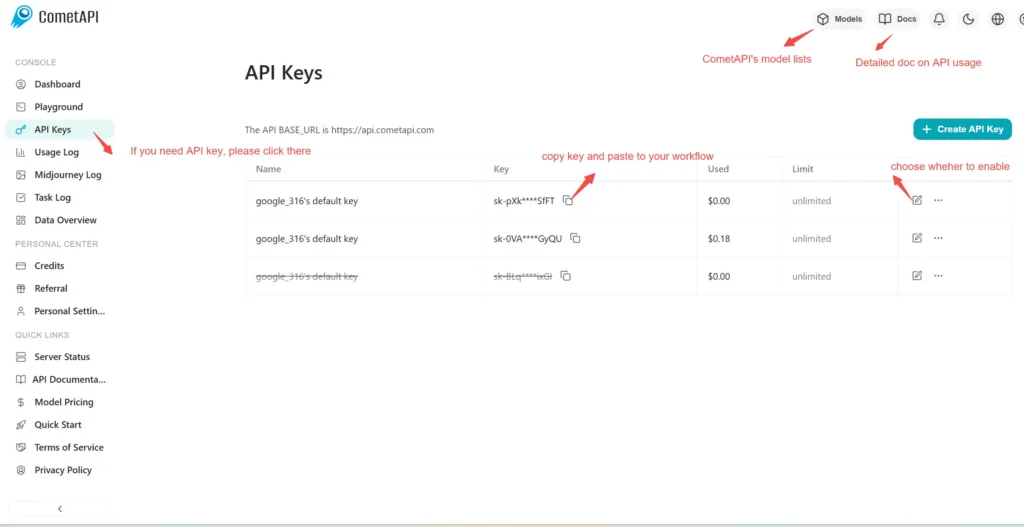

Slik kaller du qwen-image API fra CometAPI

qwen-image API-priser i CometAPI, 20 % avslag på den offisielle prisen:

Nødvendige trinn

- Logg på cometapi.com. Hvis du ikke er vår bruker ennå, vennligst registrer deg først.

- Logg inn på din CometAPI-konsoll.

- Få tilgangslegitimasjons-API-nøkkelen til grensesnittet. Klikk "Legg til token" ved API-tokenet i det personlige senteret, hent tokennøkkelen: sk-xxxxx og send inn.

Bruk metoden

- Velg endepunktet «qwen-image» for å sende API-forespørselen og angi forespørselsteksten. Forespørselsmetoden og forespørselsteksten er hentet fra nettstedets API-dokumentasjon. Nettstedet vårt tilbyr også Apifox-testing for enkelhets skyld.

- Erstatt med din faktiske CometAPI-nøkkel fra kontoen din.

- Sett inn spørsmålet eller forespørselen din i innholdsfeltet – det er dette modellen vil svare på.

- . Behandle API-svaret for å få det genererte svaret.

CometAPI tilbyr et fullt kompatibelt REST API – for sømløs migrering. Viktige detaljer for bildegenerering:

- Grunnadresse: https://api.cometapi.com/v1/images/generations

- Modellnavn: qwen-bilde

- Autentisering:

Bearer YOUR_CometAPI_API_KEYheader - Innholdstype:

application/json.

«qwen-image»-modellen krever ikke parameteren «n» og kan bare sende ut ett bilde.