19.–20. november 2025 ga OpenAI ut to relaterte, men forskjellige oppgraderinger: GPT-5.1-Codex-Max, en ny agentisk kodemodell for Codex som vektlegger koding over lengre tid, tokeneffektivitet og «komprimering» for å opprettholde flervindusøkter; og GPT-5.1 Pro, en oppdatert Pro-tier ChatGPT-modell finjustert for klarere og mer kapable svar i komplekst og profesjonelt arbeid.

Hva er GPT-5.1-Codex-Max, og hvilket problem prøver det å løse?

GPT-5.1-Codex-Max er en spesialisert Codex-modell fra OpenAI, innstilt for kodingsarbeidsflyter som krever vedvarende, langsiktig resonnering og utførelseDer vanlige modeller kan bli utløst av ekstremt lange kontekster – for eksempel refaktorering av flere filer, komplekse agentløkker eller vedvarende CI/CD-oppgaver – er Codex-Max designet for å komprimer og administrer sesjonsstatus automatisk på tvers av flere kontekstvinduer, noe som gjør det mulig å fortsette å fungere sammenhengende ettersom et enkelt prosjekt strekker seg over mange tusen (eller flere) tokens. OpenAI posisjonerer Codex-Max som det neste steget i å gjøre kodekompatible agenter genuint nyttige for utvidet ingeniørarbeid.

Hva er GPT-5.1-Codex-Max, og hvilket problem prøver det å løse?

GPT-5.1-Codex-Max er en spesialisert Codex-modell fra OpenAI, innstilt for kodingsarbeidsflyter som krever vedvarende, langsiktig resonnering og utførelseDer vanlige modeller kan bli utløst av ekstremt lange kontekster – for eksempel refaktorering av flere filer, komplekse agentløkker eller vedvarende CI/CD-oppgaver – er Codex-Max designet for å komprimer og administrer sesjonsstatus automatisk på tvers av flere kontekstvinduer, slik at det kan fortsette å fungere sammenhengende som et enkelt prosjekt som spenner over mange tusen (eller flere) tokens.

Den beskrives av OpenAI som «raskere, mer intelligent og mer token-effektiv i alle trinn av utviklingssyklusen», og er eksplisitt ment å erstatte GPT-5.1-Codex som standardmodellen i Codex-overflater.

Funksjonsoversikt

- Komprimering for kontinuitet i flere vinduer: beskjærer og bevarer kritisk kontekst for å fungere sammenhengende over millioner av tokens og timer. 0

- Forbedret tokeneffektivitet sammenlignet med GPT-5.1-Codex: opptil ~30 % færre tenketokens for lignende resonneringsinnsats på noen kodebenchmarks.

- Langtidsholdbarhet: internt observert å opprettholde agentløkker over flere timer/fler dager (OpenAI dokumenterte >24-timers interne kjøringer).

- Plattformintegrasjoner: tilgjengelig i dag i Codex CLI, IDE-utvidelser, sky og kodegjennomgangsverktøy; API-tilgang kommer snart.

- Støtte for Windows-miljøet: OpenAI bemerker spesifikt at Windows støttes for første gang i Codex-arbeidsflyter, noe som utvider rekkevidden til utviklere i den virkelige verden.

Hvordan er det sammenlignet med konkurrerende produkter (f.eks. GitHub Copilot, andre AI-er for koding)?

GPT-5.1-Codex-Max presenteres som en mer autonom samarbeidspartner med langsiktig horisont sammenlignet med verktøy for fullføring per forespørsel. Mens Copilot og lignende assistenter utmerker seg ved fullføringer på kort sikt i redigeringsprogrammet, ligger Codex-Maxs styrker i å orkestrere flertrinnsoppgaver, opprettholde sammenhengende tilstand på tvers av økter og håndtere arbeidsflyter som krever planlegging, testing og iterasjon. Når det er sagt, vil den beste tilnærmingen i de fleste team være hybrid: bruk Codex-Max for kompleks automatisering og vedvarende agentoppgaver, og bruk lettere assistenter for fullføringer på linjenivå.

Hvordan fungerer GPT-5.1-Codex-Max?

Hva er «komprimering», og hvordan muliggjør det langvarig arbeid?

Et sentralt teknisk fremskritt er kompakte– en intern mekanisme som beskjærer økthistorikken samtidig som den bevarer de viktigste kontekstelementene, slik at modellen kan fortsette sammenhengende arbeid på tvers flere kontekstvinduer. I praksis betyr det at Codex-økter som nærmer seg kontekstgrensen, blir komprimert (eldre eller lavere verdi tokener oppsummert/bevart), slik at agenten har et nytt vindu og kan fortsette å iterere gjentatte ganger til oppgaven er fullført. OpenAI rapporterer interne kjøringer der modellen jobbet kontinuerlig med oppgaver i mer enn 24 timer.

Adaptiv resonnering og tokeneffektivitet

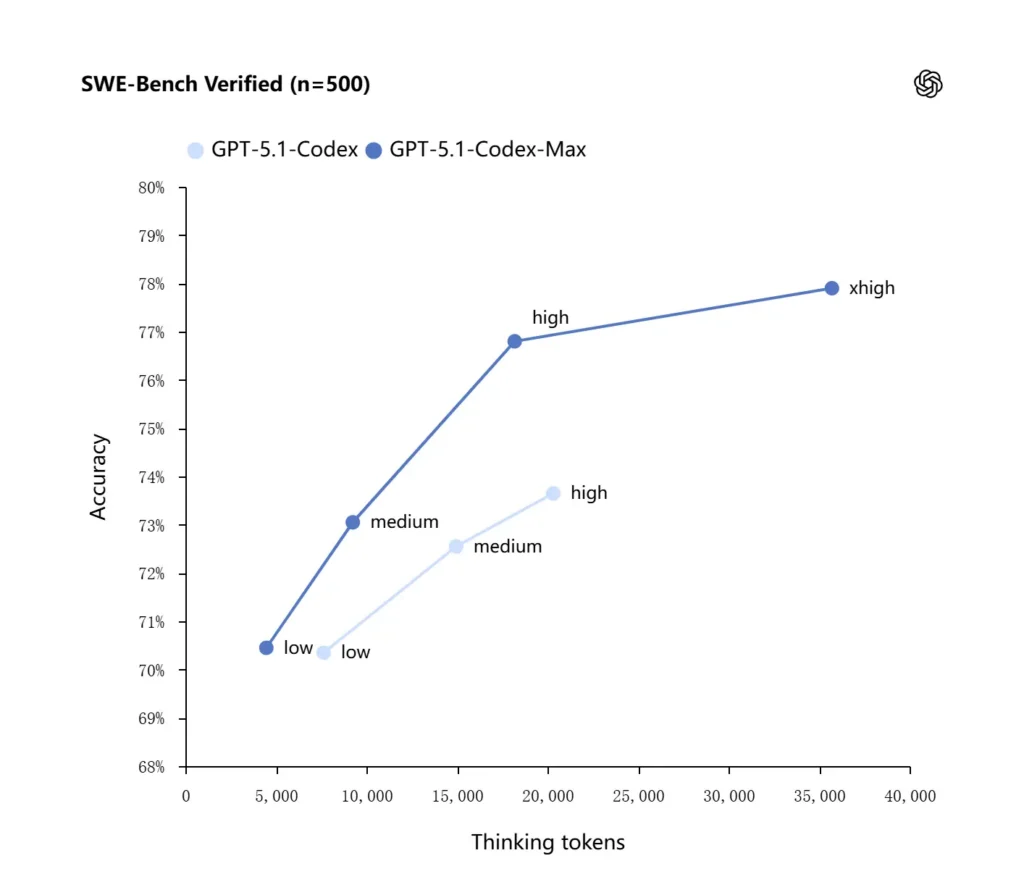

GPT-5.1-Codex-Max bruker forbedrede resonneringsstrategier som gjør den mer token-effektiv: i OpenAIs rapporterte interne benchmarks oppnår Max-modellen lignende eller bedre ytelse enn GPT-5.1-Codex, samtidig som den bruker betydelig færre "tenkende" tokens – OpenAI siterer omtrent 30 % færre Tenketokens på SWE-benken Verifisert når de kjører med lik resonneringsinnsats. Modellen introduserer også en "Ekstra høy (xhigh)" resonneringsinnsatsmodus for ikke-latensfølsomme oppgaver som lar den bruke mer intern resonnering for å få resultater av høyere kvalitet.

Systemintegrasjoner og agentverktøy

Codex-Max distribueres innenfor Codex-arbeidsflyter (CLI, IDE-utvidelser, sky og kodegjennomgangsflater) slik at det kan samhandle med faktiske utviklerverktøykjeder. Tidlige integrasjoner inkluderer Codex CLI og IDE-agenter (VS Code, JetBrains, etc.), med API-tilgang planlagt å følge. Designmålet er ikke bare smartere kodesyntese, men en AI som kan kjøre flertrinns arbeidsflyter: åpne filer, kjøre tester, fikse feil, refaktorere og kjøre på nytt.

Hvordan presterer GPT-5.1-Codex-Max på benchmarks og i virkeligheten?

Vedvarende resonnering og oppgaver med lang horisont

Evalueringer peker på målbare forbedringer i vedvarende resonnering og oppgaver med langsiktig sikt:

- OpenAI interne evalueringerCodex-Max kan jobbe med oppgaver i «mer enn 24 timer» i interne eksperimenter, og at integrering av Codex med utviklerverktøy økte interne produktivitetsmål for ingeniører (f.eks. bruk og gjennomstrømning av pull-forespørsler). Dette er OpenAIs interne påstander og indikerer forbedringer på oppgavenivå i produktivitet i den virkelige verden.

- **Uavhengige evalueringer (METR)**METRs uavhengige rapport målte observert 50 % tidshorisont (en statistikk som representerer mediantiden modellen koherent kan opprettholde en lang oppgave) for GPT-5.1-Codex-Max på omtrent 2 timer 40 minutter (med et bredt konfidensintervall), opp fra GPT-5s 2 timer og 17 minutter i sammenlignbare målinger – en betydelig forbedring i trenden i vedvarende koherens. METRs metodikk og konfidensintervall vektlegger variasjon, men resultatet støtter fortellingen om at Codex-Max forbedrer praktisk ytelse over lengre tid.

Kodereferanser

OpenAI rapporterer forbedrede resultater på evalueringer av frontierkoding, spesielt SWE-bench Verified der GPT-5.1-Codex-Max overgår GPT-5.1-Codex med bedre tokeneffektivitet. Selskapet fremhever at Max-modellen gir bedre resultater for samme "middels" resonneringsinnsats, samtidig som den bruker omtrent 30 % færre tenketokens. For brukere som tillater lengre intern resonnering, kan xhigh-modusen ytterligere forbedre svarene på bekostning av latens.

| GPT-5.1-Codex (høy) | GPT‑5.1-Codex-Max (xhigh) | |

| SWE-benk verifisert (n=500) | 73.7% | 77.9% |

| SWE-Lancer IC SWE | 66.3% | 79.9% |

| Terminalbenk 2.0 | 52.8% | 58.1% |

Hvordan er GPT-5.1-Codex-Max sammenlignet med GPT-5.1-Codex?

Forskjeller i ytelse og formål

- Omfang: GPT-5.1-Codex var en høytytende kodevariant av GPT-5.1-familien; Codex-Max er eksplisitt en agentisk, langsiktig etterfølger ment å være den anbefalte standarden for Codex og Codex-lignende miljøer.

- Token-effektivitet: Codex-Max viser betydelige effektivitetsgevinster for tokener (OpenAIs påstand om ~30 % færre tenketokener) på SWE-benk og i intern bruk.

- Konteksthåndtering: Codex-Max introduserer komprimering og innebygd håndtering av flere vinduer for å opprettholde oppgaver som overskrider et enkelt kontekstvindu; Codex tilbød ikke denne funksjonaliteten innebygd i samme skala.

- Verktøyberedskap: Codex-Max leveres som standard Codex-modell på tvers av CLI-, IDE- og kodegjennomgangsflater, noe som signaliserer en migrering for arbeidsflyter for produksjonsutviklere.

Når skal man bruke hvilken modell?

- Bruk GPT-5.1-Codex for interaktiv kodingshjelp, raske redigeringer, små refaktoreringer og brukstilfeller med lavere latens der hele den relevante konteksten enkelt får plass i ett enkelt vindu.

- Bruk GPT-5.1-Codex-Max for refaktorering av flere filer, automatiserte agentoppgaver som krever mange iterasjonssykluser, CI/CD-lignende arbeidsflyter, eller når du trenger at modellen skal ha et prosjektnivåperspektiv på tvers av mange interaksjoner.

Praktiske spørsmålsmønstre og eksempler for best resultat?

Oppfordringsmønstre som fungerer bra

- Vær tydelig om mål og begrensninger: «Refaktorer X, behold offentlig API, behold funksjonsnavn og sørg for at testene A, B og C består.»

- Gi minimal reproduserbar kontekst: lenke til den mislykkede testen, inkludere stakkspor og relevante filutdrag i stedet for å dumpe hele arkiver. Codex-Max vil komprimere historikken etter behov.

- Bruk trinnvise instruksjoner for komplekse oppgaver: del opp store jobber i en sekvens av deloppgaver, og la Codex-Max iterere gjennom dem (f.eks. «1) kjør tester 2) fiks de 3 vanligste testene 3) kjør linter 4) oppsummer endringer»).

- Be om forklaringer og uenigheter: be om både oppdateringen og en kort begrunnelse, slik at menneskelige anmeldere raskt kan vurdere sikkerhet og intensjon.

Eksempelmaler for spørsmål

Refaktoreringsoppgave

"Omstrukturer

payment/modul for å trekke ut betalingsbehandling ipayment/processor.pyHold signaturer for offentlige funksjoner stabile for eksisterende innringere. Lag enhetstester forprocess_payment()som dekker suksess, nettverksfeil og ugyldig kort. Kjør testpakken og returner mislykkede tester og en patch i enhetlig diff-format.

Feilretting + testing

«En test

tests/test_user_auth.py::test_token_refreshmislykkes med sporing . Undersøk rotårsaken, foreslå en løsning med minimale endringer og legg til en enhetstest for å forhindre regresjon. Bruk oppdatering og kjør tester.

Iterativ PR-generering

"Implementer funksjon X: legg til endepunkt"

POST /api/exportsom strømmer eksportresultater og er autentisert. Opprett endepunktet, legg til dokumenter, opprett tester og åpne en PR med sammendrag og sjekkliste over manuelle elementer.

For de fleste av disse, start med medium innsats; bytt til xhøy når du trenger at modellen skal gjøre dyp resonnement på tvers av mange filer og flere testiterasjoner.

Hvordan får du tilgang til GPT-5.1-Codex-Max

Hvor det er tilgjengelig i dag

OpenAI har integrert GPT-5.1-Codex-Max i Codex-verktøy i dag: Codex CLI, IDE-utvidelser, sky og kodegjennomgangsflyter bruker Codex-Max som standard (du kan velge Codex-Mini). API-tilgjengelighet skal forberedes; GitHub Copilot har offentlige forhåndsvisninger som inkluderer GPT-5.1 og Codex-seriens modeller.

Utviklere kan få tilgang til GPT-5.1-Codex-Max og GPT-5.1-Codex API gjennom CometAPI. For å begynne, utforsk modellfunksjonene tilCometAPI i lekeplass og se API-veiledningen for detaljerte instruksjoner. Før du får tilgang, må du sørge for at du har logget inn på CometAPI og fått API-nøkkelen. cometAPI tilby en pris som er langt lavere enn den offisielle prisen for å hjelpe deg med å integrere.

Klar til å dra? → Registrer deg for CometAPI i dag !

Hvis du vil vite flere tips, guider og nyheter om AI, følg oss på VK, X og Discord!

Hurtigstart (praktisk trinn-for-trinn)

- Sørg for at du har tilgang til: Bekreft at ChatGPT/Codex-produktplanen din (Plus, Pro, Business, Edu, Enterprise) eller at utvikler-API-planen din støtter GPT-5.1/Codex-familiemodeller.

- Installer Codex CLI- eller IDE-utvidelsen: Hvis du vil kjøre kodeoppgaver lokalt, må du installere Codex CLI eller Codex IDE-utvidelsen for VS Code / JetBrains / Xcode, etter behov. Verktøyet vil som standard bruke GPT-5.1-Codex-Max i støttede oppsett.

- Velg resonneringsinnsats: starte med medium innsats for de fleste oppgaver. For dyp feilsøking, komplekse refaktoreringer, eller når du vil at modellen skal tenke hardere og du ikke bryr deg om responsforsinkelse, bytt til høy or xhøy moduser. For raske småreparasjoner, lav er rimelig.

- Oppgi kontekst for repositoriet: Gi modellen et klart utgangspunkt – en URL for repo eller et sett med filer og en kort instruksjon (f.eks. «omstrukturer betalingsmodulen for å bruke asynkron I/O og legge til enhetstester, beholde funksjonsnivåkontrakter»). Codex-Max vil komprimere historikken når den nærmer seg kontekstgrenser og fortsette jobben.

- Iterer med tester: Etter at modellen produserer patcher, kjøre testpakker og gi tilbakemelding om feil som en del av den pågående økten. Komprimering og kontinuitet i flere vinduer lar Codex-Max beholde viktig feilkontekst og iterere.

Konklusjon:

GPT-5.1-Codex-Max representerer et betydelig skritt mot agentiske kodeassistenter som kan opprettholde komplekse, langvarige ingeniøroppgaver med forbedret effektivitet og resonnement. De tekniske fremskrittene (komprimering, resonneringsmoduser, opplæring i Windows-miljøet) gjør den usedvanlig godt egnet for moderne ingeniørorganisasjoner – forutsatt at team kombinerer modellen med konservative driftskontroller, tydelige «human-in-the-loop»-policyer og robust overvåking. For team som tar den i bruk nøye, har Codex-Max potensial til å endre hvordan programvare designes, testes og vedlikeholdes – og gjøre repeterende, krevende ingeniørarbeid til et samarbeid med høyere verdi mellom mennesker og modeller.