Hva er Llama 4?

Meta Platforms har avduket sin siste serie med store språkmodeller (LLM) under Llama 4-serien, og markerer et betydelig fremskritt innen kunstig intelligens-teknologi. Llama 4-kolleksjonen introduserer to hovedmodeller i april 2025: Llama 4 Scout og Llama 4 Maverick. Disse modellene er designet for å behandle og oversette ulike dataformater, inkludert tekst, video, bilder og lyd, og vise frem deres multimodale muligheter. I tillegg har Meta forhåndsvist Llama 4 Behemoth, en kommende modell utpekt som en av de kraftigste LLM-ene til dags dato, beregnet på å hjelpe til med å trene fremtidige modeller.

Hvordan skiller Llama 4 seg fra tidligere modeller?

Forbedrede multimodale evner

I motsetning til forgjengerne, er Llama 4 designet for å håndtere flere datamodaliteter sømløst. Dette betyr at den kan analysere og generere svar basert på tekst, bilder, videoer og lydinndata, noe som gjør den svært tilpasningsdyktig for ulike applikasjoner. ?

Introduksjon av spesialiserte modeller

Meta har introdusert to spesialiserte versjoner i Llama 4-serien:

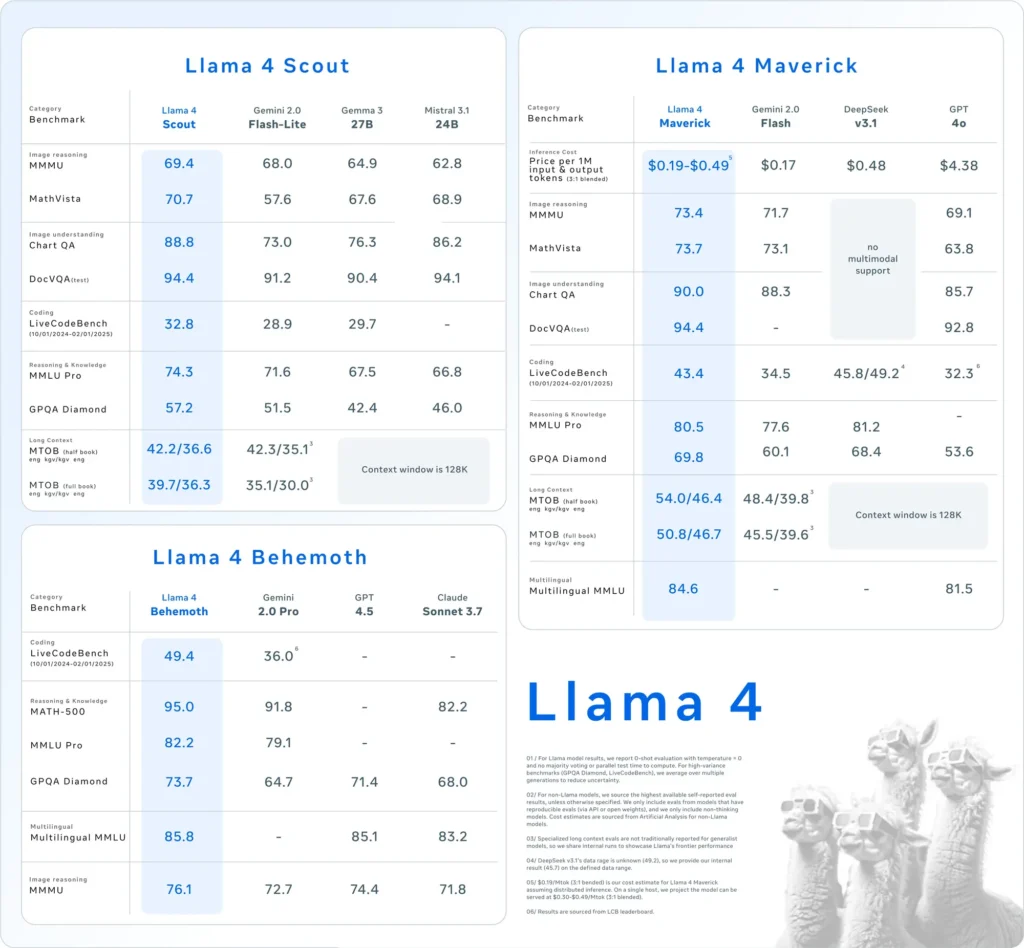

- Flamme 4 speider: En kompakt modell optimalisert for å kjøre effektivt på en enkelt Nvidia H100 GPU. Den har et kontekstvindu på 10 millioner tokener og har vist overlegen ytelse i forhold til konkurrenter som Googles Gemma 3 og Mistral 3.1 i forskjellige benchmarks. ?

- Flame 4 Maverick: En større modell som kan sammenlignes i ytelse med OpenAIs GPT-4o og DeepSeek-V3, og utmerket seg spesielt i kodings- og resonneringsoppgaver samtidig som man bruker færre aktive parametere. ?

I tillegg utvikler Meta seg Flame 4 Behemoth, en modell med 288 milliarder aktive parametere og totalt 2 billioner, som tar sikte på å overgå modeller som GPT-4.5 og Claude Sonnet 3.7 på STEM-benchmarks.

Adopsjon av blanding av eksperter (MoE) arkitektur

Llama 4 bruker en "blanding av eksperter" (MoE)-arkitektur, som deler modellen inn i spesialiserte enheter for å optimalisere ressursutnyttelsen og forbedre ytelsen. Denne tilnærmingen tillater mer effektiv behandling ved å aktivere bare relevante delsett av modellen for spesifikke oppgaver.

Hvordan er Llama 4 sammenlignet med andre AI-modeller?

Llama 4 posisjonerer seg konkurransedyktig blant ledende AI-modeller:

- Performance Benchmarks: Llama 4 Mavericks ytelse er på nivå med OpenAIs GPT-4o og DeepSeek-V3 i kodings- og resonneringsoppgaver, mens Llama 4 Scout utkonkurrerer modeller som Googles Gemma 3 og Mistral 3.1 i ulike benchmarks.

- Åpen kildekode-tilnærming: Meta fortsetter å tilby Llama-modeller som åpen kildekode, og fremmer bredere samarbeid og integrasjon på tvers av plattformer. Llama 4-lisensen pålegger imidlertid begrensninger for kommersielle enheter med over 700 millioner brukere, noe som fører til diskusjoner om modellens sanne åpenhet.

| Kategori | benchmark | Flame 4 Maverick | GPT-4o | Gemini 2.0 Flash | DeepSeek v3.1 |

|---|---|---|---|---|---|

| Bildebegrunnelse | MMMU | 73.4 | 69.1 | 71.7 | Ingen multimodal støtte |

| MathVista | 73.7 | 63.8 | 73.1 | Ingen multimodal støtte | |

| Bildeforståelse | ChartQA | 90.0 | 85.7 | 88.3 | Ingen multimodal støtte |

| DocVQA (test) | 94.4 | 92.8 | - | Ingen multimodal støtte | |

| Koding | LiveCodeBench | 43.4 | 32.3 | 34.5 | 45.8/49.2 |

| Resonnement og kunnskap | MMLU Pro | 80.5 | - | 77.6 | 81.2 |

| GPQA diamant | 69.8 | 53.6 | 60.1 | 68.4 | |

| Flerspråklig | Flerspråklig MMLU | 84.6 | 81.5 | - | - |

| Lang kontekst | MTOB (halvbok) eng→kgv/kgv→eng | 54.0/46.4 | Kontekst begrenset til 128K | 48.4/39.8 | Kontekst begrenset til 128K |

| MTOB (full bok) eng→kgv/kgv→eng | 50.8/46.7 | Kontekst begrenset til 128K | 45.5/39.6 | Kontekst begrenset til 128K |

Hvordan fungerer Llama 4 i benchmark-tester?

Benchmark-evalueringer gir innsikt i ytelsen til Llama 4-modellene:

- Flamme 4 speider: Denne modellen utkonkurrerer flere konkurrenter, inkludert Googles Gemma 3 og Mistral 3.1, på tvers av ulike benchmarks. Dens evne til å operere med et kontekstvindu på 10 millioner token på en enkelt GPU fremhever effektiviteten og effektiviteten i håndtering av komplekse oppgaver.

- Flame 4 Maverick: Sammenlignbar i ytelse med OpenAIs GPT-4o og DeepSeek-V3, utmerker Llama 4 Maverick seg i kodings- og resonneringsoppgaver samtidig som den bruker færre aktive parametere. Denne effektiviteten går ikke på bekostning av kapasitet, noe som gjør den til en sterk konkurrent i LLM-landskapet.

- Flame 4 Behemoth: Med 288 milliarder aktive parametere og totalt 2 billioner, overgår Llama 4 Behemoth modeller som GPT-4.5 og Claude Sonnet 3.7 på STEM-benchmarks. Dens omfattende parametertelling og ytelse indikerer potensialet som en grunnleggende modell for fremtidig AI-utvikling.

Disse referanseresultatene understreker Metas dedikasjon til å fremme AI-evner og posisjonere Llama 4-serien som en formidabel aktør i feltet.

Hvordan kan brukere få tilgang til Llama 4?

Meta har integrert Llama 4-modellene i sin AI-assistent, noe som gjør dem tilgjengelige på tvers av plattformer som WhatsApp, Messenger, Instagram og nettet. Denne integrasjonen lar brukere oppleve de forbedrede egenskapene til Llama 4 i kjente applikasjoner.

For utviklere og forskere som er interessert i å utnytte Llama 4 for tilpassede applikasjoner, gir Meta tilgang til modellvektene gjennom plattformer som Hugging Face og sine egne distribusjonskanaler. Denne åpen kildekode-tilnærmingen gjør det mulig for AI-fellesskapet å innovere og bygge videre på Llama 4s evner.

Det er viktig å merke seg at mens Llama 4 markedsføres som åpen kildekode, pålegger lisensen begrensninger for kommersielle enheter med over 700 millioner brukere. Organisasjoner bør gjennomgå lisensvilkårene for å sikre overholdelse av Metas retningslinjer.

Bygg raskt med Llama 4 på CometAPI

CometAPI gir tilgang til over 500 AI-modeller, inkludert åpen kildekode og spesialiserte multimodale modeller for chat, bilder, kode og mer. Dens primære styrke ligger i å forenkle den tradisjonelt komplekse prosessen med AI-integrasjon. Ved å sentralisere API-aggregering i én plattform sparer det brukere for verdifull tid og ressurser som ellers ville blitt brukt på å administrere separate plattformer og leverandører. Med den er tilgang til ledende AI-verktøy som Claude, OpenAI, Deepseek og Gemini tilgjengelig gjennom ett enkelt, enhetlig abonnement. Du kan bruke API i CometAPI til å lage musikk og kunstverk, generere videoer og bygge dine egne arbeidsflyter

CometAPI tilby en pris som er langt lavere enn den offisielle prisen for å hjelpe deg med å integrere Llama 4 API, og du vil få $1 på kontoen din etter registrering og innlogging! Velkommen til å registrere deg og oppleve CometAPI.CometAPI betaler mens du går,Llama 4 API i CometAPI er prissettingen strukturert som følger:

| Kategori | lama-4-maverick | lama-4-speider |

| API-priser | Input tokens: $0.48 / M tokens | Input tokens: $0.216 / M tokens |

| Output tokens: $1.44/M tokens | Output tokens: $1.152/M tokens |

- Vennligst se Llama 4 API for integreringsdetaljer.

- For modelllunsjinformasjon i Comet API, se https://api.cometapi.com/new-model.

- For modellprisinformasjon i Comet API, se https://api.cometapi.com/pricing

Begynn å bygge videre CometAPI i dag – registrer deg her for gratis tilgang eller skalering uten takstgrenser ved å oppgradere til en CometAPI betalt plan.

Hva er implikasjonene av utgivelsen av Llama 4?

Integrasjon på tvers av metaplattformer

Llama 4 er integrert i Metas AI-assistent på tvers av plattformer som WhatsApp, Messenger, Instagram og nettet, og forbedrer brukeropplevelsen med avanserte AI-funksjoner. ?

Innvirkning på AI-industrien

Utgivelsen av Llama 4 understreker Metas aggressive push til AI, med planer om å investere opptil 65 milliarder dollar i å utvide AI-infrastrukturen. Dette trekket gjenspeiler den økende konkurransen blant teknologigiganter om å lede innen AI-innovasjon.

Energiforbrukshensyn

De betydelige beregningsressursene som kreves for Llama 4 vekker bekymring for energiforbruk og bærekraft. Å drive en klynge på over 100,000 XNUMX GPUer krever betydelig energi, noe som fører til diskusjoner om miljøpåvirkningen av store AI-modeller. ?

Hva vil fremtiden bringe for Llama 4?

Meta planlegger å diskutere videre utvikling og anvendelser av Llama 4 på den kommende LlamaCon-konferansen 29. april 2025. AI-fellesskapet forutser innsikt i Metas strategier for å møte nåværende utfordringer og utnytte Llama 4s evner på tvers av ulike sektorer. ?

Oppsummert representerer Llama 4 et betydelig fremskritt innen AI-språkmodeller, og tilbyr forbedrede multimodale muligheter og spesialiserte arkitekturer. Til tross for utviklingsutfordringer, posisjonerer Metas betydelige investeringer og strategiske initiativ Llama 4 som en formidabel utfordrer i det utviklende AI-landskapet.