Seedance 2.0 er ByteDance sin neste generasjons AI-modell for videogenerering, offisielt lansert i mars 2026. Den støtter tekst-, bilde-, lyd- og videoinndata, kan bruke opptil 9 bilder, 3 videoklipp og 3 lydklipp som referanser, og er utformet for kontroll på regissørnivå, bevegelsesstabilitet og felles lyd-video-generering. I Artificial Analysis sine nåværende topplister basert på blindavstemning leder Seedance 2.0 både tekst-til-video- og bilde-til-video-kategoriene uten lyd, med Elo-score på henholdsvis 1269 og 1351.

Hva er Seedance 2.0?

Seedance 2.0 er ByteDance Seed sin nye generasjons modell for videoskaping. Offisielt er den bygget på en enhetlig multimodal arkitektur for felles lyd-video-generering som tar imot tekst-, bilde-, lyd- og videoinndata, og den er posisjonert som et verktøy for skapere med uvanlig brede referanse- og redigeringsmuligheter. Seedance 2.0 ble utviklet for innholdsarbeidsflyter på industrinivå, med sterkere fysisk nøyaktighet, realisme, kontrollerbarhet og stabilitet i komplekse bevegelsesscener enn den tidligere 1.5-utgaven. I motsetning til tidligere modeller som hovedsakelig fokuserte på tekst-til-video, introduserer Seedance 2.0 en fullt enhetlig multimodal genereringspipeline, som muliggjør:

- Tekst-til-video-generering

- Bilde-til-video-animasjon

- Video-til-video-redigering

- Lydsynkronisert utdata

Dette gjør den til en av de mest komplette AI-plattformene for videoskaping tilgjengelig i 2026.

Hvorfor er det viktig?

De fleste videogeneratorer er fortsatt optimalisert for en relativt smal arbeidsflyt: prompt inn, klipp ut. Seedance 2.0 går lenger ved å behandle videogenerering mer som en regissørs arbeidsflate. Ifølge ByteDance kan den bruke flere referansetyper samtidig, bevare konsistens i motivet, følge detaljerte instruksjoner mer trofast, og til og med planlegge kameraspråk på en mer «regissørmessig» måte. Denne kombinasjonen er viktig fordi de vanskeligste problemene i videogenerering ikke bare handler om estetikk, men om kontinuitet, bevegelsessammenheng og kontroll over hva som skjer over tid.

Hva er nytt og hvilke nøkkelfunksjoner finnes i Seedance 2.0?

Enhetlig multimodal generering

Den viktigste funksjonen er modellens evne til å resonnere samlet over flere modaliteter. Seedance 2.0 støtter opptil 9 bilder, 3 videoer og 3 lydklipp som referanser, sammen med instruksjoner på naturlig språk, og kan generere videoer på opptil 15 sekunder. I praksis betyr det at du ikke bare kan styre motiv og scene, men også bevegelsesstil, kamerabevegelse, spesialeffekter og lydsignaler i én og samme genereringsrunde.

Kontroll på regissørnivå

Seedance 2.0 er også bygget rundt det ByteDance beskriver som kontroll på regissørnivå. Skapere kan forme fremføring, lyssetting, skygger og kamerabevegelse ved hjelp av referansebilder, lyd og video. Modellen kan bevare en stabil motividentitet, gjengi komplekse manus nøyaktig og velge kameraspråk på en måte som gjenspeiler en slags innebygd «redigeringslogikk». For skapere er dette et stort steg forbi grunnleggende tekst-til-video.

Redigering og utvidelse, ikke bare generering

En annen bemerkelsesverdig oppgradering er at Seedance 2.0 ikke stopper ved generering. Seedance 2.0 legger til funksjoner for videoredigering og videoutvidelse, som muliggjør målrettede endringer i bestemte scener, figurer, handlinger eller plottpunkter, og gjør det mulig med kontinuerlige oppfølgingsopptak. Utviklerartikkelen forklarer også at modellen kan brukes til å «fortsette opptak» ved å utvide et klipp i stedet for å starte på nytt. Dette er viktig for arbeidsflyteffektivitet, fordi det reduserer behovet for å regenerere en hel scene bare for å rette ett segment.

Bedre håndtering av komplekse bevegelser

Seedance 2.0 er betydelig sterkere i scener med flere motiver, interaksjoner og kompliserte bevegelser. Genereringskvaliteten har forbedret seg vesentlig fra versjon 1.5, med bedre fysisk nøyaktighet, realisme og kontrollerbarhet. Seedance 2.0 sin brukbare andel i krevende bevegelsesscener når et bransjeledende SOTA-nivå i dens interne evalueringsrammeverk, samtidig som det også anerkjennes at det fortsatt trengs videre forbedringer i stabilitet i fine detaljer, realisme og livlighet.

Ytelsesbenchmark

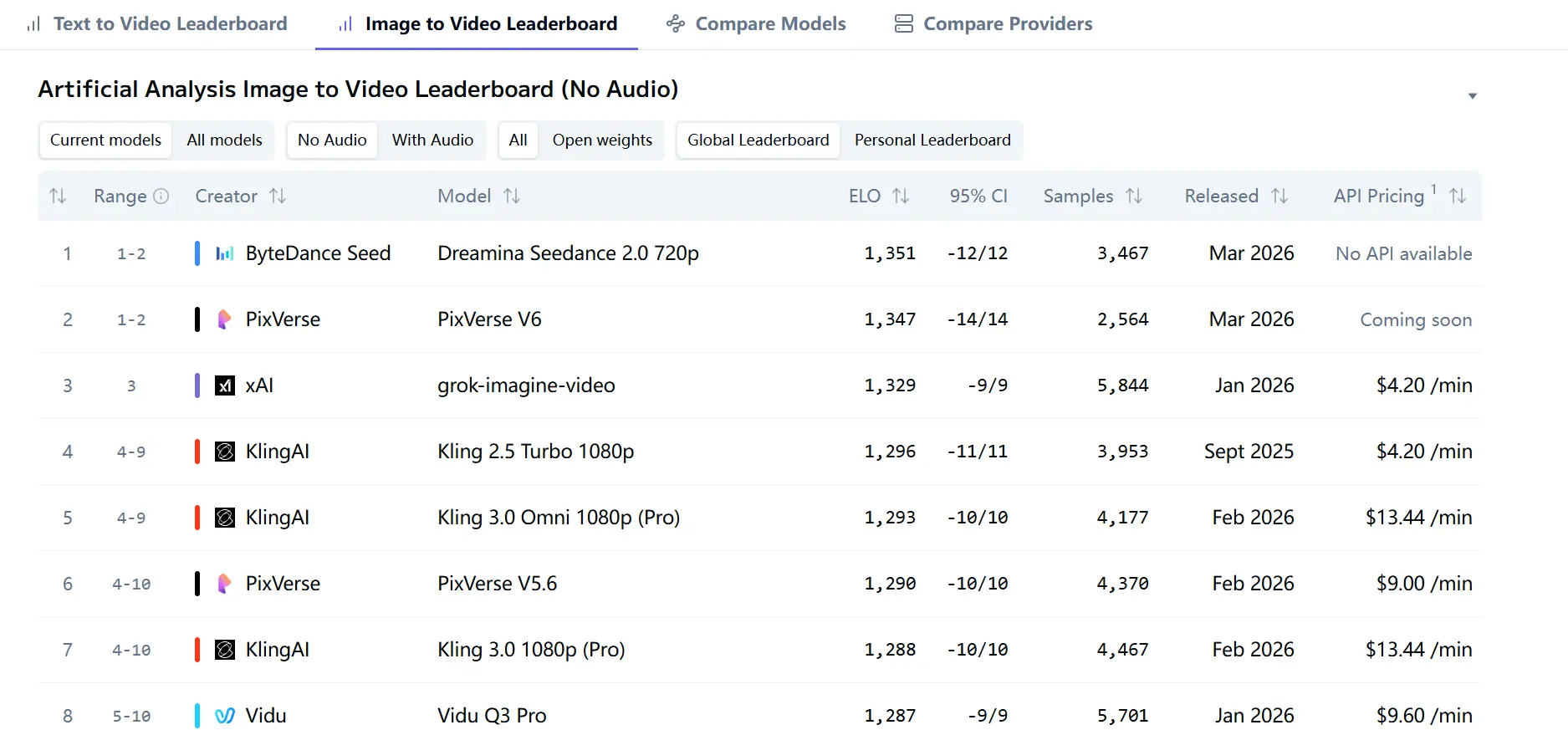

Det sterkeste tredjepartssignalet i kildene som er gjennomgått, er Artificial Analysis Video Arena. På de nåværende topplistene leder Dreamina Seedance 2.0 720p Image-to-Video Arena without audio med Elo 1351, og Text-to-Video Arena without audio med Elo 1269. Topplistene oppgir også at rangeringene kommer fra blinde brukeravstemninger, noe som er viktig fordi det måler menneskelige preferanser i stor skala i stedet for bare modellinterne måltall.

Dette er viktig fordi det betyr at Seedance 2.0 ikke bare markedsføres som kapabel; den foretrekkes for øyeblikket også av brukere i direkte sammenligningstester på to store arenaer. I tekst-til-video uten lyd leder den foran Kling 3.0 1080p (Pro), SkyReels V4, PixVerse V6 og Kling 3.0 Omni 1080p (Pro). I bilde-til-video uten lyd ligger den så vidt foran PixVerse V6 og grok-imagine-video.

Ytelsessammendrag for Seedance 2.0

| Metric | Seedance 2.0 |

|---|---|

| Image-to-Video Rank | Topp 15 globalt |

| ELO Score | ~1258 |

| Text-to-Video Rank | Topp 25 |

| Cost | ~$1.56/min |

| Strength | Balanse mellom kostnad og ytelse |

👉 Tolkning:

- Ikke alltid nr. 1 i ren kvalitet

- Men eksepsjonelt forhold mellom verdi og ytelse

Hvor god er Seedance 2.0, egentlig?

De største styrkene

Seedance 2.0 sine største styrker er tydelige: den håndterer komplekse bevegelser bedre enn mange videomodeller, den støtter flere referansemodaliteter, den tilbyr redigering og utvidelse, og den leder for tiden de mest synlige offentlige arenarangeringene innen tekst-til-video og bilde-til-video uten lyd. Forbedringer i fysisk nøyaktighet, realisme og kontrollerbarhet er nettopp de egenskapene som betyr noe når en modell går fra lekedemoer til profesjonelle arbeidsflyter.

Dagens begrensninger

ByteDance presenterer ikke Seedance som perfekt. Det er fortsatt rom for å forbedre detaljstabilitet, realisme og bevegelseslivlighet, og det pekes på gjenværende utfordringer knyttet til konsistens mellom flere motiver, presisjon i tekstgjengivelse og komplekse redigeringseffekter.

Min vurdering

Basert på kildene som er gjennomgått, fremstår Seedance 2.0 mindre som en marginal oppdatering og mer som et seriøst steg mot et produksjonsklart videosystem. Det sterkeste argumentet er ikke én enkelt prangende demo, men kombinasjonen av en bredere multimodal inputstakk, direkte redigeringskontroller, klipputvidelse og troverdig ledelse på offentlige topplister. Det gjør den til en av de viktigste videomodellene på markedet akkurat nå, spesielt for team som bryr seg like mye om kontrollerbarhet som om ren filmatisk kvalitet.

Seedance 2.0 vs Sora 2 vs Veo 3.1

Sammenligningstabell (AI-videolederne i 2026)

| Feature | Seedance 2.0 | Sora 2 | Veo 3.1 |

|---|---|---|---|

| Developer | ByteDance | OpenAI | |

| Input Types | Tekst, bilde, lyd, video | Tekst | Tekst + bilde |

| Audio Generation | ✅ Innebygd | ❌ Begrenset | ✅ |

| Max Video Length | 15–20 sek | ~25 sek | ~8 sek (utvidbar) |

| Editing Capability | ⭐ Avansert (referansebasert) | Moderat | Moderat |

| ELO Ranking | Topp 15–25 | Høy | Høy |

| Cost Efficiency | ⭐ Høy | Middels | Middels |

| Commercial Use | Ja | Begrenset (vannmerke) | Ja |

| Unique Strength | Multimodal redigering | Lang historiefortelling | Visuell kvalitet |

Viktige konklusjoner

- Seedance 2.0 = best på redigering + multimodal fleksibilitet

- Sora 2 = best på narrativ lengde

- Veo 3.1 = best på bildekvalitet i bilde-til-video

På Artificial Analysis sine nåværende rangeringer for tekst-til-video ligger Seedance 2.0 720p foran både Veo 3.1 og Sora 2 Pro i kategorien uten lyd. Det avgjør ikke enhver kvalitetsdebatt, fordi modellene skiller seg i arbeidsflyt, sikkerhetsbegrensninger og produktpakking, men det viser at Seedance 2.0 har beveget seg inn i samme toppsjikt som de mest synlige vestlige tilbudene.

Seedance 2.0 sin mest åpenbare fordel er bredden i inndataene. ByteDance sier at den kan behandle tekst, bilde, lyd og video samlet, og kan bruke så mange som 9 bilder, 3 videoer og 3 lydklipp samtidig. OpenAI sin dokumentasjon for Sora 2 oppgir derimot tekst og bilde som inndata og video pluss lyd som utdata, med tilgang via Sora-appen og sora.com; Sora 2 Pro er også tilgjengelig for ChatGPT Pro-brukere på nettet. Google sin Veo 3.1 ligger et sted imellom: den er bygget rundt bildestyrt skapelse og lydrik videogenerering, med opptil 3 referansebilder, sceneutvidelse og kontroll over første og siste bilde.

Hvordan få tilgang og hvor du kan sammenligne

Hvis du vil få tilgang til Sora 2, Veo 3.1, og xx samtidig på én plattform, anbefaler jeg CometAPI. CometAPI sitt Playgoud tilbyr direkte videogenerering med bare en enkel kommando eller noen referansebilder. Hvis du vil konfigurere ditt eget API for videogenerering programmatisk, er CometAPI enda mer verdt å vurdere. Det tilbyr API-er for Sora 2, Veo 3.1 osv., og har for tiden 20 % rabatt.

Hvordan bruke Seedance 2.0 med CometAPI

Tekst-til-video-generering

Skriv inn en beskrivelse av scenen din. Jo mer spesifikk, desto bedre — inkluder kamerabevegelse, lyssetting, stemning og stil. Seedance 2.0 sin sterke promptetterlevelse betyr at utdataene samsvarer tett med intensjonen din, noe som gjør den pålitelig for innholdsproduksjon fremfor prøving og feiling.

I CometAPI Playground kan du direkte skrive inn promter og generere videoer ved hjelp av Seedance 2.0-modellen. Dette er spesielt nyttig for innhold til sosiale medier (Reels, TikTok, YouTube Shorts), merkevarevideoer og korte narrative klipp.

Slik fungerer det:

- Åpne CometAPI

- Velg modellen Seedance 2.0

- Skriv inn prompten din

- Juster parametere (varighet, oppløsning, sideforhold)

- Kjør genereringsjobben og vent på resultatet

Bilde-til-video med CometAPI

Last opp et stillbilde — for eksempel et produktfoto, en konseptillustrasjon eller en designmockup — og bruk Seedance 2.0 sine bilde-til-video-funksjoner via CometAPI for å animere det.

Resultatet er jevn, kontekstbevisst bevegelse generert fra det visuelle inputtet ditt. Dette er ideelt for team som allerede har designressurser og ønsker å gjøre dem om til video uten en full produksjonsarbeidsflyt.

Slik fungerer det:

- Bruk

input_reference(eller tilsvarende filopplastingsfelt i Playground) - Legg til en bevegelsesfokusert prompt som beskriver hvordan scenen skal bevege seg

Eksempel på prompt:

“Kameraet beveger seg sakte inn mot produktet, myk studiobelysning, subtile refleksjoner, eksklusiv kommersiell følelse”

Audiovisuell generering i én omgang

I stedet for å generere video først og deretter legge til lyd separat, støtter CometAPI Seedance 2.0 sin innebygde audiovisuelle genereringspipeline.

Ved å beskrive både det visuelle og lyden i én enkelt prompt kan du generere synkronisert video og lyd i ett steg. Dette gir mer sammenhengende og bevisste resultater, samtidig som det reduserer redigeringstiden.

Eksempel på prompt:

“En fredelig strand ved soloppgang, milde bølger som ruller inn, varmt gyllent lys, myk ambient musikk med havlyder”

Utdata inkluderer:

- Generert video

- Synkronisert bakgrunnslyd

- Naturlig tilpasset timing og stemning

Hvorfor bruke CometAPI for Seedance 2.0

- Direkte tilgang via API eller Playground

- Enkel parameterkontroll (varighet, oppløsning, format)

- Støtter både tekst-til-video- og bilde-til-video-arbeidsflyter

- Innebygd jobbhåndtering for asynkron videogenerering

Konklusjon

Seedance 2.0 ser ut som et reelt sprang innen AI-videogenerering: et multimodalt system som kombinerer tekst-, bilde-, lyd- og videoinndata; en topplisteleder innen både tekst-til-video og bilde-til-video; og en modell bygget for regissørlignende kontroll fremfor tilfeldig leketøybruk. Hvis du bare bryr deg om rå opplevd kvalitet, sier dagens bevis at den er enestående.

Begynn å skape med Seedance 2.0 på CometAPI i dag.