- juli 2025 avduket det Beijing‑baserte oppstartsselskapet Zhipu AI offisielt sin GLM‑4.5‑serie med store språkmodeller med åpen kildekode, selskapets kraftigste lansering til dags dato, rettet mot avanserte intelligente agent‑applikasjoner. Kunngjøringen—gjort via et direktesendt nettarrangement etter World Artificial Intelligence Conference (WAIC)—viste frem to varianter: fullskala GLM‑4.5 med 355 milliarder totale parametere (32 milliarder aktive) og den mer kompakte GLM‑4.5‑Air med 106 milliarder totale parametere (12 milliarder aktive). Begge modellene benytter en hybrid «tenkende» og «ikke‑tenkende» resonneringsarkitektur utformet for å balansere dyp inferens med rask respons, og tilbyr et kontekstvindu på 128,000 tokens for omfattende samtale‑ og oppgaveorienterte bruksområder.

Lanseringen av GLM‑4.5 skjer midt i et tiltagende innenlandsk AI‑kappløp. Ifølge Kinas statlige Xinhua News Agency har kinesiske utviklere lansert 1,509 store språkmodeller per juli 2025, i tet av den globale totalen på 3,755 modeller—et tydelig bevis på omfanget og tempoet i utvidelsen av Kinas AI‑økosystem.

Åpen kildekode‑lisensiering av GLM‑4.5

I et tydelig brudd med lukkede, proprietære paradigmer slipper Z.ai GLM‑4.5 under en MIT‑stil, fullt etterprøvbar åpen kildekode‑lisens, som gir virksomheter full transparens i modellvekter og treningskode. Organisasjoner kan distribuere GLM‑4.5 lokalt, finjustere den på proprietære datasett eller integrere den via selvhostede inferenstjenester, og dermed unngå leverandørlåsing og ugjennomsiktige API‑prisstrukturer.

Tilgjengeligheten av både GLM‑4.5 for generelle agent‑oppgaver og GLM‑4.5‑Air, en lettvektsvariant optimalisert for miljøer med færre ressurser, sikrer et bredt spekter av bruksområder—fra storskala datasenterdistribusjoner til inferens på edge‑enheter.

Strategisk posisjonerer Zhipus åpen‑kildekode‑tilnærming selskapet mot lukkede vestlige aktører som OpenAI. Ved å demokratisere tilgangen til en modell på nivå med GPT‑4 under MIT‑lisensen, tar Zhipu sikte på å kultivere et robust fellesskap av videreutviklere og sette tekniske referanser for agentiske AI‑kapabiliteter. Bransjeobservatører påpeker at dette trekket følger en bredere trend blant Kinas «AI Tigers», inkludert Moonshot AI og Step AI, som også har åpenkildekodet store modeller for å akselerere innovasjonssykluser.

Ytelsesmålinger og sammenlignende analyse

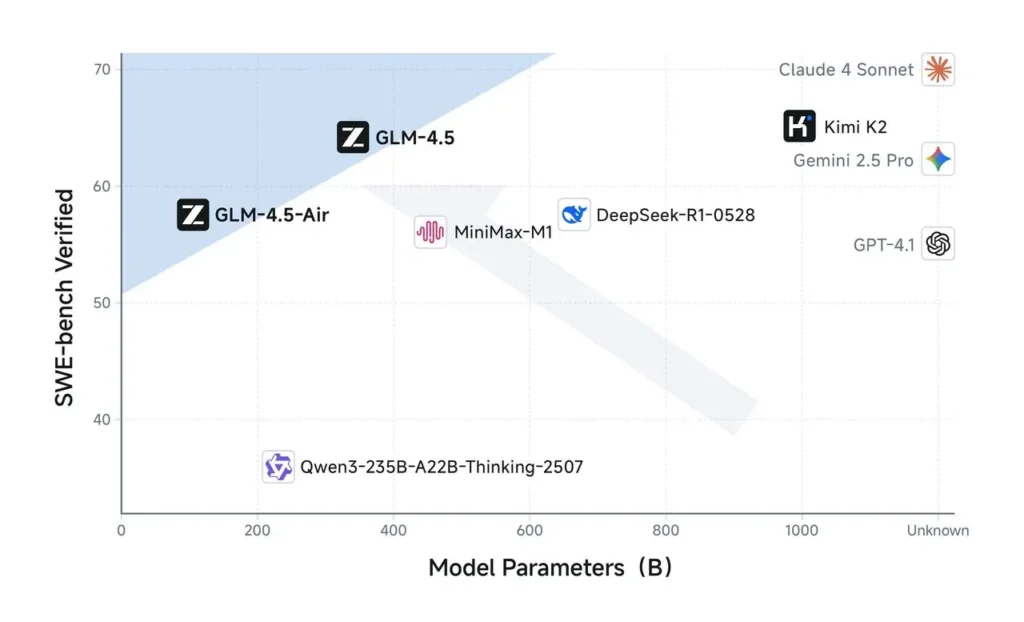

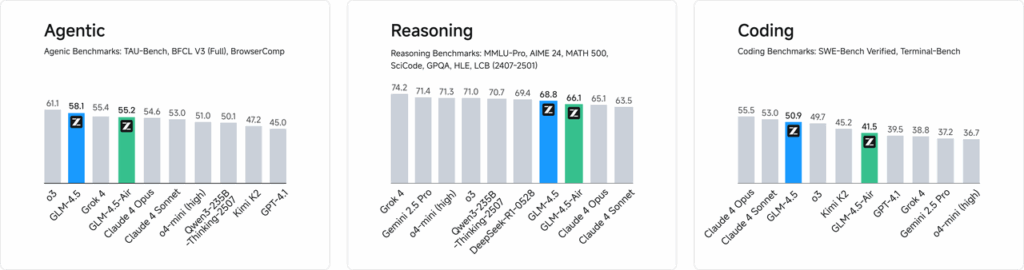

Foreløpige målinger fra Zhipu AI indikerer at GLM‑4.5 oppnår en samlet score på 63.2 på tvers av 12 industristandard evalueringssviter—noe som plasserer den på tredjeplass blant både åpne og proprietære modeller—mens den strømlinjeformede GLM‑4.5‑Air scorer 59.8 og balanserer effektivitet med høy nøyaktighet. Interne kodevurderinger viser videre at GLM‑4.5 overgår store rivaler, med en seiersrate på 53.9 prosent mot Kimi K2 og en suksessrate på 80.8 prosent mot Qwen3‑Coder på tvers av 52 ulike programmeringsoppgaver.

Demonstrasjoner under direktesendingen understreket GLM‑4.5s agentiske kapabiliteter: Modellen utførte autonom nettforskning—hentet og syntetiserte informasjon fra flere kilder—og koblet seg til simulerte miljøer for sosiale medier og utvikling for å generere innlegg, kjøre kodesnutter og manipulere elementer i brukergrensesnittet i sanntid. Interesserte brukere kan umiddelbart prøve fullskalamodellen gratis via Zhipus portal Qingyan og plattformen CometAPI, mens utviklere kan få tilgang til API‑endepunkter på CometAPIs BigModel‑tjeneste eller laste ned komplette modellvekter fra Hugging Face og ModelScope under en MIT‑lisens.

Kostnadseffektivitet er en hjørnestein i Z.ais strategi. Trenet på et korpus på 15 billioner tokens, utnytter GLM‑4.5 optimaliserte inferensbaner for å levere en gjennomstrømning på 100–200 tokens per sekund—opptil åtte ganger raskere enn sammenlignbare innenlandske rivaler—til en annonsert pris på bare $0.11 per million tokens, og underbyr modeller som DeepSeek‑R1 og Alibabas nyeste lanseringer. Under den permissive MIT‑lisensen er alle modellvekter, kode og dokumentasjon fritt tilgjengelig via Hugging Face, med mål om å fremme et levende utvikler‑ og forskningsmiljø over hele verden.

«GLM‑4.5 legemliggjør vårt engasjement for å demokratisere tilgangen til fremragende AI‑teknologi,» sa Zhang Peng, CEO i Z.ai, i et CNBC‑intervju. «Ved å åpenkildekode en modell som utmerker seg i resonnering, koding og agentiske funksjoner, gjør vi organisasjoner av alle størrelser i stand til å innovere uten begrensningene fra proprietære API‑er eller prohibitive kostnader.»

Kom i gang

CometAPI er en samlet API‑plattform som aggregerer over 500 AI‑modeller fra ledende leverandører—slik som OpenAIs GPT‑serie, Googles Gemini, Anthropics Claude, Midjourney, Suno og flere—i ett enkelt, utviklervennlig grensesnitt. Ved å tilby konsistent autentisering, forespørselsformat og håndtering av svar forenkler CometAPI dramatisk integrasjonen av AI‑kapabiliteter i applikasjonene dine. Enten du bygger chatboter, bildegeneratorer, musikkkomponister eller datadrevne analysepipeliner, lar CometAPI deg iterere raskere, kontrollere kostnader og forbli leverandøruavhengig—samtidig som du kan dra nytte av de siste gjennombruddene i AI‑økosystemet.

Utviklere kan få tilgang til GLM‑4.5‑API via CometAPI, de nyeste Claude‑modellene som er oppført er per artikkelens publiseringsdato. For å komme i gang kan du utforske modellens kapabiliteter i Playground og se API‑guide for detaljerte instruksjoner. Før du får tilgang, må du sørge for at du er logget inn på CometAPI og har hentet API‑nøkkelen. CometAPI tilbyr en pris som er langt lavere enn den offisielle prisen for å hjelpe deg med integrasjonen.