GPT-5 firmy OpenAI został uruchomiony na początku sierpnia 2025 roku i szybko stał się dostępny za pośrednictwem wielu kanałów dystrybucji. Jednym z najszybszych sposobów eksperymentowania z GPT-5 bez konieczności zmiany dostawcy SDK jest CometAPI — wielomodelowa brama, która udostępnia GPT-5 wraz z setkami innych modeli. W tym artykule znajduje się praktyczna dokumentacja wyjaśniająca ten temat. co CometAPI oferuje, w jaki sposób aby wywołać GPT-5 za jego pośrednictwem, kompromisy, które należy ocenić, oraz praktyczne zarządzanie i kontrola kosztów, które należy wdrożyć przed przeniesieniem najważniejszych przepływów pracy do GPT-5.

Czym jest GPT-5 i czym różni się od wcześniejszych modeli?

GPT-5 to kolejna flagowa rodzina dużych modeli językowych OpenAI, która zostanie wydana na początku sierpnia 2025 roku. Jest ona prezentowana jako zunifikowany, multimodalny system wnioskowania, który łączy szybkie komponenty bezrozumowe, głębszy wariant „wnioskowania” (często określany jako „myślenie GPT-5”) oraz router, który decyduje, który podmodel ma zostać użyty na podstawie złożoności i wymaganych narzędzi. Efekt końcowy, o którym mówi OpenAI, to: lepsze wnioskowanie, większe okna kontekstowe oraz ulepszone wsparcie dla kodowania i zadań agentowych.

Architektura i kluczowe możliwości

- System wieloskładnikowy: GPT-5 to system, który kieruje żądania do różnych wewnętrznych podmodeli (szybkiego i głębokiego wnioskowania) w zależności od potrzeb; programiści mogą zażądać modelu wnioskowania za pośrednictwem interfejsu API w celu uzyskania maksymalnej wydajności.

- Szeroki kontekst: Rodzina modeli obsługuje wyjątkowo duże konteksty (setki tysięcy tokenów), umożliwiając jednoetapową obsługę długich dokumentów, baz kodów lub konwersacji obejmujących wiele plików.

- Rodzina wielopokoleniowa: OpenAI wydało GPT-5 w wielu rozmiarach (standardowych

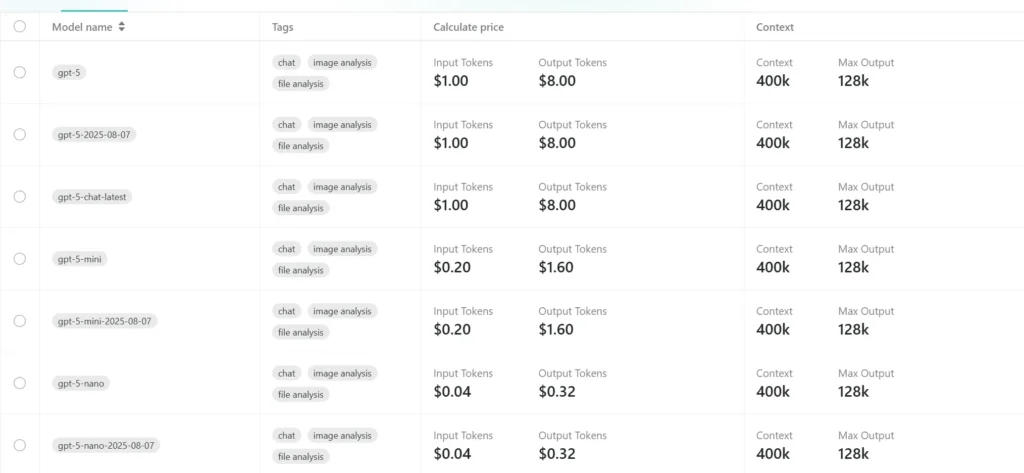

gpt-5,gpt-5-mini,gpt-5-nano) dzięki czemu zespoły mogą równoważyć opóźnienia, koszty i moc wnioskowania.

Czym jest CometAPI i czy faktycznie oferuje GPT-5?

Szybka definicja

Interfejs API Comet to platforma agregująca API, która reklamuje ujednolicony dostęp do setek modeli AI (rodzin GPT OpenAI, Anthropic Claude, xAI Grok, modeli obrazowych i innych) za pośrednictwem jednego, zgodnego z OpenAI interfejsu REST. Oznacza to, że programiści mogą zmieniać dostawców modeli, zmieniając ciąg nazwy modelu, zamiast przepisywać kod sieciowy. Na stronach produktów CometAPI wyraźnie wymienia GPT-5 i pokrewne warianty (np. gpt-5, gpt-5-chat-latest, gpt-5-mini) jako dostępne punkty końcowe.

Dlaczego zespoły korzystają z bramek, takich jak CometAPI

Usługi bramkowe, takie jak CometAPI, są atrakcyjne, ponieważ pozwalają na:

- Zamień modele szybko, bez konieczności zmiany dużej ilości kodu integracyjnego.

- Porównanie cen i kierować określone żądania do tańszych lub szybszych wariantów modeli.

- Łączne rozliczanie i rejestrowanie w wielu modelach i u różnych dostawców.

Dokumentacja CometAPI zapewnia prostą ścieżkę migracji i klienta w stylu OpenAI (dzięki czemu istniejący kod OpenAI lub kod „kompatybilny z OpenAI” często wymaga jedynie drobnych zmian).

W jaki sposób CometAPI programowo udostępnia GPT-5?

CometAPI prezentuje Interfejs API REST zgodny z OpenAI powierzchnia: podstawowy adres URL, Authorization: Bearer <YOUR_KEY>i żądaj treści podobnych do punktów końcowych czatu/uzupełnień OpenAI. GPT-5 platforma dokumentuje nazwy modeli, takie jak gpt-5, gpt-5-mini, gpt-5-nano a wymienione punkty końcowe obejmują POST https://api.cometapi.com/v1/chat/completions do rozmów w formie czatu i /v1/responses dla niektórych wariantów bez czatu. Przykładowe szczegóły konfiguracji (podstawowy adres URL, format nagłówka i parametr modelu) są publikowane w Dokumentacja CometAPI oraz przewodniki szybkiego startu.

Typowy punkt końcowy i wzorzec uwierzytelniania

- Adres URL bazowy:

https://api.cometapi.com/v1(lub udokumentowane/v1/chat/completionsdo czatu i/v1/responsesdla niektórych wariantów bez czatu.). - Nagłówek autoryzacji:

Authorization: Bearer sk-xxxxxxxxxxxx(problemy z CometAPIsk-tokeny stylu w panelu). - Typ treści:

application/json. - Parametr modelu: zestaw

modeldogpt-5, gpt-5-2025-08-07,gpt-5-chat-latest,gpt-5-minilub innych, odnoszą się do strona modelowa.

Jak rozpocząć korzystanie z CometAPI i zażądać GPT-5? (krok po kroku)

Poniżej znajdziesz zwięzły i niezawodny schemat wdrażania, z którego możesz skorzystać już dziś.

Krok 1: Zarejestruj się i uzyskaj klucz CometAPI

- Iść do pl.com i załóż konto.

- Z pulpitu nawigacyjnego przejdź do Tokeny API or Centrum osobiste → Dodaj tokenCometAPI wydaje token w

sk-...format. Przechowuj go bezpiecznie (nie osadzaj kluczy w publicznych repozytoriach).

Krok 2: Wybierz ciąg modelu

- Wybierz nazwę modelu odpowiadającą Twoim potrzebom (np.

gpt-5,gpt-5-nano-2025-08-07). CometAPI często publikuje wiele aliasów dla każdego modelu, dzięki czemu możesz wybrać kompromis między dokładnością a kosztami.

Krok 3: Złóż swoje pierwsze żądanie (curl)

Minimalny curl przykład zgodny ze wzorcem zgodnym z OpenAI:

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-YOUR_COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-5",

"messages": [{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"Summarize the benefits of using a model aggregator."}],

"max_tokens": 500,

"temperature": 0.2

}'

Odzwierciedla strukturę API czatu OpenAI, ale wskazuje na podstawowy adres URL CometAPI i wykorzystuje token Comet.

Krok 4: Przykład Pythona (żądania)

import requests, os

COMET_KEY = os.getenv("COMETAPI_KEY") # set this in your environment

url = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "gpt-5",

"messages": [

{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"List three concrete steps to reduce model hallucination in production."}

],

"max_tokens": 400,

"temperature": 0.1

}

resp = requests.post(url, json=payload, headers=headers, timeout=60)

resp.raise_for_status()

print(resp.json())

zastąpić model w gpt-5-nano lub dokładny alias CometAPI w dokumentach dla mniejszych i tańszych wariantów.

Cena w CometAPI

Jakie są praktyczne najlepsze praktyki i środki zaradcze w zakresie użytkowania w środowisku produkcyjnym?

Poniżej przedstawiono konkretne wzorce pozwalające ograniczyć ryzyko i zwiększyć niezawodność podczas korzystania z pośrednika takiego jak CometAPI.

Zacznij od małego pilota i przeprowadź testy równoległe

Uruchom identyczne żądania do OpenAI (jeśli masz bezpośredni dostęp) i CometAPI, aby porównać wyniki, opóźnienia i koszty. Ujawni to wszelkie ukryte transformacje, filtry treści lub niezgodności aliasów modeli.

Narzędzie do obserwacji i zapewnienia jakości

Rejestruj monity, zwrócone tokeny (zaciemnione pod kątem danych osobowych), opóźnienia i kody błędów. Wdrażaj zautomatyzowane testy pod kątem współczynników dryftu monitów i halucynacji. Śledź użycie aliasów modelu, aby migracje były audytowalne.

Zabezpiecz klucze i regularnie je wymieniaj

Tokeny CometAPI należy traktować jak każdy inny sekret API: przechowywać w menedżerach sekretów, poddawać okresowej rotacji i przydzielać tokeny do środowisk (dev/stage/prod).

Wdrożenie wielowarstwowego bezpieczeństwa

Użyj kombinacji:

- Szybka inżynieria w celu ograniczenia halucynacji (wyraźne ograniczenia, ustrukturyzowany wynik).

- Kontrole po przetwarzaniu (weryfikacja faktów, listy blokowanych, sprawdzanie wyrażeń regularnych pod kątem danych osobowych).

- Człowiek w pętli dla wyników wysokiego ryzyka.

Są one standardem w przypadku wdrożeń GPT-5 obsługujących treści krytyczne lub prawne.

Jakie są najczęstsze pułapki i jak rozwiązywać problemy z dostępem?

Pułapka: „model nie istnieje / brak dostępu”. Niektórzy deweloperzy zgłaszają, że dostęp do modelu może być blokowany przez weryfikację dostawcy lub organizacji w przypadku korzystania z interfejsów API dostawców bezpośrednich; podobne ograniczenia mogą wystąpić, gdy agregatory pośredniczą w modelach dostawców. Jeśli pojawi się komunikat „model nie istnieje” lub błąd uprawnień, sprawdź: (a) czy klucz CometAPI jest prawidłowy i nie wygasł, (b) czy żądana nazwa modelu dokładnie odpowiada liście obsługiwanych modeli CometAPI oraz (c) czy istnieją dodatkowe kroki weryfikacyjne lub rozliczeniowe wymagane przez dostawcę bazowego. Lub błędy dostępu związane z weryfikacją i anomalie limitu czasu/uprawnień — bądź przygotowany na przekazanie szczegółów do działu obsługi klienta w celu rozwiązania problemu (e-mail: support@cometapi.com).

Pułapka: nieoczekiwane opóźnienie lub koszt. Tryby wysokiego rozumowania i duże konteksty powodują opóźnienia i zużycie tokenów. max_tokens, zmniejszyć temperature w stosownych przypadkach i preferować mini Warianty dla obciążeń o wysokiej przepustowości. Monitoruj z rejestrowaniem i alertami.

Notatka końcowa

CometAPI oferuje zespołom szybką ścieżkę do eksperymentowania z wariantami GPT-5, centralizując jednocześnie dostęp do modelu. Jednak użytkowanie produkcyjne wymaga takiej samej dyscypliny, jaką stosuje się w przypadku każdego wydajnego modelu: bezpiecznych kluczy, starannego i szybkiego projektowania, monitorowania pod kątem halucynacji oraz weryfikacji pod kątem zgodności z polityką i przepisami prawnymi w przypadku wrażliwych obciążeń. Zacznij od małego pilota, użyj pulpitów CometAPI do pomiaru zużycia tokenów i opóźnień, a następnie przejdź do wariantów o wyższym poziomie racjonalności dopiero po sprawdzeniu dokładności i bezpieczeństwa w Twojej domenie.

Deweloperzy mogą uzyskać dostęp GPT-5 , GPT-5 Nano i GPT-5 Mini przez CometAPI (CometAPI zaleca /v1/responses) najnowsze wersje modeli podane są na dzień publikacji artykułu. Na początek zapoznaj się z możliwościami modelu w Plac zabaw Szczegółowe instrukcje znajdziesz w przewodniku API. Przed uzyskaniem dostępu upewnij się, że zalogowałeś się do CometAPI i uzyskałeś klucz API. Interfejs API Comet zaoferuj cenę znacznie niższą niż oficjalna, aby ułatwić Ci integrację.

Zobacz także Jak korzystać z nowych parametrów i narzędzi GPT-5

FAQ

1.Który wariant modelu GPT-5 powinieneś wybrać i co z tokenami/cenami?

CometAPI wymienia wiele wariantów GPT-5 (domyślnie gpt-5, migawki z czatu, takie jak gpt-5-chat-latesti mniejsze wersje, takie jak gpt-5-mini/gpt-5-nano). Wybierz według swoich potrzeb:

gpt-5/gpt-5-chat-latest— pełna zdolność do prowadzenia rozmów ogólnego przeznaczenia, najlepsza pod względem jakości i racjonalności.gpt-5-mini/gpt-5-nano— niższe koszty i opóźnienia w przypadku zadań o dużej objętości lub niskiej krytyczności.

2. Jak należy projektować rozmowy, aby zapewnić szeroki kontekst i wysoką jakość rozumowania?

Długi kontekst: GPT-5 obsługuje bardzo duże okna kontekstowe. Podczas wysyłania dużych dokumentów, należy celowo dzielić dane wejściowe na fragmenty, korzystać z funkcji rozszerzania pobierania (baza danych wektorowych + okno kontekstowe) i utrzymywać maksymalną liczbę tokenów dla danych wyjściowych na poziomie, aby kontrolować koszty.

3. Jakie środki bezpieczeństwa, prywatności i zgodności należy zastosować?

Higiena klucza API. Przechowuj klucze w zmiennych środowiskowych, regularnie je rotuj i ograniczaj ich zakres, gdy to możliwe. Nie zatwierdzaj kluczy w repozytoriach. (Najlepsze praktyki powtarzane w podręcznikach dla programistów).

Miejsce przechowywania i prywatność danych. Zapoznaj się z polityką prywatności i warunkami CometAPI (oraz polityką OpenAI) przed wysłaniem poufnych danych osobowych, medycznych lub danych regulowanych za pośrednictwem dowolnego zewnętrznego agregatora. Niektóre przedsiębiorstwa będą wymagać bezpośrednich umów z dostawcami lub prywatnych instancji.

Limity stawek i ochrona kwot. Wdrażaj wyłączniki, mechanizmy wykładniczego wycofywania i kontroli limitów w produkcji, aby zapobiec niekontrolowanym kosztom i kaskadowym awariom. Panele CometAPI udostępniają dane o wykorzystaniu i limitach — użyj ich do egzekwowania limitów programowych.