Dział badawczy ByteDance Nasienie rozpoczął Seed3D 1.0, model 3D o wysokiej wierności, oparty na pojedynczym obrazie, który generuje siatki gotowe do symulacji, materiały PBR i wyrównane tekstury – zasoby zaprojektowane do bezpośredniego podłączenia do silników fizycznych i symulatorów robotyki. Wydanie ma na celu wypełnienie bolesnej luki: skalowalnego generowania treści (zróżnicowanej treści wizualnej) w porównaniu z wiernością odwzorowania fizyki wymaganą przez ucieleśnioną sztuczną inteligencję i trening symulatorów.

Czym jest ByteDance Seed3D 1.0?

Seed3D 1.0 to model fundamentów 3D stworzony do konwersji pojedynczy obraz RGB obiektu lub środowiska do gotowy do symulacji Pakiet zasobów 3D — zazwyczaj jawna, hermetyczna siatka, powiązane mapy tekstur odwzorowane w UV oraz parametry materiałów do renderowania opartego na fizyce (PBR). Model został zaprojektowany nie tylko po to, aby generować wizualnie wierną geometrię i tekstury, ale także po to, aby generować zasoby wymagające minimalnego przetwarzania końcowego przed ich wykorzystaniem w symulatorach, takich jak Isaac Sim, Unity lub Unreal Engine, do robotyki, szkoleń lub generowania wirtualnego świata.

Kluczowe cele projektowe na wysokim poziomie:

- Wejście pojedynczego obrazu: eliminuje potrzebę stosowania sprzętu do przechwytywania wielu widoków lub skanowania.

- Gotowość do symulacji:zapewnij, że topologia, skala i materiały PBR nadają się do symulacji fizycznej.

- Skalowalność sceny:umożliwia automatyczne składanie wygenerowanych obiektów w spójne sceny.

- Integracja:minimalna adaptacja do typowych silników fizycznych i potoków wykonawczych.

Jakie funkcje oferuje Seed3D 1.0?

Geometria o wysokiej wierności (wodoszczelne siatki)

Seed3D produkuje zamknięta, rozmaita geometria Zaprojektowany z myślą o precyzyjnej obsłudze kolizji i niezawodnej fizyce kontaktu. Komponent geometryczny wykorzystuje hybrydę VAE + transformator dyfuzyjny do tworzenia siatek zachowujących poziom szczegółowości, które zachowują drobne detale strukturalne, takie jak cienkie wypukłości, otwory i tekst. Proces ekstrakcji siatki wykorzystuje strategię podwójnych kostek marszowych / hierarchicznej powierzchni izo, aby wydajnie wyodrębniać powierzchnie wysokiej jakości. ()

Fotorealistyczne tekstury i materiały PBR

Proces teksturowania generuje wielowidokowe, spójne mapy albedo oraz pełne tekstury PBR (albedo, metaliczne, chropowatość) i może generować tekstury w rozdzielczości do 4K. Mapy te zostały zaprojektowane tak, aby oświetlenie zachowywało się fizycznie wiarygodnie w silnikach renderujących. Moduł UV inpainting uzupełnia obszary przesłonięte i zapewnia spójność przestrzenną w całym atlasie UV.

Symulacja i gotowość rurociągu

Wyniki można eksportować do popularnych formatów (OBJ/GLB). Wygenerowane zasoby są celowo gotowy do symulacjiIntegrują się z symulatorami fizycznymi, gdzie siatki kolizji oraz parametry tarcia/sztywności mogą być automatycznie generowane lub dostosowywane, co umożliwia natychmiastowe wykorzystanie w robotyce lub silnikach gier. Seed3D demonstruje procesy, które umieszczają wygenerowane zasoby w Isaac Sim w celu przeprowadzenia eksperymentów manipulacyjnych.

Generowanie scen i montaż faktoryzowany

Oprócz pojedynczych obiektów, Seed3D wykorzystuje faktoryzowane podejście do generowania scen, w którym modele wizyjno-językowe wnioskują o mapach układu (pozycji, skal, orientacji), a Seed3D odpowiednio syntetyzuje i rozmieszcza obiekty, umożliwiając spójną kompozycję sceny dla wnętrz i układów miejskich.

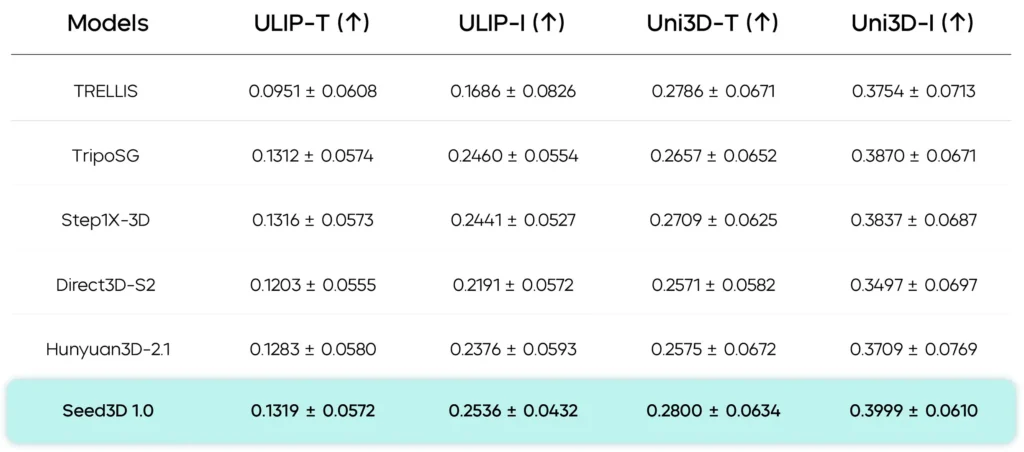

Wynik oceny wydajności

Generowanie geometrii

W testach geometrii, model geometryczny Seed3D 1.0 o 1.5 miliarda parametrów (Seed3D-DiT + VAE) osiąga lepszą dokładność strukturalną i drobniejsze szczegóły w porównaniu z kilkoma modelami bazowymi (TRELLIS, TripoSG, Step1X-3D, Direct3D-S2 i dużymi modelami, takimi jak Hunyuan3D-2.1). Architektura Seed3D – dyfuzja w przestrzeni ukrytej w połączeniu z precyzyjnym dekodowaniem SDF i hierarchiczną ekstrakcją siatki – zapewnia siatki z mniejszą liczbą artefaktów i lepszym zachowaniem geometrii o wysokiej częstotliwości (tekst, drobne wypukłości).

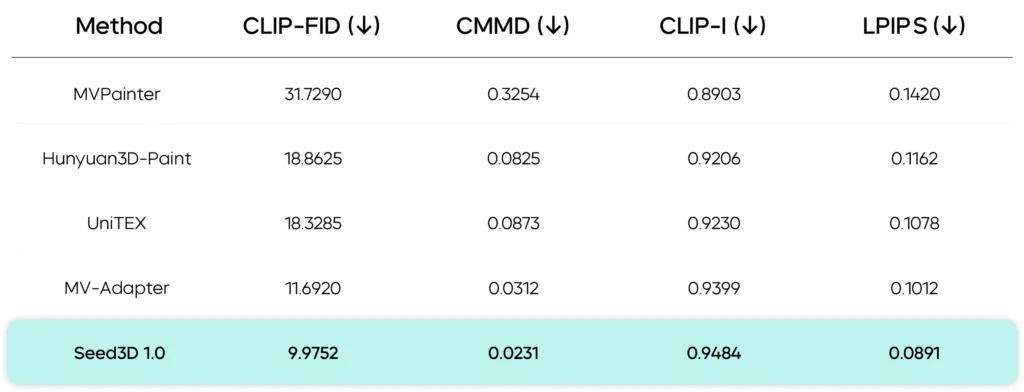

Generowanie tekstur

W przypadku szacowania tekstur i materiałów, Seed3D odnotowuje znaczną poprawę zgodności z obrazami referencyjnymi i realizmu materiałów. Rozkład Seed3D-PBR i inpainting Seed3D-UV łącznie tworzą atlasy UV, które zachowują szczegóły tekstur o wysokiej częstotliwości i zapewniają spójne mapy PBR (albedo, metaliczne, chropowatość) odpowiednie do renderowania fizycznego.

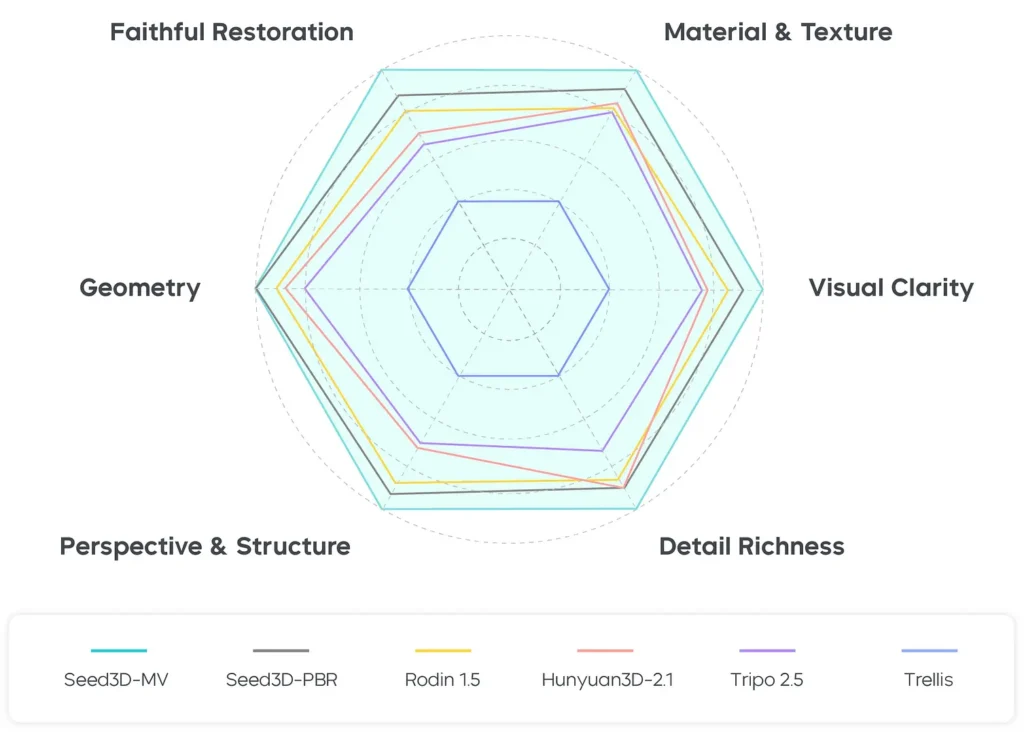

Ocena człowieka (badanie użytkowników)

W artykule opisano badanie użytkowników z udziałem 14 osób oceniających, obejmujące zestaw testowy 43 obrazów. Oceniający porównali wiele metod w różnych wymiarach, takich jak przejrzystość wizualna, wierne odwzorowanie, dokładność geometrii, perspektywa i struktura, realizm materiałów i tekstur oraz bogactwo detali. Seed3D 1.0 konsekwentnie otrzymywał wyższe oceny subiektywne w tych kategoriach, a najbardziej widoczne korzyści dotyczyły geometrii i jakości materiałów. Badanie z udziałem ludzi potwierdza ilościowe testy porównawcze, pokazując, że postrzegany realizm i przydatność symulacji poprawiły się w porównaniu z wartościami bazowymi.

Jak działa Seed3D 1.0 (architektura i potok)?

Seed3D 1.0 to system wielokomponentowy, łączący wyuczone reprezentacje geometrii ukrytej, odszumianie w przestrzeni ukrytej oparte na transformatorach oraz moduły wielowidokowe i uzupełniania tekstur. Projekt jest celowo modułowy, dzięki czemu każdy komponent można niezależnie optymalizować i aktualizować.

Główne komponenty

Seed3D-VAE (koder/dekoder ukrytej geometrii): Uczy się zwartej, ukrytej reprezentacji geometrii 3D (np. TSDF/siatka). VAE jest trenowany w celu rekonstrukcji geometrii o wysokiej rozdzielczości i pełnej spójności ze skompresowanych kodów ukrytych. Stanowi to efektywne wąskie gardło na etapie generowania.

Seed3D-DiT (transformator dyfuzyjny dla geometrii): Transformator przepływu/odszumiania (podobny do DiT), który działa w przestrzeni ukrytej wyuczonej geometrii. Uwarunkowany osadzeniem obrazu referencyjnego, iteracyjnie odszumia ukryte tokeny do ukrytej geometrii, którą VAE dekoduje do jawnej siatki.

Seed3D-MV (synteza wielu widoków) i Seed3D-UV (uzupełnianie tekstur):Po wytworzeniu początkowej geometrii system syntetyzuje wiele widoków w celu zmniejszenia niejednoznaczności okluzji, a następnie uzupełnia mapy UV za pomocą modułu uzupełniania/wzbogacania UV, aby wytworzyć pełne, spójne tekstury.

Seed3D-PBR (rozkład materiału):Rozkłada wygenerowane tekstury na mapy PBR (metaliczność, chropowatość, mapy normalnych itd.), dzięki czemu fizycznie prawdopodobne cieniowanie i odpowiedzi kontaktowe są zachowywane w symulacji.

Model wizji i języka do faktoryzacji scen:Do generowania scen potok wykorzystuje modele VLM do wykrywania obiektów, przewidywania relacji przestrzennych i tworzenia map układu (pozycja, skala, orientacja). Poszczególne obiekty są generowane, a następnie montowane w scenę zgodnie z mapą układu. ()

Przepływ wnioskowania wysokiego poziomu

- Wejście: pojedynczy obraz RGB → koder obrazu wyodrębnia osadzenie wizualne.

- Generowanie geometrii: Seed3D-DiT warunkuje osadzanie, odszumiając ukryte dane geometryczne → Seed3D-VAE dekoduje siatkę (szczelnie).

- Synteza wielowidokowa: generowanie widoków syntetycznych z siatki i procesu renderowania w celu uzupełnienia tekstur.

- UV i tekstura: Seed3D-UV maluje okluzje i tworzy pełne mapy UV → Seed3D-PBR rozkłada tekstury na mapy materiałów.

- Eksport: tworzenie pliku .obj/.gltf z teksturami i mapami materiałów, gotowego do użycia przez silniki fizyczne (siatki kolizji, szacowanie skali przez VLM).

Generowanie Scen

Seed3D nie tylko generuje pojedyncze obiekty, ale także automatycznie generuje kompletne sceny.

Proces generowania:

- Dane wejściowe: Obraz zawierający wiele obiektów;

- Model VLM identyfikuje obiekty i relacje przestrzenne na obrazie;

- Seed3D generuje geometrię i teksturę dla każdego obiektu;

- Na koniec układ przestrzenny zostaje połączony w celu utworzenia kompletnej sceny 3D.

Jakie są ograniczenia i otwarte wyzwania?

Seed3D 1.0 to duży krok naprzód, ale nadal istnieje kilka ograniczeń — zarówno wewnętrznych dla generowania pojedynczych obrazów, jak i specyficznych dla kontekstów symulacji:

- Niejednoznaczność pojedynczego widoku:wnioskowanie o przesłoniętej geometrii i dokładnej topologii na podstawie jednego punktu widzenia jest z gruntu błędne; wcześniejsze teorie i wyuczona statystyka pomagają, ale w przypadku silnie przesłoniętych obszarów nadal występują błędy.

- Poprawność fizyczna w skali:chociaż zasoby są „gotowe do symulacji” według wielu praktycznych rozwiązań, szczegółowa ocena masy/bezwładności i dynamiki połączeń dla złożonych układów przegubowych nadal wymaga dostrojenia specyficznego dla danej dziedziny.

- Rzadkie materiały i mikrostruktura:materiały silnie połyskliwe, półprzezroczyste lub anizotropowe (np. szczotkowane metale, tkaniny z rozpraszaniem podpowierzchniowym) trudniej jest dokładnie odtworzyć na podstawie jednego obrazu.

- Błędy w danych:źródła danych szkoleniowych wpływają na to, co model dobrze rejestruje — nietypowe obiekty lub artefakty specyficzne dla danej kultury mogą być słabo odtworzone.

- Własność intelektualna i etyka:tak jak ma to miejsce w przypadku wszystkich systemów generatywnych, twórcy i organizacje muszą brać pod uwagę własność intelektualną i pochodzenie podczas konwersji obrazów chronionych prawem autorskim na zasoby 3D.

Scenariusz aplikacji

Seed3D jest wyraźnie pozycjonowany ucieleśniona sztuczna inteligencja i symulacja przypadków użycia, ale implikacje obejmują wiele branż:

- Szkolenia z robotyki i RL:szybkie generowanie treści do testów porównawczych, programów szkoleniowych i zestawów danych zrandomizowanych w domenie do transferu symulacji do rzeczywistości. Gotowość zasobów do obsługi fizyki zmniejsza tarcie związane z przetwarzaniem wstępnym.

- Rozwój gier i XR:przyspieszone tworzenie zasobów dla prototypów, rekwizytów tła lub całych scen; przepływy pracy PBR i tekstury 4K są szczególnie przydatne w przypadku doświadczeń o wysokiej wierności.

- Wirtualna produkcja i wizualizacja:szybkie generowanie rekwizytów i elementów otoczenia na potrzeby koncepcji lub wstępnej wizualizacji.

- Procesy tworzenia treści:projektanci mogą znacznie szybciej przechodzić od materiałów referencyjnych 2D (zdjęć, grafik) do prototypów 3D, co umożliwia hybrydowe procesy pracy człowieka i sztucznej inteligencji, w których artyści dopracowują wyniki. ()

- Badania: generowanie na dużą skalę różnorodnych danych treningowych 3D dla modeli wizji-języka-działania i innych badań multimodalnych. Artykuł wyraźnie przedstawia Seed3D jako narzędzie do rozwoju skali symulatorów świata i badań nad ucieleśnioną inteligencją.

Seed3D potrafi przekonwertować pojedyncze zdjęcie na szczegółowy obiekt 3D nadający się do symulacji i zastosowań interaktywnych, co poszerza dostęp do tworzenia wysokiej jakości treści 3D.

Podsumowanie

Seed3D 1.0 firmy ByteDance to znaczący krok w kierunku skalowalna, symulacyjna generacja 3D z prostych danych wejściowych 2D. Łącząc skoncentrowany proces geometrii (VAE + DiT), solidną estymację tekstury/PBR i uzupełnianie UV, system generuje zasoby, które są zarówno fotorealistyczne, jak i natychmiast użyteczne w symulatorach fizycznych – połączenie to rozwiązuje uporczywy problem wąskiego gardła w badaniach nad ucieleśnioną sztuczną inteligencją i wielu procesach aplikacyjnych. Zgłoszona wydajność SOTA modelu (geometria i tekstura) oraz pozytywne wyniki oceny ludzkiej czynią go silnym graczem w szybko ewoluującym świecie generatywnych rozwiązań 3D.

Jak zacząć

CometAPI to ujednolicona platforma API, która agreguje ponad 500 modeli AI od wiodących dostawców — takich jak seria GPT firmy OpenAI, Gemini firmy Google, Claude firmy Anthropic, Midjourney, Suno i innych — w jednym, przyjaznym dla programistów interfejsie. Oferując spójne uwierzytelnianie, formatowanie żądań i obsługę odpowiedzi, CometAPI radykalnie upraszcza integrację możliwości AI z aplikacjami. Niezależnie od tego, czy tworzysz chatboty, generatory obrazów, kompozytorów muzycznych czy oparte na danych potoki analityczne, CometAPI pozwala Ci szybciej iterować, kontrolować koszty i pozostać niezależnym od dostawcy — wszystko to przy jednoczesnym korzystaniu z najnowszych przełomów w ekosystemie AI.

Programiści mogą uzyskać dostęp do modeli 3D i innych modeli ByteDance, takich jak: API Seedream 4.0 poprzez CometAPI, najnowsza wersja modelu jest zawsze aktualizowany na oficjalnej stronie internetowej. Na początek zapoznaj się z możliwościami modelu w Plac zabaw i zapoznaj się z Przewodnik po API aby uzyskać szczegółowe instrukcje. Przed uzyskaniem dostępu upewnij się, że zalogowałeś się do CometAPI i uzyskałeś klucz API. Interfejs API Comet zaoferuj cenę znacznie niższą niż oficjalna, aby ułatwić Ci integrację.

Gotowy do drogi?→ Zarejestruj się w CometAPI już dziś !

Jeśli chcesz poznać więcej wskazówek, poradników i nowości na temat sztucznej inteligencji, obserwuj nas na VK, X oraz Discord!