OpenAI testuje znaczące odświeżenie webowego doświadczenia ChatGPT — wewnętrznie określane kryptonimem „Salute” — wraz z bogatszym zestawem narzędzi edycji inline, które mogą zmienić sposób, w jaki wchodzimy w interakcję ze sztuczną inteligencją w przeglądarce. Na podstawie publicznego wycieku oraz odniesień w kodzie można wnioskować, że to coś więcej niż kosmetyczny redesign: Salute wydaje się zmierzać do przekształcenia ChatGPT w trwałe, zorientowane na zadania środowisko pracy, w którym użytkownicy mogą przesyłać pliki, tworzyć śledzone zadania oraz edytować kod i matematykę inline bez opuszczania czatu.

Czym dokładnie jest „Salute” i jak doszło do wycieku?

Najistotniejszym odkryciem w ujawnionej bazie kodu jest funkcja nazwana „Salute”. Choć OpenAI wcześniej wprowadziło „Projects” do organizowania czatów, „Salute” wygląda na znacznie ambitniejszą próbę wprowadzenia prawdziwego zarządzania zadaniami do doświadczenia AI. Najwcześniejsze publiczne wzmianki o Salute wywodzą się z odniesień w kodzie i interfejsie, odkrytych przez badaczy i opisanych w mediach społecznościowych.

Czym wydaje się być „Salute” (na podstawie artefaktów z wycieku)

Z elementów widocznych w przecieku wynika, że Salute to warstwa workflow zbudowana ponad sesjami ChatGPT. Obejmuje to:

- Możliwość tworzenia zadań bezpośrednio w interfejsie czatu, z opcją dołączania plików do każdego zadania.

- Widoczne śledzenie postępu lub stanów zadania, sugerujące trwałe obiekty zadań, które wykraczają poza pojedynczą wymianę wiadomości.

Ponieważ te twierdzenia pochodzą z wewnętrznych przecieków, a nie z publicznej mapy drogowej, należy traktować je jako prawdopodobne, lecz niepotwierdzone do czasu weryfikacji przez OpenAI. Wycieki wpisują się jednak w szerszy kierunek produktowy: przesunięcie ChatGPT z roli asystenta konwersacyjnego ku wielozadaniowemu środowisku produktywności.

Przesyłanie plików i ciągłość kontekstu

Kluczowym elementem „Salute” jest solidna obsługa załączników. ChatGPT od pewnego czasu wspiera przesyłanie plików, ale „Salute” integruje je z architekturą zadań. Użytkownicy prawdopodobnie będą mogli przypinać dokumenty, arkusze kalkulacyjne lub bazy kodu do konkretnych zadań, zapewniając utrzymanie kontekstu przez dłuższy czas.

Wyobraź sobie scenariusz, w którym deweloper tworzy w „Salute” zadanie „Refactor Login Authentication”. Może dołączyć odpowiednią dokumentację i aktualne pliki kodu. W miarę postępów w ciągu tygodnia zadanie pozostaje aktywne, śledząc, które podkomponenty zostały już omówione — w praktyce zamieniając ChatGPT w inteligentnego kierownika projektu, który „pamięta” stan pracy lepiej niż standardowe okno czatu.

W jaki sposób edycja inline zmieni sposób pisania z ChatGPT?

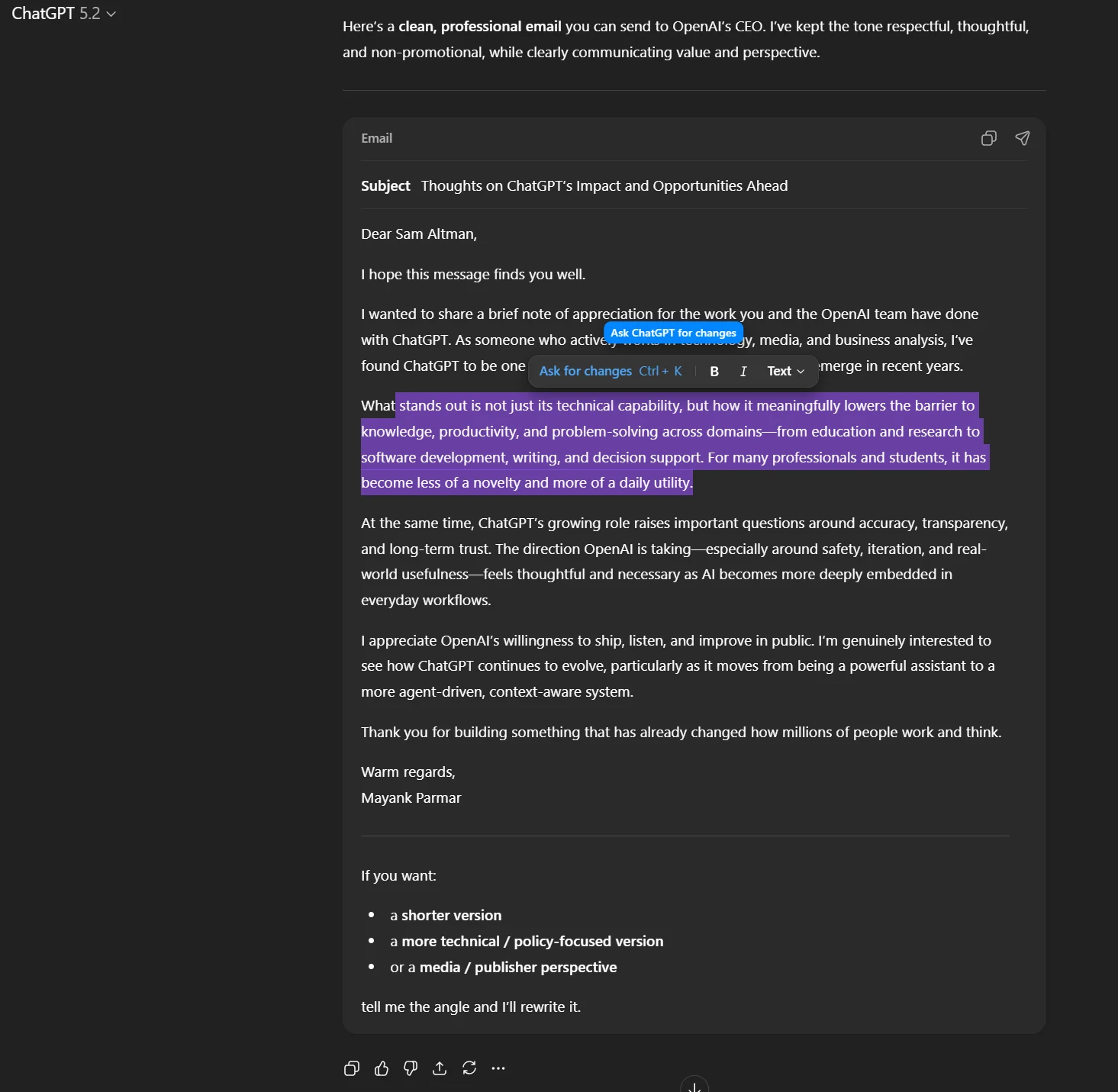

Edycja inline to drugi duży wątek wyłaniający się z tego samego zestawu przecieków. Dotąd ChatGPT zwracał blok wygenerowanego tekstu, który użytkownik kopiował, wklejał i edytował gdzie indziej; nowa wersja wprowadza bogatą edycję inline oraz „bloki formatowania”. Oznacza to możliwość edycji tekstu, stosowania podstawowego formatowania (pogrubienie, kursywa, listy) i lokalnych poprawek bezpośrednio w interfejsie ChatGPT — bez przechodzenia do zewnętrznego edytora. Wczesne odniesienia sugerują obszar edycji w stylu WYSIWYG, z którym model może wchodzić w interakcję na miejscu.

Co dokładnie „edycja inline” umożliwia autorom i redaktorom?

- Mniej przełączania kontekstu: szkicuj, proś o przeredagowanie i dopracowuj formatowanie bez opuszczania karty przeglądarki.

- Iteracyjną współpracę: jeśli ChatGPT może edytować tekst inline, może też proponować ukierunkowane zmiany (np. „skróć wstęp” lub „rozszerz sekcję metodologii”), które zaakceptujesz lub odrzucisz na miejscu.

- Lepszą wierność treści strukturalnych: e-maile, tabele i listy punktowane często tracą formę przy przenoszeniu między edytorami; edytor inline, który respektuje strukturę, ogranicza to ryzyko.

- Szybsze cykle polerowania treści marketingowych, ofert i wpisów blogowych: połącz możliwości generatywne ChatGPT z lokalnymi poprawkami w jednym obiegu.

Nowe funkcje edycji inline, w szczególności dla bloków kodu i równań matematycznych, pozwolą użytkownikom klikać bezpośrednio w wygenerowany wynik i wprowadzać zmiany. Przekształca to interfejs z trybu tylko do odczytu w kanwę współtworzenia. Jeśli AI „zmyśli” nazwę zmiennej, możesz po prostu ją poprawić. Taki model „human-in-the-loop” jest szybszy i daje użytkownikom większe poczucie sprawczości, którego brakowało w interfejsach czatowych.

Jak „bloki formatowania” mogą działać pod spodem?

Wycieki wspominają o „blokach formatowania” i wyspecjalizowanych widżetach edytora w kliencie webowym. Prawdopodobna architektura to hybrydowy model treści, w którym zwykłe wiadomości czatu można przekształcić w strukturalne bloki (akapit, lista, fragment kodu, tabela), rozpoznawane i obsługiwane przez model. Pozwala to interfejsowi oferować bogate kontrolki dla każdego bloku przy zachowaniu świadomości po stronie modelu (ChatGPT rozumie, który dokładnie blok poprosiłeś o poprawę). Takie podejście blokowe nawiązuje do nowoczesnych edytorów dokumentów i umożliwia selektywną regenerację lub podstawienia inline bez naruszania otoczenia.

Wyzwanie dla interfejsów „Canvas”?

Ten krok prawdopodobnie odpowiada na ruchy konkurentów, takich jak Anthropic, którego funkcja „Artifacts” zapewnia widok kodu obok renderowanej treści. OpenAI zdaje się obierać nieco inny kierunek, osadzając możliwości edycji bezpośrednio w toku rozmowy („inline”). Utrzymuje to fokus na dialogu, jednocześnie dając użytkownikowi rolę redaktora. Sugeruje to, że OpenAI widzi przyszłość AI nie jako wyrocznię dostarczającą doskonałe prawdy, lecz jako współautora, który tworzy szkice do ludzkiego dopracowania.

Jakie inne funkcje sugerują przecieki?

Śledzenie zadań, przesyłanie plików i wybór modelu lokalnego

Jak wspomniano, Salute wydaje się zaprojektowane do zarządzania cyklem życia zadań z natywnymi załącznikami i wskaźnikami postępu. Odniesienia obejmują flagę „preferred model”, co sugeruje, że ChatGPT mógłby wybierać lub przypinać modele wyspecjalizowane do określonych zadań lokalnych (np. model dostrojony do lokalnych firm lub zapytań mapowych). Taka możliwość pomogłaby optymalizować odpowiedzi dla zadań lokalnych i domenowych.

Bezpieczne tunele, narzędzia deweloperskie i bloki techniczne

W kilku raportach pojawia się wsparcie „secure tunnel” oraz nowe, bezpieczne mechanizmy łączności kierowane do serwerów MCP (wewnętrzne odniesienia do infrastruktury OpenAI). W ujęciu produktowym może to oznaczać lepsze integracje dla klientów korporacyjnych, którzy potrzebują umożliwić ChatGPT dostęp do prywatnych źródeł danych (np. bazy klientów, repozytoria dokumentów, prywatnie hostowane bazy kodu) bez ujawniania poświadczeń i z zachowaniem wymogów zgodności. Włączenie edytowalnych inline bloków kodu i matematyki dodatkowo podkreśla nacisk na techniczne przepływy pracy użytkowników.

Optymalizacje dla map/usług lokalnych

Wycieki łańcuchów znaków dotyczących zachowania widżetu mapy i wyników dla firm lokalnych sugerują usprawnienia w obsłudze zapytań geograficznych i mapowych — potencjalnie przekierowując takie zapytania do modeli zoptymalizowanych pod kątem wyszukiwania lokalnego albo używając „preferowanego modelu” do odpowiedzi na pytania związane z handlem. Może to przynieść lepsze odpowiedzi dla planowania podróży, odkrywania lokalnych firm i trafniejszych rekomendacji kontekstowych.

Sonata: nowa platforma?

Badacze bezpieczeństwa zauważyli certyfikaty SSL dla sonata.openai.com. Użycie osobnej subdomeny (zamiast podkatalogu, jak chatgpt.com/sonata) często wskazuje na samodzielny produkt. Spekulacje sugerują, że „Sonata” może być wyspecjalizowanym interfejsem dla autonomicznych agentów — miejscem, w którym AI wykonuje wieloetapowe przepływy pracy bez ciągłego nadzoru człowieka. Jeśli „Salute” służy do zarządzania zadaniami razem z użytkownikiem, „Sonata” mogłaby być do zadań wykonywanych dla użytkownika.

Pulse: asynchroniczne badania

Kryptonim „Pulse” odnosi się do funkcji umożliwiającej ChatGPT prowadzenie badań, gdy śpisz. Wyciek opisuje to jako asynchroniczny proces w tle, który może „przeprowadzać badania w Twoim imieniu raz dziennie”. Przenosi to AI z synchronicznego modelu „czatu” (Ty mówisz, ono odpowiada) do asynchronicznego modelu „pracownika” (Ty zlecasz zadanie, ono raportuje jutro).

Czy ta zmiana przeobrazi konkurencyjny krajobraz asystentów AI?

Krótka odpowiedź: tak — ale nie z dnia na dzień.

Połączenie edycji w edytorze, śledzenia zadań i korporacyjnych tuneli zbliża ChatGPT do platform roboczych (np. Notion, Google Docs + Google Workspace albo wyspecjalizowanych narzędzi do zarządzania projektami) oraz do konkurencyjnych asystentów AI dążących do przepływów end-to-end. Konkurenci zapewne przyspieszą własne integracje: część postawi na głębszą automatyzację zadań, inni na otwartość platformy (np. wtyczki i rozszerzenia firm trzecich). Efekt netto to zaostrzenie rywalizacji na dwóch osiach:

- Głębokość integracji: kto najlepiej łączy się z systemami przedsiębiorstw i zapewnia kontrolę?

- Inteligencja workflow: kto buduje najlepsze możliwości in-context (np. pozyskiwanie odpowiedzi, rozumienie dokumentów i automatyzację zadań)?

Siłą OpenAI były wydajność modeli i pozycja wśród deweloperów. Wbudowanie możliwości workflow i edytora w podstawowe doświadczenie webowe przesuwa pole walki w stronę UX produktu, otwartości platformy i gotowości dla przedsiębiorstw.

Wnioski

Wycieki dotyczące aktualizacji „Salute” oraz funkcji edycji inline reprezentują największą zmianę w UX ChatGPT od momentu jego uruchomienia. Przechodząc poza prostą wymianę tekstu do zarządzania zadaniami, edycji dokumentów i wyszukiwania lokalnego, OpenAI pozycjonuje ChatGPT jako przyszły system operacyjny pracy.

Czekając na oficjalne potwierdzenie, kod mówi sam za siebie: era pasywnego chatbota dobiega końca. Nadchodzi era współpracującego z człowiekiem „współpracownika” AI.

Aby zacząć, poznaj możliwości modeli takich jak gpt 5.2 na CometAPI w Playground. Upewnij się, że jesteś zalogowany, aby uzyskać klucz API i zacząć budować już dziś.

Gotowy, by zacząć? → Darmowy okres próbny modeli ChatGPT przez CometAPI!