DeepSeek oficjalnie zapowiedział V4 jako otwartoźródłową rodzinę modeli, a sednem nie jest tylko „kolejna aktualizacja modelu”. Firma pozycjonuje V4 jako system z długim kontekstem, przyjazny agentom, zbudowany pod realne obciążenia: analizy oparte na dużych dokumentach, asystenci kodowania, agenci wyszukiwania oraz wieloetapowa automatyzacja. Wydanie jest dostępne w wersji web, aplikacji i API, a linia V4 wprowadza opłacalne okno kontekstu o wielkości 1M tokenów we wszystkich oficjalnych usługach.

To, co czyni tę premierę szczególnie godną uwagi, to połączenie skali i efektywności. DeepSeek podaje, że V4‑Pro ma 1.6T parametrów łącznie, z 49B aktywnymi, podczas gdy V4‑Flash ma 284B parametrów łącznie, z 13B aktywnymi. W raporcie technicznym DeepSeek twierdzi też, że architektura V4 wykorzystuje hybrydową uwagę, routing MoE oraz post‑trening zaprojektowany tak, by poprawić zachowania agentowe, jednocześnie ograniczając koszt obliczeń przy ultra‑długim kontekście.

Czym jest DeepSeek V4?

DeepSeek‑V4 to najnowsza zapowiadana flagowa rodzina modeli, a wydanie obejmuje dwa publiczne warianty: V4‑Pro i V4‑Flash. DeepSeek opisuje V4‑Pro jako mocniejszy model w zakresie wiedzy o świecie, matematyki, STEM, programowania i programowania agentowego, natomiast V4‑Flash to bardziej responsywna, opłacalna kosztowo opcja, która zachowuje sporą część jakości rozumowania i zdolność pracy z długim kontekstem. V4‑Pro prowadzi wśród obecnych modeli otwartych w programowaniu agentowym i wiedzy o świecie, podczas gdy V4‑Flash zaprojektowano pod szybkość i ekonomiczne wdrożenia.

V4 wykorzystuje hybrydową architekturę uwagi łączącą Compressed Sparse Attention (CSA) i Heavily Compressed Attention (HCA), a także Manifold‑Constrained Hyper‑Connections oraz optymalizator Muon. Firma podaje też, że modele wstępnie wytrenowano na ponad 32T tokenów i że przy kontekście 1M V4‑Pro potrzebuje tylko 27% FLOPs wnioskowania na pojedynczy token oraz 10% pamięci podręcznej KV w porównaniu z DeepSeek‑V3.2. Ta efektywność to prawdziwy nagłówek stojący za premierą.

DeepSeek‑V4‑Pro vs DeepSeek‑V4‑Flash

DeepSeek‑V4‑Pro

V4‑Pro to flagowy model dla użytkowników, którym najbardziej zależy na jakości. DeepSeek‑V4‑Pro oferuje lepszą wydajność w programowaniu agentowym, bogatszą wiedzę o świecie i światowej klasy rozumowanie; według strony premiery prowadzi wśród obecnych modeli otwartych, ustępując pod względem wiedzy o świecie jedynie Gemini‑3.1‑Pro. W raporcie technicznym V4‑Pro to większy model w rodzinie, a DeepSeek‑V4‑Pro jest dostępny poprzez te same interfejsy zgodne z OpenAI i Anthropic co V4‑Flash.

DeepSeek‑V4‑Flash

V4‑Flash to model stawiający na efektywność; jego zdolności rozumowania zbliżają się do V4‑Pro i osiąga porównywalne wyniki w prostych zadaniach agentowych, przy mniejszej liczbie aktywnych parametrów i krótszych czasach odpowiedzi. Wspiera zarówno tryby non‑thinking, jak i thinking, ma tę samą długość kontekstu 1M i te same kluczowe funkcje co Pro, ale przy znacznie niższym koszcie.

Który wybrać?

Używaj V4‑Pro, gdy zadanie jest wysokiej stawki, silnie zależne od wiedzy lub trudne do weryfikacji: badania korporacyjne, złożone programowanie, wieloetapowe wsparcie decyzyjne albo sytuacje, w których zależy Ci na możliwie najsilniejszej odpowiedzi. Wybierz V4‑Flash, gdy przepustowość, opóźnienia lub koszt tokenów mają większe znaczenie niż „wyciskanie” ostatnich punktów w benchmarkach. Taki wybór jest spójny z oficjalnym pozycjonowaniem i raportowanymi różnicami w benchmarkach między modelami.

| Parametr | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| Parametry łącznie | 284B | 1.6T |

| Aktywne parametry | 13B | 49B |

| Długość kontekstu | 1M | 1M |

| Tryby rozumowania | Non-think + think | Non-think + think |

| Najlepsze zastosowanie | Szybkie wnioskowanie, aplikacje o wysokiej przepustowości, agenci wrażliwi na koszty | Najwyższe możliwości rozumowania, trudniejsze zadania programistyczne i wymagające wiedzy |

| Oficjalne ceny API | Cache hit $0.028 / cache miss $0.14 / output $0.28 per 1M tokens | Cache hit $0.145 / cache miss $1.74 / output $3.48 per 1M tokens |

| Maksymalna długość odpowiedzi | 384K | 384K |

CometAPI zapewnia dostęp do Deepseek v4 Pro i V4 Flash — o 20% taniej niż oficjalnie — oraz płynne przełączanie między 500+ modelami (GPT‑5.4, Gemini 3.1 itd.) poprzez jeden punkt końcowy zgodny z OpenAI lub Anthropic Messages.

Benchmark wydajności

DeepSeek‑V3.2 vs V4‑Flash vs V4‑Pro

W tabeli porównującej modele bazowe V4‑Flash i V4‑Pro przewyższają DeepSeek‑V3.2 w kluczowych benchmarkach, przy czym V4‑Pro zazwyczaj prowadzi. Na przykład raport podaje następujące wyniki: AGIEval 82.6 / 83.1 vs 80.1 dla V3.2; MMLU 88.7 / 90.1 vs 87.8; MMLU‑Pro 68.3 / 73.5 vs 65.5; HumanEval 69.5 / 76.8 vs 62.8; oraz LongBench‑V2 44.7 / 51.5 vs 40.2 dla V3.2, gdzie środkowa wartość to V4‑Flash, a ostatnia to V4‑Pro.

| Benchmark | DeepSeek-V3.2-Base | DeepSeek-V4-Flash-Base | DeepSeek-V4-Pro-Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU-Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench-V2 (EM) | 40.2 | 44.7 | 51.5 |

Źródło: Raport techniczny DeepSeek‑V4, Tabela 1.

Wzorzec jest prosty: Flash zmniejsza dystans do Pro, ale Pro nadal jest ogólnie silniejszym modelem. To czyni V4‑Flash praktycznym domyślnym wyborem dla wielu systemów produkcyjnych, podczas gdy V4‑Pro jest modelem, po który warto sięgnąć, gdy jakość odpowiedzi jest ważniejsza niż koszt lub opóźnienie.

Porównania z modelami zachodnimi: gdzie mieści się V4

W jednej ewaluacji ludzkiej na chińskich zadaniach biurowych raport podaje, że DeepSeek‑V4‑Pro‑Max przewyższył Claude Opus 4.6‑Max, z 63% non‑loss rate. DeepSeek‑V4‑Pro „znacząco przewyższa” Claude Sonnet 4.5 i zbliża się do Claude Opus 4.5 na benchmarku R&D programistycznym.

| Obszar ewaluacji | Wynik DeepSeek | Porównanie z modelami zachodnimi | Wniosek |

|---|---|---|---|

| Chińskie zadania biurowe | V4‑Pro‑Max, 63% non-loss | vs Claude Opus 4.6‑Max | Mocny wynik w praktycznych zadaniach biznesowych |

| R&D benchmark programistyczny | Wskaźnik zaliczeń V4‑Pro‑Max 67 | vs Claude Sonnet 4.5: 47; Opus 4.5: 70; Opus 4.6 Thinking: 80 | Konkurencyjny względem czołowych modeli, zwłaszcza wobec systemów klasy Sonnet |

To nie jest „numer jeden we wszystkim”, ale już poziom, który „trzeba poważnie oceniać”.

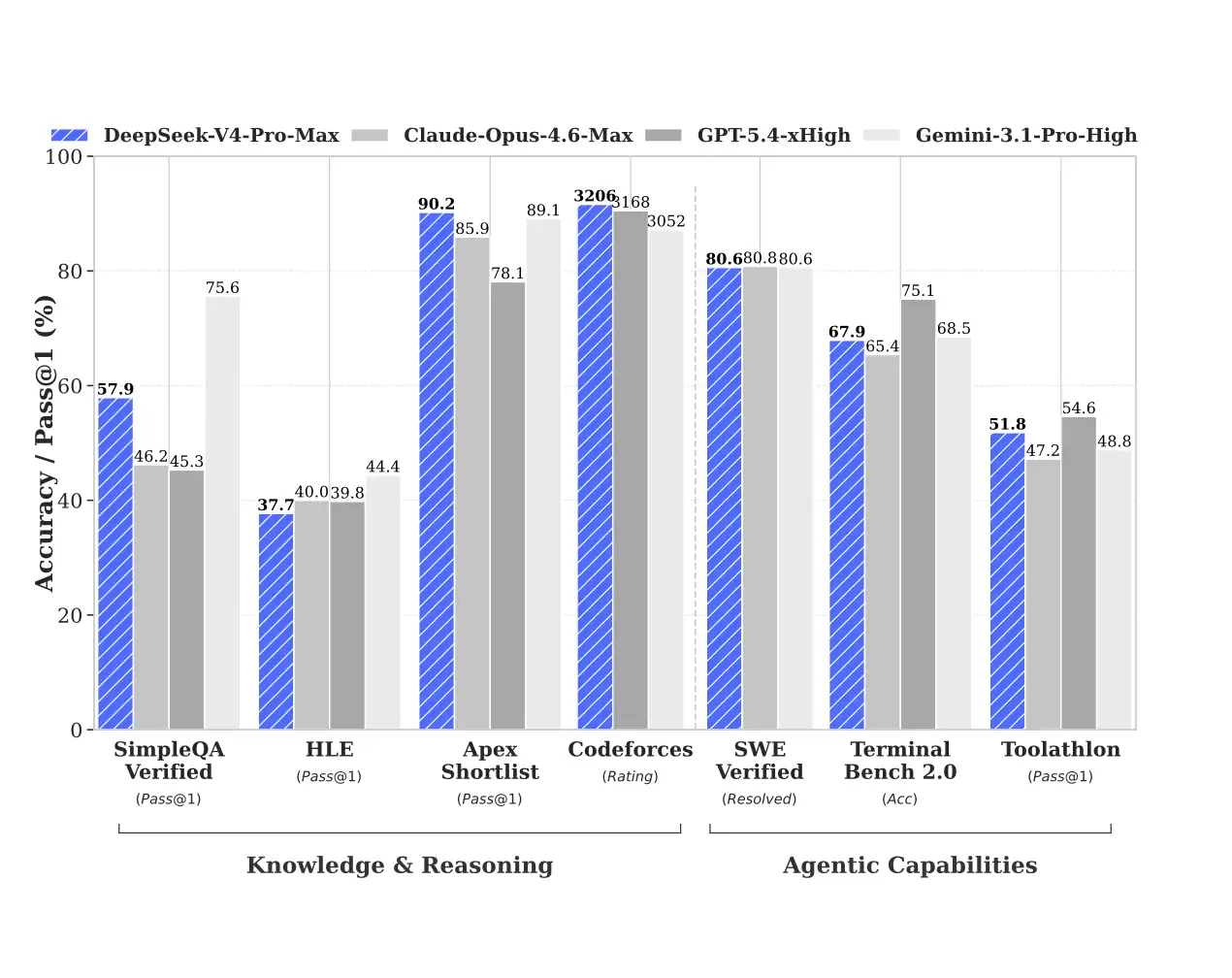

Raport techniczny DeepSeek porównuje V4‑Pro‑Max z Claude Opus 4.6 Max, GPT‑5.4 xHigh oraz Gemini 3.1 Pro High w tej samej tabeli. Wyniki nie są zero‑jedynkowe: zachodnie, zamknięte modele nadal wypadają silnie w niektórych aspektach wiedzy i wnioskowania; jednak V4‑Pro‑Max ma bardzo silną pozycję w kodzie, długim kontekście i części zadań agentowych. Innymi słowy, to już nie jest prosta narracja „krajowych alternatyw”, lecz etap „który jest bardziej odpowiedni do twojego scenariusza”.

Pod względem wiedzy i zdolności rozumowania jest na poziomie Opus 4.6 Max, GPT‑5.4 xHigh i Gemini 3.1 Pro High. Nieco ustępuje w możliwościach agentowych, choć różnica nie jest duża.

DeepSeek‑V4‑Pro‑Max jest bardzo konkurencyjny w scenariuszach zorientowanych na kod i długi kontekst, podczas gdy modele zachodnie pozostają bardzo silne w kilku benchmarkach czystego rozumowania i wiedzy. Tak należy czytać tę premierę: DeepSeek V4 jest mocno w czołówce, ale prowadzenie w benchmarkach zależy od zadania.

Jak uzyskać dostęp do DeepSeek V4

1) Korzystaj z oficjalnej wersji web i aplikacji

DeepSeek informuje, że V4 Preview jest dostępny już teraz w wersji web, aplikacji i API. Dla zwykłych użytkowników najprostszą ścieżką pozostaje oficjalny interfejs czatu, gdzie model można wybrać przez Expert Mode lub Instant Mode.

2) Użyj API

Zdecydowanie polecam CometAPI do dostępu do DeepSeek V4, ponieważ oferuje najlepszą cenę i zalety agregacji.

Nazwy modeli:

deepseek-v4-flashdeepseek-v4-pro

DeepSeek podaje również, że starsze nazwy

deepseek-chatideepseek-reasonerbędą wycofane i obecnie mapują się odpowiednio na tryby non‑thinking i thinking V4‑Flash do 2026-07-24. To istotne dla planowania migracji, jeśli masz starsze integracje w produkcji.

- Zarejestruj się w CometAPI i pobierz klucz API.

- Użyj standardowego OpenAI Python SDK (lub dowolnego zgodnego klienta) z niestandardowym base URL:

Oto prosty przykład w formacie zgodnym z OpenAI:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "Jesteś pomocnym asystentem."},

{"role": "user", "content": "Streść korzyści z kontekstu o wielkości miliona tokenów."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

Ten wzorzec żądania podąża za szybkim startem: ustaw base URL, wybierz deepseek-v4-pro lub deepseek-v4-flash i włącz thinking, gdy potrzebujesz głębszego rozumowania.

Jak skutecznie korzystać z DeepSeek V4

W przepływach pracy z długimi dokumentami najskuteczniejszy wzorzec to utrzymywanie kontekstu w czystej, uporządkowanej formie. Okno 1M tokenów to duża przewaga V4, ale model nadal działa najlepiej, gdy wejście jest zorganizowane w sekcje, cytaty źródłowe, instrukcje zadań i jednoznaczne ograniczenia wyjścia. To najnaturalniejszy sposób wykorzystania długiego kontekstu, który reklamuje DeepSeek.

W przepływach pracy z kodem i agentami zacznij od V4‑Flash dla szybkiej iteracji, a następnie przejdź do V4‑Pro na finalne uruchomienia lub najtrudniejsze kroki. To podejście jest zgodne z oficjalnym pozycjonowaniem: Flash jest opcją efektywną, Pro jest silniejszym modelem, a oba mają ten sam interfejs API i długość kontekstu.

Na koniec

DeepSeek‑V4 jest istotny, ponieważ łączy cztery rzeczy, których rynek chce jednocześnie: długi kontekst, silne rozumowanie, otwartą dostępność i agresywne ceny. Prawdziwa historia nie polega na tym, że DeepSeek wypuścił kolejny model. Chodzi o to, że firma próbuje uczynić AI klasy frontier ekonomicznie użyteczną w produkcji. Dla zespołów oceniających, gdzie postawić kolejny zakład na AI, to sygnał warty przetestowania, a nie zignorowania.

Dla zespołów budujących rozwiązania w oparciu o wielu dostawców to dokładnie taki rodzaj premiery, który warto zbenchmarkować we własnym stosie. CometAPI może być praktyczną warstwą do porównania DeepSeek‑V4 obok innych modeli z czołówki bez zmuszania zespołu produktowego do przebudowy integracji za każdym razem, gdy rynek się zmienia.