Google DeepMind oficjalnie wydało Gemma 4 2 kwietnia 2026 r., co stanowi ważny kamień milowy w otwartoźródłowej AI. Ta rodzina modeli dostarcza czołową inteligencję na parametr, opartą na tych samych badaniach i technologii, które napędzają Gemini 3. W przeciwieństwie do wcześniejszych wersji Gemma z niestandardowymi licencjami, Gemma 4 jest dostarczana na w pełni permisywnej licencji Apache 2.0, umożliwiającej nieograniczone komercyjne użycie, modyfikację i redystrybucję.

Gemma 4 wyróżnia się multimodalnymi możliwościami (wejścia tekst + obraz we wszystkich rozmiarach oraz audio w modelach brzegowych), natywnym wsparciem zaawansowanego rozumowania i agentowych przepływów pracy, długimi oknami kontekstu do 256K tokenów oraz optymalizacją pod kątem wszystkiego — od smartfonów i Raspberry Pi po wysokiej klasy GPU. Obsługuje ponad 140 języków i kładzie nacisk na efektywność, dzięki czemu potężna AI staje się dostępna na sprzęcie konsumenckim i brzegowym bez zależności od chmury.

CometAPI zapewnia znakomite interfejsy API do modeli open source i zamkniętych.

Czym jest Gemma 4?

Gemma 4 to najnowsza rodzina otwartych multimodalnych dużych modeli językowych (LLM) od Google DeepMind, zaprojektowana specjalnie do zaawansowanego rozumowania, agentowych przepływów pracy AI i wydajnego wdrażania na urządzeniach. Maksymalizuje „inteligencję na parametr”, wykorzystując wnioski z własnościowych badań nad Gemini 3, jednocześnie pozostając w pełni otwartoźródłowa i z otwartymi wagami.

Kluczowe usprawnienia względem wcześniejszych modeli Gemma obejmują:

- Natywna multimodalność: rozumienie tekstu i obrazu (we wszystkich modelach), z obsługą audio w mniejszych wariantach brzegowych.

- Konfigurowalny tryb myślenia: rozumowanie krok po kroku ze strukturyzowanym wyjściem <|think|>.

- Natywne wywoływanie funkcji i użycie narzędzi: idealne dla autonomicznych agentów.

- Rozszerzony kontekst: do 256K tokenów w większych modelach.

- Hybrydowa architektura uwagi: łączy lokalne okno przesuwne i globalną uwagę dla efektywności i wydajności przy długim kontekście.

- Per-Layer Embeddings (PLE) w mniejszych modelach oraz współdzielona pamięć podręczna KV dla oszczędności pamięci.

- Szerokie wsparcie wielojęzyczne: wstępne trenowanie na danych obejmujących 140+ języków z uwzględnieniem niuansów kulturowych.

Wydana na licencji Apache 2.0, Gemma 4 usuwa wcześniejsze ograniczenia licencyjne, które ograniczały adopcję w przedsiębiorstwach. Deweloperzy mogą teraz bez przeszkód dostrajać, wdrażać i komercjalizować — pozycjonując ją jako bezpośredniego konkurenta dla w pełni otwartych ekosystemów, takich jak Llama i Qwen.

Gemma 4 celuje w zróżnicowany sprzęt: urządzenia brzegowe (telefony, IoT, Raspberry Pi, Jetson Nano) dla niskich opóźnień w trybie offline oraz stacje robocze/GPU dla lokalnych serwerów o wysokiej wydajności. To podejście „local-first” priorytetyzuje prywatność, oszczędności kosztowe i wnioskowanie bez opóźnień.

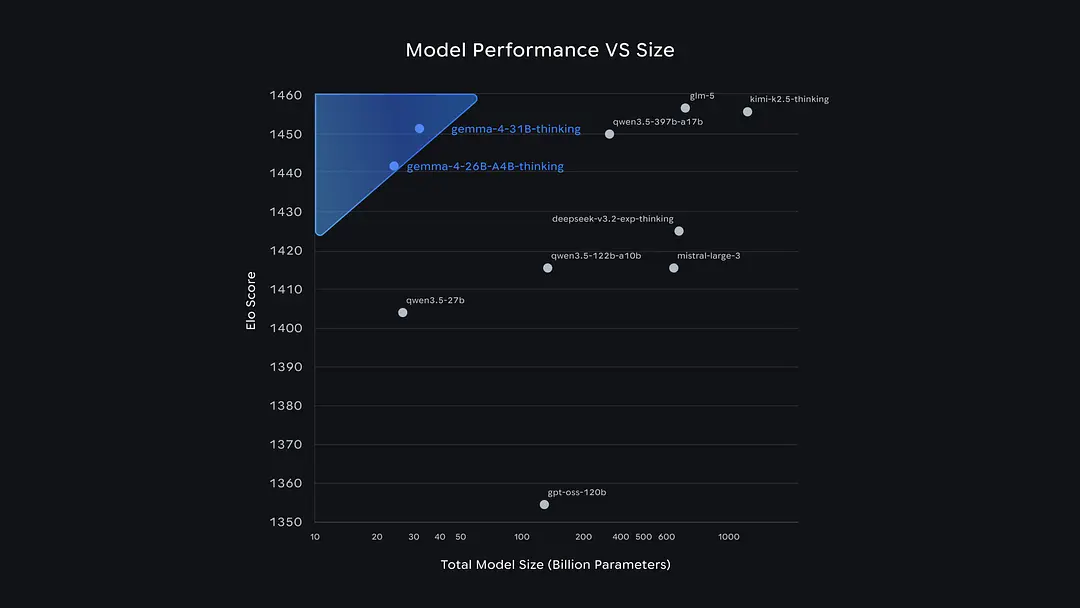

Wyprzedzające ją na liście Arena modele open source pochodzą głównie z zespołów chińskich. Gemma 4 niewiele różni się od Qwen 3.5 i GLM-5, ale znacząco różni się od GPT-OSS-120B firmy OpenAI.

Deweloperzy mogą teraz znaleźć GLM-5, Qwen 3.5, itd. na CometAPI.

Cztery wersje Gemma 4

Google wydało Gemma 4 w czterech starannie zoptymalizowanych rozmiarach, z których każdy równoważy wydajność, efektywność i scenariusze wdrożeń. Dwa korzystają z gęstych architektur z innowacyjnym Per-Layer Embeddings (PLE) dla efektywności na brzegu; jeden to Mixture-of-Experts (MoE) dla wysokiej wydajności przy niskim koszcie aktywnych parametrów; a jeden to flagowy model gęsty.

| Model | Architektura | Łączna liczba parametrów | Aktywne parametry (MoE) | Efektywne parametry | Długość kontekstu | Modalności | Docelowy sprzęt |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | Gęsty + PLE | ~5.1B (w tym osadzenia) | N/D | 2.3B | 128K | Tekst, Obraz, Audio | Smartfony, Raspberry Pi, urządzenia brzegowe IoT |

| Gemma 4 E4B | Gęsty + PLE | ~8B (w tym osadzenia) | N/D | 4.5B | 128K | Tekst, Obraz, Audio | Urządzenia mobilne, lekkie GPU, Jetson |

| Gemma 4 26B A4B | MoE (8 aktywnych / 128 łącznie + 1 współdzielona) | 25.2B | 3.8B–4B | N/D | 256K | Tekst, Obraz | Stacje robocze, konsumenckie GPU, serwery lokalne |

| Gemma 4 31B | Gęsty | 30.7B | N/D | N/D | 256K | Tekst, Obraz | Wysokiej klasy GPU (mieści się na pojedynczym H100/A100 w FP16) |

Gemma 4 E2B i E4B (zoptymalizowane na brzeg): korzystają z PLE, aby dodać specjalizację per warstwa przy minimalnym narzucie parametrów. Idealne dla urządzeń zasilanych bateryjnie lub z ograniczoną pamięcią. Enkoder audio (Conformer w stylu USM, ~300M parametrów) umożliwia zamianę mowy na tekst i tłumaczenie.

Gemma 4 26B A4B (MoE): aktywuje tylko ~4B parametrów podczas wnioskowania mimo ponad 25B łącznej liczby. Dostarcza wydajność zbliżoną do 31B przy dramatycznie niższym koszcie obliczeniowym — idealna do ekonomicznego skalowania.

Gemma 4 31B (Gęsty): flagowiec dla maksymalnych możliwości. Mieści się na pojedynczym GPU 80GB w pełnej precyzji i plasuje się wśród najlepszych otwartych modeli na listach.

Wszystkie modele obejmują warianty dostrojone instrukcyjnie („-it”) zoptymalizowane pod kątem czatu, rozumowania i użycia narzędzi, a także bazowe wersje wstępnie wytrenowane do dalszego dostrajania. Dwa duże modele przyjmują różne podejścia: model 31B Gęsty dąży do najwyższej jakości i stanowi najlepszą podstawę do fine-tuningu; model 26B MoE priorytetyzuje szybkość, aktywując jedynie 3.8 miliarda parametrów podczas wnioskowania, co skutkuje znacznie szybszym generowaniem słów, ale nieco niższą ogólną jakością.

Dwa mniejsze modele, E2B i E4B, zostały zaprojektowane specjalnie dla telefonów i urządzeń IoT: mogą działać całkowicie offline, oszczędzając pamięć i energię. Co więcej, te mniejsze modele mają możliwości, których brakuje większym: natywne wejście audio, umożliwiające bezpośrednie rozpoznawanie mowy.

Kluczowe możliwości Gemma 4

Gemma 4 wyróżnia się w obszarach kluczowych dla rzeczywistych zastosowań AI:

1. Zaawansowane rozumowanie i tryb myślenia

Konfigurowalne rozumowanie krok po kroku poprzez podpowiedzi systemowe lub enable_thinking=True. Zwraca ustrukturyzowane tagi <|think|> po których następują odpowiedzi końcowe. Zdecydowanie poprawia wyniki w złożonych zadaniach bez dodatkowego fine-tuningu.

2. Rozumienie multimodalne

- Wizja: wykrywanie obiektów (ramki ograniczające w JSON), OCR (wielojęzyczny), parsowanie dokumentów/PDF, rozumienie wykresów, zrozumienie UI, rozpoznawanie pisma odręcznego oraz obsługa obrazów o zmiennej rozdzielczości (budżety tokenów: 70–1120 tokenów).

- Wideo: do 60 sekund (przetwarzanie 1 fps).

- Audio (tylko E2B/E4B): automatyczne rozpoznawanie mowy (ASR) i tłumaczenie mowy na tekst (max 30s).

- Wejścia przeplatane: mieszanie tekstu, obrazów i audio w dowolnej kolejności.

3. Agentowe przepływy pracy i wywoływanie funkcji

Natywne wsparcie użycia narzędzi umożliwia autonomicznych agentów do wieloetapowego planowania, wywołań API, nawigacji po aplikacjach i realizacji zadań. Silne wyniki na τ2-bench (agentowe użycie narzędzi).

4. Programowanie i narzędzia deweloperskie

Wyjątkowe generowanie kodu, uzupełnianie, debugowanie i rozumienie na poziomie repozytoriów. Obsługuje wyjścia o strukturze JSON dla bezproblemowej integracji. Osiąga 80.0% (31B) na LiveCodeBench v6, pozycjonując się jako asystent programistyczny w podejściu local-first, odpowiedni dla scenariuszy rozwoju offline.

5. Długi kontekst i wielojęzyczność

Niezawodnie obsługuje 128K–256K tokenów (testowane na MRCR needle-in-haystack). Wstępnie trenowana na zróżnicowanych danych do stycznia 2025 r., ze silnymi wynikami międzyjęzykowymi. To nie tylko wielojęzyczne tłumaczenie; model jest natywnie trenowany i obejmuje ponad 140 języków.

Dane benchmarkowe: rozbicie wydajności Gemma 4

Gemma 4 ustanawia nowe standardy dla otwartych modeli. Warianty 31B i 26B dostarczają wyniki, które wcześniej były zarezerwowane dla znacznie większych systemów własnościowych, podczas gdy modele brzegowe przewyższają większego poprzednika Gemma 3.

Pełne wyniki benchmarków (modele dostrojone instrukcyjnie)

| Benchmark | Kategoria | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (bez think) |

|---|---|---|---|---|---|---|

| MMLU Pro | Rozumowanie i wiedza | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (no tools) | Matematyka | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | Nauki na poziomie magisterskim | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (avg) | Agentowe użycie narzędzi | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | Kodowanie | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | Programowanie konkursowe | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | Multimodalne rozumowanie | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | Matematyka + Wizja | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8-needle, 128K) | Długi kontekst | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

Kluczowe wnioski:

- Ogromny skok względem Gemma 3: model 31B poprawia wynik AIME z 20.8% do 89.2% i LiveCodeBench z 29.1% do 80.0%.

- Efektywność MoE: 26B A4B niemal dorównuje 31B, zużywając znacznie mniej zasobów podczas wnioskowania.

- Dominacja na brzegu: E4B i E2B przewyższają Gemma 3 27B w wielu metrykach mimo że są 6–10× mniejsze.

- Pozycje w rankingach: 31B osiąga ~1452 na Arena AI (tekst); 26B A4B ~1441. Wariant 26B podobno przewyższa znacznie większe modele, takie jak Qwen 3.5 397B, pod względem preferencji użytkowników i kodowania.

Benchmarki wizji i audio potwierdzają silną, gotową do użycia wydajność multimodalną bez specjalistycznego fine-tuningu.

Ekosystem i wsparcie narzędziowe

Gemma 4 cieszy się natychmiastową, szeroką integracją z ekosystemem:

- Hugging Face: wsparcie od pierwszego dnia z

transformers,pipeline("any-to-any"), GGUF, ONNX i procesorami multimodalnymi. - Lokalne środowiska uruchomieniowe: Ollama, Llama.cpp (LM Studio, Jan), MLX (Apple Silicon z TurboQuant), Mistral.rs (Rust), Transformers.js (wnioskowanie w przeglądarce przez WebGPU).

- Fine-tuning: TRL, Unsloth, PEFT, Vertex AI oraz pełne wsparcie dla multimodalnych zestawów danych.

- Optymalizacja sprzętowa: NVIDIA RTX/DGX Spark/Jetson (przez TensorRT-LLM), Google AI Edge tools oraz wdrożenia na Android/iOS na urządzeniu.

- Frameworki agentowe: OpenClaw, Hermes, Pi oraz testy w symulacji CARLA.

- Chmura/Studio: Google AI Studio do szybkich testów; Kaggle Models do pobrania.

Ten ekosystem pozwala wdrożyć Gemma 4 w kilka minut na laptopach, serwerach lub urządzeniach brzegowych.

Ograniczenia i bezpieczeństwo:

- Odcięcie danych treningowych: styczeń 2025 (brak wiedzy w czasie rzeczywistym bez narzędzi).

- Audio ograniczone do mowy (nie muzyki); wideo ograniczone do 60 s.

- Ryzyko halucynacji pozostaje — używaj trybu myślenia i weryfikacji.

- Bezpieczeństwo: rygorystyczne filtrowanie i ewaluacje zgodne z Google AI Principles; deweloperzy powinni dodać zabezpieczenia specyficzne dla aplikacji.

Dlaczego Gemma 4 ma znaczenie w 2026

Gemma 4 demokratyzuje czołową AI. Dzięki połączeniu multimodalnej inteligencji, możliwości agentowych i swobody Apache 2.0 z niezależną od sprzętu efektywnością, umożliwia deweloperom i przedsiębiorstwom budowanie bezpiecznych, prywatnych i opłacalnych rozwiązań AI na skalę. Przełom w „inteligencji na parametr” — szczególnie widoczny w modelach brzegowych przewyższających wczorajsze flagowe modele open source — sygnalizuje przejście ku prawdziwie powszechnej AI.

Niezależnie od tego, czy uruchamiasz model 2B na telefonie, czy lokalnie potężny 31B, Gemma 4 dowodzi, że open source w AI dogonił (a w wielu przypadkach przewyższył) zamknięte alternatywy pod względem praktycznej użyteczności.