OpenAI ogłosiło GPT Image 1.5, nowy flagowy model firmy do generowania i edycji obrazów, oraz wprowadziło odświeżone doświadczenie „ChatGPT Images” w ChatGPT i w API. OpenAI promuje tę premierę jako krok w kierunku tworzenia obrazów na poziomie produkcyjnym: lepsze podążanie za instrukcjami, bardziej precyzyjne edycje zachowujące ważne detale (twarze, oświetlenie, logotypy), wyniki nawet 4× szybciej oraz niższe koszty wejścia/wyjścia obrazów w API. Dobrą wiadomością jest to, że CometAPI zintegrowało GPT-image 1.5 (gpt-image-1.5) i oferuje niższą cenę niż OpenAI.

Czym jest GPT Image 1.5?

GPT Image 1.5 to najnowsza generacja modelu obrazowego OpenAI, wydana jako silnik napędzający przebudowane doświadczenie ChatGPT Images i udostępniona poprzez OpenAI API jako gpt-image-1.5. OpenAI pozycjonuje go nie tylko jako narzędzie do artystycznych nowinek, ale jako gotowe do produkcji „kreatywne studio”: ma umożliwiać precyzyjne, powtarzalne edycje i wspierać przepływy pracy, takie jak katalogi e‑commerce, generowanie wariantów zasobów marki, pipeline’y kreatywnych assetów oraz szybkie prototypowanie. Wyraźnie podkreślono postępy w zachowaniu ważnych szczegółów obrazów — twarzy, logotypów, oświetlenia — oraz w podążaniu za instrukcjami edycji krok po kroku.

Dwa szczegóły operacyjne, o których warto pamiętać: GPT Image 1.5 renderuje obrazy nawet czterokrotnie szybciej niż poprzednik, a wejścia/wyjścia obrazów są o ok. 20% tańsze w API w porównaniu z GPT Image 1.0 — oba aspekty istotne dla zespołów, które dużo iterują. Nowy interfejs ChatGPT Images dodaje też dedykowany obszar roboczy w pasku bocznym, predefiniowane filtry i popularne prompty oraz jednorazowe przesłanie „podobizny” (likeness) do powtarzalnych personalizacji.

Jak GPT Image 1.5 ewoluował względem wcześniejszych modeli obrazowych OpenAI?

Linia modeli obrazowych OpenAI przeszła od DALL·E → wiele wewnętrznych eksperymentów obrazowych → GPT Image 1 (i mniejsze warianty). W porównaniu z wcześniejszymi modelami obrazowymi OpenAI (np. GPT-image-1 i wcześniejszymi stosami obrazowymi ChatGPT), wersja 1.5 jest wyraźnie zoptymalizowana pod kątem:

- Dokładniejszego podążania za instrukcjami — model ściślej stosuje się do poleceń tekstowych.

- Wyższej wierności edycji obrazów — zachowuje kompozycję, rysy twarzy, oświetlenie i logotypy w trakcie edycji, dzięki czemu powtarzane edycje pozostają spójne.

- Szybszej, tańszej inferencji — OpenAI deklaruje nawet 4× szybsze działanie niż poprzedni model obrazowy oraz obniżone koszty tokenów/obrazów dla wejść i wyjść.

W skrócie: zamiast traktować generowanie obrazów jako jednorazową „zabawkę artystyczną”, OpenAI przesuwa modele obrazowe w stronę przewidywalnych, powtarzalnych narzędzi dla zespołów kreatywnych i przepływów korporacyjnych.

Najważniejsze funkcje GPT Image 1.5

Możliwości edycji i zachowania cech obrazu

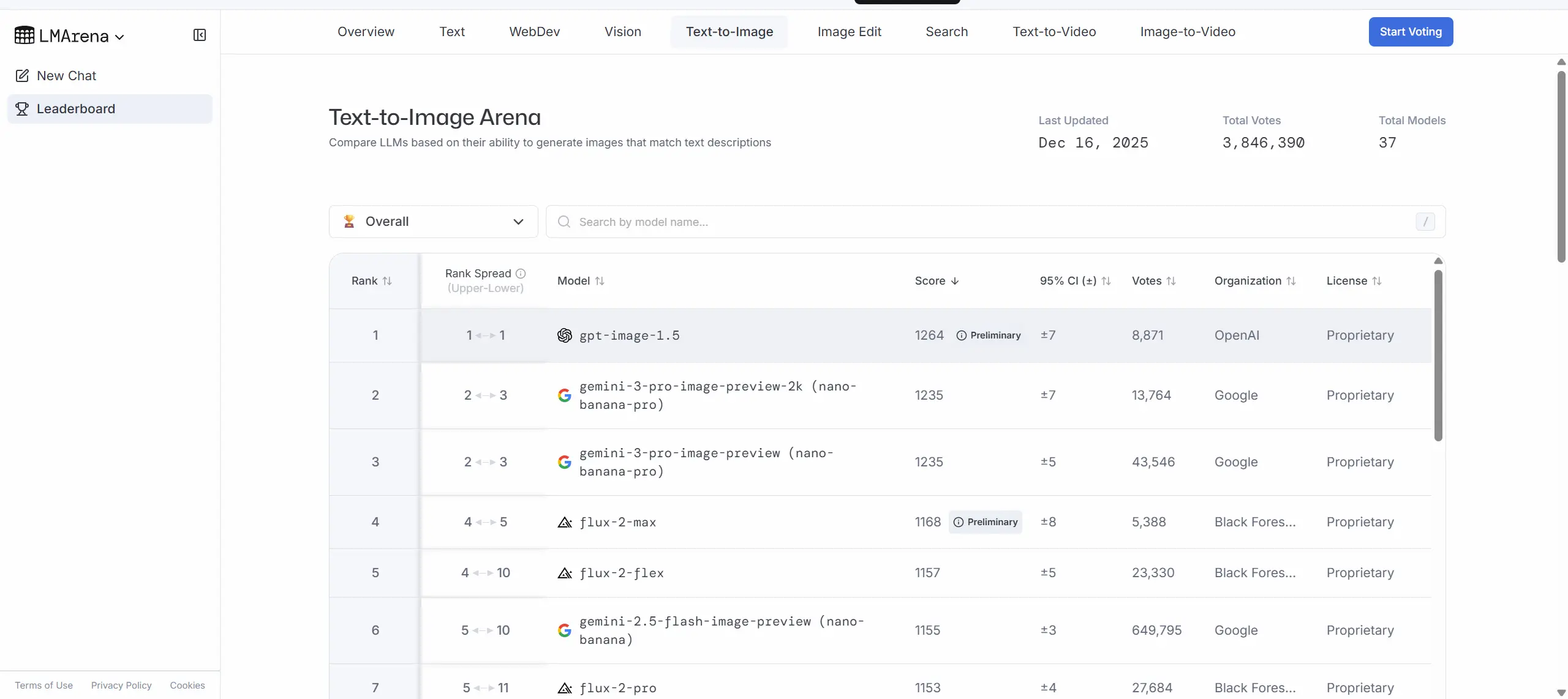

GPT Image 1.5 osiąga bardzo dobre wyniki w kilku rankingach generowania i edycji obrazów opublikowanych od czasu premiery. LMArena raportuje, że GPT Image 1.5 plasuje się na szczycie lub blisko szczytu list dla text-to-image i ed assignów edycji obrazów, czasem minimalnie przed konkurentami, takimi jak Google Nano Banana Pro.

Jedną z kluczowych funkcji GPT Image 1.5 jest precyzyjna edycja, która zachowuje „to, co istotne”: gdy prosisz model o zmianę konkretnego obiektu lub atrybutu, stara się zmienić wyłącznie ten element, utrzymując spójną kompozycję, oświetlenie i wygląd osób w kolejnych edycjach. Dla marek i zespołów e‑commerce przekłada się to na mniej ręcznych poprawek po automatycznych edycjach.

Jak szybki jest model i co oznacza „4× szybciej”?

OpenAI informuje, że generowanie obrazów w ChatGPT Images jest nawet 4× szybsze niż wcześniej, a koszty I/O obrazów w API są ~20% niższe niż w GPT Image 1. To deklaracja na poziomie produktu: szybszy czas renderowania oznacza, że możesz iterować więcej obrazów w tej samej sesji, rozpoczynać dodatkowe generacje, gdy inne jeszcze się przetwarzają, i zmniejszać tarcie w eksploracyjnych przepływach pracy. Szybsza inferencja nie tylko redukuje opóźnienia dla użytkowników końcowych, ale także obniża zużycie energii na żądanie i koszt operacyjny wdrożeń. Uwaga: „do” oznacza, że zyski w realnych warunkach będą zależeć od złożoności promptu, rozmiaru obrazu oraz obciążenia systemu.

Lepsze podążanie za instrukcjami i renderowanie tekstu

W porównaniu z GPT Image 1.0 wzmocniono podążanie za instrukcjami: model lepiej interpretuje wieloetapowe prompty i utrzymuje intencję użytkownika w łańcuchach edycji. Wskazano także poprawione renderowanie tekstu (czytelny tekst osadzony w obrazach) oraz lepsze renderowanie małych twarzy, choć nadal sygnalizowane są ograniczenia wielojęzyczności/renderowania tekstu w niektórych skrajnych przypadkach. Ogólnie jednak model ma domykać dotychczasową lukę, gdy generowane obrazy zawierały nieczytelne lub bezsensowne napisy.

GPT Image 1.5 vs Nano Banana Pro (Google) vs Qwen-Image (Alibaba)?

Czym jest Google Nano Banana Pro?

Nano Banana Pro (markowany w rodzinie Gemini jako Gemini 3 Pro Image / Nano Banana Pro) to model obrazowy Google/DeepMind klasy studyjnej. Google podkreśla znakomite renderowanie tekstu, kompozycję wieloobrazową (łączenie wielu obrazów w jeden) oraz integrację z szerszymi możliwościami Gemini (osadzanie w wynikach wyszukiwania, tłumaczenia z uwzględnieniem lokalizacji oraz przepływy korporacyjne w Vertex AI). Nano Banana Pro ma być gotowy do produkcji dla projektantów, którzy potrzebują wysokiej wierności i przewidywalnego układu tekstu wewnątrz obrazów.

Czym jest Qwen-Image?

Qwen-Image (z rodziny Qwen/Tongyi) to model obrazowy wydany przez Alibaba, oceniany w ramach akademickich i publicznych benchmarków. Raport techniczny zespołu Qwen dokumentuje mocne wyniki przekrojowe (GenEval, DPG, OneIG-Bench) i podkreśla szczególne atuty w rozumieniu promptów, wielojęzycznym renderowaniu tekstu (zwłaszcza po chińsku) oraz solidnej edycji. Qwen-Image jest często wskazywany jako jedna z wiodących opcji open-source/przyjaznych dla przedsiębiorstw poza amerykańskimi hiperskalerami.

Bezpośrednie porównanie: mocne strony każdego

- GPT Image 1.5 (OpenAI) — Mocne strony: szybka generacja, silne podążanie za instrukcjami w wieloetapowych przepływach, dobrze zintegrowany UX ChatGPT i szeroka dostępność przez API. Wczesne benchmarki lokują go na szczycie lub bardzo blisko w łączonych metrykach generowania i edycji; prezentacja OpenAI skupia się na modelu jako „kreatywnym studio” dla praktycznej produktywności.

- Nano Banana Pro (Google) — Mocne strony: wyjątkowe renderowanie tekstu i integracje korporacyjne (Vertex AI, Google Workspace), silna lokalizacja i kompozycja wieloobrazowa, studyjne sterowanie kątem/oświetleniem/proporcjami/wyjściem 2K. Google akcentuje użyteczność modelu w pipeline’ach marketingowych/lokalizacyjnych i precyzyjnym tworzeniu plakatów/makiet.

- Qwen-Image (Alibaba) — Mocne strony: wyniki przekrojowe na międzynarodowych zbiorach, otwarty raport techniczny oraz silne wielojęzyczne renderowanie tekstu. Atrakcyjny wybór dla deweloperów i firm koncentrujących się na rynkach azjatyckich i poszukujących transparentnych wyników benchmarków.

Praktyczne różnice zauważalne dla deweloperów

- API i wzorce integracji: OpenAI udostępnia GPT Image 1.5 przez Image API i Responses API; Google udostępnia Nano Banana Pro przez Gemini/Vertex; Alibaba publikuje dokumentację modelu i końcówki demonstracyjne. Ceny i limity przepustowości różnią się między dostawcami i wpłyną na koszty produkcyjne oraz decyzje o przepustowości.

- Kompromisy kontroli vs. szybkości: Niektórzy dostawcy oferują tryby „fast/flash” vs „thinking/pro” — np. Nano Banana (fast) vs Nano Banana Pro (thinking). Komunikaty OpenAI sugerują, że GPT Image 1.5 zmniejsza praktyczną potrzebę wyboru między jakością a szybkością, jednak strojenie kosztów/wydajności nadal będzie istotne przy generacji masowej.

Jak uzyskać dostęp i używać GPT Image 1.5

Są dwa sposoby uzyskania dostępu:

ChatGPT (UI) — GPT Image 1.5 zasila nowe doświadczenie ChatGPT Images (zakładka Images). Użyj go do generowania z tekstu, przesyłania obrazów i wprowadzania edycji lub interaktywnej iteracji.

API — Skorzystaj z Image API (/v1/images/generations i /v1/images/edits), aby generować i edytować obrazy z gpt-image-1.5. Odpowiedzi to obrazy zakodowane w base64 dla modeli obrazowych GPT.

Dobrą wiadomością jest to, że CometAPI zintegrowało GPT-image 1.5 (gpt-image-1.5) i oferuje niższą cenę niż OpenAI. Możesz użyć CometAPI, aby jednocześnie korzystać i porównywać Nano banana pro i Qwen image.

Jakie są praktyczne przypadki użycia i zalecane przepływy pracy?

Zastosowania, które zyskują najwięcej

- E‑commerce i katalogowanie produktów: tworzenie wielu spójnych zdjęć produktu z jednego egzemplarza, zmiana teł i zachowanie spójności oświetlenia oraz detali w ramach serii. Stabilność edycji GPT Image 1.5 pomaga w tym obszarze.

- Kreacje reklamowe i szybka iteracja: szybsze generowanie skraca cykle tworzenia wariantów do testów A/B.

- Retusz zdjęć i lokalizacja: podmiana rekwizytów lub strojów przy zachowaniu spójności tożsamości modela w kampaniach lokalizowanych regionalnie.

- Prototypowanie projektów i concept art: model wspiera zarówno wyjścia fotorealistyczne, jak i wysoko stylizowane, przydatne we wczesnej eksploracji koncepcji.

Kto najbardziej skorzysta z GPT Image 1.5?

- Twórcy treści i zespoły social media, które potrzebują szybkiej, iteracyjnej edycji i kreatywnych transformacji.

- Projektanci i zespoły produktowe, prototypujące zasoby UI/UX, obrazy hero lub makiety reklam wymagające szybkich szkiców.

- Zespoły e‑commerce wykonujące makiety produktowe (przymiarki odzieży, podmiany tła, nakładki z tekstem).

- Deweloperzy budujący konwersacyjne, oparte na obrazach doświadczenia (np. czatowe edytory zdjęć, automatyzacja marketingu).

Sugerowany przepływ pracy dla twórców

- Prototypuj w ChatGPT Images, aby dopracować instrukcje (używaj presetów, by odkrywać style).

- Przypnij migawkę w użyciu API dla stabilności produkcyjnej (

gpt-image-1.5-YYYY-MM-DD). - Prowadź kontrolowane testy A/B, porównując wyniki modeli i koszty post-processingu ręcznego.

- Zintegruj kontrole moderacji i człowieka w pętli przy zadaniach wrażliwych na markę lub bezpieczeństwo.

Zagadnienia kosztów i wydajności

Szybsze generowanie może zmniejszyć opóźnienia i (w zależności od cen) koszt na obraz, ale w zastosowaniach korporacyjnych należy mierzyć zarówno przepustowość, jak i ceny tokenów/obliczeń.

Bezpieczeństwo, stronniczość i halucynacje

GPT Image 1.5 redukuje pewne klasy błędów (nietrafione edycje, niespójne twarze), ale ich nie eliminuje. Jak inne modele generatywne, może odtwarzać uprzedzenia kulturowe lub tworzyć nieprecyzyjne przedstawienia, jeśli prompty są niedookreślone. Wdrażaj zabezpieczenia: filtry treści, ocenę przez człowieka oraz zestawy testów odzwierciedlające oczekiwane przypadki brzegowe.

Konkluzja — czy warto wypróbować GPT Image 1.5?

Jeśli Twój projekt potrzebuje wysokiej jakości generowania obrazów lub solidnej, iteracyjnej edycji w konwersacyjnych przepływach pracy (na przykład: kreacje marketingowe, makiety produktów, wirtualne przymiarki lub image‑enabled SaaS pro.

Aby zacząć, sprawdź możliwości GPT Image 1.5 w Playgroundzie i zapoznaj się z przewodnikiem po API w celu uzyskania szczegółowych instrukcji. Przed dostępem upewnij się, że zalogowałeś(-aś) się do CometAPI i uzyskałeś(-aś) klucz API. CometAPI oferuje cenę znacznie niższą niż oficjalna, aby ułatwić integrację.

Ready to Go?→ Free trial of GPT image 1.5 models !