W szybko przyspieszającym krajobrazie sztucznej inteligencji xAI ponownie przyciągnęła uwagę branży — nie efektowną prezentacją, lecz bezlitosną, błyskawiczną strategią wdrożeń, która przeczy tradycyjnym cyklom wydań. Na styczeń 2026 społeczność AI wrze z powodu pojawienia się Grok 4.2, wyrafinowanej iteracji flagowego modelu Elona Muska. W przeciwieństwie do poprzedników, Grok 4.2 dotarł poprzez serię „ukrytych punktów kontrolnych” — tajemniczych wariantów modelu pojawiających się w rankingach pod kryptonimami jak Obsidian, Vortex Shade i Quantum Crow.

Czym jest Grok 4.2?

Grok 4.2 reprezentuje zmianę paradygmatu w podejściu xAI do rozwoju modeli. Podczas gdy Grok 3 i Grok 4 definiowały ogromne, wyraźne skoki w liczbie parametrów i architekturze, Grok 4.2 najlepiej rozumieć jako hiperoptymalizowane udoskonalenie architektury Grok 4.x, zaprojektowane, aby zlikwidować lukę między „surową inteligencją” a „praktyczną użytecznością”.

Model nie podążał tradycyjną ścieżką pojedynczej, monolitycznej premiery. Zamiast tego, doniesienia z początku stycznia 2026 wskazują, że xAI wypuszcza wiele punktów kontrolnych do aren testowych. Te checkpointy to zasadniczo różne „smaki” lub migawki rozwojowe modelu, każdy dostrojony pod konkretne mocne strony — jedne pod szybkość, inne pod głębokie rozumowanie czy kreatywny design.

Strategia wydania „Stealth”

Istnienie Grok 4.2 po raz pierwszy potwierdzono nie , lecz przez bystrych obserwatorów „Alpha Arena” i „Design Arena” — platform, na których modele AI są ślepo testowane wobec ludzkich preferencji. Użytkownicy zaczęli zauważać nowego pretendenta, często oznaczanego kryptonimami takimi jak „Obsidian” lub „Grok-4.20” (ukłon w stronę znanego poczucia humoru Muska). Modele te wykazywały możliwości znacząco przewyższające niedawno wydanego Grok 4.1, szczególnie w programowaniu i złożonych zadaniach wizualnych.

Podejście „wielu punktów kontrolnych” pozwala xAI testować eksperymentalne funkcje — jak nowe funkcje aktywacji czy gęste optymalizacje architektury — „w terenie”, bez zobowiązywania się do jednego, statycznego modelu. Odzwierciedla to filozofię inżynierii oprogramowania zastosowaną do AI: ciągła integracja i ciągłe wdrażanie (CI/CD), zapewniające, że Grok skutecznie ewoluuje w czasie rzeczywistym.

Jakie funkcje przyniesie Grok 4.2?

Podczas gdy Grok 4.1 zbierał pochwały za „inteligencję emocjonalną” i obniżony poziom halucynacji, Grok 4.2 jawi się jako „inżynier” przy „poecie” 4.1. Funkcje zaobserwowane w wyciekłych punktach kontrolnych sugerują zwrot w stronę twardej logiki, natywnej multimodalności i autonomicznych zachowań agentowych.

1. Natywna multimodalność: koniec przetwarzania „Text-First”

Jednym z najgłębszych ulepszeń Grok 4.2 jest rzekoma natywna multimodalność. W odróżnieniu od poprzednich modeli, które mogły używać osobnego enkodera wizji, by „zobaczyć” obraz, a następnie tłumaczyć go na tekst do przetworzenia przez LLM, uważa się, że Grok 4.2 przetwarza audio, wideo i tekst jako pojedynczy strumień informacji.

- Zrozumienie wideo: Wczesne testy sugerują, że Grok 4.2 potrafi oglądać wideo i rozumieć nie tylko obiekty wizualne, ale również fizykę i przyczynowość w obrębie sceny. Na przykład, gdy pokazuje mu się filmik o spadającej szklance, rozumie, dlaczego się rozbiła, a nie tylko identyfikuje rozbitą szklankę.

- Synteza audio-wizualna: Pozwala to na bezszwowe interakcje, w których użytkownik może pokazać AI strumień wideo na żywo i zadawać pytania w czasie rzeczywistym, a model odpowiada natychmiast, reagując na wskazówki wizualne — kluczowa funkcja dla integracji z robotem Optimus Tesli.

2. Ogromne, 2-milionowe okno kontekstu

Wyciek wskazuje, że Grok 4.2 przesuwa granice pamięci dzięki 2-milionowemu oknu kontekstu w trybie standardowym.

Aby zobrazować skalę:

- Może wchłonąć około 1.5 miliona słów lub mniej więcej 3,000 stron tekstu w pojedynczym promptcie.

- Zastosowanie w praktyce: Deweloper mógłby wgrać cały kod źródłowy złożonego jądra systemu operacyjnego, a Grok 4.2 potrafiłby prześledzić błąd w setkach plików jednocześnie. Zespół prawny mógłby dostarczyć mu lata orzecznictwa i transkrypcji sądowych, by odnaleźć konkretny precedens.

- Biegłość w „igle w stogu siana”: Co kluczowe, xAI wydaje się, że rozwiązało zjawisko „lost in the middle”, w którym modele zapominają informacje ukryte w środku długiego promptu. Grok 4.2 wykazuje niemal perfekcyjne przypominanie w całym swoim ogromnym kontekście.

3. Silniki rozumowania „Deep Thought”

Budując na „Thinking Mode” wprowadzonym w Grok 4.1, iteracja 4.2 wykorzystuje bardziej zaawansowane podejście „Compute-Over-Time”. W obliczu złożonego problemu — takiego jak dowód matematyczny lub strategiczna decyzja finansowa — Grok 4.2 potrafi „zatrzymać się”, by zasymulować wiele potencjalnych rozwiązań, zanim wygeneruje odpowiedź.

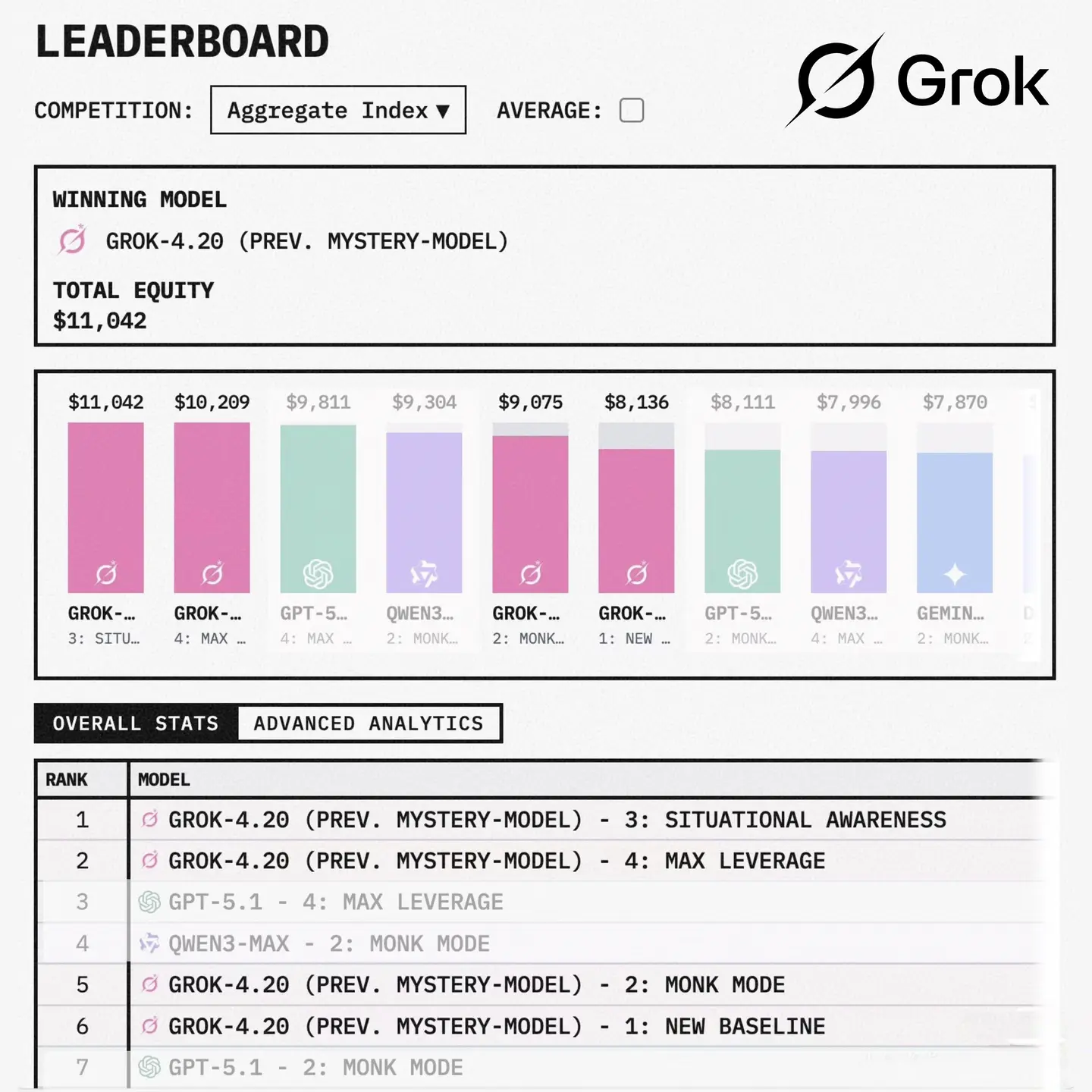

- Wynik na Alpha Arena: W zdumiewającym pokazie tej zdolności, wyciek z benchmarku symulacji handlu akcjami na „Alpha Arena” wykazał, że wariant Grok 4.2 osiągnął 12.11% zysku w ciągu dwóch tygodni, podczas gdy konkurenci tacy jak GPT-5.1 i Gemini 3 Pro rzekomo traciły na wartości. Sugeruje to poziom strategicznej przewidywalności i oceny ryzyka wcześniej niespotykany w LLM-ach.

4. Zaawansowane programowanie i możliwości projektowe „Obsidian”

Checkpoint o kryptonimie „Obsidian” wykazał szczególny talent do front-endu i projektowania UI.

- Elementy interaktywne: Użytkownicy zgłaszali, że ta wersja potrafi generować kod złożonych, interaktywnych elementów webowych — takich jak karty po najechaniu, dynamiczne wykresy, a nawet grywalne minigierki (np. Snake lub Tetris) — w jednej próbie.

- SVG i grafika: Poza kodem wykazuje biegłość w bezpośrednim generowaniu SVG (Scalable Vector Graphics), co pozwala mu „rysować” diagramy i schematy w ramach wyjścia kodowego, zacierając granicę między koderem a projektantem.

Jakie są powiązane wycieki informacji?

Ekosystem wycieków wokół Grok 4.2 jest gęsty i fascynujący, kreśląc obraz modelu testowanego do granic możliwości przed szerokim wydaniem.

Warianty „Vortex Shade” i „Quantum Crow”

Górnicy danych i zaawansowani użytkownicy na platformach takich jak LMArena zidentyfikowali kilka wysoko wydajnych anonimowych modeli, które mają charakterystyczne sygnatury tokenizera xAI.

- Vortex Shade: Ten wariant wydaje się zoptymalizowany pod szybkość i zwięzłość. Konsekwentnie dostarcza odpowiedzi o 30–40% szybciej niż Grok 4.1 Fast, prawdopodobnie z myślą o zastosowaniach w czasie rzeczywistym na platformie X (dawniej Twitter).

- Quantum Crow: Ten model wykazuje niezwykle wysoki „wskaźnik odmów” dla niejednoznacznych pytań, ale osiąga wyjątkowo wysokie wyniki w benchmarkach z matematyki i fizyki. Analitycy spekulują, że to wyspecjalizowany wariant „Truth Mode”, zaprojektowany tak, by priorytetyzować dokładność faktograficzną ponad płynnością konwersacyjną, być może do zastosowań w badaniach naukowych.

Nomenklatura „4.20”

Słabość Elona Muska do kultury memów jest widoczna nawet w wewnętrznym wersjonowaniu. Kilka wycieków odnosi się do buildu „Grok 4.20”.

Choć to żartobliwe, build ten pojawił się w logach serwera jako wersja „Heavy” modelu. Krąży pogłoska, że to wersja „bez kwantyzacji” (pełna precyzja) Grok 4.2, wymagająca ogromnych zasobów obliczeniowych (prawdopodobnie klastra xAI „Colossus”) i zarezerwowana dla najbardziej wymagających zadań korporacyjnych.

„Reality Engine”

Uporczywa plotka dotyczy modułu o nazwie „Reality Engine.” Wyciekła dokumentacja wewnętrzna sugeruje, że Grok 4.2 jest podłączony do żywej, z prawem odczytu i zapisu, bazy „ground truths” pochodzących z danych „Community Notes” platformy X. Pozwalałoby to modelowi na weryfikację własnych halucynacji względem stale aktualizowanego rejestru zweryfikowanych faktów, teoretycznie czyniąc go najbardziej „aktualnym” modelem AI na świecie.

Jakie są powiązane wycieki informacji?

Ekosystem wycieków wokół Grok 4.2 jest gęsty i fascynujący, kreśląc obraz modelu testowanego do granic możliwości przed szerokim wydaniem.

Warianty „Vortex Shade” i „Quantum Crow”

Górnicy danych i zaawansowani użytkownicy na platformach takich jak LMArena zidentyfikowali kilka wysoko wydajnych anonimowych modeli, które mają charakterystyczne sygnatury tokenizera xAI.

- Vortex Shade: Ten wariant wydaje się zoptymalizowany pod szybkość i zwięzłość. Konsekwentnie dostarcza odpowiedzi o 30–40% szybciej niż Grok 4.1 Fast, prawdopodobnie z myślą o zastosowaniach w czasie rzeczywistym na platformie X (dawniej Twitter).

- Quantum Crow: Ten model wykazuje niezwykle wysoki „wskaźnik odmów” dla niejednoznacznych pytań, ale osiąga wyjątkowo wysokie wyniki w benchmarkach z matematyki i fizyki. Analitycy spekulują, że to wyspecjalizowany wariant „Truth Mode”, zaprojektowany tak, by priorytetyzować dokładność faktograficzną ponad płynnością konwersacyjną, być może do zastosowań w badaniach naukowych.

Nomenklatura „4.20”

Słabość Elona Muska do kultury memów jest widoczna nawet w wewnętrznym wersjonowaniu. Kilka wycieków odnosi się do buildu „Grok 4.20”. Choć to żartobliwe, build ten pojawił się w logach serwera jako wersja „Heavy” modelu. Krąży pogłoska, że to wersja „bez kwantyzacji” (pełna precyzja) Grok 4.2, wymagająca ogromnych zasobów obliczeniowych (prawdopodobnie klastra xAI „Colossus”) i zarezerwowana dla najbardziej wymagających zadań korporacyjnych.

„Reality Engine”

Uporczywa plotka dotyczy modułu o nazwie „Reality Engine.” Wyciekła dokumentacja wewnętrzna sugeruje, że Grok 4.2 jest podłączony do żywej, z prawem odczytu i zapisu, bazy „ground truths” pochodzących z danych „Community Notes” platformy X. Pozwalałoby to modelowi na weryfikację własnych halucynacji względem stale aktualizowanego rejestru zweryfikowanych faktów, teoretycznie czyniąc go najbardziej „aktualnym” modelem AI na świecie.

Kiedy możemy wnioskować o czasie wydania?

Przewidywanie premiery xAI jest notorycznie trudne ze względu na firmowe „move fast and break things”, ale oś czasu może zostać wywnioskowana z dużą dozą pewności na podstawie obecnych wzorców.

Dowody z mapy drogowej

- Grok 4.0: wydany w lipcu 2025.

- Grok 4.1: wydany w listopadzie 2025.

- Wycieki Grok 4.2: zaczęły się pojawiać pod koniec grudnia 2025.

Przerwa między 4.0 a 4.1 wyniosła około czterech miesięcy. Pojawienie się checkpointów 4.2 w ukrytych testach pod koniec grudnia i na początku stycznia sugeruje, że model jest w końcowej fazie walidacji.

„Stealth” wdrożenie to wydanie

W przeciwieństwie do tradycyjnego oprogramowania, które ma datę „Gold Master”, Grok 4.2 wydaje się być wdrażany stopniowo. Wysoce prawdopodobne jest, że subskrybenci premium na X (tier Premium+) już korzystają z wczesnych wersji Grok 4.2 bez wyraźnego oznaczenia, pod szyldem „Grok 4.1 Thinking” lub „Grok Beta”.

Wniosek: Formalny, opisany przełącznik dla „Grok 4.2” prawdopodobnie pojawi się pod koniec stycznia lub na początku lutego 2026. Jednak możliwości 4.2 są właśnie teraz sączone do ekosystemu.

Jak wypada w porównaniu z Grok 4.1?

Aby zrozumieć skok, jaki reprezentuje Grok 4.2, musimy zestawić go z modelem obecnie dostępnym dla większości użytkowników, Grok 4.1.

1. Filozofia: EQ vs IQ

- Grok 4.1 (Dyplomata): Definiującą cechą Grok 4.1 była jego inteligencja emocjonalna (EQ). Został dostrojony, by być lepszym rozmówcą, rozumieć niuanse, sarkazm i intencje użytkownika. Zredukował „robotyczne” odpowiedzi i brzmiał bardziej ludzko.

- Grok 4.2 (Polimat): Grok 4.2 wraca do surowych możliwości. Choć zachowuje konwersacyjną płynność 4.1, jego trening wyraźnie przesunął się ku twardym umiejętnościom: programowaniu, analizie finansowej, interpretacji wizualnej i logice. To mniej „partner do rozmowy”, a bardziej „silnik rozumowania”.

2. Architektura i efektywność

- Grok 4.1: Silnie opierał się na tradycyjnej architekturze Mixture-of-Experts (MoE), by zbalansować szybkość i jakość.

- Grok 4.2: Wycieki sugerują „Dense Architectural Optimization.” Oznacza to, że dla konkretnych, wysokowartościowych tokenów (jak składnia kodu czy operatory matematyczne) model aktywuje więcej swojej sieci neuronowej niż zwykle, „mocniej myśląc” nad trudnymi fragmentami, a przelatując nad łatwymi. Rezultatem jest model zarazem mądrzejszy i zaskakująco wydajny.

3. Metryki wydajności (prognozowane vs. rzeczywiste)

| Funkcja | Grok 4.1 | Grok 4.2 (Prognozowane/Wyciekłe) |

|---|---|---|

| Okno kontekstu | 128k - 256k Tokens | 2 Million Tokens |

| Główna mocna strona | Kreatywne pisanie, czat | Programowanie, rozumowanie strategiczne, wideo |

| Multimodalność | Image Input (Vision Encoder) | Native Audio/Video/Text Stream |

| Wskaźnik halucynacji | ~4.2% | Szacowane <2.0% (via Reality Engine) |

| Symulacja handlu | Neutralny/Loss | +12.11% Profit (Alpha Arena) |

4. Głębokość integracji

Grok 4.1 potrafi uzyskiwać dostęp do postów X w celu streszczenia wiadomości. Grok 4.2 ma rzekomo możliwości zapisu dla zadań agentowych (za zgodą użytkownika), co oznacza, że potencjalnie mógłby tworzyć szkice wątków, planować posty, a nawet bezpośrednio wchodzić w interakcje z punktami końcowymi API, pełniąc rolę menedżera mediów społecznościowych, a nie tylko biernego obserwatora.

Jak Grok 4.2 wypada na tle konkurencji?

Ewolucja Groka — zwłaszcza przez wersje 4.1 i potencjalnie 4.2 — odbywa się w szybko zaostrzającym się krajobrazie, w którym OpenAI, Google, Anthropic i inni nieustannie ulepszają swoje flagowe modele.

Porównanie z Claude Opus 4.5

Sam Elon Musk zasugerował, że Grok 4.2 może przewyższać Claude Opus 4.5 „w kilku aspektach”, ustępując mu konkretnie w wyspecjalizowanych zadaniach programistycznych.

Mocne strony Claude w zakresie bezpieczeństwa, niezawodności i wyrafinowanego rozumowania — zwłaszcza w złożonej generacji kodu i wdrożeniach korporacyjnych — stanowią wysoką poprzeczkę, którą Grok 4.2 musi spełnić lub przeskoczyć.

Na tle GPT-5 i serii Gemini

Choć wyciekające narracje i spekulacje społeczności widzą Grok 4.2 w konkurencji z rodziną GPT-5 od OpenAI i linią Gemini od Google, konkretne dowody z benchmarków nie są jeszcze dostępne. Spekulacje rynkowe sugerują, że każda przewaga konkurencyjna może wynikać z rozszerzonego kontekstu i głębi multimodalności, a nie wyłącznie z surowych benchmarków rozumowania.

Jakie są kontrowersje i wyzwania dla Grok 4.2

Żadna dyskusja o xAI nie jest pełna bez podjęcia kwestii znaczących kontrowersji, które towarzyszą jego szybkim postępom. W miarę zbliżania się Grok 4.2 do szerokiego wydania, stoi on w obliczu intensywnej kontroli dotyczącej bezpieczeństwa i etyki.

Kryzys „deepfake” i generowanie obrazów

W styczniu 2026, gdy plotki o Grok 4.2 osiągnęły szczyt, xAI stanęło w obliczu silnego sprzeciwu wobec narzędzia do generowania obrazów, Grok Imagine. Pojawiły się doniesienia, że narzędzie było wykorzystywane do generowania niekonsensualnych, seksualizowanych obrazów (deepfake’ów) prawdziwych osób, w tym nieletnich.

- Globalna reakcja: Doprowadziło to do natychmiastowych działań regulacyjnych. Kraje takie jak Indonezja i Malezja zablokowały dostęp do Grok w całości. Rząd Wielkiej Brytanii wszczął dochodzenie za pośrednictwem Ofcom, a Prokurator Generalny Kalifornii rozpoczął postępowanie w sprawie proliferacji treści jednoznacznie seksualnych.

- Dylemat zabezpieczeń: Elon Musk słynął z promowania Grok jako „anti-woke” lub „unfiltered” AI. Jednak ta filozofia weszła w ostry konflikt z przepisami dotyczącymi bezpieczeństwa dzieci i nękania. W odpowiedzi xAI było zmuszone w pośpiechu wdrożyć w styczniu 2026 „geoblokadę” i bardziej rygorystyczne filtry, aby zapobiegać „rozbieraniu” obrazów. Grok 4.2 zadebiutuje w tym wrogim środowisku regulacyjnym, zmuszając xAI do balansowania między „absolutyzmem wolności słowa” Muska a prawną koniecznością stosowania zabezpieczeń.

„Spicy Mode” vs. bezpieczeństwo korporacyjne

Grok 4.2 zawiera rzekomy „Spicy Mode” (lub Fun Mode), który pozwala na bardziej ostre, sarkastyczne odpowiedzi. Choć popularny wśród użytkowników konsumenckich, ten tryb to koszmar dla adopcji korporacyjnej. Firmy chcące używać Grok 4.2 do programowania czy analizy danych obawiają się modelu, który mógłby znieważyć klienta lub wygenerować kontrowersyjną treść. xAI musi udowodnić, że Grok 4.2 potrafi być „zdyscyplinowany” i profesjonalny, gdy jest to potrzebne, całkowicie separując „osobowość” od „użyteczności”.

Hype „AGI do 2026”

Elon Musk publicznie stwierdził, że Grok może przewyższyć inteligencję człowieka do 2026, de facto ogłaszając rychłe AGI (Artificial General Intelligence). Tworzy to nierealnie wysoko zawieszoną poprzeczkę dla Grok 4.2. Jeśli model będzie jedynie „bardzo dobry”, ale nie „nadludzki”, ryzykuje, że zostanie odebrany jako rozczarowanie względem hype’u. „12% zysku w handlu” z wycieku pali tę narrację o AGI, ale sceptycy argumentują, że wyspecjalizowana wydajność nie równa się inteligencji ogólnej.

Podsumowanie

Grok 4.2 zapowiada się na znacznie więcej niż zwykłe zwiększenie numeru wersji. To deklaracja intencji ze strony xAI. Wykorzystując strategię wydania „stealth checkpoint”, firma zamieniła cały świat w swoje laboratorium beta-testów, iterując nad buildami „Obsidian” i „Vortex” w czasie rzeczywistym.

Model obiecuje rozpuścić granice między tekstem, kodem a wideo, oferując natywnie multimodalny „mózg”, który potrafi rozumować przez złożone problemy finansowe i inżynieryjne z głębią dorównującą ludzkim ekspertom.

Deweloperzy mogą uzyskać dostęp do grok 4.1 api i grok 4 api poprzez CometAPI. Aby rozpocząć, zapoznaj się z możliwościami modeli CometAPI w Playground i skonsultuj przewodnik API w celu uzyskania szczegółowych instrukcji. Przed uzyskaniem dostępu upewnij się, że zalogowałeś(-aś) się do CometAPI i uzyskałeś(-aś) klucz API. CometAPI oferuje cenę znacznie niższą niż oficjalna, aby pomóc w integracji.

Gotowi do działania?→ Zarejestruj się do Grok 4 API już dziś !

Jeśli chcesz poznać więcej porad, przewodników i nowości ze świata AI, obserwuj nas na VK, X i Discord!