Szybka ewolucja dużych modeli językowych (LLM) zapoczątkowała nową erę produktywności opartej na sztucznej inteligencji, dzięki xAI Grok 4 i antropiczne Claude Opus 4 wyróżniają się jako dwie z najbardziej zaawansowanych ofert na rynku. Oba modele obiecują przesunąć granice rozumowania, multimodalnego rozumienia i integracji danych w czasie rzeczywistym, jednak różnią się znacząco pod względem rozwiązań projektowych, strategii wdrożenia i zabezpieczeń etycznych. W tej kompleksowej analizie zestawiamy Grok 4 i Claude Opus 4 w wielu wymiarach – w tym pod kątem ich wydań, architektur, testów wydajności, rzeczywistych zastosowań i modeli cenowych – aby pomóc organizacjom i deweloperom w podejmowaniu świadomych decyzji.

Czym jest Grok 4 i jakie są jego najważniejsze innowacje?

Grok 4 to czwarta główna iteracja pakietu chatbotów xAI, oficjalnie zaprezentowana 9 lipca 2025 roku. Wprowadza ona natywne narzędzia i integrację z wyszukiwaniem w czasie rzeczywistym, pozycjonując go jako wszechstronnego asystenta, zdolnego do dynamicznego wyszukiwania informacji i korzystania z zewnętrznych interfejsów API. Dostępny dla subskrybentów SuperGrok i Premium+, a także za pośrednictwem API xAI, Grok 4 zadebiutował również w wersji „Heavy” –Grok 4 Heavy—który działa na superkomputerze Colossus firmy xAI, co zapewnia zwiększoną wydajność i pojemność.

Dostępność i wdrażanie

Dostęp do Grok 4 jest możliwy poprzez kilka poziomów: SuperGrok oraz Premium + abonenci otrzymują priorytetowy dostęp, podczas gdy nowy SuperGrok Heavy Subskrypcja w cenie 300 USD miesięcznie odblokowuje Grok 4 Heavy — jeszcze bardziej wydajną wersję zoptymalizowaną pod kątem obciążeń wrażliwych na opóźnienia lub wymagających dużej mocy obliczeniowej. Dodatkowo organizacje mogą zintegrować Grok 4 za pośrednictwem interfejsu API xAI, który obsługuje wywołania RESTful i uwierzytelnianie oparte na tokenach w przypadku wdrożeń korporacyjnych.

Czym Claude Opus 4 różni się od poprzednich modeli Claude?

Firma Anthropic zaprezentowała serię Claude 4 w dniach 22–23 maja 2025 r., składającą się z dwóch wariantów: Claude Opus 4, najpotężniejszy model zoptymalizowany pod kątem złożonych zadań kodowania i wnioskowania, Sonet Claude'a 4, uproszczoną wersję dostosowaną do codziennego użytku konwersacyjnego. Claude 4 wprowadza „rozszerzone myślenie”, paradygmat umożliwiający modelowi wywoływanie narzędzi zewnętrznych w trakcie rozmowy – takich jak wyszukiwanie w sieci, wywołania API i wykonywanie kodu – dzięki czemu po włączeniu działa on jako autonomiczny asystent badawczy.

Claude Opus 4 wydawnictwa Anthropic stanowi znaczący krok naprzód w stosunku do Claude 3.7 i Sonnet 4, skupiając się na długotrwała spójność, ulepszone rozumowanie, możliwości agenturalne.

poprawa wydajności

W testach porównawczych Opus 4 utrzymywał spójne rozumowanie dla do siedmiu godzin w zadaniach ciągłych, wieloetapowych – znacznie przewyższając wcześniejsze modele, które zazwyczaj tracą wydajność po kilku minutach akumulacji kontekstu. Wewnętrzne oceny Anthropic pokazują również, że Opus 4 przewyższa konkurentów, takich jak Gemini 2.5 Pro firmy Google i GPT‑4.1 firmy OpenAI, w przypadku złożonych wyzwań związanych z kodowaniem i symulacjami wieloagentowymi.

Nowe funkcje: rozszerzone myślenie i korzystanie z narzędzi

Dwiema sztandarowymi innowacjami w Opus 4 są: Podsumowania myśli—skrócone streszczenia łańcucha rozumowania modelu—i Rozszerzone myślenie, tryb beta, który przełącza się między czystym wnioskowaniem a przepływami pracy wspomaganymi narzędziami (np. wywoływaniem zewnętrznych interfejsów API, zapytaniami do bazy danych), aby zoptymalizować dokładność i wydajność. Pozwala to programistom zarówno na inspekcję wewnętrznej logiki modelu, jak i płynne organizowanie wieloetapowych procesów bez ręcznej interwencji.

Jak Grok 4 i Claude 4 wypadają w porównaniu pod względem architektury i możliwości?

Architektura modelu i rozumowanie

Grok 4 wykorzystuje szkielet transformatora dostrojony za pomocą zastrzeżonych technik w celu zwiększenia logicznego rozumowania i retencji kontekstu w przypadku bardzo długich danych wejściowych. xAI twierdzi, że Okno kontekstowe o pojemności 256,000 XNUMX tokenów, co stanowi znaczący krok naprzód w porównaniu z poprzednimi modelami, umożliwiając Grokowi 4 obsługę całych książek lub długich baz kodu w jednym przejściu. Claude 4 z kolei bazuje na Anthropic rozumowanie hybrydowe framework, który przeplata kroki generatywne z wewnętrznymi modułami rozumowania opartego na łańcuchu myślowym. Zarówno warianty Opus, jak i Sonnet mają wspólną podstawową, rozszerzoną strukturę myślenia, ale Opus 4 jest skalowany pod kątem maksymalnej liczby parametrów i przepustowości, podczas gdy Sonnet 4 równoważy wydajność z efektywnością.

Okno kontekstowe i multimodalność

Choć oba modele obsługują dane wejściowe multimodalne, ich naciski różnią się. Ogromne okno kontekstowe Grok 4 obsługuje analizę dokumentów na dużą skalę i długie wątki konwersacyjne, podczas gdy Claude 4 koncentruje się na rozumowanie modułowe z możliwością pobierania dokumentów, danych internetowych i plików użytkowników za pośrednictwem interfejsu API plików. Oba systemy oferują funkcje wizyjne; Grok 4 integruje interpretację obrazu w czasie rzeczywistym za pośrednictwem strumienia danych X, a Claude 4 łączy się z Google Workspace i wyszukiwarką internetową, umożliwiając wzbogacanie kontekstu w czasie rzeczywistym.

Jakie funkcje narzędziowe oferują?

Klauzula 4„Rozszerzone myślenie” pozwala na sekwencyjne łączenie narzędzi — wyszukiwanie, obliczenia, wykonywanie kodu — w ramach jednego spójnego przepływu pracy, ułatwiając realizację złożonych zadań składających się z wielu etapów bez utraty kontekstu.

Grok 4:Umożliwia wyszukiwanie w sieci w czasie rzeczywistym i wywoływanie API za pomocą natywnych narzędzi. Integruje się z ekosystemem X w celu pobierania danych z poziomu platformy.

Jak wypadają pod względem wydajności Grok 4 i Claude Opus 4?

Choć oba modele stawiają na zaawansowane rozumowanie, nacisk w ich konstrukcji prowadzi do różnych optymalnych rozwiązań.

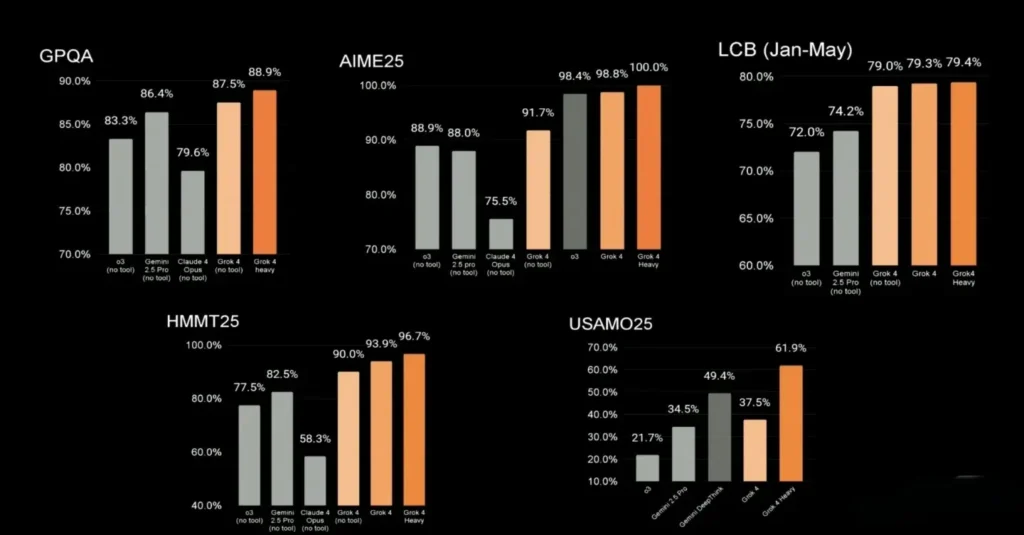

Testy porównawcze i biegłość w kodowaniu

- Zadania kodowania:Claude Opus 4 jest reklamowany jako „najlepszy na świecie model kodowania”, osiągając nawet o 25–30% wyższy wskaźnik zdawalności w testach kodowania w porównaniu z GPT‑4 i modelami konkurencyjnymi. Grok 4, mimo że jest zaawansowany, wykazuje nieco niższe wyniki w syntezie kodu, ale rekompensuje to integracją wyszukiwania w czasie rzeczywistym fragmentów kodu i bibliotek.

- Rozumowanie:W łamigłówkach logicznych i problemach matematycznych wymagających rozwiązywania krok po kroku oba modele działają solidnie, ale rozszerzone okno kontekstowe Anthropic daje Opus 4 przewagę w przypadku problemów wymagających długotrwałego, wielowarstwowego rozumowania obejmującego setki tokenów, przy niższym wskaźniku halucynacji w problemach matematycznych i logicznych.

- Grok 4 Code, uruchomiony równolegle, wyróżnia się w trudnym rozumowaniu i debugowaniu; teoretyczny wynik SWE‑Bench sugeruje 75% w porównaniu z ~72% w przypadku Opus.

Przepływy pracy agentów i zadania długoterminowe

Natywne wywoływanie funkcji Grok 4 umożliwia wykonywanie API w locie (np. narzędzia do rezerwacji, planowanie), co czyni go mocnym kandydatem do agenci interaktywni W przeciwieństwie do tego, Claude Opus 4 wyróżnia się w autonomiczne, ciągłe przepływy pracy—takie jak monitorowanie strumieni danych, aktualizowanie raportów lub organizowanie symulacji wieloagentowych — działające niezawodnie przez kilka godzin bez zmiany kontekstu.

Wnioskowanie i przepustowość

- Grok 4: ~75 tokenów/s, z opóźnieniem ~5.7 s.

- Claude Opus 4 (komparator GPT‑4o): ~138 tokenów/s, opóźnienie ~0.43 s.

Jakie są opcje cenowe i dostępu?

Ile Grok 4 koszt?

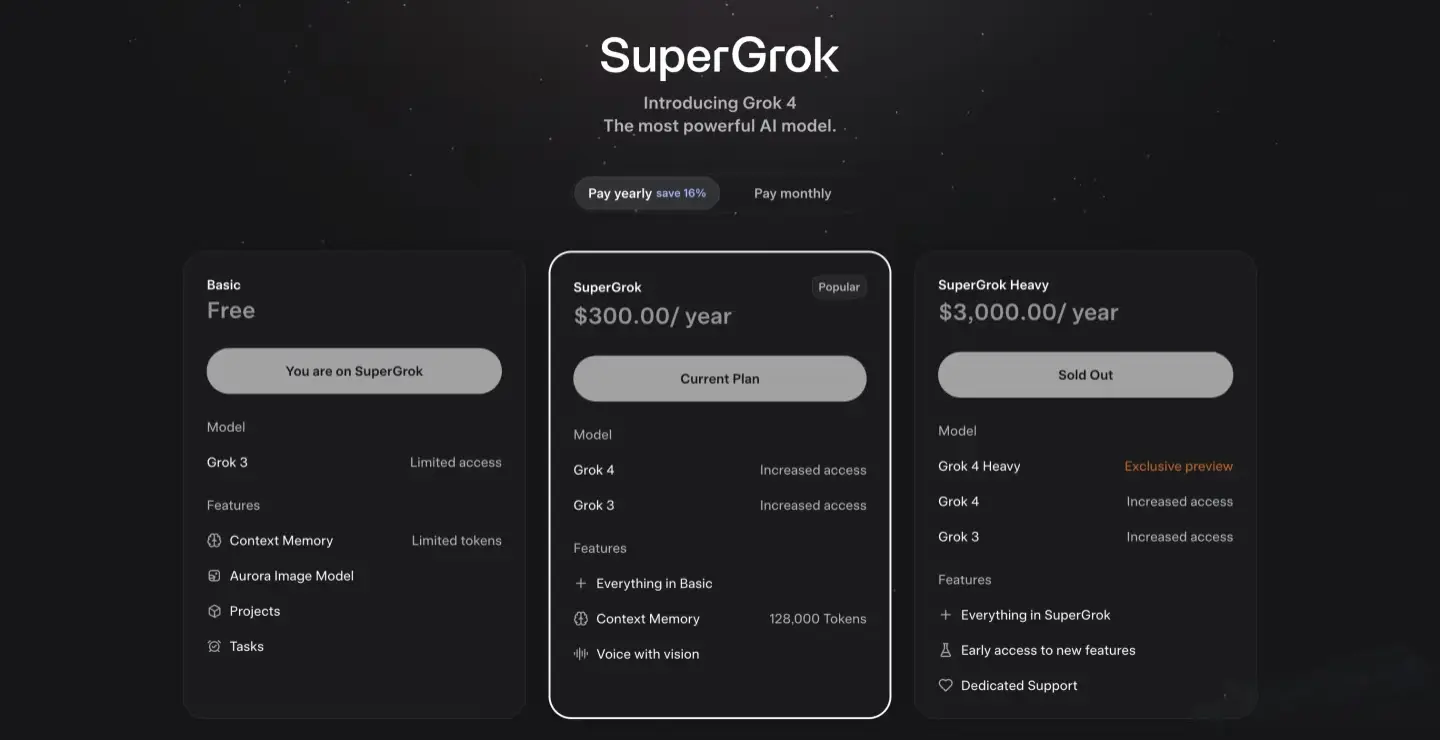

- Standardowy Grok‑4 – 30 USD/miesiąc, 300 USD rocznie: dostęp do modelu rdzeniowego, podstawowe dane wejściowe multimodalne i wyszukiwanie w czasie rzeczywistym. SuperGrok () zawiera Grok 4 z rozszerzonym dostępem i 128,000 XNUMX tokenów pamięci kontekstowej.

- SuperGrok Heavy – 300 USD miesięcznie, 3,000 USD rocznie: wiele instancji agentów, zaawansowane narzędzia badawcze, priorytetowe wsparcie i wczesny dostęp do funkcji. SuperGrok Heavy oferuje ekskluzywny dostęp do wersji zapoznawczej Grok 4 Heavy z dedykowanym wsparciem i wczesnym dostępem do funkcji.

- Dostęp API (płać zgodnie z rzeczywistym użyciem): Model cenowy API zakłada naliczenie opłaty w wysokości 3.00 USD za 1 mln tokenów wejściowych i 15.00 USD za 1 mln tokenów wyjściowych, przy czym buforowane tokeny wejściowe oferują znaczną oszczędność kosztów na poziomie 0.75 USD za 1 mln tokenów.

Ile kosztuje Claude Opus 4?

Pro, Max, Zespół, Przedsiębiorstwo: 20–200 USD miesięcznie, odblokowanie Sonnet 4 i Opus 4, plus wydłużony okres testowania wersji beta dla wyższych planów. Cena Claude Opus 4 firmy Anthropic jest oparta na liczbie przetworzonych tokenów. Rozliczenie jest podzielone na tokeny wejściowe (to, co wysyłasz do modelu) i tokeny wyjściowe (to, co zwraca model):

- Tokeny wejściowe — 15 USD za 1 milion tokenów

- Tokeny wyjściowe — 75 USD za 1 milion tokenów

Funkcje oszczędzające koszty:

- Szybkie buforowanie — Ponowne wykorzystanie danych wyjściowych z pamięci podręcznej dla identycznych monitów w ciągu godziny, co daje do 90% oszczędności na wielokrotne prośby.

- Przetwarzanie wsadowe — Prześlij wiele danych wejściowych w jednym połączeniu, zmniejszając narzut i obniżając koszty nawet o 50%.

Tabela porównawcza obok siebie

| Cecha | Grok 4 (xAI) | Claude Opus 4 (Antropiczny) |

|---|---|---|

| Data wydania | July 9, 2025 | May 22, 2025 |

| Okno kontekstowe | 256 tys. tokenów | 200 tys. tokenów |

| Punkty odniesienia akademickie | Najwyższej klasy (45%+ HLE; 16% ARC) | Silny, ale w tyle |

| Umiejętność kodowania | ~75% SWE‑Bench; tryb „Kod” | ~75%+ HumanEval; powszechnie chwalony |

| Prędkość wnioskowania | ~75 tokenów/s; opóźnienie 5.7 s | ~138 tokenów/s; opóźnienie ~0.43 s |

| Ceny | 30 USD za wersję podstawową, 300 USD za wersję ciężką miesięcznie | Premium API, zróżnicowane ceny |

| Bezpieczeństwo i etyka | Pojawiające się, ale niezauważone moderacje | Bezpieczeństwo ASL‑3, rygorystyczne filtry |

| Multimodalne i pamięci | Teraz można wprowadzać obrazy, wkrótce będzie można dodawać wideo | Multimodalny + włączona pamięć i użycie narzędzi |

Wybór właściwego modelu: przewodnik po przypadkach użycia

1. Do surowych badań naukowych i bardzo trudnych rozumowań

Wybierz Grok 4 Heavy: najwyższa dokładność testu porównawczego, najszerszy kontekst.

2. Do profesjonalnego tworzenia oprogramowania i kodowania

Wybierz Claude Opus 4: najwyższa na rynku dokładność, dłuższa niezawodność kontekstu, szybsza przepustowość.

3. Do ogólnych zadań multimodalnych z pamięcią i zgodnością

Claude Opus 4 wygrywa dzięki dojrzałemu oprzyrządowaniu i zabezpieczeniom.

4. Do wyszukiwania w czasie rzeczywistym, kreatywności i systemów sprzyjających elastyczności

Grok 4 jest skierowany do deweloperów, którym zależy na mniej filtrowanym dostępie i na pojawiających się zachowaniach agenturalnych.

Jak zacząć

CometAPI zapewnia ujednolicony interfejs REST, który agreguje setki modeli AI — w ramach spójnego punktu końcowego, z wbudowanym zarządzaniem kluczami API, limitami wykorzystania i panelami rozliczeniowymi. Zamiast żonglować wieloma adresami URL dostawców i poświadczeniami.

Deweloperzy mogą uzyskać dostęp Grok 4 API oraz Claude Opus 4 API przez Interfejs API CometNajnowsze wersje modeli podane są na dzień publikacji artykułu. Na początek zapoznaj się z możliwościami modelu w Plac zabaw i zapoznaj się z Przewodnik po API aby uzyskać szczegółowe instrukcje. Przed uzyskaniem dostępu upewnij się, że zalogowałeś się do CometAPI i uzyskałeś klucz API. Interfejs API Comet zaoferuj cenę znacznie niższą niż oficjalna, aby ułatwić Ci integrację.

Podsumowując

Grok 4 i Claude Opus 4 przesuwają granice modelowania dużych języków, opierając się na rozbieżnych filozofiach: Grok stawia na przejrzystość i zwinność w czasie rzeczywistym, podczas gdy Claude kładzie nacisk na doskonałość kodowania i bezpieczeństwo prewencyjne. Wybór między nimi zależy od apetytu organizacji na integrację danych w czasie rzeczywistym, tolerancji na ryzyko związane z narzędziami oraz potrzeby rygorystycznych zabezpieczeń etycznych. Wraz z dojrzewaniem obu platform, testy porównawcze i interoperacyjność międzymodelowa – na przykład wykorzystanie konektorów Claude wraz z wyszukiwaniem Grok – mogą jeszcze bardziej zatrzeć te różnice, zapoczątkowując erę hybrydowych rozwiązań AI.