GPT-5.5 Instant to najnowsza aktualizacja codziennej inteligencji napędzającej ChatGPT od OpenAI. Wydany 5 maja 2026 r., zastępuje GPT-5.3 Instant jako domyślny model dla setek milionów użytkowników. Dostarcza mądrzejsze, dokładniejsze odpowiedzi z istotnie zmniejszonymi halucynacjami, jednocześnie zachowując niskie opóźnienia, których użytkownicy oczekują od „instant”.

Dla deweloperów, przedsiębiorców, twórców SaaS i zespołów korporacyjnych, ta aktualizacja modelu otwiera nowe możliwości niezawodnej integracji AI bez poświęcania szybkości ani zwiększania kosztów. Ten kompleksowy przewodnik obejmuje wszystko, od szybkiego dostępu do ChatGPT po wykorzystanie API w jakości produkcyjnej, z praktycznymi przykładami i strategiami optymalizacji.

Czym jest GPT-5.5 Instant i dlaczego ma znaczenie

GPT-5.5 Instant to szybki, wydajny wariant zoptymalizowany pod kątem codziennych interakcji, odpowiedzi wzbogaconych wyszukiwaniem, analizy obrazów oraz spersonalizowanego przywoływania kontekstu. Zasila domyślne doświadczenie ChatGPT, zapewniając mierzalne ulepszenia względem poprzednika.

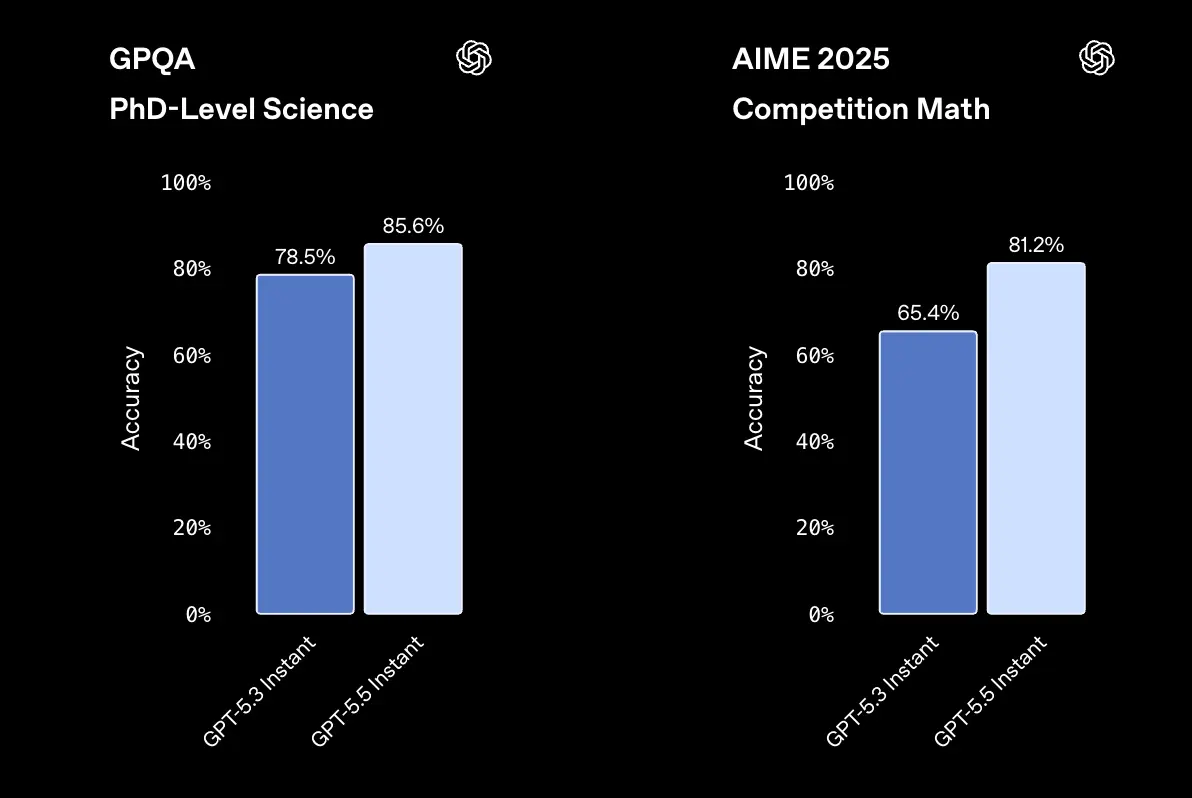

Kluczowe ulepszenia (potwierdzone ewaluacjami OpenAI):

- GPT-5.5 Instant wygenerował o 52.5% mniej halucynowanych stwierdzeń niż GPT-5.3 Instant w scenariuszach wysokiej wagi

- 37.3% redukcji nieścisłych stwierdzeń w wymagających rozmowach.

- Lepsza wydajność w analizie zdjęć/obrazów, pytaniach STEM oraz wyczuciu, kiedy użyć wyszukiwania w sieci.

- Bardziej zwięzłe, naturalne i spersonalizowane odpowiedzi z lepszym zarządzaniem kontekstem z poprzednich czatów, plików i połączonej poczty Gmail.

W odróżnieniu od cięższego GPT-5.5 (warianty Thinking/Pro) zaprojektowanego do głębokiego rozumowania i złożonych zadań agentowych, GPT-5.5 Instant priorytetowo traktuje szybkość i niezawodność w zastosowaniach ogólnych, oferując jednocześnie istotny wzrost możliwości.

GPT-5.5 Instant vs. GPT-5.5 vs. poprzednie modele: tabela porównawcza

| Funkcja/Model | GPT-5.5 Instant (Domyślny) | GPT-5.5 (Pełny/Thinking) | GPT-5.3 Instant (Poprzedni) |

|---|---|---|---|

| Główna mocna strona | Szybkość + niezawodność | Głębokie rozumowanie i agenci | Zastosowania ogólne |

| Opóźnienie | Najniższe | Wyższe | Niskie |

| Redukcja halucynacji | o 52.5% mniej (wysokiej wagi) | Najwyższa | Punkt odniesienia |

| Personalizacja | Doskonała (wyszukiwanie w pamięci) | Silna | Dobra |

| Wydajność w obrazach/STEM | Znacząco poprawiona | Wyższa | Dobra |

| Cennik API (przybliżony) | Konkurencyjna u dostawców | $5/$30 per M tokens | Niższa |

| Najlepszy do | Czat, szybkie zadania, aplikacje | Złożone przepływy pracy | Starsze |

Kiedy wybrać Instant: Aplikacje codzienne, boty wsparcia klienta, generowanie treści i interfejsy wrażliwe na opóźnienia.

Zasadniczo GPT-5.5 Instant i GPT-5.5 Thinking współdzielą tę samą architekturę bazową. Różnica polega na głębokości rozumowania, a nie poziomie wiedzy. Użytkownicy płatni mogą korzystać z GPT-5.5 Thinking, podczas gdy bezpłatni mają ograniczoną pulę GPT-5.5 Instant w chatgpt.

Aby uzyskać więcej informacji, zobacz GPT-5.5 overview i mechanizm.

Jak uzyskać dostęp do GPT-5.5 Instant w ChatGPT

Jeśli korzystasz bezpośrednio z ChatGPT, GPT-5.5 Instant jest domyślny dla wszystkich zalogowanych użytkowników. OpenAI informuje, że wdraża go dla wszystkich użytkowników ChatGPT, zastępując GPT-5.3 Instant jako model domyślny. Oznacza to, że wielu użytkowników nie musi niczego ręcznie przełączać, aby skorzystać z nowego doświadczenia Instant.

Dla użytkowników płatnych ChatGPT udostępnia selektor modelu, który pozwala ręcznie wybrać GPT-5.5 Instant lub GPT-5.5 Thinking (dla użytkowników płatnych GPT‑5.3 Instant pozostanie dostępny przez trzy miesiące). Centrum pomocy OpenAI podaje, że użytkownicy Plus, Pro i Business mają dostęp do selektora, podczas gdy GPT-5.5 Pro jest zarezerwowany dla planów Pro, Business, Enterprise i Edu.

Użytkownicy bezpłatni nadal mogą używać GPT-5.5 w ChatGPT, ale obowiązują limity użycia. OpenAI podaje, że konta Free mogą wysyłać do 10 wiadomości z GPT-5.5 co 5 godzin, podczas gdy użytkownicy Plus i Go mogą wysyłać do 160 wiadomości co 3 godziny. Po osiągnięciu limitu czaty przełączają się na mini wersję GPT-5.5 do czasu resetu limitu. Zespoły Pro i business nie będą przełączane i mogą kontynuować używanie GPT-5.5.

Jeśli używasz edycji Pro lub Enterprise i chcesz porównać wydajność Instant i Thinking w zadaniu z realnego świata, otwórz dwie karty obok siebie, przypnij po jednej karcie do każdego i wprowadź te same polecenia. Różnica jest szczególnie zauważalna w zadaniach obejmujących niejawne wieloetapowe rozumowanie, ponieważ Thinking eksploruje różne gałęzie rozumowania przed odpowiedzią. W codziennym czacie Instant jest szybszy przy odpowiedziach początkowych.

Praktyczny przebieg dostępu do ChatGPT

Dla większości użytkowników przebieg jest prosty:

- Zaloguj się do ChatGPT.

- Korzystaj z domyślnego doświadczenia Instant.

- W planach płatnych otwórz selektor modelu, jeśli chcesz ręcznie wybrać GPT-5.5 Instant.

- Przełączaj na GPT-5.5 Thinking tylko wtedy, gdy zadanie naprawdę wymaga głębszego rozumowania.

To ścieżka po stronie użytkownika. Dla zespołów produktowych kluczowe jest jednak odtworzenie tej samej jakości we własnej aplikacji. Tu właśnie liczy się ścieżka przez API.

Funkcje zaawansowane

- Pamięć i personalizacja: Model inteligentnie korzysta z historii rozmów, przesłanych plików i Gmaila (jeśli jest połączony). Decyduje, kiedy personalizacja wnosi wartość.

- Analiza obrazów: Przesyłaj zdjęcia dla lepszego rozumowania wizualnego.

- Integracja z wyszukiwarką: Automatyczna, gdy potrzebne są aktualne informacje.

Wskazówka: Rozpoczynaj nowe czaty dla najczystszego domyślnego doświadczenia. Używaj niestandardowych instrukcji w ustawieniach, aby zachować spójny ton i kontekst między sesjami.

Jak uzyskać dostęp i korzystać z GPT-5.5 Instant przez API

Bezpośredni dostęp do OpenAI API używa aliasów modeli, takich jak chat-latest. chat-latest wskazuje na najnowszy model Instant aktualnie używany w ChatGPT. Wiele zespołów preferuje zunifikowanych dostawców, takich jak CometAPI, ze względu na niższe koszty, wyższe limity i uproszczoną integrację z wieloma modelami.

W API GPT-5.5 Instant i GPT-5.5 Thinking łączą się w jeden identyfikator modelu: gpt-5.5. Nie ma osobnego endpointu gpt-5.5-instant. Zamiast tego głębokość rozumowania kontrolujesz parametrem reasoning_effort, który przyjmuje wartości minimal, low, medium lub high. Ustawienie reasoning_effort: "minimal" jest najbliższym odpowiednikiem doświadczenia Instant w ChatGPT.

GPT-5.5 jest dostępny w dwóch endpointach:

- Responses API (

/v1/responses): zalecany endpoint dla nowych wdrożeń, z pełnym wsparciem narzędzi, wyników strukturyzowanych i strumieniowania. - Chat Completions API (

/v1/chat/completions): przestarzały endpoint, utrzymywany dla zgodności wstecznej.

Konfiguracja API krok po kroku z CometAPI (zalecane dla większości zespołów)

1. Zarejestruj się i pobierz klucz API

- Odwiedź CometAPI.com i utwórz konto.

- Przejdź do konsoli/pulpitu, aby wygenerować klucz API (zaczyna się od

sk-).

2. Przykład podstawowej integracji (Python)

from openai import OpenAI

import os

client = OpenAI(

api_key=os.getenv("COMETAPI_KEY"), # Twój klucz CometAPI

base_url="https://api.cometapi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.5", # or specific alias

messages=[

{"role": "system", "content": "Jesteś pomocnym, zwięzłym asystentem."},

{"role": "user", "content": "Wyjaśnij, w jaki sposób GPT-5.5 Instant poprawia zgodność z faktami."}

],

temperature=0.7,

max_tokens=500

)

print(response.choices[0].message.content)

3. Strumieniowanie odpowiedzi dla lepszego UX

stream = client.chat.completions.create(

model="gpt-5.5",

messages=[...],

stream=True

)

for chunk in stream:

if chunk.choices[0].delta.content is not None:

print(chunk.choices[0].delta.content, end="")

Przykłady w JavaScript, cURL i innych językach są podobne, zgodne ze wzorcem SDK OpenAI.

Kluczowe parametry API dla GPT-5.5 Instant

- temperature: 0.0–1.0 (niższa dla zadań faktograficznych).

- reasoning_effort (jeśli obsługiwane w wariantach): low/medium dla równowagi.

- tools/function calling: Pełne wsparcie dla przepływów agentowych.

- Vision: Przekazuj adresy URL obrazów lub base64 dla zapytań multimodalnych.

Najlepsze praktyki uzyskiwania lepszych wyników

GPT-5.5 nie jest modelem „napisz jedno mgliste polecenie i licz na cud”. Zdecydowanie polecam podejście zorientowane na wynik: określ oczekiwany rezultat, kryteria sukcesu, ograniczenia, efekty uboczne i kształt wyjścia. Dokumentacja zaleca również ograniczenie szczegółowego prowadzenia krok po kroku, chyba że sam proces jest elementem wymagań produktu. W praktyce oznacza to, że powinieneś opisać cel, a nie mikrozarządzać każdym zakrętem.

Strukturyzowane wyniki to kolejna ważna dźwignia. OpenAI zaleca używanie zestrukturyzowanych wyjść zamiast opisywania schematu w promptcie, zwłaszcza w systemach produkcyjnych, które potrzebują automatycznej walidacji i bardziej niezawodnego parsowania w dalszych etapach. Ma to znaczenie w produktach SaaS, ponieważ im mniej czasu Twoja aplikacja spędza na czyszczeniu wyjścia modelu, tym stabilniejsze staje się doświadczenie użytkownika.

Lista kontrolna promptowania dla GPT-5.5 Instant

Pisz polecenia, które:

- Jasno określają cel.

- Definiują kryteria akceptacji.

- Wskazują wymagane formatowanie.

- Ograniczają zbędne instrukcje.

- Pozostawiają modelowi przestrzeń na wybór najlepszej ścieżki.

Wytyczne dot. poziomu rozumowania

OpenAI mówi, że medium to domyślne i rekomendowane, zrównoważone ustawienie; low może dobrze działać w wielu obciążeniach; none jest dla zadań krytycznych pod kątem opóźnień, które nie wymagają rozumowania; a high lub xhigh należy rezerwować dla zadań, w których ewaluacja pokazuje mierzalny wzrost jakości. Ta wskazówka jest subtelna, ale ważna: więcej rozumowania nie jest automatycznie lepsze, zwłaszcza gdy zadanie ma słabe kryteria zatrzymania lub zbyt szeroki dostęp do narzędzi.

Przydatny wzorzec produkcyjny

Dla wsparcia klienta, wewnętrznych asystentów wiedzy i automatyzacji przepływów pracy, mocna konfiguracja to:

- Responses API do stanu rozmowy

- Strukturyzowane wyniki dla przewidywalnego parsowania

- Poziom rozumowania dostrojony do przypadku użycia

- Keszowanie promptów dla powtarzalnych prefiksów

- Narzędzia hostowane tam, gdzie pasują do przepływu pracy

To połączenie sprawia, że GPT-5.5 zaczyna wyglądać mniej jak model czatu, a bardziej jak silnik produkcyjny.

Strategie optymalizacji kosztów

- Keszuj popularne prompty/odpowiedzi.

- Używaj zestrukturyzowanych wyjść (tryb JSON) dla niezawodnego parsowania.

- Monitoruj użycie tokenów i rozważnie dobieraj poziom rozumowania.

- Kieruj proste zapytania do lżejszych modeli i eskaluj do Instant/GPT-5.5 w razie potrzeby.

Przykłady wdrożenia krok po kroku

1) Przepływ pracy w ChatGPT

Najprostszy sposób użycia GPT-5.5 Instant to sam ChatGPT. Zaloguj się, pozwól domyślnemu doświadczeniu Instant obsługiwać rutynowe zadania, a w planach płatnych przełącz się na selektor modelu, jeśli chcesz ręcznie wybrać GPT-5.5 Instant lub GPT-5.5 Thinking. OpenAI twierdzi, że domyślne doświadczenie Instant jest już dostrojone do pytań informacyjnych, instruktaży, pisania technicznego i tłumaczeń.

To właściwa opcja dla założycieli, operatorów i menedżerów produktu, którzy potrzebują szybkich odpowiedzi bez wdrażania kodu. To także najlepsze miejsce, by sprawdzić, czy ton i faktografia GPT-5.5 poprawiają typowe przepływy pracy, zanim zainwestujesz w integrację.

2) Bezpośredni przepływ API

Dla rozwoju produktu wybierz ścieżkę przez API. Dokumentacja OpenAI mówi, by zaktualizować skrót modelu do gpt-5.5, użyć Responses API do rozumowania i wywołań narzędzi oraz celowo ustawić reasoning.effort. Dokumenty podkreślają też keszowanie promptów, zestrukturyzowane wyjścia i obsługę rozmów wielotaktowych jako kluczowe elementy dobrej integracji.

Praktyczna sekwencja wdrożenia wygląda tak:

- Zacznij od świeżej bazy promptów.

- Ustaw model na

gpt-5.5. - Użyj Responses API.

- Dodaj zestrukturyzowane wyjścia, jeśli aplikacja potrzebuje odpowiedzi maszynowo parsowalnych.

- Dostosuj

reasoning.effortwedług celów dot. opóźnień i jakości. - Zbenchmarkuj zachowanie end-to-end przed wdrożeniem.

3) Zunifikowana brama z CometAPI

CometAPI pozycjonuje się jako zunifikowana, w stylu OpenAI, platforma agregacji API z dostępem do ponad 500 modeli AI przez jeden interfejs, jeden klucz API i rozliczanie pay‑as‑you‑go. Podkreśla niższe tarcie integracji, jedno poświadczenie i możliwość przełączania modeli bez ponownej autoryzacji lub dużych prac migracyjnych.

Dla zespołów budujących produkty wielomodelowe ma to znaczenie. Zamiast wiązać stos z jedną ścieżką integracji dostawcy, podejście bramowe pozwala standaryzować obsługę żądań, uprościć eksperymenty z dostawcami i zmniejszyć koszty utrzymania zarośnięcia stosu specyficznymi SDK modeli.

CometAPI Zalety: Zdecydowanie niższe ceny (np. ~20% rabatu vs. oficjalne), jeden klucz API dla 500+ modeli, hojne limity i playground do testów. To czyni go idealnym dla startupów skalujących funkcje AI bez natychmiastowo wysokich rachunków OpenAI.

Jeśli chcesz poznać zmiany cen GPT-5.5, oto szczegółowa analiza GPT-5.5 pricing breakdowns.

FAQ

1. Jak uzyskać dostęp do GPT-5.5 Instant w ChatGPT?

GPT-5.5 Instant jest domyślny dla wszystkich zalogowanych użytkowników, a płatne poziomy mogą ręcznie wybrać GPT-5.5 Instant lub GPT-5.5 Thinking z selektora modelu.

2. Czy GPT-5.5 Instant jest dostępny w API?

OpenAI podaje, że GPT-5.5 Instant jest wdrażany w API jako chat-latest, podczas gdy dokumentacja modeli API używa gpt-5.5 jako skrótu dla deweloperów.

3. Jaka jest różnica między GPT-5.5 Instant a GPT-5.5 Thinking?

GPT-5.5 Instant to szybki, niskolatencyjny domyślny wariant zoptymalizowany do codziennego użytku i ChatGPT. Warianty GPT-5.5 (i Pro) oferują głębsze rozumowanie dla złożonych, wieloetapowych zadań kosztem wyższych opóźnień i kosztów. OpenAI mówi, że Thinking lepiej śledzi wcześniejsze kroki i może wyświetlać krótką przedmowę przed rozpoczęciem rozumowania.

4. Którego API używać z GPT-5.5?

OpenAI zaleca Responses API do rozumowania, wywołań narzędzi i przypadków wielotaktowych.

5. Od jakiego ustawienia rozumowania zacząć?

OpenAI rekomenduje rozpocząć od medium, następnie testować low dla obciążeń wrażliwych na opóźnienia, a high i xhigh tylko wtedy, gdy ewaluacja pokazuje mierzalny wzrost jakości.

6. Czy GPT-5.5 obsługuje przepływy silnie oparte na narzędziach?

Tak. OpenAI podaje, że GPT-5.5 jest szczególnie użyteczny przy dużych powierzchniach narzędziowych, wieloetapowych przepływach usług i długotrwałych zadaniach agentowych, z większą precyzją w doborze narzędzi i argumentów.

7. Dlaczego zespół miałby używać CometAPI zamiast iść bezpośrednio?

CometAPI pozycjonuje się jako zunifikowana brama w stylu OpenAI z jednym kluczem API, dostępem do 500+ modeli i niższym tarciem integracji przy zmianie dostawców.

Wnioski i kolejne kroki

GPT-5.5 Instant podnosi poprzeczkę dla dostępnej, niezawodnej AI. Niezależnie od tego, czy usprawniasz przepływy w ChatGPT, czy budujesz kolejną generację produktów zasilanych AI, opanowanie dostępu i użycia tego modelu jest kluczowe.

Gotowy do integracji? Get started with CometAPI i uzyskaj natychmiastowy dostęp do GPT-5.5 Instant oraz pełnej rodziny GPT-5.5 w konkurencyjnych cenach. Zarejestruj się bezpłatnie, przetestuj w playgroundzie i wdrażaj w kilka minut dzięki zgodności ze znanym SDK OpenAI.