Model o3 firmy OpenAI stanowi znaczący krok naprzód w dziedzinie rozumowania AI na dużą skalę, łącząc ulepszone możliwości rozważań z solidnymi integracjami narzędzi. Od czasu prezentacji w grudniu 2024 r. o3 znajduje się w centrum intensywnej uwagi branży, a OpenAI opisuje go jako demonstrujący „inteligencję na poziomie geniusza” i pionierski w zakresie nowych technik bezpieczeństwa. W tym artykule podsumowano najnowsze wiadomości i oficjalne wydania, aby zapewnić kompleksowy, krok po kroku przewodnik dotyczący uzyskiwania dostępu do o3 — niezależnie od tego, czy jesteś użytkownikiem końcowym w ChatGPT, czy deweloperem wykorzystującym API. Każda sekcja jest przedstawiona jako pytanie ułatwiające szybką nawigację, a szczegółowe podsekcje oferują głębsze spostrzeżenia.

Czym jest o3 firmy OpenAI?

Początki i wydanie

OpenAI po raz pierwszy wprowadził o3 20 grudnia 2024 r. podczas wydarzenia „12 Days of OpenAI”. Model, nazwany tak, aby uniknąć pomyłki z dostawcą usług telekomunikacyjnych O2, jest następcą oryginalnego modelu rozumowania o1 i został zaprojektowany tak, aby poświęcić więcej czasu obliczeniowego na myślenie przed wygenerowaniem odpowiedzi. Wydany 16 kwietnia 2025 r., obok swojego mniejszego odpowiednika o4-mini, o3 oferuje niezrównane możliwości zarówno dla programistów, badaczy, jak i zespołów korporacyjnych.

Podstawowe możliwości

W swojej istocie o3 wykorzystuje architekturę transformatora rozszerzoną o to, co OpenAI nazywa „prywatnym łańcuchem myśli”, umożliwiając wewnętrzne planowanie wieloetapowych procesów rozumowania. Skutkuje to wyraźnie poprawioną wydajnością w przypadku złożonych zadań — szczególnie w dziedzinach STEM, takich jak zaawansowana matematyka, kodowanie i rozwiązywanie problemów naukowych — gdzie może osiągnąć poziom dokładności kilkakrotnie wyższy niż jego poprzednik.

Czym o3 różni się od swoich poprzedników?

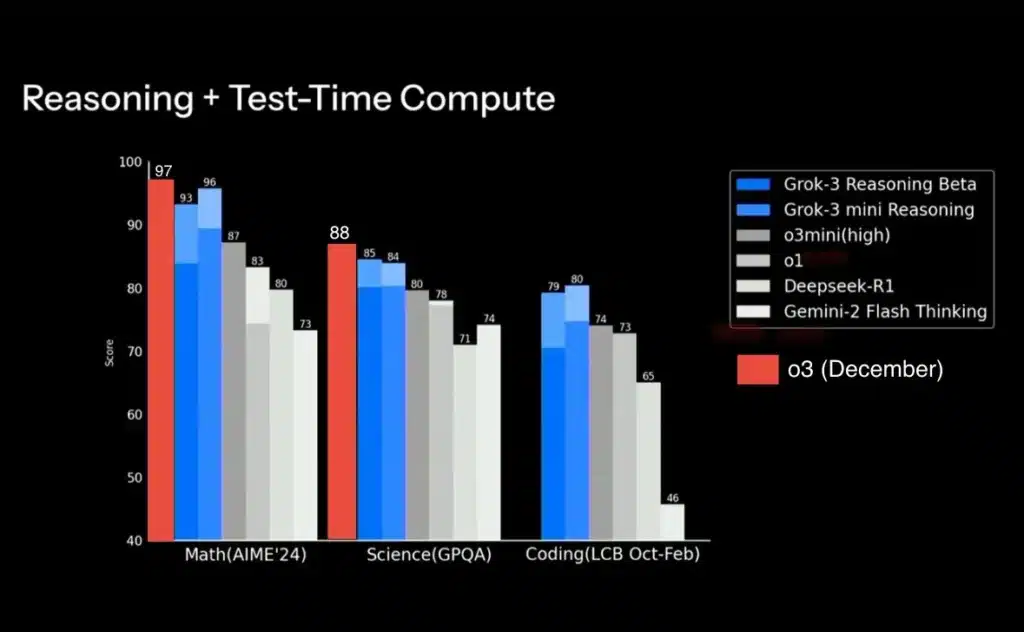

OpenAI o3 opiera się na strukturze „o-series” firmy, która kładzie nacisk na rozszerzone wewnętrzne rozważania — lub „prywatny łańcuch myśli” — przed wygenerowaniem wyników. W przeciwieństwie do o1, który oferował solidną wydajność w przypadku ogólnych zadań, o3 został wytrenowany w celu przydzielania dodatkowych obliczeń dla zapytań intensywnie rozumujących, co zaowocowało znacząco lepszymi wynikami w testach porównawczych, takich jak GPQA Diamond (87.7% w porównaniu z niższą wydajnością o1) i zaawansowanych testach kodowania w Codeforces (Elo 2727 w porównaniu z 1 o1891). W testach równoległych o3 dorównuje o1 lub przewyższa go w zakresie zadań STEM, logiki i kreatywnego rozwiązywania problemów, choć z nieco większym opóźnieniem ze względu na głębszy proces rozumowania.

Kto ma dostęp do o3?

Które poziomy subskrypcji ChatGPT obejmują o3?

Od 16 kwietnia 2025 r. o3 jest dostępne dla abonentów ChatGPT Plus, Pro i Team. Użytkownicy Plus i Team mogą wybrać o3 (lub o4-mini) bezpośrednio w selektorze modeli, zastępując starszą opcję o1-mini i korzystając z wyższych limitów szybkości — do 150 wiadomości dziennie dla o3-mini w porównaniu z 50 wcześniej. Użytkownicy Pro uzyskują dostęp zarówno do o3, jak i wariantu o wyższej mocy obliczeniowej o3-pro po jego uruchomieniu, z nieograniczonym użytkowaniem w ramach swojego planu subskrypcji. Użytkownicy bezpłatnej wersji nadal mają dostęp do standardowych modeli GPT-4.5 i GPT-4o, ale muszą dokonać aktualizacji, aby skorzystać z zaawansowanego stosu wnioskowania o3.

W jaki sposób klienci API mogą korzystać z o3?

Programiści wykorzystujący API OpenAI mogą wywołać o3, gdy tylko spełnią zaktualizowane wymagania dostępu. Zgodnie z najnowszą dokumentacją API OpenAI, punkty końcowe o3 są włączone dla wszystkich użytkowników z prawidłowym kluczem API, chociaż korzystanie z nich podlega temu samemu limitowi stawki i strukturze rozliczeniowej, co w przypadku innych modeli. Od 11 marca 2025 r. API „Responses” i „Tools” obsługują wywołania o3 z wtyczkami wyszukiwania w sieci, wyszukiwania plików i wykonywania kodu, umożliwiając niestandardowe kompilacje agentów oparte na możliwościach rozumowania o3.

Jak uzyskać dostęp do o3 poprzez ChatGPT?

Jakie kroki należy wykonać, aby odblokować o3 w interfejsie ChatGPT?

- Zaloguj się i przejdź do Ustawień: Otwórz ChatGPT w przeglądarce lub aplikacji komputerowej, a następnie kliknij ikonę swojego profilu (w lewym dolnym rogu) i wybierz „Ustawienia”.

- Wybierz poziom subskrypcji: Potwierdź, że jesteś w Plus, Pro lub Team. Jeśli nie, dokonaj uaktualnienia za pomocą łącza „Zarządzaj subskrypcją”.

- Otwórz selektor modeli: W dowolnym oknie konwersacji kliknij nazwę modelu w lewym górnym rogu (domyślnie może to być „GPT-4”).

- Wybierz „o3” lub „o4-mini”: Wyszukaj listę serii o — o3 pojawi się obok o4-mini i GPT-4. Kliknij „o3”, aby natychmiast rozpocząć korzystanie z modelu.

- Dostosuj poziom rozumowania (tylko o3-mini): W „Advanced Settings” ChatGPT możesz wybrać pomiędzy niskim, średnim lub wysokim wysiłkiem rozumowania dla wariantów o3-mini. Średni jest domyślny; wysoki zużywa więcej obliczeń, ale może dać bardziej szczegółowe rozwiązania krok po kroku.

Jak można sprawdzić, czy o3 jest aktywne?

Po wybraniu o3 nagłówek konwersacji wyświetli „Model: o3”. Możesz również przeprowadzić test, wydając wieloetapowe zapytanie rozumowania — takie jak „Wyjaśnij i rozwiąż problem Monty'ego Halla krok po kroku” — i obserwując głębokość wyjaśnienia ciągu myśli. Jeśli odpowiedź pokazuje wyraźne kroki pośrednie, wykorzystujesz prywatny ciąg myśli o3.

W jaki sposób programiści mogą zintegrować o3 poprzez API?

Klucze API i uwierzytelnianie

- Uzyskaj klucz API logując się na platform.openai.com i przechodząc do zakładki „Klucze API”.

- Wygeneruj nowy klucz jeśli jeszcze go nie masz.

- Przechowuj swój klucz bezpiecznie — nigdy nie koduj go na stałe w publicznych repozytoriach.

- Ustaw zmienną środowiskową:

export OPENAI_API_KEY="your_api_key_here"Ten klucz zapewnia dostęp do wszystkich subskrybowanych punktów końcowych, w tym o3.

Konfiguracja punktu końcowego

W kodzie aplikacji określ parametr modelu jako "o3"Na przykład używając Pythona z SDK OpenAI:

import openai

response = openai.ChatCompletion.create(

model="o3",

messages=,

temperature=0.7

)

print(response.choices.message.content)

Dostosuj parametry takie jak temperature, max_tokens, stream aby dopasować się do Twojego przypadku użycia. Jeśli potrzebujesz niższego opóźnienia lub kosztów, rozważ o4-mini wariant poprzez określenie "o4-mini".

Jakie są limity cenowe i stawek?

o3 jest wyceniany na poziomie premium — około 1.5-krotnie wyższym od kosztów tokenów GPT-4 — co odzwierciedla jego rozszerzone wykorzystanie obliczeniowe. Limity stawek różnią się w zależności od poziomu konta, ale zazwyczaj zezwalają na 40 żądań na minutę dla standardowych użytkowników API, a pojemność burst jest dostępna dla klientów korporacyjnych na żądanie. Wykorzystanie jest mierzone na podstawie tokena (wejście + wyjście), a szczegółowe informacje dotyczące rozliczeń można przeglądać na pulpicie nawigacyjnym.

Dostęp do API o3 w CometAPI

CometAPI zapewnia ujednolicony interfejs REST, który agreguje setki modeli AI — w tym rodzinę Gemini firmy Google — w ramach spójnego punktu końcowego, z wbudowanym zarządzaniem kluczami API, limitami wykorzystania i panelami rozliczeniowymi. Zamiast żonglować wieloma adresami URL dostawców i poświadczeniami.

Deweloperzy mogą uzyskać dostęp Interfejs API O3 przez Interfejs API CometNa początek zapoznaj się z możliwościami modelu w Playground i skonsultuj się z Przewodnik po API dla szczegółowych instrukcji.

Jakie wymagania systemowe i najlepsze praktyki mają zastosowanie?

Czy należy brać pod uwagę opóźnienia lub moc obliczeniową?

Głębsze rozumowanie o3 powoduje większe opóźnienia — odpowiedzi mogą trwać 0.5–1.5 sekundy dłużej niż GPT-4, w zależności od złożoności żądania. Gdy wydajność jest krytyczna, deweloperzy mogą zdecydować się na o4-mini, który zapewnia podobne korzyści w rozumowaniu przy zmniejszonych kosztach i opóźnieniach, lub dostosować poziom rozumowania o3-mini, aby uzyskać równowagę między szybkością a głębokością.

Jak należy strukturyzować polecenia, aby uzyskać optymalne wyniki?

Skuteczne podpowiadanie za pomocą o3 obejmuje:

- Wyraźne żądania wieloetapowe:Utwórz zapytania ramowe, które kierują ciągiem myśli (np. „Wypisz każde założenie przed rozwiązaniem…”).

- Dyrektywy narzędzi kontekstowych: Podczas korzystania z wtyczek określ w konwersacji, którego narzędzia chcesz użyć do przeszukiwania sieci lub analizy plików.

- Zarządzanie tokenami:Długie okna kontekstowe (obsługa do 128 tys. tokenów) umożliwiają tworzenie obszernych dokumentów, należy jednak pamiętać o kosztach tokenów.

W jaki sposób badacze bezpieczeństwa mogą uzyskać wczesny dostęp do o3-pro?

Czym jest o3-pro i dlaczego jest wyjątkowy?

o3-pro to nadchodząca profesjonalna wersja o3, oferująca pełne wsparcie narzędzi, wyższe limity szybkości i dodatkowe zabezpieczenia dla wrażliwych lub wymagających dużej uwagi aplikacji. OpenAI przewiduje jej wydanie pod koniec drugiego kwartału 2 r., z zarezerwowanymi slotami wczesnego dostępu dla zespołów badawczych ds. bezpieczeństwa i ochrony w celu oceny solidności, prywatności i łagodzenia stronniczości.

Jak złożyć wniosek o usługi wczesnego dostępu?

Badacze ds. bezpieczeństwa mogą się zgłaszać, przesyłając formularz „Early Access Services” na stronie zasad OpenAI. Wnioskodawcy muszą zaakceptować dodatkowe warunki dotyczące odpowiedzialnego ujawniania, raportowania użytkowania i przestrzegania warunków biznesowych API. Wcześni wnioskodawcy są zazwyczaj powiadamiani w ciągu dwóch tygodni od złożenia wniosku i muszą przejść weryfikację tożsamości i organizacji przed otrzymaniem poświadczeń API do testowania o3-pro.

Jak wykorzystać zaawansowane funkcje o3 w praktyce

W jaki sposób zintegrować wnioskowanie obrazowe z procesami pracy?

W ChatGPT wystarczy przesłać obraz — taki jak wykres, szkic lub zdjęcie tablicy — do konwersacji. Po wybraniu o3 poinstruuj model, aby przeanalizował lub przekształcił obraz („Obróć ten diagram o 90 stopni i oznacz każdą oś”). o3 przetworzy dane wizualne, wykona żądane manipulacje i wyjaśni kroki rozumowania w języku naturalnym.

W jaki sposób o3 może usprawnić badania w czasie rzeczywistym dzięki przeglądaniu stron internetowych?

Po włączeniu wtyczki „Web Browsing” w ustawieniach ChatGPT o3 może wydawać zapytania wyszukiwania, pobierać fragmenty stron internetowych na żywo i cytować źródła bezpośrednio w swoich odpowiedziach. Na przykład pytanie „Jakie są najnowsze ustalenia dotyczące efektów CRISPR poza celem?” powoduje, że o3 zbiera najnowsze badania, podsumowuje kluczowe wyniki i uwzględnia klikalne odniesienia — przyspieszając przeglądy literatury i sprawdzanie faktów w ciągu kilku minut.

Podsumowanie

Model o3 firmy OpenAI zapoczątkowuje nową erę rozumowania opartego na sztucznej inteligencji, łącząc głębokie możliwości łańcucha myśli z bezproblemową integracją narzędzi — od wyszukiwania w sieci na żywo po analizę obrazów multimodalnych. Dostęp do o3 jest prosty dla subskrybentów ChatGPT Plus, Pro i Team, a programiści mogą go wywołać za pośrednictwem standardowego interfejsu API z minimalnymi zmianami w istniejącym kodzie. Badacze ds. bezpieczeństwa zainteresowani wczesnym dostępem do nadchodzącego o3-pro mogą aplikować w ramach specjalistycznego programu OpenAI. Postępując zgodnie z opisanymi tutaj krokami i przyjmując najlepsze praktyki w zakresie szybkiego projektowania i korzystania z narzędzi, możesz odblokować pełny potencjał o3 w celu automatyzacji złożonych przepływów pracy, przyspieszenia badań i tworzenia inteligentniejszych aplikacji opartych na sztucznej inteligencji.