W latach 2025–2026 krajobraz narzędzi AI nadal się konsolidował: bramki API (takie jak CometAPI) rozszerzyły ofertę, aby zapewnić dostęp w stylu OpenAI do setek modeli, podczas gdy aplikacje LLM dla użytkowników końcowych (takie jak AnythingLLM) konsekwentnie ulepszały swojego dostawcę „Generic OpenAI”, umożliwiając aplikacjom desktopowym i lokalnym wywoływanie dowolnego endpointu kompatybilnego z OpenAI. Dzięki temu dziś łatwo skierować ruch AnythingLLM przez CometAPI i zyskać korzyści w postaci wyboru modeli, routingu kosztów oraz ujednoliconego rozliczania — przy zachowaniu lokalnego interfejsu AnythingLLM i funkcji RAG/agentów.

Czym jest AnythingLLM i dlaczego warto połączyć je z CometAPI?

Czym jest AnythingLLM?

AnythingLLM to otwartoźródłowa, kompleksowa aplikacja AI oraz klient lokalny/chmurowy do budowania asystentów konwersacyjnych, przepływów retrieval-augmented generation (RAG) i agentów sterowanych przez LLM. Oferuje dopracowany interfejs, API deweloperskie, funkcje workspace/agent oraz obsługę lokalnych i chmurowych LLM — domyślnie zaprojektowana z myślą o prywatności i rozszerzalna wtyczkami. AnythingLLM udostępnia dostawcę Generic OpenAI, który pozwala komunikować się z LLM-ami poprzez interfejsy kompatybilne z OpenAI.

Czym jest CometAPI?

CometAPI to komercyjna platforma agregująca API, udostępniająca 500+ modeli AI przez jeden interfejs REST w stylu OpenAI oraz ujednolicone rozliczanie. W praktyce umożliwia wywoływanie modeli od wielu dostawców (OpenAI, Anthropic, Google/warianty Gemini, modele obraz/dźwięk itd.) przez te same endpointy https://api.cometapi.com/v1 i z użyciem jednego klucza API (format sk-xxxxx). CometAPI obsługuje standardowe endpointy w stylu OpenAI, takie jak /v1/chat/completions, /v1/embeddings itd., co ułatwia adaptację narzędzi już wspierających API kompatybilne z OpenAI.

Dlaczego integrować AnythingLLM z CometAPI?

Trzy praktyczne powody:

- Wybór modeli i elastyczność względem dostawców: AnythingLLM może używać „dowolnego kompatybilnego z OpenAI” LLM przez wrapper Generic OpenAI. Skierowanie tego wrappera na CometAPI daje natychmiastowy dostęp do setek modeli bez zmiany interfejsu i przepływów w AnythingLLM.

- Optymalizacja kosztów i operacji: CometAPI pozwala centralnie przełączać modele (lub obniżać koszt przez tańsze warianty) dla kontroli wydatków oraz zachować ujednolicone rozliczanie zamiast żonglowania wieloma kluczami dostawców.

- Szybsze eksperymenty: Możesz robić A/B testy różnych modeli (np.

gpt-4o,gpt-4.5, warianty Claude czy otwartoźródłowe modele multimodalne) w tym samym interfejsie AnythingLLM — przydatne dla agentów, odpowiedzi RAG, podsumowań i zadań multimodalnych.

Środowisko i warunki, które musisz przygotować przed integracją

Wymagania systemowe i programowe (wysoki poziom)

- Komputer lub serwer z uruchomionym AnythingLLM (Windows, macOS, Linux) — instalacja desktopowa lub instancja self-hosted. Upewnij się, że używasz aktualnej wersji z ustawieniami LLM Preferences / AI Providers.

- Konto CometAPI i klucz API (tajny ciąg w formacie

sk-xxxxx). Użyjesz go w dostawcy AnythingLLM „Generic OpenAI”. - Łączność sieciowa z

https://api.cometapi.com(brak blokad HTTPS wychodzącego w firewallu). - Opcjonalnie, ale zalecane: nowoczesne środowisko Python lub Node do testów (Python 3.10+ lub Node 18+), curl oraz klient HTTP (Postman / HTTPie) do szybkiej weryfikacji CometAPI przed podpięciem do AnythingLLM.

Warunki specyficzne dla AnythingLLM

Dostawca Generic OpenAI jest zalecanym wyborem dla endpointów odwzorowujących API OpenAI. Dokumentacja AnythingLLM ostrzega, że ten dostawca jest ukierunkowany na deweloperów i powinieneś rozumieć przekazywane parametry. Jeśli korzystasz ze streamingu lub endpoint nie wspiera streamingu, AnythingLLM zawiera ustawienie do wyłączenia streamingu dla Generic OpenAI.

Lista kontrolna bezpieczeństwa i operacji

- Traktuj klucz CometAPI jak każdy inny sekret — nie commituj go do repozytoriów; przechowuj w systemowych schowkach na hasła lub zmiennych środowiskowych, gdzie to możliwe.

- Jeśli planujesz używać wrażliwych dokumentów w RAG, upewnij się, że gwarancje prywatności endpointów spełniają Twoje wymogi zgodności (sprawdź dokumentację/warunki CometAPI).

- Ustal limity max tokens i context window, aby zapobiec niekontrolowanym kosztom.

Jak skonfigurować AnythingLLM do użycia CometAPI (krok po kroku)?

Poniżej znajduje się konkretny ciąg kroków — a następnie przykładowe zmienne środowiskowe oraz fragmenty kodu do przetestowania połączenia przed zapisaniem ustawień w interfejsie AnythingLLM.

Krok 1 — Uzyskaj klucz CometAPI

- Zarejestruj się lub zaloguj w CometAPI.

- Przejdź do „API Keys” i wygeneruj klucz — otrzymasz ciąg podobny do

sk-xxxxx. Zachowaj go w tajemnicy.

Krok 2 — Zweryfikuj CometAPI szybkim żądaniem

Użyj curl lub Pythona, aby wywołać prosty endpoint chat completions i potwierdzić łączność.

Przykład curl

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-xxxxx" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-4o",

"messages": ,

"max_tokens": 50

}'

Jeśli otrzymasz status 200 i odpowiedź JSON z tablicą choices, Twój klucz i sieć działają poprawnie. (Dokumentacja CometAPI pokazuje powierzchnię zgodną z OpenAI i endpointy).

Przykład Python (requests)

import requests

url = "https://api.cometapi.com/v1/chat/completions"

headers = {"Authorization": "Bearer sk-xxxxx", "Content-Type": "application/json"}

payload = {

"model": "gpt-4o",

"messages": ,

"max_tokens": 64

}

r = requests.post(url, json=payload, headers=headers, timeout=15)

print(r.status_code, r.json())

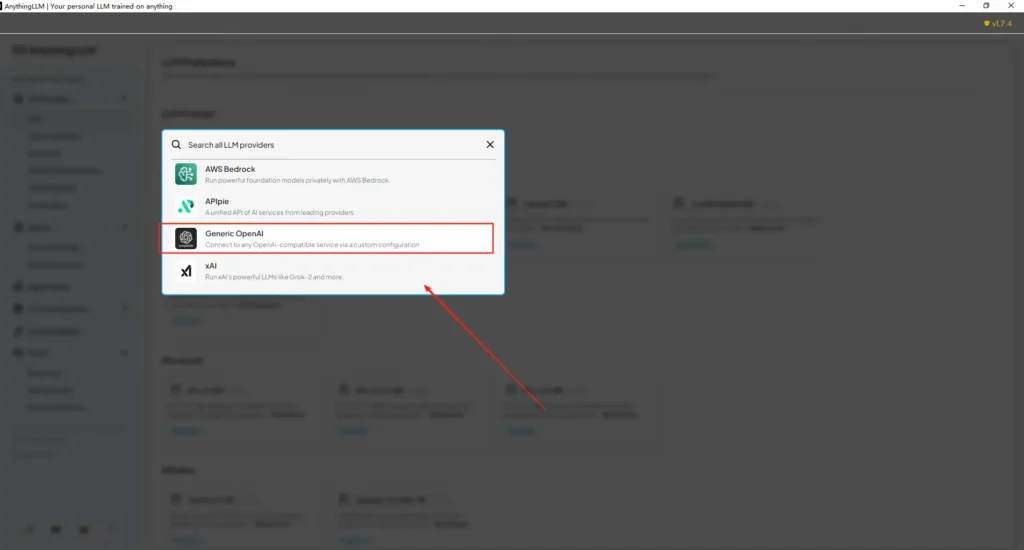

Krok 3 — Konfiguracja AnythingLLM (UI)

Otwórz AnythingLLM → Settings → AI Providers → LLM Preferences (lub podobna ścieżka w Twojej wersji). Użyj dostawcy Generic OpenAI i wypełnij pola następująco:

API Configuration (example)

• Wejdź do menu ustawień AnythingLLM, znajdź LLM Preferences w AI Providers.

• Wybierz Generic OpenAI jako dostawcę modelu, wpiszhttps://api.cometapi.com/v1w polu URL.

• Wklejsk-xxxxxz CometAPI do pola klucza API. Ustaw Token context window i Max Tokens zgodnie z wybranym modelem. Możesz też dostosować nazwy modeli na tej stronie, np. dodając modelgpt-4o.

To jest zgodne z wytycznymi AnythingLLM dla „Generic OpenAI” (wrapper deweloperski) oraz podejściem CometAPI z bazowym adresem URL kompatybilnym z OpenAI.

Krok 4 — Ustaw nazwy modeli i limity tokenów

Na tym samym ekranie dodaj lub dostosuj nazwy modeli dokładnie tak, jak publikuje je CometAPI (np. gpt-4o, minimax-m2, kimi-k2-thinking), aby interfejs AnythingLLM mógł je prezentować użytkownikom. CometAPI publikuje ciągi nazw modeli dla każdego dostawcy.

Krok 5 — Test w AnythingLLM

Rozpocznij nowy czat lub użyj istniejącego workspace, wybierz dostawcę Generic OpenAI (jeśli masz wielu dostawców), wybierz jedną z nazw modeli CometAPI, które dodałeś, i uruchom prosty prompt. Jeśli otrzymasz sensowne odpowiedzi, integracja działa.

Jak AnythingLLM wykorzystuje te ustawienia wewnętrznie

Wrapper Generic OpenAI w AnythingLLM konstruuje żądania w stylu OpenAI (/v1/chat/completions, /v1/embeddings), więc po ustawieniu bazowego URL i podaniu klucza CometAPI AnythingLLM będzie transparentnie kierować czaty, wywołania agentów i zapytania embeddingów przez CometAPI. Jeśli korzystasz z agentów AnythingLLM (przepływy @agent), odziedziczą oni tego samego dostawcę.

Jakie są najlepsze praktyki i możliwe pułapki?

Najlepsze praktyki

- Używaj ustawień kontekstu odpowiednich dla modelu: Dopasuj Token Context Window i Max Tokens w AnythingLLM do modelu wybranego w CometAPI. Niedopasowanie skutkuje nieoczekiwanym obcinaniem lub błędami wywołań.

- Zabezpiecz swoje klucze API: Przechowuj klucze CometAPI w zmiennych środowiskowych i/lub menedżerach sekretów (np. Kubernetes); nigdy nie commituj ich do gita. AnythingLLM zapisze klucze w lokalnych ustawieniach, jeśli wprowadzisz je przez UI — traktuj magazyn hosta jako wrażliwy.

- Zacznij od tańszych/mniejszych modeli do eksperymentów: Dzięki CometAPI wypróbujesz tańsze modele w fazie developmentu, a modele premium zarezerwujesz na produkcję. CometAPI wprost promuje przełączanie kosztów i ujednolicone rozliczenia.

- Monitoruj użycie i ustaw alerty: CometAPI oferuje panele zużycia — ustaw budżety/alerty, by uniknąć niespodziewanych kosztów.

- Testuj agentów i narzędzia w izolacji: Agenci AnythingLLM mogą wywoływać działania; testuj ich bezpiecznymi promptami i najpierw na środowiskach staging.

Typowe pułapki

- Konflikty UI vs

.env: Przy self-hostingu ustawienia UI mogą nadpisywać zmiany w.env(i odwrotnie). Sprawdź wygenerowany plik/app/server/.env, jeśli po restarcie ustawienia się resetują. Zgłoszenia społeczności raportują resetLLM_PROVIDER. - Niedopasowane nazwy modeli: Użycie nazwy modelu niedostępnej w CometAPI spowoduje 400/404 z bramki. Zawsze potwierdź dostępne modele na liście modeli CometAPI.

- Limity tokenów i streaming: Jeśli potrzebujesz streamingu odpowiedzi, sprawdź, czy dany model CometAPI go wspiera (oraz czy Twoja wersja UI AnythingLLM go obsługuje). Niektórzy dostawcy różnią się semantyką streamingu.

Jakie realne przypadki użycia odblokowuje ta integracja?

Retrieval-Augmented Generation (RAG)

Użyj loaderów dokumentów AnythingLLM + bazy wektorowej z LLM-ami CometAPI, by generować odpowiedzi świadome kontekstu. Możesz eksperymentować z tanimi embeddingami + drogimi modelami czatu lub trzymać wszystko w CometAPI dla ujednoliconego rozliczania. Przepływy RAG są kluczową funkcją wbudowaną w AnythingLLM.

Automatyzacja agentów

AnythingLLM wspiera przepływy @agent (przeglądanie stron, wywoływanie narzędzi, automatyzacje). Kierowanie wywołań LLM agentów przez CometAPI daje wybór modeli do kroków kontrolnych/interpretacyjnych bez modyfikowania kodu agentów.

Testy A/B na wielu modelach i optymalizacja kosztów

Przełączaj modele per workspace lub funkcję (np. gpt-4o dla odpowiedzi produkcyjnych, gpt-4o-mini dla developmentu). CometAPI ułatwia podmianę modeli i centralizuje koszty.

Potoki wielomodalne

CometAPI zapewnia modele obrazu, audio i wyspecjalizowane. Wsparcie wielomodalności w AnythingLLM (przez dostawców) plus modele CometAPI umożliwia opis obrazów, wielomodalne podsumowania czy transkrypcję audio przez ten sam interfejs.

Wnioski

CometAPI konsekwentnie pozycjonuje się jako bramka wielomodelowa (500+ modeli, API w stylu OpenAI) — co czyni ją naturalnym partnerem dla aplikacji takich jak AnythingLLM, które już obsługują dostawcę Generic OpenAI. Z kolei dostawca Generic w AnythingLLM i najnowsze opcje konfiguracji ułatwiają podłączenie do takich bramek. To zbieżność, która upraszcza eksperymenty i migrację produkcyjną pod koniec 2025 roku.

Jak zacząć z CometAPI

CometAPI to zunifikowana platforma API agregująca ponad 500 modeli AI od wiodących dostawców — takich jak seria GPT od OpenAI, Gemini od Google, Claude od Anthropic, Midjourney, Suno i inne — w jeden, przyjazny dla dewelopera interfejs. Dzięki spójnemu uwierzytelnianiu, formatowaniu żądań i obsłudze odpowiedzi CometAPI znacząco upraszcza integrację możliwości AI w Twoich aplikacjach. Niezależnie od tego, czy tworzysz chatboty, generatory obrazów, kompozytory muzyki, czy potoki analityki danych, CometAPI pozwala iterować szybciej, kontrolować koszty i zachować niezależność od dostawców — jednocześnie czerpiąc z najnowszych osiągnięć ekosystemu AI.

Aby zacząć, poznaj możliwości modeli CometAPI w Playground i zapoznaj się z przewodnikiem API. Przed dostępem upewnij się, że zalogowałeś się do CometAPI i uzyskałeś klucz API. CometAPI oferuje cenę znacznie niższą niż oficjalna, aby ułatwić integrację.

Gotowy do działania? → Zarejestruj się w CometAPI już dziś!

Jeśli chcesz poznać więcej porad, przewodników i nowości o AI, obserwuj nas na VK, X i Discord!