Anthropic wprowadził Claude Opus 4.5 pod koniec listopada 2025 r. jako bardziej zdolny, bardziej efektywny model klasy Opus, ukierunkowany na profesjonalne inżynierstwo oprogramowania, agentowe przepływy pracy oraz zadania o długim horyzoncie. Jest dostępny poprzez platformę deweloperską Anthropic oraz za pośrednictwem CometAPI i wprowadza nowe mechanizmy sterowania API (w szczególności parametr effort), ulepszone narzędzia do obsługi komputera, rozszerzone myślenie oraz poprawę efektywności wykorzystania tokenów, co ma znaczenie w środowisku produkcyjnym.

Poniżej znajduje się praktyczny, profesjonalny przewodnik: co się zmieniło, jak uzyskać dostęp, jak korzystać z nowych ustawień (effort, extended thinking, tool use, files/computer use), wskazówki dotyczące kosztów i optymalizacji, kwestie bezpieczeństwa/ładu oraz wzorce integracji z rzeczywistością.

Czym dokładnie jest Claude Opus 4.5 i dlaczego to ważne?

Claude Opus 4.5 to najnowszy członek rodziny modeli klasy Opus firmy Anthropic (wydany 24–25 listopada 2025 r.), który koncentruje się na maksymalnych możliwościach rozumowania i kodowania, jednocześnie poprawiając efektywność korzystania z tokenów i oferując nowe sterowanie API do równoważenia kosztów i dokładności. Anthropic pozycjonuje Opus 4.5 jako „najinteligentniejszy model”, jaki dotąd wydał, ukierunkowany na złożone zadania inżynierii oprogramowania, długo działające agentów, automatyzację arkuszy kalkulacyjnych/Excel oraz zadania wymagające podtrzymywanego, wieloetapowego rozumowania.

Jakie są najważniejsze aktualizacje w Opus 4.5?

Anthropic zaprojektował Opus 4.5, aby poprawić głębokość rozumowania i zachowania agentowe, jednocześnie dając deweloperom lepszą kontrolę nad kompromisami koszt/latencja. Najważniejsze elementy wydania to:

- Parametr effort (beta): pierwszorzędne pokrętło w API, które kontroluje, ile „budżetu myślenia” Claude poświęca na żądanie (zwykle

low,medium,high). Wpływa na rozumowanie, wywołania narzędzi i wewnętrzne tokeny „thinking”, dzięki czemu można stroić szybkość vs. dokładność per wywołanie, zamiast przełączać modele. To charakterystyczna funkcja Opus 4.5. - Lepsza orkiestracja agentów i narzędzi: większa trafność w wyborze narzędzi, lepiej ustrukturyzowane wywołania narzędzi i bardziej odporny przepływ wyników narzędzi do budowy agentów i wieloetapowych potoków. Anthropic dostarcza dokumentację i wskazówki SDK do przepływu „tool use”.

- Efektywność tokenów/kosztów — Anthropic raportuje do ~50% redukcji zużycia tokenów dla niektórych przepływów względem Sonnet 4.5, a także mniej błędów wywołań narzędzi i mniej iteracji w złożonych zadaniach inżynieryjnych.

- Ulepszone możliwości multimodalne: wszechstronne ulepszenia w obszarze wizji, rozumowania i matematyki.

- Rozszerzone okno kontekstu do 200K tokenów, wspierające długie, pogłębione rozmowy i analizę złożonych dokumentów.

Jakie praktyczne możliwości uległy poprawie?

Aktualizacja wydajności

- Lepsza orkiestracja agentów i narzędzi: większa trafność w wyborze narzędzi, lepiej ustrukturyzowane wywołania narzędzi i bardziej odporny przepływ wyników narzędzi do budowy agentów i wieloetapowych potoków. Anthropic dostarcza dokumentację i wskazówki SDK do przepływu „tool use”. Ulepszone zarządzanie kontekstem, narzędzia do kompakcji w długich przebiegach agentów i pierwszorzędne SDK narzędzi do rejestrowania i walidacji narzędzi sprawiają, że Opus 4.5 lepiej sprawdza się przy budowie agentów działających bez nadzoru przez wiele kroków.

- Ulepszone możliwości multimodalne: wszechstronne ulepszenia w obszarze wizji, rozumowania i matematyki.

- Rozszerzone okno kontekstu do 200K tokenów, wspierające długie, pogłębione rozmowy i analizę złożonych dokumentów.

Kodowanie i praca długohoryzontalna

Opus 4.5 pozostaje sterowany benchmarkami w zadaniach kodowania; redukuje liczbę iteracji i błędów wywołań narzędzi podczas długich prac (migracja kodu, refaktoryzacja, wieloetapowe debugowanie). Wczesne raporty i karta systemowa Anthropic wskazują na poprawę utrzymywanej wydajności w benchmarkach inżynierskich i znaczące zyski efektywności w potokach sterowanych narzędziami.

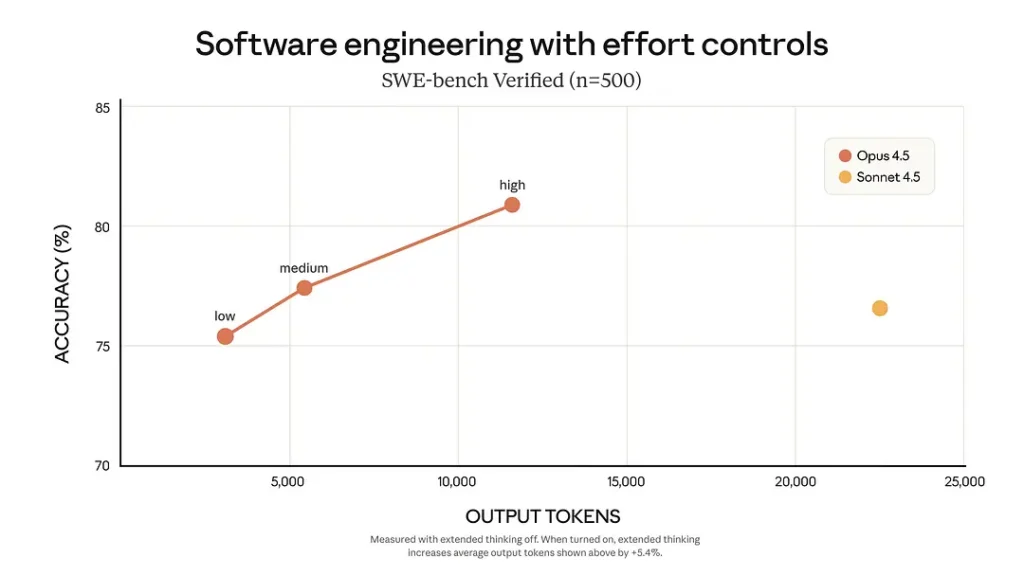

W SWE-bench Opus 4.5 raportuje wiodące wyniki na benchmarkach inżynierii oprogramowania (Anthropic podaje 80,9% na SWE-bench Verified w materiałach premierowych), a klienci zgłaszają poprawę w debugowaniu, edycjach wielu plików i długohoryzontalnych zadaniach kodowych.

Koszt i efektywność

Anthropic zaprojektował Opus 4.5, aby poprawić głębokość rozumowania i zachowania agentowe, jednocześnie dając deweloperom lepszą kontrolę nad kompromisami koszt/latencja:

- Obniżka ceny względem opus 4.1: $5 (input) / $25 (output) per million tokens.

- Poprawa zużycia tokenów: średnio 50–75% mniej przy zachowaniu wydajności.

- pierwszorzędne pokrętło API, które kontroluje, ile „budżetu myślenia” Claude poświęca na żądanie (zwykle

low,medium,high). Wpływa na rozumowanie, wywołania narzędzi i wewnętrzne tokeny „thinking”, dzięki czemu można stroić szybkość vs. dokładność per wywołanie, zamiast przełączać modele. To charakterystyczna funkcja Opus 4.5 (w porównaniu z Sonnet 4.5: Medium Effort → 76% mniej tokenów, porównywalna wydajność; High Effort → ok. 4,3 pkt proc. lepsza wydajność, 48% redukcji wykorzystania tokenów).

Jak uzyskać dostęp i korzystać z API Claude Opus 4.5?

Jak mogę uzyskać dostęp i klucze?

- Utwórz konto deweloperskie Anthropic / Claude. Zarejestruj się w portalu deweloperskim Claude/Anthropic i utwórz klucz API w konsoli (dla zespołów dostępne są ścieżki organizacja/admin). Messages API to podstawowy endpoint dla interakcji w stylu czat/asystent.

- Partnerzy chmurowi: Opus 4.5 jest dostępny także poprzez główne marketplace’y chmurowe Google Vertex AI, CometAPI (platforma agregacji API AI, wymaga własnego uwierzytelniania). W CometAPI możesz korzystać z API Claude opus 4.5 w formacie Anthropic Messages oraz w formacie Chat.

Jak powinienem uwierzytelniać żądania?

Używaj standardowych tokenów Bearer: do każdego wywołania API dodaj nagłówek Authorization: Bearer $_API_KEY. Żądania to JSON przez HTTPS; Messages API akceptuje listę ustrukturyzowanych wiadomości (system + user + assistant).

Szybki start — Python (oficjalne SDK)

Zainstaluj SDK:

pip install anthropic

Minimalny przykład (synchroniczny):

import os

from anthropic import Anthropic

# expects ANTHROPIC_API_KEY in env

client = Anthropic(api_key=os.environ)

resp = client.messages.create(

model="claude-opus-4-5-20251101",

messages=,

max_tokens=512,

)

print(resp.content.text) # SDK returns structured content blocks

To wywołanie używa kanonicznego identyfikatora modelu Opus 4.5. Dla endpointów zarządzanych przez dostawcę (Vertex, CometAPI, Foundry) postępuj zgodnie z dokumentacją dostawcy, aby skonstruować klienta i dostarczyć URL oraz klucz dostawcy (np. https://api.cometapi.com/v1/messages dla CometAPI).

Szybki start — Python (CometAPI)

Musisz zalogować się do CometAPI i uzyskać klucz.

curl

--location

--request POST 'https://api.cometapi.com/v1/messages' \

--header 'Authorization: Bearer ' \

--header 'Content-Type: application/json' \

--data-raw '{ "model": "claude-opus-4-5-20251101", "max_tokens": 1000, "thinking": { "type": "enabled", "budget_tokens": 1000 }, "messages": }'

Jak używać nowego parametru effort i rozszerzonego myślenia?

Czym jest parametr effort i jak go ustawić?

Parametr effort to pierwszorzędne sterowanie API wprowadzone w Opus 4.5, które dostosowuje, ile wewnętrznych obliczeń i budżetu tokenów model poświęca na generowanie odpowiedzi. Typowe wartości to low, medium i high. Używaj go do równoważenia latencji i kosztu względem dokładności:

low— szybkie, oszczędne w tokeny odpowiedzi do zadań masowych i rutynowych.medium— zrównoważona jakość/koszt do zastosowań produkcyjnych.high— dogłębna analiza, wieloetapowe rozumowanie lub gdy dokładność jest najważniejsza.

Anthropic wprowadził effort dla Opus 4.5 (beta). Musisz dołączyć nagłówek beta (np. effort-2025-11-24) i wskazać output_config: { "effort": "low|medium|high" } (przykład poniżej). Domyślnym zachowaniem jest high. Obniżenie effort zmniejsza zużycie tokenów i latencję, ale może nieznacznie ograniczyć dokładność. Używaj go w przypadku wysokiej przepustowości lub gdy liczy się latencja.

Przykład:

# Example using the beta messages API shown in Anthropic docs

from anthropic import Anthropic

import os

client = Anthropic(api_key=os.getenv("ANTHROPIC_API_KEY"))

response = client.beta.messages.create(

model="claude-opus-4-5-20251101",

betas=, # required beta header

messages=,

max_tokens=1500,

output_config={"effort": "medium"} # low | medium | high

)

print(response)

Kiedy którego używać: low do zautomatyzowanych potoków (np. kategoryzacja e‑maili), medium do standardowych asystentów, a high do generowania kodu, głębokich badań lub zadań wysokiego ryzyka. Anthropic podkreśla ten parametr jako kluczowe sterowanie dla Opus 4.5.

W teście SWE-bench:

- W trybie Medium Effort: wydajność porównywalna z Sonnet 4.5, ale tokeny wyjściowe zredukowane o 76%;

- W trybie High Effort: wydajność przewyższa Sonnet 4.5 o ok. 4,3 pkt proc., a tokeny są zredukowane o 48%.

Czym jest Extended Thinking i jak je wywołać?

Extended Thinking (zwane także „extended thinking” lub „thinking blocks”) pozwala modelowi wykonywać pośrednie łańcuchy rozumowania lub krokowe wnioskowanie, z opcjonalnym zachowaniem lub podsumowaniem wewnętrznych bloków myślenia. Messages API wspiera to zachowanie, a Anthropic dodał sterowanie zachowywaniem wcześniejszych bloków myślenia, aby agenci wieloturowi mogli ponownie używać wcześniejszego rozumowania bez powtarzania kosztownych obliczeń. Używaj rozszerzonego myślenia, gdy zadanie wymaga wieloetapowego planowania, długohoryzontalnego rozwiązywania problemów lub orkiestracji narzędzi.

Jak integrować narzędzia i budować agentów z Opus 4.5?

Jedną z głównych mocnych stron Opus 4.5 jest ulepszony tool use: zdefiniuj narzędzia w kliencie, pozwól Claude zdecydować, kiedy je wywołać, wykonaj narzędzie i zwróć tool_result — Claude wykorzysta te wyniki w finalnej odpowiedzi. Anthropic dostarcza Agent SDK, które pozwalają rejestrować typowane funkcje narzędziowe (np. run_shell, call_api, search_docs), które Claude może wykryć i wywołać podczas rozszerzonego myślenia. Platforma przekształca definicje narzędzi w wywoływalne funkcje, które model może wywołać i otrzymać z nich wyniki. Tak budujesz bezpieczne przepływy agentowe (z kontrolowanymi wejściami/wyjściami).

Poniżej praktyczny wzorzec i kompleksowy przykład w Pythonie.

Wzorzec użycia narzędzi (koncepcyjny)

- Klient dostarcza metadane

toolsz nazwą, opisem i schematem JSON (input_schema). - Model zwraca blok

tool_use(ustrukturyzowana instrukcja wywołania danego narzędzia z konkretnymi danymi wejściowymi). Polestop_reasonw odpowiedzi API może mieć wartośćtool_use. - Klient wykonuje narzędzie (Twój kod wywołuje zewnętrzne API lub funkcję lokalną).

- Klient wysyła wiadomość uzupełniającą z

role:"user"i blokiem treścitool_resultzawierającym dane wyjściowe narzędzia. - Model konsumuje wynik narzędzia i zwraca finalną odpowiedź lub kolejne wywołania narzędzi.

Ten przepływ zapewnia bezpieczną kontrolę po stronie klienta nad tym, co model wykonuje (model proponuje wywołania narzędzi; Ty decydujesz o ich wykonaniu).

Kompletny przykład — Python (proste narzędzie pogodowe)

# 1) Define tools metadata and send initial request

from anthropic import Anthropic

import os, json

client = Anthropic(api_key=os.environ)

tools = [

{

"name": "get_weather",

"description": "Return the current weather for a given city.",

"input_schema": {"type":"object","properties":{"city":{"type":"string"}},"required":}

}

]

resp = client.messages.create(

model="claude-opus-4-5-20251101",

messages=,

tools=tools,

max_tokens=800,

)

# 2) Check if Claude wants a tool call

stop_reason = resp.stop_reason # SDK field

if stop_reason == "tool_use":

# Extract the tool call (format varies by SDK; this is schematic)

tool_call = resp.tool_calls # e.g., {"name":"get_weather", "input":{"city":"Tokyo"}}

tool_name = tool_call

tool_input = tool_call

# 3) Execute the tool client-side (here: stub)

def get_weather(city):

# Replace this stub with a real weather API call

return {"temp_c": 12, "condition": "Partly cloudy"}

tool_result = get_weather(tool_input)

# 4) Send tool_result back to Claude

follow_up = client.messages.create(

model="claude-opus-4-5-20251101",

messages=[

{"role":"user", "content":[{"type":"tool_result",

"tool_use_id": resp.tool_use_id,

"content": json.dumps(tool_result)}]}

],

max_tokens=512,

)

print(follow_up.content.text)

else:

print(resp.content.text)

Jak strukturyzować agentów dla niezawodności?

- Sanityzuj dane wejściowe narzędzi (unikaj iniekcji poprzez prompt).

- Waliduj wyniki narzędzi przed przekazaniem ich z powrotem do modelu (kontrola zgodności ze schematem).

- Ogranicz zakres narzędzi (zasada najmniejszych uprawnień).

- Używaj narzędzi do kompakcji (z SDK Anthropic), aby zachować kontrolę nad kontekstem w długich przebiegach.

Jak projektować prompty i strukturyzować wiadomości dla Opus 4.5?

Jakie role wiadomości i strategie prefill działają najlepiej?

Używaj wzorca trzyczęściowego:

- System (rola: system): instrukcje globalne — ton, zabezpieczenia, rola.

- Assistant (opcjonalnie): gotowe przykłady lub treści przygotowujące.

- User (rola: user): bieżące żądanie.

Wypełnij wiadomość systemową ograniczeniami (format, długość, polityka bezpieczeństwa, schemat JSON, jeśli chcesz strukturalny output). Dla agentów dołącz specyfikacje narzędzi i przykłady użycia, aby Opus 4.5 mógł je prawidłowo wywoływać.

Jak używać kompakcji kontekstu i pamięci podręcznej promptów, aby oszczędzać tokeny?

- Kompakcja kontekstu: kompresuj starsze części rozmowy do zwięzłych podsumowań, które model nadal może wykorzystać. Opus 4.5 wspiera automatyzację kompakcji kontekstu bez utraty kluczowych bloków rozumowania.

- Pamięć podręczna promptów: buforuj odpowiedzi modelu dla powtarzających się promptów (Anthropic zapewnia wzorce cache’owania promptów w celu redukcji latencji/kosztów).

Obie funkcje zmniejszają ślad tokenowy długich interakcji i są zalecane dla długo działających agentów i asystentów produkcyjnych.

Obsługa błędów i najlepsze praktyki

Poniżej pragmatyczne zalecenia dotyczące niezawodności i bezpieczeństwa przy integracji produkcyjnej z Opus 4.5.

Niezawodność i ponowienia

- Obsługuj limity zapytań (HTTP 429) z wykładniczym wycofaniem (exponential backoff) i jitterem (start 500–1000 ms).

- Idempotencja: dla niezmieniających stanu wywołań LLM możesz bezpiecznie ponawiać, ale uważaj w przepływach, gdzie model wyzwala efekty uboczne (wywołania narzędzi) — deduplikuj, śledząc

tool_use_idlub własne identyfikatory żądań. - Stabilność strumieniowania: obsługuj częściowe strumienie i wznawiaj połączenie w sposób kontrolowany; w razie przerwania preferuj ponowienie całego żądania albo wznowienie z użyciem stanu aplikacji, aby uniknąć niespójnych interakcji narzędziowych.

Bezpieczeństwo

- Iniekcja promptów i bezpieczeństwo narzędzi: nigdy nie pozwalaj modelowi bezpośrednio wykonywać dowolnych poleceń shella lub kodu bez walidacji. Zawsze waliduj dane wejściowe narzędzi i sanityzuj wyjścia. Model proponuje wywołania narzędzi; Twój kod decyduje o ich uruchomieniu. Karta systemowa i dokumentacja Anthropic opisują ograniczenia i poziomy bezpieczeństwa — stosuj je w domenach wysokiego ryzyka.

- Przetwarzanie danych i zgodność: traktuj prompty i dane wejściowe/wyjściowe narzędzi zawierające PII lub dane regulowane zgodnie z polityką prawną/zgodności. Używaj rozwiązań VPC/enterprise dostawcy, jeśli masz wymogi dotyczące rezydencji danych lub audytu (Bedrock / Vertex / Foundry oferują opcje korporacyjne).

Observability i kontrola kosztów

- Loguj metadane żądań/odpowiedzi (bez surowych treści wrażliwych, chyba że jest to dozwolone) — liczbę tokenów, poziom effort, latencję, identyfikator modelu i dostawcę. Te metryki są kluczowe dla rozliczeń kosztów i debugowania.

- Używaj effort do kontroli kosztu per wywołanie: preferuj

lowdla rutynowej kategoryzacji/streszczania lub endpointów o wysokim QPS; używajhighdo głębokiego debugowania lub dochodzeń. Monitoruj jakość vs. zużycie tokenów, aby dobrać domyślne poziomy dla różnych endpointów.

Wnioski — kiedy (i jak) wybrać Opus 4.5?

Claude Opus 4.5 to naturalny wybór, gdy Twój produkt potrzebuje:

- głębokiego, wieloetapowego rozumowania (długie łańcuchy logiki, badania lub debugowanie),

- odpornej orkiestracji agentów/narzędzi (złożone przepływy wywołujące zewnętrzne API), lub

- asysty produkcyjnej przy kodzie w dużych bazach kodu.

Operacyjnie używaj effort do strojenia budżetu per wywołanie; polegaj na wzorcu tool use, aby zachować bezpieczeństwo wykonania, i wybierz partnera chmurowego (lub bezpośrednie API Anthropic) zgodnie z wymogami zgodności. Benchmarkuj na własnym korpusie: dane dostawcy (SWE-bench itp.) są użyteczną wskazówką, ale to Twoje rzeczywiste zadanie i dane determinują ROI. Dla bezpieczeństwa postępuj zgodnie z kartą systemową Opus 4.5 i ustaw zabezpieczenia wokół wykonywania narzędzi i przetwarzania PII.

Deweloperzy mogą uzyskać dostęp do Claude Opus 4.5 API za pośrednictwem CometAPI. Aby rozpocząć, zapoznaj się z możliwościami modeli CometAPI w Playground i sprawdź przewodnik API z instrukcjami. Przed uzyskaniem dostępu upewnij się, że zalogowałeś się do CometAPI i uzyskałeś klucz API. CometAPI oferuje cenę znacznie niższą niż oficjalna, aby ułatwić integrację.

Gotowy do startu?→ Zarejestruj się w CometAPI już dziś!

Jeśli chcesz poznać więcej porad, przewodników i wiadomości o AI, śledź nas na VK, X i Discord!

![Poniżej znajdziesz szybki przewodnik, jak wywoływać model Claude Opus 4.5 przez API Anthropic. Zastąp {MODEL_ID} poprawnym identyfikatorem modelu z dokumentacji Anthropic dla wydania „Opus 4.5” oraz ustaw zmienną środowiskową ANTHROPIC_API_KEY.

1) Krok po kroku

- Utwórz konto w Anthropic i wygeneruj klucz API.

- Sprawdź w dokumentacji właściwy identyfikator modelu dla Opus 4.5 ({MODEL_ID}).

- Wyślij żądanie POST do https://api.anthropic.com/v1/messages z wymaganymi nagłówkami:

- x-api-key: {Twój klucz}

- anthropic-version: 2023-06-01

- content-type: application/json

- Ustal parametry co najmniej: model, messages, max_tokens. Opcjonalnie: system, temperature, top_p, top_k, stop_sequences.

2) Minimalny przykład: cURL

curl https://api.anthropic.com/v1/messages \

-H "x-api-key: $ANTHROPIC_API_KEY" \

-H "anthropic-version: 2023-06-01" \

-H "content-type: application/json" \

-d '{

"model": "{MODEL_ID}",

"max_tokens": 512,

"messages": [

{"role": "user", "content": "Napisz krótkie podsumowanie w 3 zdaniach."}

],

"system": "Jesteś pomocnym asystentem."

}'

3) Python (oficjalny SDK)

# pip install anthropic

import os

from anthropic import Anthropic

client = Anthropic(api_key=os.environ["ANTHROPIC_API_KEY"])

resp = client.messages.create(

model="{MODEL_ID}",

max_tokens=512,

system="Jesteś pomocnym asystentem.",

messages=[{"role": "user", "content": "Podaj 3 kluczowe punkty na temat uczenia maszynowego."}]

)

print(resp.content[0].text)

4) JavaScript/TypeScript (oficjalny SDK)

# npm i @anthropic-ai/sdk

import Anthropic from "@anthropic-ai/sdk";

const client = new Anthropic({ apiKey: process.env.ANTHROPIC_API_KEY });

const msg = await client.messages.create({

model: "{MODEL_ID}",

max_tokens: 512,

system: "Jesteś pomocnym asystentem.",

messages: [{ role: "user", content: "Wypisz 5 pomysłów na kampanię." }]

});

console.log(msg.content[0].text);

5) Streaming odpowiedzi (JS)

import Anthropic from "@anthropic-ai/sdk";

const client = new Anthropic({ apiKey: process.env.ANTHROPIC_API_KEY });

const stream = await client.messages.create({

model: "{MODEL_ID}",

max_tokens: 512,

messages: [{ role: "user", content: "Pisz powoli po jednym zdaniu." }],

stream: true

});

for await (const event of stream) {

if (event.type === "content_block_delta" && event.delta.type === "text_delta") {

process.stdout.write(event.delta.text);

}

}

6) Dobre praktyki

- Nie umieszczaj klucza API w kodzie frontendu.

- Ustaw rozsądne max_tokens i kontroluj koszty.

- Obsługuj 429/5xx retry (z backoff), respektuj limity.

- Przechowuj identyfikator sesji/kontekst tylko w razie potrzeby — pamiętaj o limitach tokenów.

- W wiadomościach używaj ról: user, assistant; opcjonalnie system do ustawienia zachowania.

- Sprawdzaj aktualną dokumentację Anthropic (modele, identyfikatory, pola i limity mogą się zmieniać).

Uwaga: użyj dokładnego ID modelu dla „Opus 4.5” podanego przez Anthropic w dokumentacji; w powyższych przykładach pozostawiono placeholder {MODEL_ID}.](/_next/image/?url=https%3A%2F%2Fresource.cometapi.com%2Fblog%2Fuploads%2F2025%2F11%2FClaude-Opus-4.5.webp&w=3840&q=75)