5 lutego 2026 r. Anthropic zaprezentował Claude Opus 4.6, najnowszy flagowy model z rodziny Claude. Opus 4.6 mocniej koncentruje się na długotrwałej pracy wymagającej wiedzy oraz agentowych przepływach pracy w oprogramowaniu: wprowadza beta okno kontekstu 1,000,000 tokenów, udoskonaloną koordynację multiagentową o nazwie Agent Teams oraz system adaptive reasoning (Adaptive Thinking) sterowany kontrolą effort. Model jest dostępny poprzez Claude Developer Platform oraz zewnętrzne agregatory API (na przykład CometAPI) i jest promowany jako zamiennik typu drop-in dla wielu zastosowań Claude.

Czym jest Claude Opus 4.6

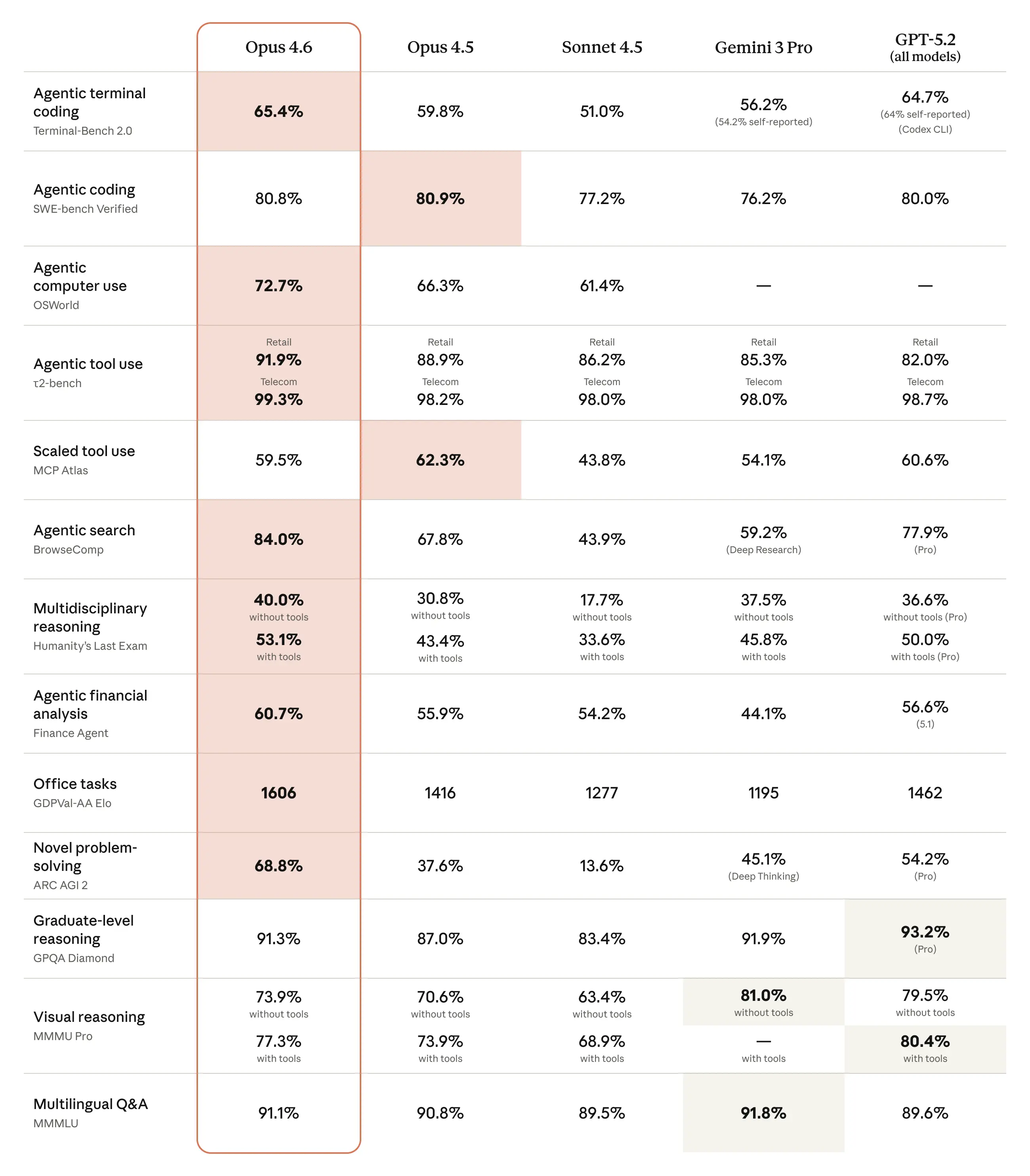

Claude Opus 4.6 to najnowszy model klasy Opus od Anthropic, pozycjonowany jako ich najbardziej kompetentny model do tej pory w zakresie kodowania, agentowych przepływów pracy i wnioskowania na długim kontekście. Wydanie priorytetowo traktuje długotrwałe zadania „agentowe” (pomyśl o etapowych migracjach kodu, refaktoryzacjach obejmujących wiele plików lub koordynowanych agentach badawczych), ciężkie przetwarzanie dokumentów oraz integracje korporacyjne. Anthropic opisuje Opus 4.6 jako niemal bezpośrednią aktualizację typu drop-in z 4.5, ale z kilkoma zmianami w zachowaniu i możliwościach istotnymi dla wdrożeniowców.

Kluczowe możliwości Claude Opus 4.6, które warto znać od razu

- 1M token context window (beta): Opus 4.6 wprowadza bardzo duże okno kontekstu (Anthropic udostępnia je w wersji beta), umożliwiając modelowi „widzenie” i wnioskowanie nad niezwykle dużymi dokumentami lub całymi bazami kodu w jednej sesji. To sprawia, że zadania takie jak refaktoryzacje całego repozytorium, długie przeglądy prawne oraz synteza wielu dokumentów stają się znacznie bardziej praktyczne.

- Agent Teams: Opus 4.6 rozwija możliwości agentowe, umożliwiając koordynowane grupy agentów (Agent Teams) — wiele agentów Claude pracujących równolegle nad różnymi podzadaniami i współdzielących stan. Zostało to zaprojektowane tak, by systemy mogły dekomponować trudne problemy (np. jeden agent skupia się na tworzeniu testów, inny na refaktoryzacji, a trzeci na QA) i koordynować ich wyniki.

- Adaptive Thinking (poziomy effort): Zamiast binarnego przełącznika „thinking”, Opus 4.6 udostępnia wiele poziomów effort (np. low/medium/high/max), które wymieniają opóźnienie i koszt na głębszy łańcuch rozumowania i bardziej rozważne wnioskowanie. Anthropic udostępnia także mechanizmy kontroli, takie jak kompresja kontekstu, aby efektywnie zarządzać długimi rozmowami.

- 128K Output Token Budget: Opus 4.6 podwaja poprzedni maksymalny budżet wyjścia (64K → 128K), dzięki czemu model może dostarczać dłuższe, ciągłe odpowiedzi bez ucinania — przydatne do raportów wieloczęściowych lub generowania kodu obejmującego wiele plików. Przy tak dużych wyjściach zalecane jest strumieniowanie.

Inne praktyczne ulepszenia obejmują lepsze umiejętności kodowania i debugowania oraz opcje trybów/priorities zaprojektowane dla przedsiębiorstw i integrowanych przepływów pracy (integracja Copilot jest już wdrażana w miejscach takich jak GitHub Copilot).

Dlaczego te funkcje mają znaczenie (krótko)

- Okno 1M token ogranicza potrzebę wielokrotnych cykli wyszukiwania lub „zszywania” wielu dokumentów w wiele wywołań — możesz utrzymać więcej kontekstu w jednym wywołaniu, co upraszcza logikę aplikacji przy wielu pracach wymagających intensywnej wiedzy.

- Agent Teams zmieniają architekturę: zamiast jednego monolitycznego asystenta projektujesz małe, wyspecjalizowane agenty, które współpracują — łatwiejsza równoległość, jaśniejszy podział odpowiedzialności i potencjalnie większa niezawodność przy złożonych zadaniach.

- Adaptive Thinking daje przewidywalne regulatory kompromisu czasu względem jakości. To kluczowe w systemach produkcyjnych, gdzie opóźnienie, determinizm i koszt są ograniczeniami.

Jak wywoływać Claude Opus 4.6 przez CometAPI — krok po kroku

Using CometAPI to call Opus 4.6

Wiele zespołów preferuje zunifikowaną bramę multi-model (gdy chcesz ujednolicić kod klienta w różnych dostawcach). CometAPI to jeden z takich dostawców, który udostępnia wiele modeli poprzez jeden interfejs zgodny z OpenAI; dostępny jest też format wiadomości Anthropic (gdy potrzebujesz specyficznych dla API Anthropic możliwości kompresji i chcesz używać Claude Code przez CometAPI). Poniższe przykłady pokazują wzorce do zastosowań produkcyjnych: uwierzytelnianie, wybór modelu, włączanie funkcji długiego kontekstu, strumieniowanie i kontrolę kosztów. (Dostosuj nazwy i nagłówki do rejestru modeli dostawcy, jeśli Comet zmieni identyfikatory modeli).

Pierwsze kroki (lista kontrolna dla deweloperów)

- zarejestruj się w CometAPI, uzyskaj

COMET_API_KEYi ustawbase_urlklienta nahttps://api.cometapi.com/v1(Comet oferuje klientów i przykłady zgodne z OpenAI). Konsola Comet wyświetla dostępne modele oraz wszelkie specyficzne dla dostawców flagi, które możesz przekazać. - Z góry zdecyduj o ustawieniach możliwości:

thinking: {type: "adaptive"}, poziomoutput_config.effort,max_tokens(budżet wyjścia), strumieniowanie dla dużych wyjść oraz czy pożądane jest kompaktowanie kontekstu.

Claude API (pseudokod w stylu Pythona):

import anthropic

import os

# Pobierz swój klucz CometAPI z https://api.cometapi.com/console/token i wklej go tutaj

COMETAPI_KEY = os.environ.get("COMETAPI_KEY") or "<YOUR_COMETAPI_KEY>"

BASE_URL = "https://api.cometapi.com"

client = anthropic.Anthropic(

base_url=BASE_URL,

api_key=COMETAPI_KEY,

)

message = client.messages.create(

model="claude-opus-4-6",

max_tokens=1024,

messages=[{"role": "user", "content": "Cześć, Claude"}],

)

print(message.content[0].text)

Via CometAPI (OpenAI-compatible shim example):

# Przykład użycia klienta w stylu OpenAI skierowanego na CometAPI

from openai import OpenAI # lub kompatybilny klient

client = OpenAI(api_key="COMET_KEY", base_url="https://api.cometapi.com/v1")

resp = client.responses.create(

model="claude-opus-4-6",

reasoning={"type":"adaptive"}, # jeśli nakładka wspiera tę samą nazwę parametru

output_config={"effort":"medium"},

messages=[{"role":"user","content":"Wygeneruj plan migracji dla tego monorepozytorium."}]

)

print(resp.output_text)

Uwaga: nazwy parametrów w wrapperach CometAPI różnią się w zależności od SDK. CometAPI dokumentuje prosty model integracji i zazwyczaj obsługuje

model="claude-opus-4-6"; sprawdź dokumentację CometAPI pod kątem dokładnego mapowania pól i wszelkich wymaganych zmian kształtu żądania.

Najlepsze praktyki i użycie

Agent Teams: wzorce projektowe i krótki przepis

Kiedy używać Agent Teams: duże refaktoryzacje baz kodu, wieloetapowe przetwarzanie dokumentów oraz przepływy pracy, które naturalnie mapują się na odrębne wyspecjalizowane agenty (np. architekt, wykonawca, recenzent).

Prosty wzorzec Agent Teams:

- Agent orkiestrujący (orchestrator) otrzymuje ogólne zadanie i dzieli je na podzadania.

- Agenty wykonawcze (każda to instancja Claude) uruchamiane są ze skupionymi promptami i jasno określonymi kryteriami sukcesu.

- Praca równoległa: agenty działają równolegle, używając niezależnych kontekstów; wyniki są zwracane do orkiestratora.

- Scalanie i przegląd: orkiestrator kompaktuje rezultaty, wykonuje passę syntezy oraz końcową kontrolę bezpieczeństwa/przegląd (w razie potrzeby z

effort=maxdla ostatniej passy).

Praktyczne wskazówki:

- Nadaj każdemu subagentowi rygorystyczny prompt systemowy i ograniczony

max_tokens, aby uniknąć niekontrolowanych kosztów. - Korzystaj z CometAPI lub frameworka orkiestracji do zarządzania wywołaniami równoległymi i ponawianiem prób.

- Używaj kompaktowania kontekstu dla historii orkiestratora, by zachować decyzje bez płacenia za pełną dosłowną historię.

Zarządzanie kontekstem: obsługa dużych wejść i okno 1M tokenów

- Preferuj strukturalne wczytywanie: podawaj dokumenty jako segmentowane części (metadane dokumentu + bloki treści). Zachowuj punkty kotwiczące (tytuły dokumentów, indeksy) i poproś model o cytowanie źródeł według indeksu. To bardziej odporne niż wklejanie surowych plików.

- Używaj kompaktowania kontekstu (gdzie dostępne) dla długich sesji interaktywnych: pozwól modelowi streścić starsze wymiany, aby nie wyczerpywać budżetu tokenów, jednocześnie zachowując istotne fakty. Anthropic udostępnia kompaktowanie jako funkcję w wersji beta.

- Jeśli potrzebujesz deterministycznego odtwarzania, przechowuj artefakty kanoniczne we własnej bazie danych i odnoś się do nich przez ID zamiast ponownie przesyłać całe pliki przy każdym żądaniu. Użyj modelu do streszczania lub wyodrębniania tylko fragmentów potrzebnych w danym kroku.

Kompromisy koszt–opóźnienie–jakość — używanie effort i innych suwaków

- Effort: najskuteczniejsza pojedyncza kontrola do równoważenia kosztu względem możliwości. Zacznij od

mediumdla systemów produkcyjnych wymagających efektywności; używajhighlubmaxprzy krytycznych audytach, końcowych przeglądach lub złożonej syntezie.lowjest użyteczne dla rutynowego wyszukiwania lub krótkiego Q&A. Wiele zespołów raportuje świetne oszczędności kosztów, stosującmediumjako domyślne i podnoszącefforttylko wtedy, gdy to konieczne. - Przetwarzanie wsadowe i cache: używaj cache’owania promptów dla powtarzalnych pytań i przetwarzania wsadowego dla wielu małych, podobnych zadań, by zredukować koszty ponownego ładowania tokenów. Platforma Anthropic i dostawcy zewnętrzni wspierają cache promptów/tryby wsadowe.

- Strumieniowanie i porcjowane wyjścia: gdy potrzebujesz bardzo dużych odpowiedzi (długie generowanie kodu, szkice książek), korzystaj ze strumieniowania, aby zmniejszyć presję na pamięć i umożliwić wczesną akceptację/anulowanie.

Ostatnie myśli — gdzie Opus 4.6 zmienia kalkulację dewelopera

Opus 4.6 to wyraźny krok w stronę budowy dużych, trwałych, agentowych przepływów pracy bez zszywania wielu krótkich żądań. Okno 1M tokenów i Agent Teams odblokowują nowe klasy aplikacji (automatyzacja dużych baz kodu, długie przeglądy prawne/finansowe, asystenci badań wielodokumentowych), ale przesuwają też nacisk projektowy z mikrooptymalizacji promptów na projekt systemu: jak przechowujesz artefakty, orkiestrujesz specjalistów, mierzysz i ograniczasz koszt oraz monitorujesz zachowanie agentów.

Deweloperzy mogą uzyskać dostęp do Opus 4.6 przez CometAPI już teraz. Aby zacząć, eksploruj możliwości modelu w Playground i zapoznaj się z API guide po szczegółowe instrukcje. Przed uzyskaniem dostępu upewnij się, że zalogowałeś się do CometAPI i uzyskałeś klucz API. CometAPI oferuje cenę znacznie niższą niż oficjalna, aby ułatwić integrację.

Gotowi do działania?→ Zarejestruj się w openclaw już dziś!

Jeśli chcesz poznać więcej porad, przewodników i nowości o AI, śledź nas na VK, X i Discord!

.png&w=3840&q=75)