MiniMax-M2.5 to nowy, ukierunkowany na produktywność duży model językowy od MiniMax, zoptymalizowany pod kątem kodowania, agentowego użycia narzędzi oraz biurowych przepływów pracy. Możesz wywoływać go przez natywną platformę MiniMax lub przez agregatory API, takie jak CometAPI. Do korzystania z API wystarczy uzyskać klucz API CometAPI, ponieważ MiniMax-M2.5 obsługuje także format czatu.

Czym jest MiniMax-M2.5?

MiniMax-M2.5 to najnowsze, duże wydanie modelu od MiniMax: ewolucja rodziny M2, pozycjonowana przez firmę jako model ogólnego przeznaczenia, zdolny do pracy jako agent, o szczególnie wysokiej jakości w generowaniu kodu, użyciu narzędzi i wieloetapowym rozumowaniu. Rodzina M2.5 została zapowiedziana jako wydanie z lutego 2026 i obejmuje zarówno standardowe M2.5, jak i wariant „highspeed” zoptymalizowany pod niższe opóźnienia przy zachowaniu tych samych kluczowych możliwości. Rodzina M2.5 poprawiła wyniki benchmarków w ocenach inżynierii oprogramowania oraz zachowanie podczas interakcji z zewnętrznymi narzędziami (wyszukiwanie, agenci itd.).

Dostawca pozycjonuje M2.5 jako krok naprzód względem wcześniejszych wydań M2.x: silniejsze rozumowanie, lepsze generowanie kodu oraz poprawiona niezawodność wywołań narzędzi. Publiczne notatki wydawnicze MiniMax z początku lutego 2026 wskazują M2.5 jako kamień milowy: udoskonalone dostrajanie instrukcji, silniejsze rozumienie kodu oraz mierzalne zyski w kilku benchmarkach skoncentrowanych na kodzie. Wydanie obejmuje:

- Standardowy model M2.5 (kładący nacisk na dokładność i rozumowanie).

- Wariant M2.5-highspeed z niższym opóźnieniem dla interaktywnych przepływów pracy deweloperów.

- Wytyczne i opcje rozliczeń dla „Coding Plan” skierowanego do intensywnego generowania kodu.

Kluczowe cechy techniczne

- Architektura: MoE (duża łączna liczba parametrów z dużo mniejszym aktywnym zbiorem podczas wnioskowania), co zapewnia korzystny kompromis koszt/wydajność w ciężkich zadaniach.

- Mocne strony: najnowocześniejsze wyniki w kodowaniu, wieloturowe rozumowanie, obsługa długiego kontekstu oraz integracje z agentami/narzędziami.

- Odmiany: MiniMax publikuje warianty (np.

MiniMax-M2.5iM2.5-highspeed) dostrojone pod kątem przepustowości a opóźnień.

Dlaczego to ważne dziś: wiele zespołów budujących narzędzia deweloperskie, asystentów programowania i automatyzacje agentowe ceni model, który potrafi rozumować przez wiele tur, bezpiecznie wywoływać narzędzia i generować wysokiej jakości kod. M2.5 — dzięki architekturze i szkoleniu — jest jawnie kierowany do takich scenariuszy.

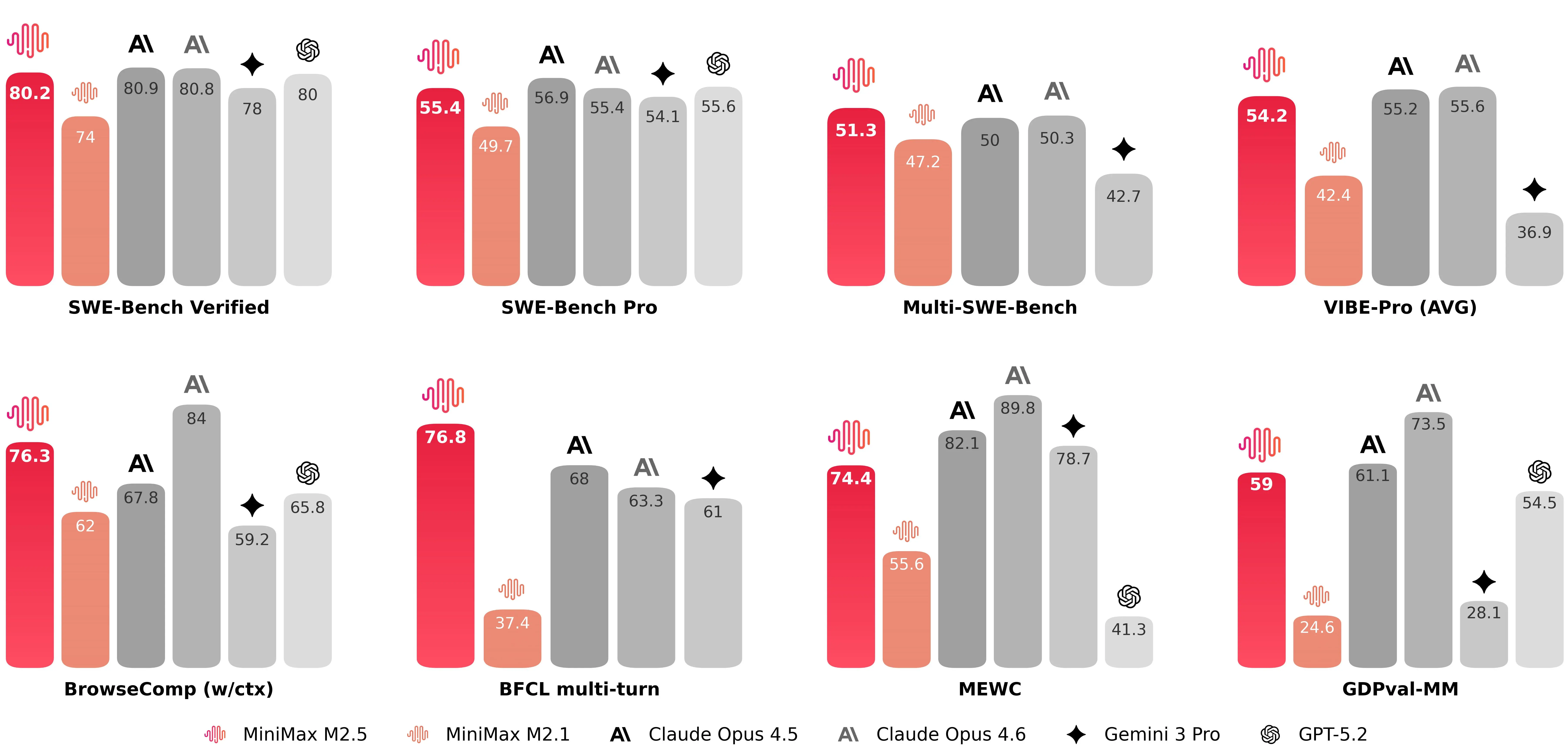

Benchmarki MiniMax-M2.5

Pozycja M2.5 na benchmarkach związanych z kodowaniem

MiniMax-M2.5 uzyskuje wynik 80,2% na SWE-Bench Verified, a także wysokie noty w wielozadaniowym kodowaniu i benchmarkach wspomaganych przeglądaniem (istotne liczby podane przez firmę obejmują 51,3% na Multi-SWE-Bench i 76,3% na BrowseComp przy włączonym zarządzaniu kontekstem). Te liczby lokują M2.5 wśród najlepiej publicznie dostępnych modeli do generowania kodu i rozwiązywania problemów w momencie premiery. Premiera MiniMax-M2.5 potwierdza, że M2.5 konkuruje z najwyższą ligą modeli kodujących.

Dla deweloperów korzyści są dwie:

- Wyższy wskaźnik sukcesu za pierwszym razem: mniej rund poprawek, mniej ręcznego debugowania i niższy koszt „pilnowania” autonomicznych agentów kodujących.

- Lepsze pokrycie full-stack: M2.5 jest opisywany jako wspierający przepływy full‑stack na aplikacjach desktopowych, mobilnych i wieloplatformowych, co oznacza, że ma generować nie tylko snippet-y, lecz spójne, wieloplikowe rozwiązania i skrypty buildów.

Zbudowany z myślą o przepływach agentowych

M2.5 jest opisywany jako „natywnie zaprojektowany do scenariuszy Agent”. Praktycznie oznacza to, że architektura i reżim szkoleniowy priorytetyzują:

- Wierność wywołań narzędzi: wykonywanie wywołań API lub uruchamianie poleceń shell/SQL z poprawną składnią i parametrami.

- Przełączanie kontekstu i pamięć: kontynuowanie przerwanej operacji wieloetapowej bez utraty poprzedniego stanu.

- Manipulację plikami: tworzenie i edycję popularnych formatów biurowych programowo (np. generowanie prezentacji PowerPoint, a następnie jej poprawa w reakcji na kolejne żądanie).

Wspomaganie wyszukiwaniem i przeglądaniem

Gdy M2.5 jest łączony z warstwami przeglądania lub wyszukiwania, MiniMax raportuje wyraźnie lepsze wyniki na benchmarkach przeglądania, odzwierciedlające silniejszą zdolność integrowania zewnętrznych informacji i cytowań w wyjściach. To sprawia, że M2.5 nadaje się do narzędzi, które muszą pozyskiwać aktualne treści, weryfikować wyniki API lub wzmacniać generowanie kodu danymi ze świata (np. pobierając najnowszą dokumentację SDK i używając jej poprawnie podczas generowania). Te możliwości są istotne dla zespołów budujących funkcje „agentowe”, takie jak zautomatyzowane QA, łańcuchy CI czy asystenci oparci na dokumentach.

Jak korzystać z API MiniMax-M2.5 (przez CometAPI)?

CometAPI to platforma agregująca API, która udostępnia setki modeli przez jednolity interfejs REST zgodny z OpenAI. Ponieważ interfejs CometAPI odzwierciedla endpointy chat/completions OpenAI, często możesz ponownie użyć istniejących klientów w stylu OpenAI, zmieniając api_base i klucz API. Jeśli wolisz nie integrować się bezpośrednio z platformą MiniMax (np. ze względu na ujednolicone rozliczenia, A/B‑testy wielu modeli lub abstrakcję dostawców), możesz wywoływać MiniMax-M2.5 przez „chat” CometAPI. Platforma CometAPI zapewnia spójny format żądania, SDK oraz webowy playground — i udostępnia nazwy oraz parametry per model (wybierasz dokładny łańcuch provider/model przy wywołaniu).

Poniżej znajduje się zwięzły, praktyczny przewodnik po wywołaniu MiniMax-M2.5 przez CometAPI, z przykładami w curl i Pythonie.

Jak zacząć — podstawowe kroki?

- Zarejestruj konto w CometAPI i uzyskaj klucz API. (CometAPI oferuje playground i SDK do testowania modeli).

- Sprawdź listę modeli CometAPI lub playground CometAPI, aby znaleźć dokładną nazwę modelu dla MiniMax-M2.5.

- Wykonaj uwierzytelnione żądanie POST z parametrem

modelustawionym na wybrany model MiniMax oraz ładunkiem zgodnym ze schematem chat/completion CometAPI. - Dostosuj parametry (temperature, max_tokens, komunikaty systemowe, streaming) do swojego przepływu pracy.

Uwierzytelnianie i podstawy endpointów

- Base URL:

https://api.cometapi.com/v1(obsługiwane są ścieżki w stylu OpenAI, takie jak/chat/completions). - Nagłówek:

Authorization: Bearer YOUR_COMETAPI_KEY - Content-Type:

application/json - Pole model: użyj dokładnego łańcucha nazwy modelu z katalogu CometAPI (przykłady:

"minimax-m2.5"

Przykład 1 — Szybki curl (REST, styl OpenAI)

# Replace $COMETAPI_KEY with your CometAPI key

curl -s -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer $COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "minimax-m2.5",

"messages": [

{"role":"system","content":"You are a concise, safety-conscious coding assistant."},

{"role":"user","content":"Refactor this synchronous Python function to async and add basic error handling:\n\n```\ndef fetch(user_id):\n resp = http_get(f\"https://api.example.com/users/{user_id}\")\n return resp.json()\n```"}

],

"max_tokens": 800,

"temperature": 0.0,

"stream": false

}'

Uwagi:

- Użyj dokładnie takiej nazwy modelu, jak w katalogu CometAPI.

stream: truejest obsługiwane do streamowania wyników (obsłuż zdarzenia SSE lub odpowiedzi kawałkami, jeśli chcesz częściowe tokeny).

Przykład 2 — Python (requests) dla chat completion

import os, requests

COMET_KEY = os.environ.get("COMETAPI_KEY") # recommended

URL = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "minimax-m2.5", # or "minimax/minimax-m2.5" — verify Comet's model page

"messages": [

{"role": "system", "content": "You are a helpful engineer who returns clear, tested code."},

{"role": "user", "content": "Write a pytest for the following function that asserts edge cases..."}

],

"temperature": 0.1,

"max_tokens": 1000,

}

r = requests.post(URL, json=payload, headers=headers, timeout=120)

r.raise_for_status()

out = r.json()

print(out["choices"][0]["message"]["content"])

Przykład 3 — Użycie litellm / integracja CometAPI (wygodna warstwa w Pythonie)

CometAPI jest obsługiwane przez kilka społecznościowych SDK i adapterów. Dokumentacja liteLLM pokazuje zwięzły przebieg, w którym ustawiasz COMETAPI_KEY i wywołujesz model po nazwie. Świetne do prototypowania:

import os

from litellm import completion

os.environ["COMETAPI_KEY"] = "your_cometapi_key_here"

messages = [{"role":"user", "content":"Explain async/await in Python in 3 bullets."}]

resp = completion(model="minimax-m2.5", messages=messages)

print(resp.choices[0].message.content)

Integracje litellm / Comet zapewniają przydatne narzędzia (streaming, async, jawny parametr api_key), które odzwierciedlają wiele istniejących wzorców SDK OpenAI.

Jak projektować prompty i komunikaty systemowe dla M2.5

Bądź jednoznaczny w roli i ograniczeniach

Nadaj M2.5 wyraźną rolę systemową przy proszeniu o kod. Przykład:

{"role": "system","content": "You are MiniMax M2.5, an assistant specialized in robust, readable, and well-documented code. Use Python 3.11 conventions, include type hints, and provide brief unit tests."}

Użyj podziału na kroki przy złożonych problemach

Gdy prosisz M2.5 o zaimplementowanie złożonych funkcji, zastosuj krótki podział:

- Poproś o zarys projektu.

- Poproś o sygnatury interfejsów.

- Poproś o implementację i testy.

To zmniejsza ryzyko halucynacji i daje modułowe, łatwe do przeglądu wyniki.

Temperature, max_tokens i bezpieczeństwo

- Do deterministycznego kodu: ustaw

temperatureblisko 0.0. - Do eksploracyjnego projektowania:

temperaturew zakresie 0.2–0.5 może ujawnić kreatywne podejścia. - Utrzymuj

max_tokensna tyle wysokie, by pokryć duże refaktoryzacje lub długie zestawy testów.

Proś o testy jednostkowe i wyjaśnienie

Gdy prosisz o kod, poproś też o testy jednostkowe i krótkie wyjaśnienie algorytmu. Pomaga to wykrywać subtelne błędy i otrzymać artefakty gotowe do uruchomienia już za pierwszym razem.

Wnioskowanie nad długimi zadaniami i śledzenie stanu

Model M2.5 oferuje znakomity mechanizm śledzenia stanu, skutecznie zapewniający ciągłość i kierunkowość rozumowania w długich sekwencjach czasu, koncentrując się za każdym razem na ograniczonej liczbie celów zamiast przetwarzać wszystko równolegle. M2.5 jest wyposażony w funkcje świadome kontekstu, umożliwiając wydajne wykonywanie zadań i zoptymalizowane zarządzanie kontekstem.

Praktyczne wskazówki użycia M2.5 w produkcji

MiniMax-M2.5 jest dostrojony do wieloetapowych narzędzi i kodu. Poniżej praktyczne, oparte na doświadczeniu porady, jak osiągać najlepsze efekty w produkcji.

Inżynieria promptów i komunikaty systemowe

- Używaj jednoznacznych komunikatów systemowych dotyczących roli i ograniczeń. Przy zadaniach kodowych dołącz wymagany runtime/frameworki testowe (np. „Zwróć test pytest zgodny z Python 3.11”).

- Dostarczaj kontekst: dla zadań agentowych lub wieloetapowych dołącz metadane kroków i opisy narzędzi jako JSON lub listy punktowane. M2.5 dobrze reaguje na strukturalne wejścia, bo jest zoptymalizowany do użycia narzędzi.

Wywoływanie funkcji/narzędzi

- Jeśli używasz CometAPI jako bramki do wywoływania narzędzi, upewnij się, że dodatkowe pola (np.

function_callw stylu OpenAI) pasują do oczekiwań CometAPI/modelu. Potwierdź wsparcie modelu na stronie Comet, ponieważ semantyka narzędzi może się różnić między dostawcami. - Dla solidnej orkiestracji dziel duże zadania na mniejsze wywołania i utrzymuj deterministyczne punkty kontrolne. M2.5 świetnie podąża za wieloetapowymi instrukcjami, ale najbardziej niezawodne zachowanie uzyskasz, walidując po każdym kroku.

Temperature, max_tokens i kontrola kosztów

- Do generowania/refaktoryzacji kodu ustaw

temperaturenisko (0.0–0.2) i dobierzmax_tokensdo oczekiwanej wielkości wyjścia. - Dla eksploracyjnych promptów podnieś

temperature, ale monitoruj rosnące użycie tokenów. Korzystając z CometAPI, porównuj ceny dostawców i zasady fallback — CometAPI podaje ceny tokenów dla instancji modeli w swoim katalogu.

Okno kontekstu i długie dokumenty

- Warianty M2.5 często wspierają długi kontekst (sprawdź specyfikację modelu pod kątem długości kontekstu). Dla bardzo długich dokumentów dziel i streszczaj — następnie podawaj streszczenia oraz odpowiednie fragmenty zamiast wysyłać całe pliki w jednym wywołaniu.

Bezpieczeństwo, treści toksyczne i ograniczanie halucynacji

- Używaj zabezpieczeń: komunikaty systemowe, zewnętrzni walidatorzy i zestawy testów (np. testy jednostkowe dla generowanego kodu) redukują ryzyko.

- Waliduj zewnętrzne odniesienia: jeśli model cytuje fakty lub kod z sieci, weryfikuj to programowo przed zaufaniem lub wdrożeniem wyników.

Typowe pułapki i jak ich unikać

Pułapka: Zbyt duże zaufanie do pojedynczej odpowiedzi modelu

Środki zaradcze: Uruchamiaj testy, statyczne analizy i — dla krytycznej logiki — poproś o wiele niezależnych kompletyzacji i porównaj. CometAPI pozwala przełączać się między wieloma modelami i możesz zmieniać je w dowolnej chwili używając formatu czatu OpenAI.

Pułapka: Używanie wysokiej temperatury w kodzie produkcyjnym

Środki zaradcze: Utrzymuj niską temperature; jeśli potrzebujesz kreatywnych alternatyw, poproś o wiele wariantów przy niskiej temperaturze lub poproś model o wyjaśnienie różnic.

Pułapka: Ignorowanie wersjonowania modeli

Środki zaradcze: Śledź nazwy modeli i łańcuchy dostawców w manifestach wdrożeniowych. Przy zmianie z MiniMax-M2.5 na MiniMax-M2.5-highspeed lub u innego dostawcy, traktuj to jak zmianę wydania i uruchom testy regresyjne.

Końcowe rekomendacje i realistyczne oczekiwania

MiniMax-M2.5 to istotny krok naprzód dla agentowych, zorientowanych na kod LLM — obiecuje mocne generowanie kodu, wieloturowe rozumowanie i bezpieczne użycie narzędzi. Jeśli priorytetem Twojego zespołu jest budowa solidnych narzędzi deweloperskich, frameworków agentowych lub asystentów kodu, M2.5 zasługuje na miejsce w macierzy porównawczej. Użycie CometAPI jako zunifikowanej bramki może przyspieszyć eksperymenty i pozwolić przełączać dostawców lub robić A/B testy bez przebudowy całej integracji.

Kilka pragmatycznych wniosków:

- Prototypuj szybko w playgroundzie CometAPI, a następnie zablokuj identyfikatory modeli w kodzie.

- Używaj niskiej temperatury, proś o testy i wyjaśnienia oraz zawsze uruchamiaj automatyczną walidację.

- Traktuj model jako potężnego współprogramistę — nie nieomylnego: stosuj przeglądy ludzkie, pipeline’y CI i telemetrię.

Deweloperzy mogą uzyskać dostęp do MiniMax-M2.5 przez CometAPI już teraz. Aby zacząć, poznaj możliwości modelu w Playground i zajrzyj do przewodnika API po szczegółowe instrukcje. Przed dostępem upewnij się, że zalogowałeś się do CometAPI i uzyskałeś klucz API. CometAPI oferuje cenę znacznie niższą niż oficjalna, aby ułatwić integrację.

Ready to Go?→ Zarejestruj się do M2.5 już dziś!

Jeśli chcesz poznać więcej porad, przewodników i nowości o AI, obserwuj nas na VK, X i Discord!