Nano Banana 2 — skrót używany przez społeczność dla najnowszego modelu generowania obrazów Google z rodziny Gemini — szybko zmienił oczekiwania dotyczące szybkiego, wysokiej wierności generowania i edycji obrazów. Wprowadzony pod koniec lutego 2026, ten wariant „Flash Image” (Gemini 3.1 Flash Image / Nano Banana 2) jest skierowany do deweloperów i zespołów produktowych, które potrzebują wyników na poziomie profesjonalnym przy wysokiej przepustowości i niskich opóźnieniach. W tym artykule łączę najnowsze relacje i dokumentację, aby wyjaśnić, czym jest Nano Banana 2, jak wypada w benchmarkach, jak uzyskać do niego dostęp i go wywoływać (w tym przez zewnętrzne bramki, takie jak CometAPI), oraz praktyczne wzorce promptów i użycia, które można stosować w produkcji.

CometAPI zapewnia jednolity interfejs w stylu HTTP, który udostępnia wiele modeli (w tym modele obrazowe) pod spójnymi endpointami. To może uprościć przełączanie się między dostawcami lub łączenie wyników z kilku modeli. Nano Banana 2 (Gemini 3.1 Image) jest dostępny w CometAPI.

Czym jest Nano Banana 2?

Nano Banana 2 (wewnętrznie zgodny z Gemini 3.1 Flash Image) to ukierunkowany, wysokowydajny model generowania obrazów od Google, który priorytetowo traktuje szybkość, niższy koszt na obraz oraz lepsze przestrzeganie instrukcji w zadaniach kreatywnych i edytorskich. Zaprojektowano go jako uzupełnienie wariantów o wyższej wierności „Pro”: Nano Banana 2 do wysokiej przepustowości i Nano Banana Pro (Gemini 3 Pro Image) do wyjść premium, klasy asset.

Zaprojektowano go, aby zapewnić:

- Szybkie wnioskowanie (z bardzo niskimi opóźnieniami, aby generowanie i edycje obrazów były niemal natychmiastowe).

- Wysoką jakość wizualną zbliżoną do rodziny „Pro”, przy niższym zużyciu zasobów/koszcie.

- Lepsze przestrzeganie instrukcji (dokładniejsze odwzorowanie żądanych tematów, tekstu w obrazie oraz scen wielopostaciowych).

- Szeroką obsługę rozdzielczości i proporcji obrazu, od szybkich małych podglądów po natywne potoki 2K/4K dla finalnych zasobów.

Co odróżnia Nano Banana 2 od oryginalnego Nano Banana / Pro?

- Architektura / silnik: Zbudowany na stosie wnioskowania Flash Geminiego (Gemini 3.1 Flash Image), dzięki czemu wymienia część ustawień maksymalnej jakości na znaczące korzyści w zakresie szybkości i kosztów.

- Zastosowania: Idealny do automatyzacji na dużą skalę (zasoby marketingowe, miniatury, interfejsy), edycji niemal w czasie rzeczywistym oraz przepływów, w których liczą się opóźnienia i koszty, ale nadal potrzebna jest wierność na poziomie Pro.

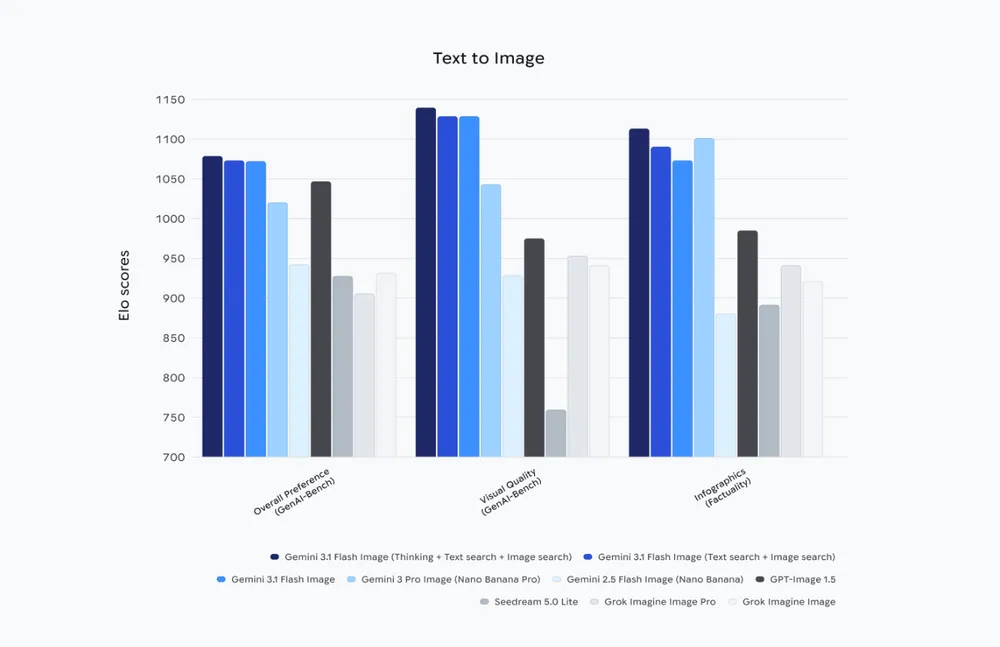

Wydajność w benchmarkach Nano Banana 2

Spójność w różnych kategoriach

Gemini 3.1 Flash Image wykazuje mierzalną poprawę w każdej zgłaszanej kategorii w porównaniu z Gemini 2.5 Flash.

Największe wzrosty

- Jakość wizualna

- Kompozycyjna edycja z wieloma wejściami

- Ogólna odporność edycji

Pozycjonowanie konkurencyjne

- Prowadzi w wewnętrznym GenAI-Bench pod względem ogólnej preferencji.

- Przewyższa GPT-Image 1.5 w metrykach ogólnych i wizualnych.

- Niewielkie, stopniowe ulepszenia sugerują dopracowanie architektury, a nie radykalną zmianę.

Jak mogę uzyskać dostęp do Nano Banana 2?

Gdzie jest dostępny

Nano Banana 2 jest dostępny poprzez narzędzia Gemini od Google (aplikacja Gemini), Gemini API (udokumentowane w materiałach dla deweloperów Google) i jest udostępniany w produktach chmurowych klasy enterprise, takich jak Vertex AI, do wersji preview/integracji korporacyjnych. CometAPI ogłosiło także wsparcie i wrappery ułatwiające integrację.

Jak używać API Nano Banana 2 (cometapi): jakie są opcje?

Przewodnik CometAPI używa struktury w stylu Gemini

generateContenti zwraca obrazy jako Base64 wcandidates[0].content.parts[].inline_data.data. Musisz zdekodować ten Base64, aby zapisać plik po stronie klienta. Wystarczy zastąpićhttps: //generativelanguage.googleapis.comadresemhttps://api.cometapi.com. Zwracany obraz jest zwykle dostarczany jako Base64-encodedinline_data. Trzeba go zdekodować po stronie klienta i zapisać jako plik. CometAPI oferuje zniżki, aby ułatwić korzystanie z API Nano Banana 2.

CometAPI udostępnia ujednolicony wrapper REST i jawne endpointy dla modeli Gemini — idealne, jeśli wolisz jeden zestaw poświadczeń i chcesz zmieniać dostawców bez modyfikacji kodu aplikacji. Dla Nano Banana 2 strona CometAPI zawiera bezpośredni fragment curl dla ich endpointu gemini-3.1-flash-image-preview:generateContent. Poniżej znajduje się oczyszczony przykład curl oparty na dokumentacji CometAPI.

Wymagania wstępne korzystania z Nano Banana 2 przez CometAPI

Konto CometAPI i klucz API: Utwórz konto w CometAPI i wygeneruj klucz dostępu API (sk-…). Ten klucz służy do uwierzytelniania wszystkich żądań API kierowanych do endpointów CometAPI.

Języki programowania i środowiska uruchomieniowe:

- Node.js 18+ (dla JavaScript/TypeScript)

- Python 3.10+

- (lub dowolny język, który potrafi wykonywać żądania HTTP)

Narzędzia HTTP lub SDK:

- Dla JavaScript:

fetch,axioslub klient zgodny z OpenAI - Dla Python:

requests,httpxlub klient OpenAI - Te narzędzia pomagają wysyłać wywołania API i obsługiwać odpowiedzi.

Szybki przegląd schematu żądania

- Base URL:

https://api.cometapi.com(baza CometAPI). - Nazwy modeli:

gemini-3.1-flash-image-preview(Nano Banana 2 / gemini 3.1 Flash Image) lubgemini-2.5-flash-imagezależnie od dostępności. - Uwierzytelnianie:

Authorization: sk-xxxx— CometAPI zwykle używa klucza w stylusk-. - Odpowiedź: obrazy są zwracane jako Base64 pod

response.candidates[0].content.parts[].inline_data.data. Zdekoduj i zapisz na dysku.

Przykładowy przepływ (wysoki poziom)

- Uzyskaj klucz API z CometAPI.

- Wybierz identyfikator modelu (np.

gemini-3.1-flash-imagelub podobny, zależnie od dostępności). - Wyślij żądanie POST do endpointu generowania modelu z Twoim promptem.

- Obsłuż zwrócone dane obrazu w aplikacji (dekoduj base64, serwuj jako PNG itp.).

- Do edycji obrazu dołącz dane istniejącego obrazu oraz instrukcje edycyjne w żądaniu.

Korzystanie z oficjalnego Gemini API (tekst → obraz)

Poniżej krótki przykład w Node.js pokazujący, jak wywołać endpoint generateContent dla gemini-3.1-flash-image-preview (odzwierciedla oficjalne fragmenty w dokumentacji). Zastąp YOUR_API_KEY swoim poświadczeniem i dodaj obsługę błędów w środowisku produkcyjnym.

# Get your CometAPI key from https://api.cometapi.com/console/token

# Export it as: export COMETAPI_KEY="your-key-here"

mkdir -p ./output

curl -s "https://api.cometapi.com/v1beta/models/gemini-3.1-flash-image-preview:generateContent" \

-H "Authorization: $COMETAPI_KEY" \

-H 'Content-Type: application/json' \

-X POST \

-d '{

"contents": [

{

"role": "user",

"parts": [

{

"text": "A woman leaning on a wooden railing of a traditional Chinese building. She is wearing a blue cheongsam with pink and red floral motifs and a headdress made of colorful flowers, including roses and lilacs. Realistic painting style, focusing on the textural details of the clothing patterns and wooden buildings."

}

]

}

],

"generationConfig": {

"responseModalities": ["IMAGE"],

"imageConfig": {

"aspectRatio": "9:16"

}

}

}' | python3 -c "

import sys, json, base64

data = json.load(sys.stdin)

parts = data['candidates'][0]['content']['parts']

for part in parts:

if 'text' in part:

print(part['text'])

elif 'inlineData' in part:

img = base64.b64decode(part['inlineData']['data'])

with open('./output/gemini-3.1-flash-image-preview.png', 'wb') as f:

f.write(img)

print('Image saved to ./output/gemini-3.1-flash-image-preview.png')

"

CometAPI udostępnia SDK i wrappery zgodne z klientem OpenAI, dzięki czemu niektóre zespoły mogą zmieniać dostawcę przy minimalnych zmianach w kodzie; pozwala żądać wyjść obrazów zakodowanych w Base64 lub hostowanych URL w zależności od konfiguracji. Zawsze sprawdzaj oficjalny schemat generateContent pod kątem dokładnych pól payloadu.

Przepływ obraz→obraz (edycja)

Aby edytować istniejący obraz:

- Przekonwertuj obraz źródłowy do Base64 (bez prefiksu

data:image/...;base64,). - Wyślij żądanie POST z payloadem, który zawiera

inline_data.dataz tym ciągiem Base64 oraz prompt edycyjny (np. „zmień tło na zmierzchowe niebo, usuń znak wodny”). - Odpowiedź będzie zawierała nowy wynik Base64 do zdekodowania i zapisania.

curl

--location

--request POST 'https://api.cometapi.com/v1beta/models/gemini-3.1-flash-image-preview:generateContent' \

--header 'Authorization: ' \

--header 'Content-Type: application/json' \

--data-raw '{ "contents":

[ { "role": "user", "parts":

[ { "text": "Blend three images to output a high-resolution image" }, { "inline_data": { "mime_type": "image/jpeg", "data": "<your_first_image_base64_data_here>" } }, { "inline_data": { "mime_type": "image/jpeg", "data": "<your_second_image_base64_data_here>" } }, { "inline_data": { "mime_type": "image/jpeg", "data": "<your_third_image_base64_data_here>" } }

] }

], "generationConfig": { "responseModalities": [ "TEXT", "IMAGE"

] } }'

Typowe parametry do dostrojenia

model: wybierzgemini-3.1-flash-image-preview(Nano Banana 2) lubgemini-3-pro-image-preview(Pro).imageConfig.aspect_ratioiimageConfig.image_size(512,1K,2K,4K) — wpływają na koszt i opóźnienie.responseModalities:["Image"]lub["Text","Image"]dla przepływów multimodalnych.

Jak tworzyć prompty dla Nano Banana 2?

Inżynieria promptów dla modeli obrazowych łączy kompozycję, styl, wskazówki dotyczące kamery/oświetlenia oraz stwierdzenia ograniczeń. Nano Banana 2 jest dostrojony do wiarygodnego podążania za instrukcjami, więc równoważ zwięzłość z jednoznacznością.

Struktura promptu (zalecana)

- Główny temat: kto/co znajduje się na obrazie.

- Akcja lub stan: co robi temat.

- Otoczenie i nastrój: miejsce, oświetlenie, atmosfera.

- Wskazówki techniczne: obiektyw, proporcje, rozdzielczość, kompozycja.

- Styl i odniesienia: styl artystyczny, referencje do twórców (z uwzględnieniem zasad prawa autorskiego), epoka.

- Ograniczenia: liczba postaci/obiektów, unikanie określonych kolorów, zawarcie czytelnego tekstu.

Przykładowy prompt:

„Fotorealistyczny obraz małego żółtego banana w kształcie zabytkowej rakiety, spoczywającego na błyszczącym mahoniowym stole w nasłonecznionym studio. Obiektyw 50 mm, płytka głębia ostrości, ciepłe światło złotej godziny, wysoki poziom detali, bez widocznych logo, 2048×1152.”

Wskazówki do promptów edycyjnych (inpainting / podmiana)

- Podaj maskę w sposób jednoznaczny i określ, które obszary mają się zmienić.

- Używaj sformułowań „zachowaj” dla obszarów do utrzymania (np. „zachowaj rysy twarzy postaci, podmień tylko tło”).

- Dla tekstu w obrazie podaj dokładny tekst oraz określ czcionkę/styl (np. „czytelny sans-serif, wyśrodkowany”). Nano Banana 2 kładzie nacisk na lepsze renderowanie tekstu, ale bądź precyzyjny.

Lista kontrolna debugowania promptów

- Jeśli wynik odbiega od oczekiwań: spróbuj uprościć — najpierw ogranicz wskazówki dotyczące stylu, następnie ponownie wprowadzaj szczegóły.

- Jeśli tekst jest nieczytelny: określ czcionkę, rozmiar i kontrast w promptcie oraz zwiększ rozdzielczość.

- Jeśli kompozycja jest nieprawidłowa: użyj określeń kąta kamery i parametrów obiektywu.

Jakie są typowe pułapki i jak ich unikać?

Pułapka: Zbytnie poleganie na promptach jednorazowych

Nie oczekuj, że pojedynczy prompt załatwi kadrowanie, layout i wieloetapowe edycje. Podziel pracę na: wygeneruj bazę → edytuj/podmień → finalne dopracowanie. Używaj ziarna i masek dla precyzji.

Pułapka: Ignorowanie pochodzenia i kontroli praw autorskich

Nie wdrażaj na dużą skalę bez SynthID/C2PA lub innego mechanizmu pochodzenia. Wiele firm wymaga śledzenia pochodzenia treści generowanych przez AI.

Pułapka: Niespodzianki budżetowe

Monitoruj wykorzystanie na poziomie modelu i endpointu oraz ustaw twarde limity użycia przez dostawcę lub proxy. Warianty Flash są tańsze, ale nadal mogą generować duże koszty, jeśli niezamierzenie renderujesz tysiące obrazów 4K.

Zalecane najlepsze praktyki z Nano Banana 2?

Uprodukcyjnienie generowania obrazów wymaga uwagi względem kosztów, opóźnień, kontroli jakości, pochodzenia i bezpieczeństwa. Poniżej praktyczne najlepsze praktyki wyodrębnione z raportów terenowych, dokumentów Google i testów społeczności.

Inżynieria promptów i deterministyczne wyjścia

- Szablonuj prompty: dla powtarzalnych wyników (np. zdjęcia produktów) używaj strukturalnych promptów z ustalonymi segmentami (temat, kamera, oświetlenie, faktura, postprocess). To zmniejsza dryf między wywołaniami.

- Używaj obrazów referencyjnych i instrukcji masek do edycji zamiast prób osiągania złożonych lokalnych zmian czystym tekstem — zmniejsza to błędy semantyczne i artefakty.

Strojenie kosztów i wydajności

- Wybierz tryb Flash/„Nano Banana 2” dla dużej wolumenowości: jeśli potrzebujesz wielu szybkich iteracji, używaj modeli z poziomu Flash i mniejszych rozmiarów (2K vs 4K), aby ograniczyć koszty i opóźnienia.

- Grupuj żądania, gdzie to możliwe: niektórzy dostawcy pozwalają na batchowanie wielu promptów — zmniejsza to całkowite opóźnienie na wygenerowany zasób w potokach o dużej przepustowości. (Sprawdź dokumentację swojego dostawcy.)

Bezpieczeństwo, pochodzenie i kwestie prawne

- Włącz metadane SynthID i C2PA w generowanych zasobach, aby wspierać audyt i zgodność w dalszych etapach (szczególnie gdy obrazy są używane w reklamie/PR). Google i partnerzy akcentują SynthID jako mechanizm pochodzenia.

- Recenzja z udziałem człowieka dla treści wrażliwych: automatyczne warstwy polityk są mocne, ale nieidealne — używaj ręcznych kontroli dla kampanii publicznych lub treści obejmujących osoby publiczne.

Zapewnienie jakości

- Automatyzuj kontrole QA: uruchom szybki klasyfikator post-generacyjny pod kątem nieoczekiwanych artefaktów (błędne renderowanie tekstu, niska wierność twarzy, przypadkowe tworzenie logo). Utrzymuj system punktacji i awaryjne przejście na rendery z poziomu Pro, jeśli kontrola automatyczna nie powiedzie się.

- Przechowuj prompty i ziarna: dla audytowalności i odtwarzalności zapisuj dokładny prompt, znacznik czasu, wersję modelu oraz każde użyte ziarno czy parametr deterministyczny.

UX wrażliwy na opóźnienia

- Postępujący UX: zwracaj najpierw niską rozdzielczość/szybki szkic, a następnie podmieniaj na render wysokiej rozdzielczości/Pro, gdy będzie gotowy. Utrzymuje to responsywność aplikacji (wielu dostawców oferuje „draft” lub wersję Flash).

Uwagi końcowe i kolejne kroki

Nano Banana 2 powstał, by zmienić ekonomię produkcyjnych przepływów nastawionych na obraz: niższe opóźnienia i niższy koszt na wywołanie otwierają przypadki użycia takie jak generowanie zasobów reklamowych na żądanie, szybkie testy A/B kreacji oraz narzędzia do współprojektowania w czasie rzeczywistym. Model jest już zintegrowany w konsumenckich i chmurowych powierzchniach Google; dla deweloperów chcących szybko wdrożyć, CometAPI oferuje wygodny wrapper marketplace wspierający endpointy obrazowe Gemini oraz inne modele — praktyczne rozwiązanie, gdy chcesz eksperymentować z wieloma silnikami bez zmiany kodu aplikacji.

Programiści mogą uzyskać dostęp do Nano Banana 2 poprzez CometAPI już teraz. Aby zacząć, poznaj możliwości modelu w Playground i zapoznaj się z przewodnikiem API po szczegółowe instrukcje. Przed uzyskaniem dostępu upewnij się, że zalogowano się do CometAPI i pozyskano klucz API. CometAPI oferuje cenę znacznie niższą niż oficjalna, aby ułatwić integrację.

Gotowy do startu?→ Zarejestruj się w Nano Banana 2 już dziś !

Jeśli chcesz poznać więcej wskazówek, poradników i nowości o AI, obserwuj nas na VK, X i Discord!