Kling 2.1 oznacza znaczący krok naprzód w szybko rozwijającej się dziedzinie generowania wideo opartego na sztucznej inteligencji. Wprowadzony w maju 2025 r. przez dział badań nad sztuczną inteligencją Kuaishou, Kling 2.1 bazuje na sukcesie swoich poprzedników (Kling 1.6 i 2.0), aby dostarczać treści wideo klasy kinowej z tekstów i obrazów. W tym artykule omówiono „Czym jest Kling 2.1” za pomocą serii ustrukturyzowanych pytań, zagłębiając się w jego podstawowe możliwości, postępy w stosunku do poprzednich wersji, praktyczne metody dostępu, przykłady użycia i perspektywy na przyszłość.

Czym jest Kling 2.1?

Definicja rdzenia

Kling 2.1 to najnowocześniejszy, oparty na sztucznej inteligencji model generowania wideo, który przekształca opisy tekstowe i obrazy referencyjne w filmy o wysokiej rozdzielczości i jakości filmowej. W przeciwieństwie do wielu czystych systemów tekst-wideo, wykorzystuje on zarówno multimodalne dane wejściowe — obrazy i tekst — do kierowania generacją, zapewniając precyzyjne przestrzeganie kontekstu wizualnego i intencji użytkownika. Jego szkolenie na petabajtach zróżnicowanych danych wideo stanowi podstawę jego solidnej wydajności w zakresie spójności klatek, realizmu ruchu i spójności scen.

Kluczowe innowacje

Kilka przełomowych rozwiązań technicznych wyróżnia Kling 2.1 na tle poprzednich wersji:

- 3D Przestrzenno-Czasowa Uwaga:Umożliwia modelowi zrozumienie dynamiki obiektu i kamery w trzech wymiarach, zapewniając fizycznie wiarygodny ruch i płynne przejścia czasowe.

- Architektura transformatora dyfuzyjnego:Integruje procesy dyfuzji z uwagą opartą na transformatorach, równoważąc kreatywną zmienność z szybką wiernością.

- Renderowanie na poziomie mistrzowskim:Ekskluzywna wersja „Master” oferuje kinowe efekty wizualne — dramatyczne oświetlenie, złożone ruchy kamery i bogate sekwencje animacji.

Czym Kling 2.1 różni się od poprzednich wersji?

Ulepszenia sterowania ruchem

Jedną z najbardziej zauważalnych ulepszeń jest dynamika ruchu. Udoskonalone algorytmy sterowania Kling 2.1 pozwalają twórcom określać skomplikowane ruchy kamery — panoramy, zoomy i dolly — z niespotykaną dotąd precyzją. To bezpośrednio rozwiązuje problemy z „dryfowaniem postaci” widoczne we wcześniejszych modelach, zapewniając, że obiekty na ekranie pozostają stabilne i przewidywalne w całym filmie.

Ulepszenia spójności i jakości

Spójność czasowa — utrzymywanie szczegółów jednolitych w klatkach — od dawna stanowi wyzwanie dla modeli wideo AI. Kling 2.1 osiąga niemal idealną spójność klatka po klatce, eliminując migotanie i artefakty, które mogą rozpraszać widzów. Szybkość renderowania również znacznie się poprawiła: użytkownicy zgłaszają, że 30-sekundowe klipy podglądu są generowane w czasie krótszym niż trzy minuty, w porównaniu do ponad pięciu minut w Kling 2.0.

Benchmarki wskazują, że Kling 2.1 może renderować klip 1080p, 30 FPS w czasie krótszym niż jedna minuta — prawie o 30% szybciej niż Kling 2.0 — jednocześnie zmniejszając koszt za sekundę wideo nawet o 65% w warstwie Master (). To połączenie szybkości, wierności i przystępności cenowej pozycjonuje Kling 2.1 jako mocnego konkurenta zarówno dla profesjonalnych studiów, jak i niezależnych twórców.

Dlaczego twórcy powinni wybrać Kling 2.1?

Przypadków użycia

Kling 2.1 jest przeznaczony dla szerokiego spektrum twórców:

- Twórcy filmów i animatorzy:Szybkie prototypowanie koncepcji scen z kierunkami działania kamery.

- Marketingowcy i reklamodawcy:Generowanie filmów demonstracyjnych produktów z dynamicznymi ujęciami i realistycznym oświetleniem.

- Wpływ na media społecznościowe:Przykuwające uwagę krótkie klipy, które wyróżniają się na platformach takich jak TikTok i Instagram.

Przewagi konkurencyjne

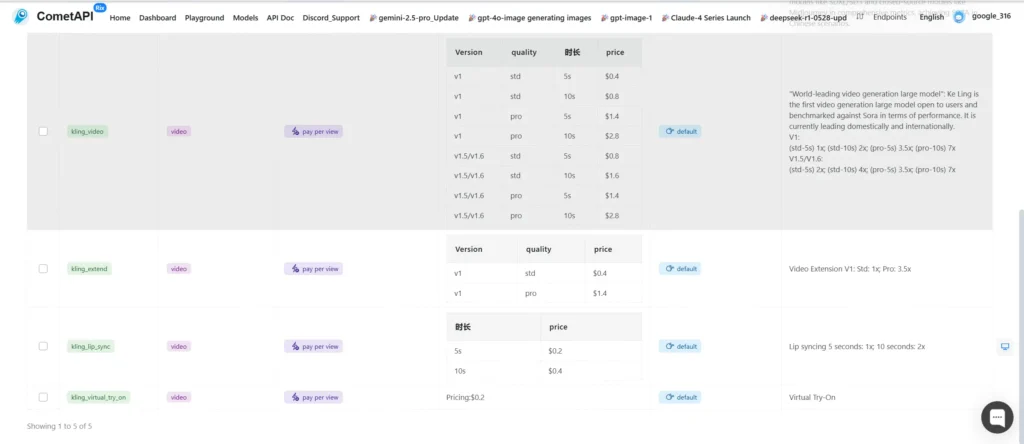

W porównaniu do konkurencyjnych platform (np. Google Veo 3, OpenAI's Sora, Flow AI), Kling 2.1 często dorównuje lub przewyższa pod względem wierności wizualnej i przyjaznych dla użytkownika elementów sterujących. Jego trzypoziomowa hierarchia modeli — Standard (720p), High-Quality (1080p) i Master (1080p kinowy) — zaspokaja zróżnicowane budżety i potrzeby jakościowe, oferując bardziej dostępny punkt wejścia dla niezależnych twórców. Wcześni testerzy zauważają, że filmy w trybie Standard kosztują tylko 20 „punktów inspiracji” (~0.20 USD), co stanowi 65% obniżkę w porównaniu z poprzednią ceną Master-only.

Jak uzyskać dostęp do Kling 2.1?

Rejestracja i ceny

Dostęp do Kling 2.1 jest możliwy za pośrednictwem oficjalnej strony internetowej Kling AI i aplikacji mobilnych. Globalni użytkownicy rejestrują się za pomocą adresu e-mail, aby otrzymywać bezpłatne „punkty inspiracji” na wersje próbne. Poziomy cenowe są następujące:

- Standardowy (720p):20 punktów za każdy 5-sekundowy klip

- Wysoka jakość (1080p):35 punktów za każdy 5-sekundowy klip

- Master (filmowy 1080p):100 punktów za każdy 5-sekundowy klip

Dostępność API i platformy

Oprócz interfejsów użytkownika w sieci Web i na urządzeniach mobilnych Kling 2.1 oferuje interfejs API RESTful, umożliwiający bezproblemową integrację z przepływami pracy innych firm. Programiści mogą programowo przesyłać monity obrazu/tekstu, ustawiać parametry renderowania (rozdzielczość, liczbę klatek na sekundę, ruch kamery) i pobierać ostateczne zasoby wideo — wszystko w ramach umów SLA klasy korporacyjnej.

Jak korzystać z Kling 2.1?

Pierwsze kroki: przewodnik krok po kroku

- Utwórz konto: Zarejestruj się na platformie Kling AI, podając swój adres e-mail, aby otrzymać początkowy kredyt na testy.

- Wybierz tryb wprowadzania: Wybierz opcję „Tekst + Obraz” lub „Tylko Tekst”. W przypadku korzystania z obrazów należy przesłać ramkę odniesienia (JPEG/PNG, maks. 10 MB, min. 300 × 300 px).

- Skonfiguruj parametry: Określ rozdzielczość (720p/1080p), liczbę klatek na sekundę (do 30 FPS), długość filmu (maks. 10 s) i polecenia kamery („wolne przesunięcie w lewo”, „dolly in”).

- Prześlij i renderuj: Kliknij „Generuj”. Obserwuj pasek postępu, gdy Kling 2.1 przetwarza żądanie — typowy czas renderowania wynosi od 2 do 5 minut.

- Przejrzyj i pobierz: Obejrzyj klip, dostosuj monity i parametry według potrzeb, a następnie pobierz końcowy plik MP4 lub udostępnij go bezpośrednio za pomocą linków społecznościowych.

Przykład: Z obrazu do wideo

Wyobraź sobie, że masz nieruchomą fotografię zabytkowego samochodu zaparkowanego nocą pod neonowymi światłami. Aby animować tę scenę:

- Prześlij zdjęcie: Wybierz obraz samochodu jako układ odniesienia.

- Wprowadź monit tekstowy: „Kamera powoli przybliża chromowany zderzak samochodu, w którego reflektorach odbijają się neony, a lekka mgiełka przesuwa się po chodniku”.

- Ustaw na tryb główny: Wybierz rozdzielczość Master 1080p, aby uzyskać oświetlenie kinowe i płynność ruchu.

- Wygeneruj :Po 4-minutowym renderowaniu otrzymasz 7-sekundowy klip prezentujący realistyczną dynamikę mgły, dokładne odbicia i płynny ruch kamery — wszystko ściśle zgodne z Twoim poleceniem.

Łącząc zaawansowane multimodalne architektury AI z zorientowanymi na użytkownika modelami cenowymi i dostępu, Kling 2.1 umożliwia twórcom na wszystkich poziomach produkcję profesjonalnych filmów w jakości Hollywood z niespotykaną łatwością i opłacalnością. Niezależnie od tego, czy jesteś niezależnym animatorem, profesjonalistą ds. marketingu czy influencerem w mediach społecznościowych, Kling 2.1 oferuje narzędzia, które pozwolą Ci przekształcić Twoją wizję w żywy ruch — już dziś.

Jak zacząć

CometAPI zapewnia ujednolicony interfejs REST, który agreguje setki modeli AI — w tym rodzinę ChatGPT — w ramach spójnego punktu końcowego, z wbudowanym zarządzaniem kluczami API, limitami wykorzystania i panelami rozliczeniowymi. Zamiast żonglować wieloma adresami URL dostawców i poświadczeniami.

Na początek zapoznaj się z możliwościami modeli w Plac zabaw i zapoznaj się z Przewodnik po API aby uzyskać szczegółowe instrukcje. Przed uzyskaniem dostępu upewnij się, że zalogowałeś się do CometAPI i uzyskałeś klucz API.

Najnowsza integracja Kling 2.1 API wkrótce pojawi się w CometAPI, więc bądźcie czujni! Podczas gdy finalizujemy przesyłanie modelu Kling 2.1, zapoznajcie się z naszymi innymi modelami na Strona modeli lub wypróbuj je w Plac zabaw AINajnowszy model Klinga w CometAPI to Kling v1.6(Kling 1.6 Standardowy interfejs API)zapoznaj się z przewodnikiem: