Czym jest API GPT-5.2

API GPT-5.2 jest tym samym co GPT-5.2 Thinking w ChatGPT. GPT-5.2 Thinking to wariant średniego poziomu w rodzinie GPT-5.2 firmy OpenAI zaprojektowany do głębszej pracy: wieloetapowego rozumowania, streszczania długich dokumentów, wysokiej jakości generowania kodu oraz profesjonalnych zadań opartych na wiedzy, w których dokładność i użyteczna struktura są ważniejsze niż surowa przepustowość. W API występuje jako model gpt-5.2 (Responses API / Chat Completions) i plasuje się pomiędzy niskolatencyjnym wariantem Instant a wariantem Pro o wyższej jakości, lecz droższym.

Główne funkcje

- Bardzo długi kontekst i kompaktowanie: efektywne okno 400K oraz narzędzia do kompaktowania, które zarządzają relewancją w długich konwersacjach i dokumentach.

- Konfigurowalny nakład rozumowania:

none | medium | high | xhigh(xhigh włącza maksymalny wewnętrzny nakład obliczeń dla trudnego rozumowania).xhighjest dostępny w wariantach Thinking/Pro. - Silniejsze wsparcie narzędzi i funkcji: wywoływanie narzędzi jako element pierwszej klasy, gramatyki (CFG/Lark) ograniczające wyjścia do ściśle zdefiniowanej struktury oraz ulepszone zachowania agentowe, które upraszczają złożoną wieloetapową automatyzację.

- Zrozumienie multimodalne: bogatsze rozumienie obrazu + tekstu oraz integracja w wieloetapowych zadaniach.

- Ulepszone bezpieczeństwo/obsługa treści wrażliwych: ukierunkowane interwencje zmniejszające ryzyko niepożądanych odpowiedzi w obszarach takich jak samouszkodzenia i inne wrażliwe konteksty.

Zdolności techniczne i specyfikacje (perspektywa dewelopera)

- Punkty końcowe API i identyfikatory modeli:

gpt-5.2dla Thinking (Responses API),gpt-5.2-chat-latestdla przepływów czatu/instant orazgpt-5.2-prodla poziomu Pro; dostępne poprzez Responses API i Chat Completions tam, gdzie wskazano. - Tokeny rozumowania i zarządzanie nakładem: API obsługuje jawne parametry przydzielania nakładu obliczeniowego (reasoning effort) na żądanie; wyższy nakład zwiększa opóźnienie i koszt, ale poprawia jakość wyników dla złożonych zadań.

- Narzędzia wyjścia o ustrukturyzowanej formie: obsługa gramatyk (Lark / CFG) ograniczających wyjścia modelu do DSL lub dokładnej składni (przydatne dla SQL, JSON, generowania DSL).

- Równoległe wywoływanie narzędzi i koordynacja agentowa: ulepszony paralelizm i czystsza orkiestracja narzędzi ograniczają potrzebę rozbudowanych promptów systemowych i wieloagentowego szkieletu.

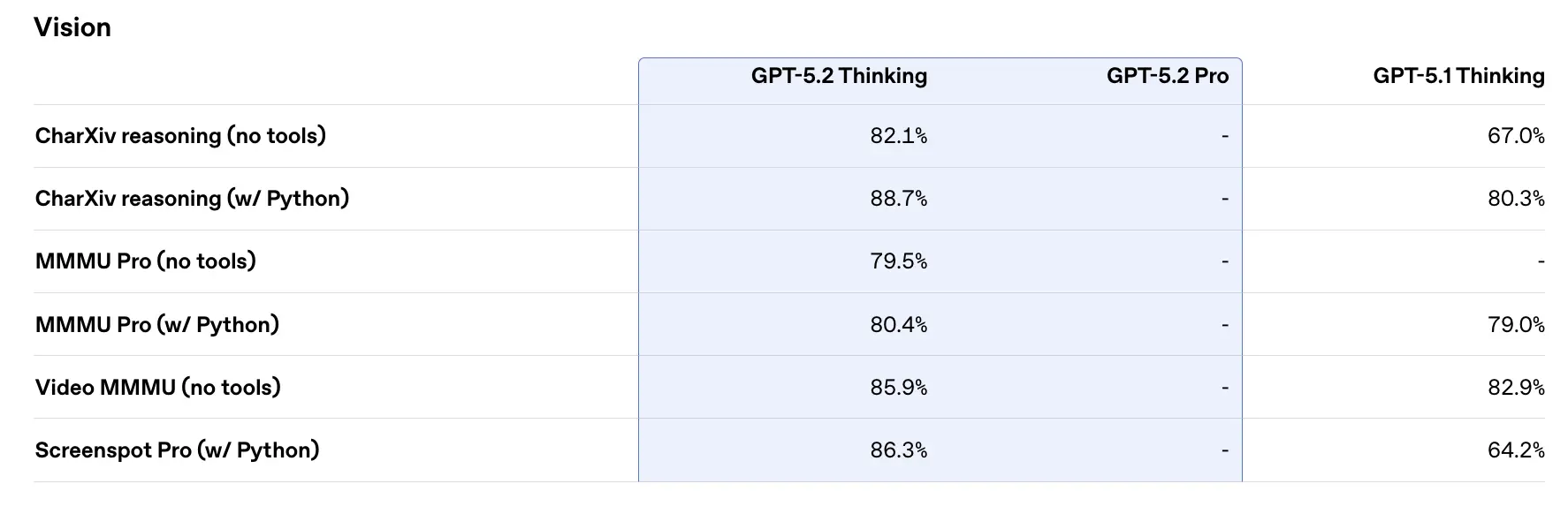

Wyniki benchmarków i dane wspierające

OpenAI opublikowało szereg wewnętrznych i zewnętrznych wyników benchmarków dla GPT-5.2. Wybrane najważniejsze (liczby raportowane przez OpenAI):

- GDPval (44 zawody, praca wiedzochłonna) — GPT-5.2 Thinking „pokonuje lub dorównuje czołowym specjalistom z branży w 70.9% porównań”; OpenAI podaje, że wyniki powstawały >11× szybciej i przy <1% kosztu względem ekspertów na zadaniach GDPval (szacunki prędkości i kosztów oparte na danych historycznych). Te zadania obejmują modele arkuszy, prezentacje i krótkie wideo.

- SWE-Bench Pro (kodowanie) — GPT-5.2 Thinking osiąga ≈55.6% na SWE-Bench Pro i ~80% na SWE-Bench Verified (tylko Python) wg OpenAI, ustanawiając nowy stan sztuki dla generowania kodu/oceny inżynierskiej w ich testach. Według przykładów OpenAI przekłada się to w praktyce na bardziej niezawodne debugowanie i poprawki end-to-end.

- GPQA Diamond (pytania i odpowiedzi na poziomie magisterskim w naukach ścisłych) — GPT-5.2 Pro: 93.2%, GPT-5.2 Thinking: 92.4% na GPQA Diamond (bez narzędzi, maksymalne rozumowanie).

- Seria ARC-AGI — Na ARC-AGI-2 (trudniejszym benchmarku płynnego rozumowania), GPT-5.2 Thinking uzyskał 52.9%, a GPT-5.2 Pro 54.2% (OpenAI twierdzi, że to nowe rekordy SOTA dla modeli w stylu chain-of-thought).

- Długi kontekst (OpenAI MRCRv2) — GPT-5.2 Thinking wykazuje niemal 100% dokładności na wariancie MRCR 4-needle do 256k tokenów oraz istotnie lepsze wyniki względem GPT-5.1 w ustawieniach długiego kontekstu. (OpenAI opublikowało wykresy i tabele MRCRv2.)

Porównanie z konkurentami

- vs Google Gemini 3 (Gemini 3 Pro / Deep Think): Gemini 3 Pro jest promowany z ~1,048,576 (≈1M) tokenowym oknem kontekstu, szerokimi wejściami multimodalnymi (tekst, obraz, audio, wideo, PDF-y) oraz silną integracją agentową poprzez Vertex AI / AI Studio. Na papierze większe okno kontekstu Gemini 3 wyróżnia go w ekstremalnie dużych, jednosesyjnych obciążeniach; kompromisy obejmują powierzchnię narzędziową i dopasowanie do ekosystemu.

- vs Anthropic Claude Opus 4.5: Opus 4.5 kładzie nacisk na firmowe przepływy kodowania/agentów i raportuje mocne wyniki SWE-bench oraz odporność w długich sesjach agentowych; Anthropic pozycjonuje Opus pod automatyzację i generowanie kodu z oknem kontekstu 200k oraz specjalizowanymi integracjami agent/Excel. Opus 4.5 to silny konkurent w automatyzacji korporacyjnej i zadaniach kodowych.

Wniosek praktyczny: GPT-5.2 celuje w zbalansowany zestaw usprawnień (kontekst 400k, wysokie limity tokenów wyjściowych, ulepszone rozumowanie/kodowanie). Gemini 3 celuje w absolutnie największe konteksty pojedynczej sesji (≈1M), podczas gdy Claude Opus skupia się na inżynierii korporacyjnej i odporności agentowej. Wybieraj, dopasowując rozmiar kontekstu, potrzeby modalności, dopasowanie funkcji/narzędzi oraz kompromisy koszt/opóźnienie.

Jak uzyskać dostęp i korzystać z API GPT-5.2

Krok 1: Zarejestruj klucz API

Zaloguj się do cometapi.com. Jeśli nie jesteś jeszcze naszym użytkownikiem, zarejestruj się najpierw. Zaloguj się do konsoli CometAPI. Uzyskaj poświadczenie dostępu — klucz API interfejsu. Kliknij „Add Token” w tokenie API w centrum osobistym, pobierz klucz tokenu: sk-xxxxx i zatwierdź.

Krok 2: Wyślij żądania do API GPT-5.2

Wybierz punkt końcowy “gpt-5.2”, aby wysłać żądanie do API i ustaw ciało żądania. Metodę i ciało żądania znajdziesz w dokumentacji API na naszej stronie. Nasza strona udostępnia także test w Apifox dla Twojej wygody. Zamień <YOUR_API_KEY> na swój rzeczywisty klucz CometAPI z konta. Deweloperzy wywołują to poprzez Responses API / punkty końcowe Chat.

Wstaw swoje pytanie lub prośbę do pola content — na to model odpowie . Przetwórz odpowiedź API, aby uzyskać wygenerowaną odpowiedź.

Krok 3: Pobierz i zweryfikuj wyniki

Przetwórz odpowiedź API, aby uzyskać wygenerowany wynik. Po przetworzeniu API zwróci status zadania i dane wyjściowe.

Zobacz także Gemini 3 Pro Preview API