GLM-4.6 to najnowsze główne wydanie w rodzinie GLM firmy Z.ai (wcześniej Zhipu AI): czwartej generacji duży model językowy typu MoE (Mixture-of-Experts) dostrojony pod agentowe przepływy pracy, wnioskowanie na długim kontekście i programowanie w realnych warunkach. Wydanie akcentuje praktyczną integrację agentów/narzędzi, bardzo duże okno kontekstowe oraz dostępność otwartych wag do lokalnego wdrażania.

Kluczowe funkcje

- Długi kontekst — natywne okno kontekstowe 200K tokenów (rozszerzone ze 128K). (docs.z.ai)

- Zdolności programistyczne i agentowe — promowane usprawnienia w realnych zadaniach programistycznych oraz lepsze wywoływanie narzędzi przez agentów.

- Wydajność — zgłaszane ~30% niższe zużycie tokenów vs GLM-4.5 w testach Z.ai.

- Wdrożenie i kwantyzacja — po raz pierwszy ogłoszona integracja FP8 i Int4 dla układów Cambricon; natywne wsparcie FP8 na Moore Threads przez vLLM.

- Rozmiar modelu i typ tensora — opublikowane artefakty wskazują na model o ~357B parametrów (tensory BF16 / F32) na Hugging Face.

Szczegóły techniczne

Modalności i formaty. GLM-4.6 jest wyłącznie tekstowym LLM (modalności wejścia i wyjścia: tekst). Długość kontekstu = 200K tokenów; maksymalny wynik = 128K tokenów.

Kwantyzacja i wsparcie sprzętowe. Zespół zgłasza kwantyzację FP8/Int4 na układach Cambricon oraz natywne FP8 na GPU Moore Threads z użyciem vLLM do wnioskowania — istotne dla obniżenia kosztów wnioskowania i umożliwienia wdrożeń on-prem oraz w krajowych chmurach.

Narzędzia i integracje. GLM-4.6 jest dystrybuowany przez API Z.ai, sieci dostawców zewnętrznych (np. CometAPI) oraz zintegrowany z agentami programistycznymi (Claude Code, Cline, Roo Code, Kilo Code).

Szczegóły techniczne

Modalności i formaty. GLM-4.6 jest wyłącznie tekstowym LLM (modalności wejścia i wyjścia: tekst). Długość kontekstu = 200K tokenów; maksymalny wynik = 128K tokenów.

Kwantyzacja i wsparcie sprzętowe. Zespół zgłasza kwantyzację FP8/Int4 na układach Cambricon oraz natywne FP8 na GPU Moore Threads z użyciem vLLM do wnioskowania — istotne dla obniżenia kosztów wnioskowania i umożliwienia wdrożeń on-prem oraz w krajowych chmurach.

Narzędzia i integracje. GLM-4.6 jest dystrybuowany przez API Z.ai, sieci dostawców zewnętrznych (np. CometAPI) oraz zintegrowany z agentami programistycznymi (Claude Code, Cline, Roo Code, Kilo Code).

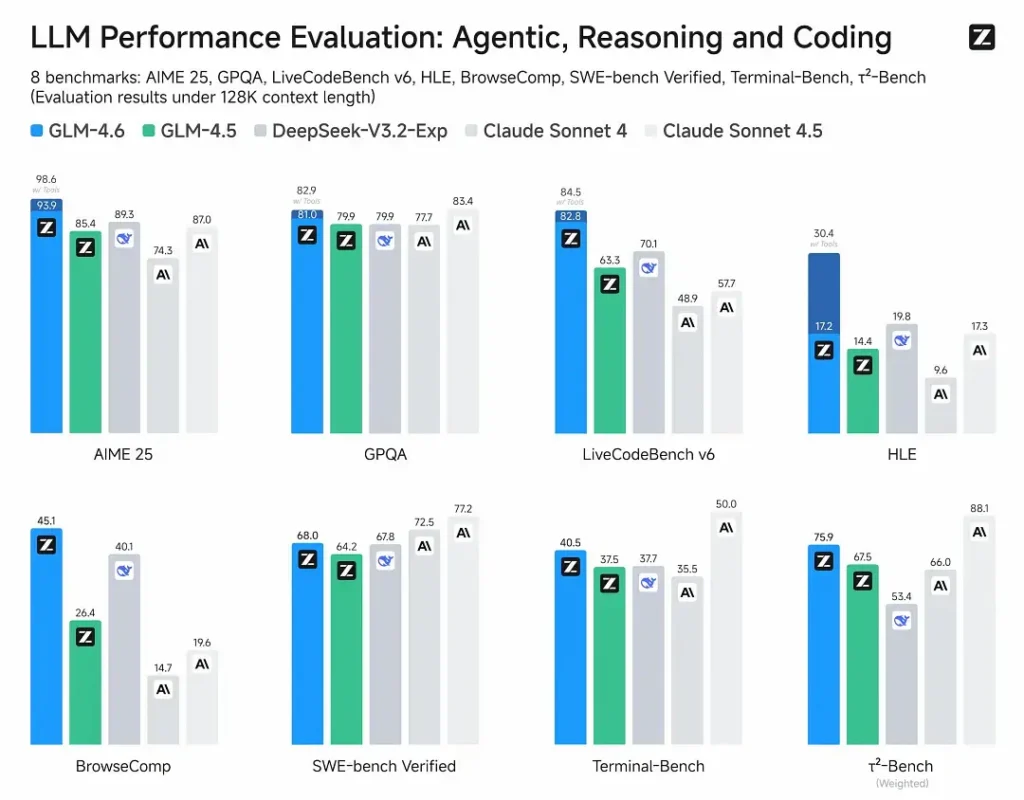

Wyniki benchmarków

- Opublikowane ewaluacje: GLM-4.6 został przetestowany na ośmiu publicznych benchmarkach obejmujących agentów, wnioskowanie i programowanie i wykazuje wyraźne zyski względem GLM-4.5. W ocenianych przez ludzi, rzeczywistych testach programistycznych (rozszerzony CC-Bench), GLM-4.6 używa ~15% mniej tokenów vs GLM-4.5 i osiąga ~48.6% wskaźnik wygranych względem Claude Sonnet 4 firmy Anthropic (niemal parytet na wielu listach wyników).

- Pozycjonowanie: wyniki wskazują, że GLM-4.6 jest konkurencyjny względem czołowych modeli krajowych i międzynarodowych (przykłady obejmują DeepSeek-V3.1 i Claude Sonnet 4).

Ograniczenia i ryzyka

- Halucynacje i błędy: jak wszystkie obecne LLM, GLM-4.6 może popełniać błędy faktograficzne — dokumentacja Z.ai wyraźnie ostrzega, że wyniki mogą zawierać pomyłki. Użytkownicy powinni stosować weryfikację i retrieval/RAG dla treści krytycznych.

- Złożoność modelu i koszt obsługi: kontekst 200K i bardzo duże wyniki znacząco zwiększają wymagania dotyczące pamięci i opóźnień oraz mogą podnieść koszty wnioskowania; aby działać na skalę, wymagana jest kwantyzacja/inżynieria wnioskowania.

- Luki domenowe: mimo że GLM-4.6 raportuje mocną wydajność agentową/programistyczną, niektóre publiczne raporty wskazują, że nadal ustępuje pewnym wersjom modeli konkurencyjnych w określonych mikrobenchmarkach (np. niektórym metrykom programistycznym względem Sonnet 4.5). Oceń na poziomie zadania przed zastąpieniem modeli produkcyjnych.

- Bezpieczeństwo i polityki: otwarte wagi zwiększają dostępność, ale rodzą też pytania o nadzór (mitigacje, guardrails i red-teaming pozostają odpowiedzialnością użytkownika).

Zastosowania

- Systemy agentowe i orkiestracja narzędzi: długie ślady agentów, planowanie z wieloma narzędziami, dynamiczne wywoływanie narzędzi; strojenie agentowe modelu jest kluczową zaletą.

- Asystenci programistyczni do realnych zastosowań: wieloturowa generacja kodu, przeglądy kodu i interaktywni asystenci IDE (zintegrowani w Claude Code, Cline, Roo Code — wg Z.ai). Usprawnienia efektywności tokenowej czynią go atrakcyjnym dla planów deweloperskich o dużym użyciu.

- Przepływy pracy z długimi dokumentami: streszczanie, synteza wielodokumentowa, długie przeglądy prawne/techniczne dzięki oknu kontekstowemu 200K.

- Tworzenie treści i postacie wirtualne: wydłużone dialogi, spójne utrzymanie persony w scenariuszach wieloturowych.

Jak GLM-4.6 wypada na tle innych modeli

- GLM-4.5 → GLM-4.6: skokowa zmiana rozmiaru kontekstu (128K → 200K) i efektywności tokenowej (~15% mniej tokenów na CC-Bench); ulepszone użycie agentów/narzędzi.

- GLM-4.6 vs Claude Sonnet 4 / Sonnet 4.5: Z.ai raportuje niemal parytet na kilku listach wyników oraz ~48.6% wskaźnik wygranych na rzeczywistych zadaniach programistycznych CC-Bench (bliska konkurencja, z niektórymi mikrobenchmarkami, w których Sonnet nadal prowadzi). Dla wielu zespołów inżynieryjnych GLM-4.6 pozycjonowany jest jako opłacalna alternatywa.

- GLM-4.6 vs inne modele długiego kontekstu (DeepSeek, warianty Gemini, rodzina GPT-4): GLM-4.6 akcentuje duży kontekst i agentowe przepływy pracy programistyczne; względne mocne strony zależą od metryki (efektywność tokenów/integracja agentów vs czysta dokładność syntezy kodu lub mechanizmy bezpieczeństwa). Wybór empiryczny powinien być zadaniowy.

Zhipu AI’s latest flagship model GLM-4.6 released: 355B total params, 32B active. Surpasses GLM-4.5 in all core capabilities.

- Programowanie: Porównywalny z Claude Sonnet 4, najlepszy w Chinach.

- Kontekst: Rozszerzony do 200K (z 128K).

- Wnioskowanie: Ulepszone, wspiera wywoływanie narzędzi podczas wnioskowania.

- Wyszukiwanie: Ulepszone wywoływanie narzędzi i wydajność agentów.

- Pisanie: Lepiej dostosowane do ludzkich preferencji w zakresie stylu, czytelności i odgrywania ról.

- Wielojęzyczność: Wzmocnione tłumaczenie międzyjęzykowe.