Integracja CometAPI z n8n pozwala zasilić Twoje automatyzacje najnowocześniejszymi modelami AI na świecie w zaledwie trzech krokach. Korzystając z jednego poświadczenia kompatybilnego z OpenAI, zyskujesz natychmiastowy dostęp do ponad 500 modeli, w tym GPT 5.5, Claude Opus 4.7 i DeepSeek V4 Pro. Ta konfiguracja jest identyczna zarówno dla chmurowych, jak i samodzielnie hostowanych instancji n8n, zapewniając stabilną, wysoce dostępną podstawę dla automatyzacji przepływów pracy AI w n8n.

Czym jest n8n i dlaczego to ma znaczenie

n8n to narzędzie open source do automatyzacji przepływów pracy. Pozwala łączyć różne aplikacje, usługi i API, aby automatyzować zadania — bez potrzeby pisania dużej ilości kodu.

Co potrafi

Pomyśl o n8n jako o wizualnym sposobie budowania automatyzacji:

- Tworzysz przepływy pracy w edytorze typu „przeciągnij i upuść”

- Każdy krok (nazywany węzłem) wykonuje działanie

- Dane przepływają automatycznie z jednego kroku do następnego

Kluczowe funkcje

- Open source (możesz hostować samodzielnie)

- Obsługuje setki integracji (API, aplikacje, bazy danych)

- Umożliwia własną logikę JavaScript wewnątrz przepływów

- Może działać na Twoim własnym serwerze lub w chmurze na oficjalnej stronie n8n

Dlaczego połączyć n8n z CometAPI

Użycie CometAPI jako centralnej bramki w n8n zapewnia znaczące korzyści operacyjne. Zastępując oddzielne klucze do OpenAI, Anthropic i Google jednym poświadczeniem, Twój zespół eliminuje narzut związany z obsługą wielu kont dostawców i złożonych cykli rozliczeń. Taka architektura zapewnia brak uzależnienia od jednego dostawcy; możesz przełączać się między najnowszymi modelami od różnych dostawców, po prostu aktualizując nazwę modelu w ustawieniach węzła, dzięki czemu Twoje przepływy pozostają zwinne, gdy krajobraz AI ewoluuje.

CometAPI to zunifikowane REST API agregujące 500+ modeli do czatu, obrazów, wideo, audio (TTS/STT) i embeddingów. Kluczowe korzyści obejmują:

- Kompatybilny z OpenAI endpoint (

https://api.cometapi.com/v1): Bezpośrednie zastępstwo węzłów OpenAI lub żądań HTTP. - O 20–40% niższe ceny niż bezpośrednio u dostawców, model rozliczeń pay‑as‑you‑go, bez miesięcznych opłat za podstawy i ujednolicone fakturowanie.

- Brak uzależnienia od dostawcy: Zmieniasz model jedną opcją.

- Funkcje dla przedsiębiorstw: Trasowanie awaryjne, analityka, kontrola prywatności (brak gromadzenia promptów — według niektórych dyskusji) oraz niezawodny dostęp.

Najnowsze informacje (stan na maj 2026 r.): CometAPI utrzymuje zweryfikowaną/partnerską integrację na n8n.io, z dedykowanym węzłem społecznościowym (n8n-nodes-cometapi) dostępnym przez npm dla instancji lokalnych/samorozszerzanych. Użytkownicy zgłaszają płynną kompatybilność z węzłami OpenAI i rosnącą adopcję w przepływach wielomodelowych. Ostatnie aktualizacje n8n ulepszają wywoływanie narzędzi i węzły HTTP, czyniąc integracje bardziej niezawodnymi.

Pierwsze kroki: wymagania wstępne i konfiguracja konta

Zarejestruj się w CometAPI

Wejdź na cometapi.com, utwórz bezpłatne konto i wygeneruj klucz API w panelu. Nowi użytkownicy często otrzymują środki testowe. Przejrzyj listę modeli i cennik.

Skonfiguruj n8n

- Chmura: n8n.cloud (zarządzane, łatwe skalowanie).

- Samodzielny hosting: Docker, npm lub Kubernetes. Zalecane ze względu na prywatność danych i nieograniczone wykonania. Najnowsze poradniki obejmują uruchamianie węzłów CometAPI lokalnie.

Zaktualizuj do najnowszej wersji (np. 2.20+ na maj 2026), aby uzyskać ulepszenia AI i stabilności.

Zainstaluj węzeł CometAPI (opcjonalne, ale zalecane dla self‑hosted)

Użyj węzła społeczności:

npm install n8n-nodes-cometapi

Zrestartuj n8n. Pojawi się w panelu węzłów, zapewniając natywne doświadczenie.

Przewodnik krok po kroku

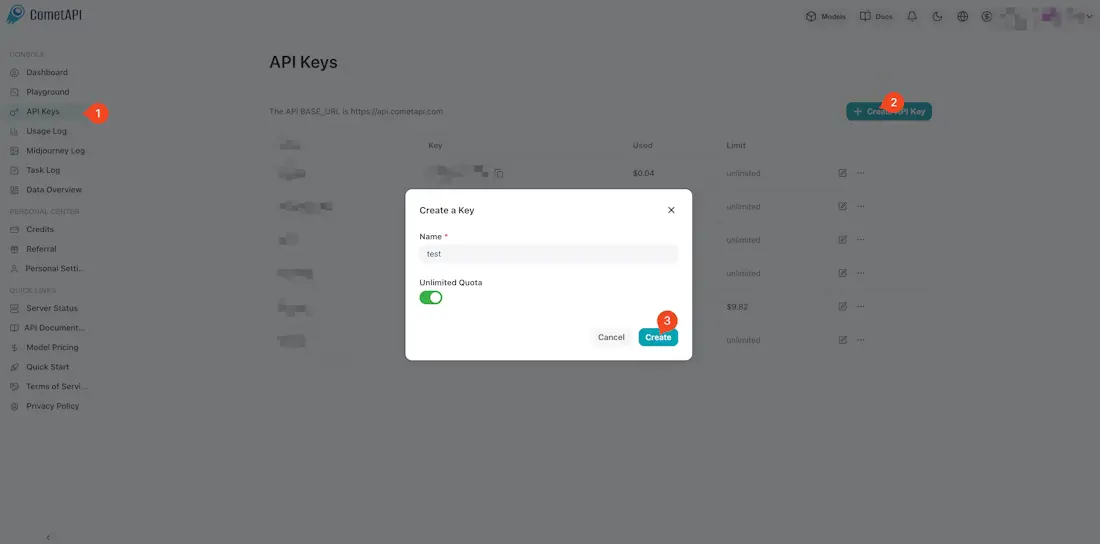

Krok 1: Pobierz swój klucz API CometAPI

Zaloguj się do panelu CometAPI i przejdź do sekcji API Token. Kliknij Add API Key, aby wygenerować unikalne poświadczenie.

Skopiuj swój klucz (zwykle w formacie sk-xxxx) i miej pod ręką podstawowy adres URL: https://api.cometapi.com/v1.

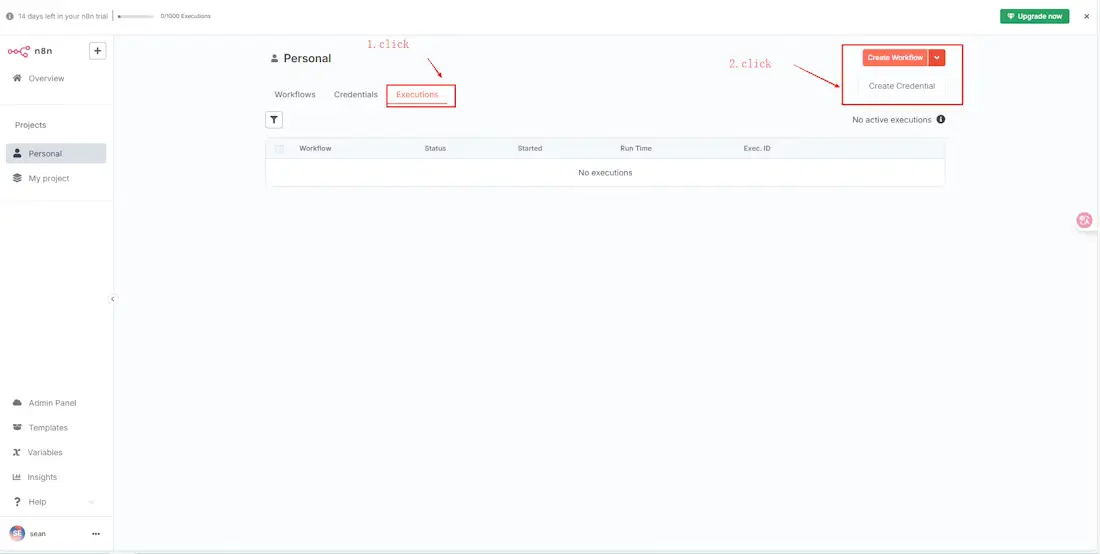

Krok 2: Utwórz poświadczenie OpenAI w n8n

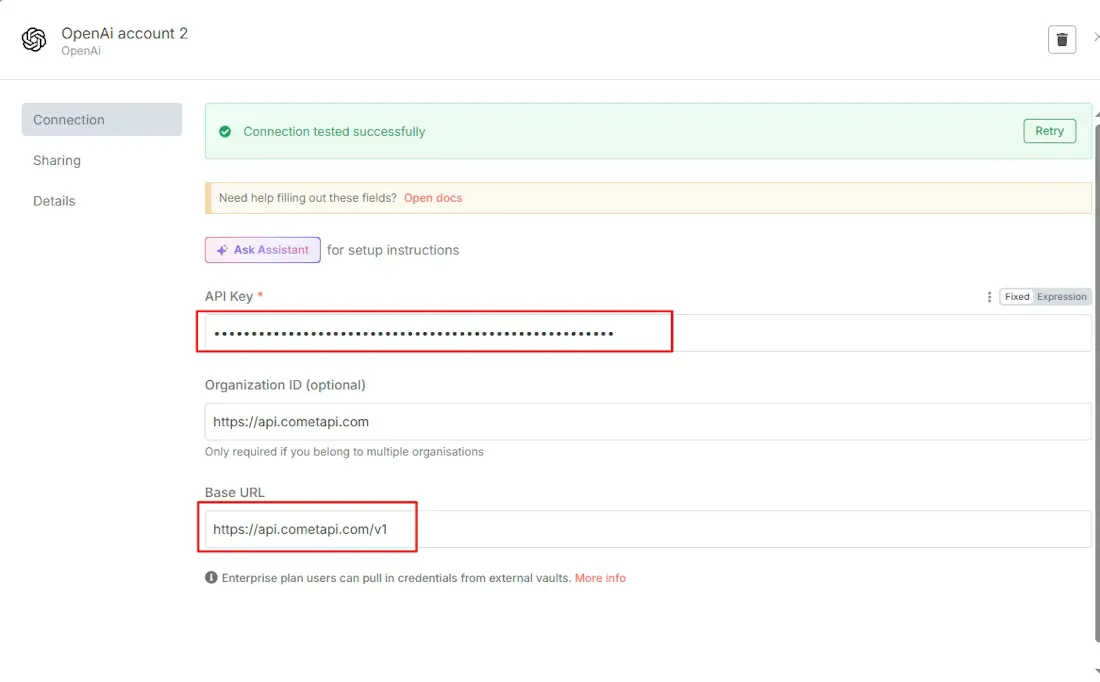

Otwórz swoją instancję n8n i przejdź do Credentials → Create Credential. Wyszukaj i wybierz typ poświadczenia OpenAI API.

- API Key: Wklej tutaj swój token CometAPI.

- Base URL: Wprowadź

https://api.cometapi.com/v1.

Kliknij Save, aby sfinalizować konfigurację.

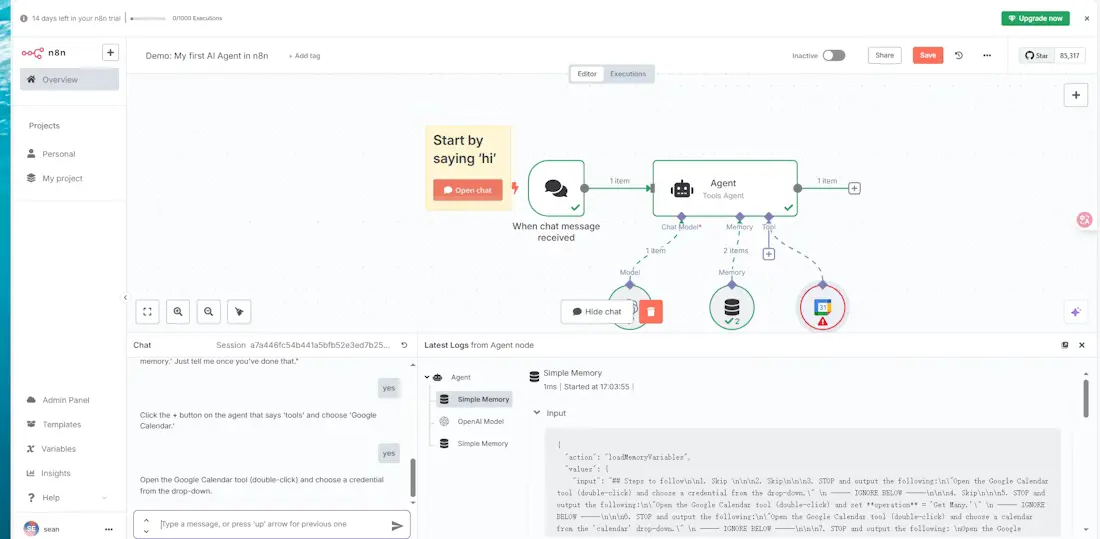

Krok 3: Przetestuj połączenie

Utwórz nowy przepływ i dodaj węzeł OpenAI (np. Chat Model lub AI Agent). Wybierz poświadczenie CometAPI, które właśnie utworzyłeś. W polu modelu możesz teraz wpisać dowolny obsługiwany identyfikator modelu, taki jak gpt-5.5 lub claude-opus-4-7. Wykonaj węzeł; pomyślna odpowiedź potwierdzi, że Twój most zgodny z OpenAI w n8n został poprawnie skonfigurowany.

Rozwiązywanie typowych problemów

Jeśli integracja nie zadziała od razu, sprawdź te trzy obszary:

API zwraca błąd 401 Unauthorized

Ten błąd zwykle oznacza, że n8n nie może uwierzytelnić się w bramce. Najpierw sprawdź, czy klucz API został poprawnie skopiowany, bez spacji na początku lub końcu. Po drugie, upewnij się, że Base URL zawiera sufiks /v1. Bez ścieżki wersji endpoint może odrzucić żądanie.

Nierozpoznana nazwa modelu

CometAPI hostuje ponad 500 modeli i każdy ma specyficzny identyfikator. Jeśli n8n zwraca błąd „Model not found”, upewnij się, że używasz dokładnego ID modelu z dokumentacji CometAPI. Na przykład użyj gpt-5.5-pro zamiast gpt-5-pro, jeśli taki identyfikator widnieje w aktualnym katalogu.

Odpowiedź jest wolna

W aplikacjach czasu rzeczywistego, gdzie liczy się opóźnienie, niektóre modele nastawione na rozumowanie mogą przetwarzać dłużej. Jeśli Twój przepływ wymaga niemal natychmiastowych odpowiedzi, spróbuj przełączyć się na model o wysokiej przepustowości, taki jak Gemini 3.1 Flash-Lite lub DeepSeek V4 Flash, zoptymalizowane pod kątem szybkości.

Jakich modeli możesz używać w n8n przez CometAPI

| Model Category | Examples | Best For |

|---|---|---|

| Tekst/Czat | GPT 5.5, Claude Opus 4.7, Gemini 3.1 Pro | Profesjonalne wnioskowanie i złożona logika |

| Kod | DeepSeek V4 Pro, GPT 5.3 Codex | Agenty programistyczne i refaktoryzacje na skalę repozytorium |

| Obraz | GPT Image 2, Flux 2 Max | Wysokiej jakości treści wizualne i projektowanie |

| Wideo | Sora 2, Doubao-Seedance 2.0 | Automatyzacja filmowa i klipy wideo do social mediów |

Gotowe szablony przepływów pracy n8n

Implementacja CometAPI w n8n umożliwia zaawansowaną logikę wielomodelową. Oto trzy szablony, które możesz zbudować już dziś.

Szablon 1: Automatyzacja wsparcia klienta

- Wyzwalacz: Węzeł Webhook odbiera zgłoszenie wsparcia z Twojej strony.

- Przetwarzanie: Węzeł CometAPI (OpenAI) używa Claude Opus 4.7 do analizy treści zgłoszenia.

- Logika: Węzeł Switch ocenia „wagę” lub „złożoność” wskazane przez AI.

- Rozgałęzienie: Proste zapytania (np. „Gdzie jest moje zamówienie?”) kierowane są do węzła automatycznej odpowiedzi. Złożone problemy techniczne trafiają do węzła Slack lub węzła Zendesk po interwencję człowieka.

- Konfiguracja węzła: Ustaw węzeł Claude na

thinking: {type: "adaptive"}, aby poświęcał więcej czasu trudniejszej analizie sentymentu.

Szablon 2: Zautomatyzowany pipeline treści

- Wyzwalacz: Węzeł RSS Feed wykrywa nowy artykuł w Twojej branży.

- Przetwarzanie 1: Użyj GPT 5.5, aby przeczytać artykuł i wygenerować 200‑wyrazowe streszczenie do wewnętrznego newslettera.

- Przetwarzanie 2: Przekaż to streszczenie do DeepSeek V3, aby wygenerować pięć tagów i słów kluczowych zoptymalizowanych pod SEO.

- Wynik: Streszczenie i tagi trafiają do bazy Notion lub węzła WordPress.

- Dlaczego taki układ?: Używając GPT 5.5 do wysokiej jakości streszczenia i tańszego DeepSeek V3 do prostego tagowania, utrzymujesz wysoką jakość przy znaczącym obniżeniu całkowitego kosztu tokenów.

Szablon 3: Przepływ generowania obrazów

- Wyzwalacz: Węzeł Google Sheets wykrywa nowy wiersz z nazwą i opisem produktu.

- Przetwarzanie: Opis jest wysyłany do węzła CometAPI (OpenAI), używającego endpointu

/v1/images/generationsz modelem Flux 2 Max. - Przechowywanie: Wygenerowany URL obrazu jest przekazywany do węzła Google Drive, aby wgrać i zapisać plik.

- Konfiguracja węzła: Ustaw parametr

nna 1 i wybierz rozdzielczość typu1024x1024dla wysokiej jakości mockupów produktów.

Wskazówki optymalizacji kosztów dla n8n + CometAPI

Aby zmaksymalizować zniżkę 20–40%, stosuj poniższe strategie architektoniczne.

Używaj tańszych modeli do klasyfikacji i routingu

Nie używaj GPT 5.5 Pro do prostych decyzji „Tak/Nie” lub „Kategoria A/B”. Skorzystaj z DeepSeek V4 Flash lub GPT 5.4 nano do takich zadań. Te modele kosztują ułamek ceny flagowców i często są szybsze, co sprawia, że Twój przepływ w n8n działa wydajniej.

Ustaw warunkowy dobór modelu w n8n

Użyj węzła Switch lub węzła If, aby wybrać model na podstawie długości wejścia lub priorytetu. Na przykład, jeśli dokument ma mniej niż 1000 słów, skieruj go do standardowego modelu. Jeśli to ogromne repozytorium o 500 000 tokenów, skieruj je do modelu z długim kontekstem, takiego jak Grok 4.20 lub Claude Opus 4.7.

Przetwarzanie wsadowe vs. w czasie rzeczywistym

Jeśli Twój przepływ w n8n nie wymaga natychmiastowych odpowiedzi (np. raport na koniec dnia), użyj węzła Wait lub węzła Schedule, aby zebrać wejścia i przetworzyć je zbiorczo. CometAPI obsługuje wysoką współbieżność, ale ograniczenie częstotliwości wielu drobnych wywołań może pomóc zmieścić się w niższych limitach i uprościć logi zużycia.

Tabela porównawcza: n8n + CometAPI vs. alternatywy

| Feature | n8n + CometAPI | Zapier + Multiple AIs | Make.com + Direct APIs | Custom Code (Python/Node) |

|---|---|---|---|---|

| Koszt | Niski (oszczędność 20–40% + n8n free/self‑host) | Wysoki (per task + per API) | Średni | Zmienny (czas dev) |

| Łatwość użycia | Wizualne, low‑code | Bardzo łatwe | Wizualne | Wymaga dużo kodu |

| Elastyczność | Nieograniczona (HTTP + 400+ węzłów) | Ograniczone szablony | Dobra | Najwyższa |

| Dostęp do modeli | 500+ w jednym miejscu | Fragmentaryczny | Zależny | Ręczny |

| Self‑hosting/Prywatność | Doskonała | Ograniczona | Skupienie na chmurze | Pełna kontrola |

| Skalowalność | Wysoka (tryby kolejki, workery) | Limity cenowe wg użycia | Dobra | Zależna od infrastruktury |

| Utrzymanie | Niskie (jedna integracja) | Wysokie (wiele połączeń) | Średnie | Wysokie |

| Wsparcie agentów AI | Natywne + narzędzia | Podstawowe | Rosnące | Własne |

Werdykt: n8n + CometAPI wygrywa w zespołach potrzebujących mocy, kontroli i efektywności kosztowej.

Perspektywy i wskazówki optymalizacyjne

W miarę proliferacji modeli AI w 2026 r., zunifikowane platformy takie jak CometAPI, połączone z elastycznymi orkiestratorami jak n8n, stają się kluczowe. Oczekuj głębszych natywnych węzłów, lepszych integracji MCP/server oraz zaawansowanych możliwości agentów.

Optymalizacja na Cometapi.com:

- Śledź zużycie tokenów w przepływach, aby analizować ROI.

- Wykorzystaj analitykę CometAPI + dane wykonań n8n.

- Eksperymentuj z nowszymi modelami (np. DeepSeek-V4) do zadań specjalistycznych przy niższym koszcie.

- Łącz z innymi narzędziami CometAPI dla kompleksowych rozwiązań AI end‑to‑end.

Krótki przewodnik: Zbuduj dziś prosty workflow do streszczania. Jutro skaluj do pełnych operacji AI.

Gotowy, by zacząć? Przejdź do CometAPI, aby uzyskać darmowy klucz API i środki. Samodzielny hosting lub chmura n8n — połącz zgodnie z powyższymi krokami i przekształć swoje automatyzacje. W przypadku niestandardowych przepływów lub konsultingu dla przedsiębiorstw, poznaj opcje na Cometapi.com.

Ta integracja nie jest tylko techniczna — to strategiczny mnożnik produktywności i innowacji w erze AI.

FAQ

P: Czy potrzebuję osobnych poświadczeń dla każdego modelu AI?

O: Nie. Jedno poświadczenie CometAPI zapewnia dostęp do wszystkich 500+ modeli w n8n — od GPT i Claude po DeepSeek i Kimi.

P: Czy CometAPI jest tańsze niż bezpośrednie użycie OpenAI w n8n?

O: Tak. Ceny CometAPI są ustawione 20–40% poniżej oficjalnych stawek detalicznych dla tych samych modeli.

P: Czy to działa z samodzielnie hostowanym n8n?

O: Tak. Proces konfiguracji jest identyczny dla n8n Cloud i samodzielnie hostowanej wersji Docker.

P: Które węzły n8n działają z CometAPI?

O: Każdy węzeł akceptujący poświadczenia OpenAI, w tym AI Agent, Chat Model i standardowe węzły completion.

P: Czy mogę przełączać modele bez rekonfiguracji n8n?

O: Tak. Wystarczy zaktualizować nazwę modelu w ustawieniach węzła (np. zmienić gpt-5.5 na claude-opus-4-7); to samo poświadczenie pozostaje ważne dla wszystkich dostawców.