OpenAI, Anthropic i Google nieustannie poszerzają granice rozbudowanych modeli językowych dzięki swoim najnowszym flagowym produktom – o3 firmy OpenAI (i jej ulepszonej wersji o3-pro), Claude Opus 4 firmy Anthropic oraz Gemini 2.5 Pro firmy Google. Każdy z tych modeli oferuje unikalne innowacje architektoniczne, mocne strony wydajnościowe i integracje z ekosystemami, które odpowiadają różnym potrzebom, od wsparcia w programowaniu klasy korporacyjnej po ulepszenia wyszukiwania dla użytkowników. To dogłębne porównanie analizuje historię wydań, możliwości techniczne, wydajność w testach porównawczych i rekomendowane aplikacje, aby pomóc organizacjom wybrać model odpowiedni do ich potrzeb.

Czym jest o3 firmy OpenAI i jak się rozwijało?

OpenAI po raz pierwszy zaprezentował o3 16 kwietnia 2025 roku, pozycjonując go jako „nasz najinteligentniejszy model” zaprojektowany z myślą o rozszerzonym kontekście i wysoce niezawodnych odpowiedziach. Wkrótce potem, 10 czerwca 2025 roku, OpenAI wydało o3-pro – wariant o zoptymalizowanej wydajności, dostępny dla użytkowników Pro w ChatGPT oraz za pośrednictwem API – który zapewnia szybsze wnioskowanie i wyższą przepustowość przy dużych obciążeniach.

Okno kontekstowe i przepustowość

OpenAI o3 oferuje 200 tys. tokenów Okno kontekstowe dla wejścia i wyjścia, umożliwiające obsługę obszernych dokumentów, baz kodu lub konwersacji wieloetapowych bez częstego skracania. Jego przepustowość wynosi około 37.6 tokenów/sek., który — choć nie jest liderem — zapewnia spójną responsywność przy stałych obciążeniach.

Zaawansowane rozumowanie deliberatywne

- „Prywatny łańcuch myśli”:o3 został wytrenowany metodą uczenia przez wzmacnianie, aby móc planować i rozumować na etapach pośrednich przed wytworzeniem ostatecznego wyniku, co znacznie poprawiło jego zdolność do logicznego wnioskowania i rozkładania problemu na czynniki pierwsze.

- Wyrównanie deliberatywne:Informuje o wykorzystaniu technik bezpieczeństwa, które dzięki rozumowaniu krok po kroku pozwalają modelowi lepiej przestrzegać wytycznych, redukując w ten sposób poważne błędy w złożonych zadaniach z życia realnego.

Cennik i integracja przedsiębiorstw

Cena OpenAI dla O3 wynosi około $2 za milion tokenów wejściowych oraz $8 za milion tokenów wyjściowychTo plasuje go w średniej półce: jest bardziej przystępny cenowo niż modele premium, takie jak Claude Opus 4, przy dużych obciążeniach, ale droższy niż ekonomiczne alternatywy, takie jak Gemini 2.5 Pro. Co najważniejsze, przedsiębiorstwa korzystają z płynnej integracji z szerszym ekosystemem API OpenAI – obejmującym osadzenia, dostrajanie i specjalistyczne punkty końcowe – minimalizując narzut związany z integracją.

Czym Claude Opus 4 wyróżnia się na rynku?

Anthropic ogłosił Claude Opus 4 22 maja 2025 roku, reklamując go jako „najlepszy na świecie model kodowania” zapewniający stałą wydajność w przypadku złożonych, długotrwałych zadań i przepływów pracy agentów. Został on uruchomiony jednocześnie w API Anthropic oraz za pośrednictwem Amazon Bedrock, dzięki czemu jest dostępny dla klientów AWS za pośrednictwem funkcji LLM i REST API Bedrock...

Rozszerzone możliwości „myślenia”

Cechą charakterystyczną Opus 4 jest jego „rozszerzone myślenie” Tryb beta, który dynamicznie przydziela moc obliczeniową między wnioskowaniem w modelu a wywołaniami narzędzi (np. wyszukiwanie, pobieranie, zewnętrzne interfejsy API). W połączeniu z „podsumowaniami myśli” użytkownicy zyskują wgląd w wewnętrzny łańcuch wnioskowania modelu – co jest kluczowe dla aplikacji wrażliwych na zgodność z przepisami w finansach i opiece zdrowotnej.

Kompromisy cenowe i kontekstowe

At $15 za milion tokenów wejściowych oraz $75 za milion tokenów wyjściowychClaude Opus 4 znajduje się na szczycie spektrum cenowego. Jego 200 tys. tokenów okno wejściowe (z 32 tys. tokenów Limit wyjściowy (limit wyjściowy) jest mniejszy niż okno Gemini 2.5 Pro o wartości 1 mln tokenów, ale wystarcza do większości zadań związanych z przeglądem kodu i rozumowaniem długoterminowym. Anthropic uzasadnia tę premię, kładąc nacisk na wewnętrzną intensywność obliczeniową i stałą wierność ciągłości myśli, z oszczędnościami do 90% dzięki szybkiemu buforowaniu i 50% dzięki przetwarzaniu wsadowemu. Rozszerzone budżety na myślenie są dostępne w płatnych planach; użytkownicy wersji darmowej mają dostęp tylko do wariantu Sonnet.

Jakie wyjątkowe funkcje i wydajność oferuje Gemini 2.5 Pro?

Wydany jako następna generacja usługi Google w warstwie „Pro”, Bliźnięta 2.5 Pro Jest skierowany do organizacji potrzebujących szerokiego kontekstu, multimodalnych danych wejściowych i ekonomicznej skalowalności. Co istotne, obsługuje do Tokeny 1,048,576 w jednym monicie — przychodzącym — i Tokeny 65,535 wychodzące, umożliwiające kompleksowy obieg dokumentów obejmujący setki tysięcy stron.

Wyższy kontekst i multimodalność

Gemini 2.5 Pro błyszczy dzięki 1M-token okno kontekstowe, ułatwiające takie przypadki użycia, jak analiza umów prawnych, eksploracja patentów i kompleksowa refaktoryzacja bazy kodu. Model natywnie akceptuje tekst, kod, obrazy, dźwięk, pliki PDF i ramki wideo, usprawniając multimodalne rurociągi bez konieczności przeprowadzania oddzielnych etapów wstępnego przetwarzania.

W jaki sposób Gemini usprawnia wyszukiwanie multimodalne i konwersacyjne?

Gemini 2.5 Pro wyróżnia się metodologią „rozdzielania zapytań”: rozkłada złożone zapytania na podpytania, przeprowadza wyszukiwania równoległe i syntetyzuje na bieżąco kompleksowe, konwersacyjne odpowiedzi. Dzięki obsłudze tekstu, głosu i obrazu, tryb AI wykorzystuje multimodalne możliwości Gemini, aby sprostać zróżnicowanym interakcjom użytkowników – choć wciąż znajduje się na wczesnym etapie rozwoju i może czasami błędnie interpretować zapytania.

Konkurencyjne ceny

Przy szybkości wprowadzania danych 1.25–2.50 dolarów na milion tokenów i 10–15 dolarów na milion tokenów wyjściowych Gemini 2.5 Pro zapewnia najlepszą cena za token Stosunek między tymi trzema. To czyni go szczególnie atrakcyjnym w przypadku aplikacji o dużej objętości i dużej ilości dokumentów, gdzie długie konteksty napędzają zużycie tokenów bardziej niż surowe wskaźniki wydajności. Plany premium odblokowują budżety „Deep Think” i zwiększają przepustowość. Subskrypcje Google AI Pro i Ultra łączą dostęp do Gemini 2.5 Pro z innymi narzędziami, takimi jak Veo Video Generation i NotebookLM.

Podstawowe architektury i możliwości

OpenAI o3: Refleksyjne rozumowanie na dużą skalę

O3 firmy OpenAI to refleksyjny, generatywny, wstępnie wytrenowany transformator, zaprojektowany w celu poświęcenia dodatkowego czasu na rozważania zadań wymagających logicznego rozumowania krok po kroku. Architektonicznie bazuje on na szkielecie transformatora GPT-4, ale zawiera mechanizm „budżetu myślowego”: model dynamicznie przydziela więcej cykli obliczeniowych złożonym problemom, tworząc wewnętrzne łańcuchy myślowe przed wygenerowaniem wyników. Przekłada się to na znaczną poprawę wydajności w dziedzinach wymagających rozumowania wieloetapowego, takich jak zaawansowana matematyka, badania naukowe i synteza kodu.

Claude Opus 4: Hybrydowe rozumowanie dla rozszerzonych przepływów pracy

Claude Opus 4 firmy Anthropic to jak dotąd najpotężniejszy model, zoptymalizowany pod kątem kodowania i zrównoważonych przepływów pracy agentowych. Podobnie jak O3, wykorzystuje rdzeń transformatorowy, ale wprowadza hybrydowe tryby wnioskowania – niemal natychmiastowe odpowiedzi („szybkie myślenie”) w porównaniu z rozszerzoną deliberacją („głębokie myślenie”) – co pozwala mu zachować kontekst w tysiącach kroków i godzinach obliczeń. To hybrydowe podejście sprawia, że Opus 4 doskonale nadaje się do długotrwałych procesów inżynierii oprogramowania, wieloetapowych zadań badawczych oraz autonomicznej orkiestracji agentów.

Gemini 2.5 Pro: myślenie multimodalne z adaptacyjnymi budżetami

Gemini 2.5 Pro firmy Google DeepMind rozszerza wbudowaną multimodalność i możliwości wnioskowania Gemini. Wprowadza „Deep Think”, adaptacyjny mechanizm myślenia równoległego, który rozdziela podzadania między moduły wewnętrzne, syntetyzując wyniki w spójne odpowiedzi. Gemini 2.5 Pro oferuje również wyjątkowo długie okno kontekstowe – umożliwiające przetwarzanie całych baz kodu, dużych zestawów danych (tekst, audio, wideo) i dokumentów projektowych w jednym przebiegu – zapewniając jednocześnie precyzyjną kontrolę nad budżetami analitycznymi w celu znalezienia kompromisu między wydajnością a kosztami.

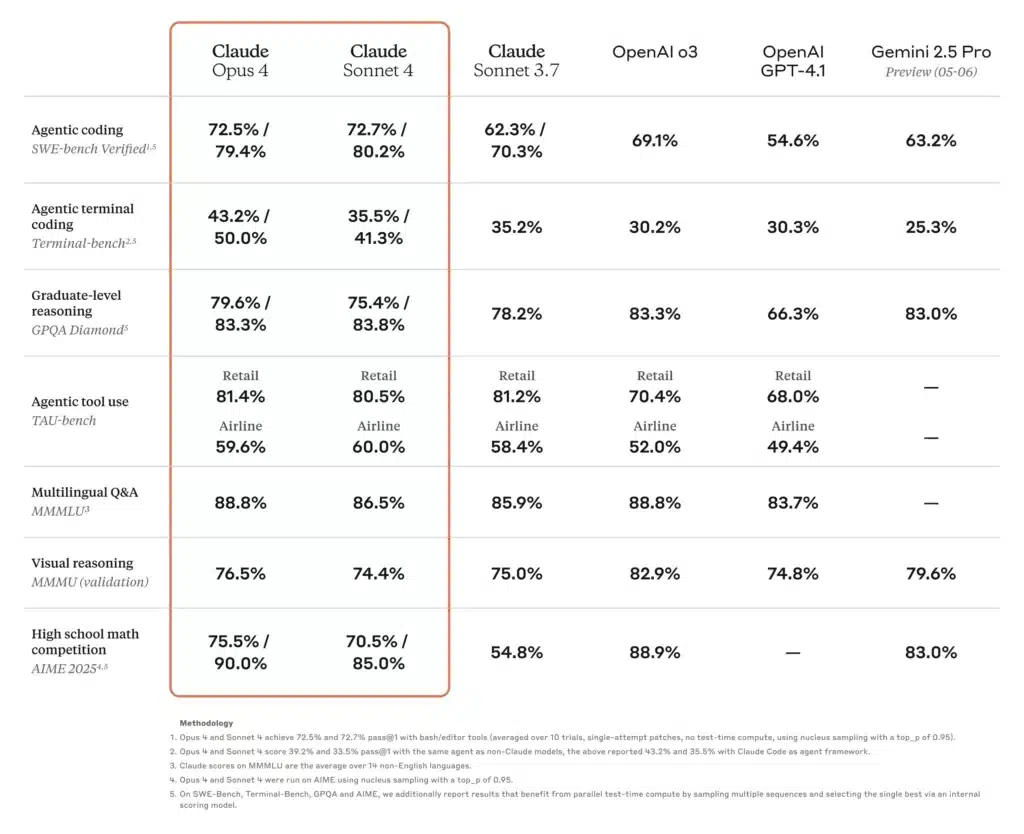

Jak wypadają testy wydajności tych modeli?

Rozumowanie akademickie i naukowe

W niedawnym rankingu SciArena, o3 wyprzedził konkurencję w pytaniach z zakresu rozumowania technicznego, ocenianych przez badaczy, co odzwierciedla silne zaufanie społeczności do jego naukowej dokładności. Z kolei Claude Opus 4 wykazał się lepszą wydajnością w testach porównawczych z agentami, wymagających długotrwałego, wielogodzinnego rozwiązywania problemów, przewyższając modele Sonnet nawet o 30% w testach TAU-bench i zadaniach z zakresu rozumowania predykcyjnego. Gemini 2.5 Pro jest również liderem w wielu testach porównawczych w środowisku akademickim, zajmując pierwsze miejsce w LMArena w zakresie miar preferencji człowieka i wykazując znaczną przewagę w testach matematyczno-przyrodniczych.

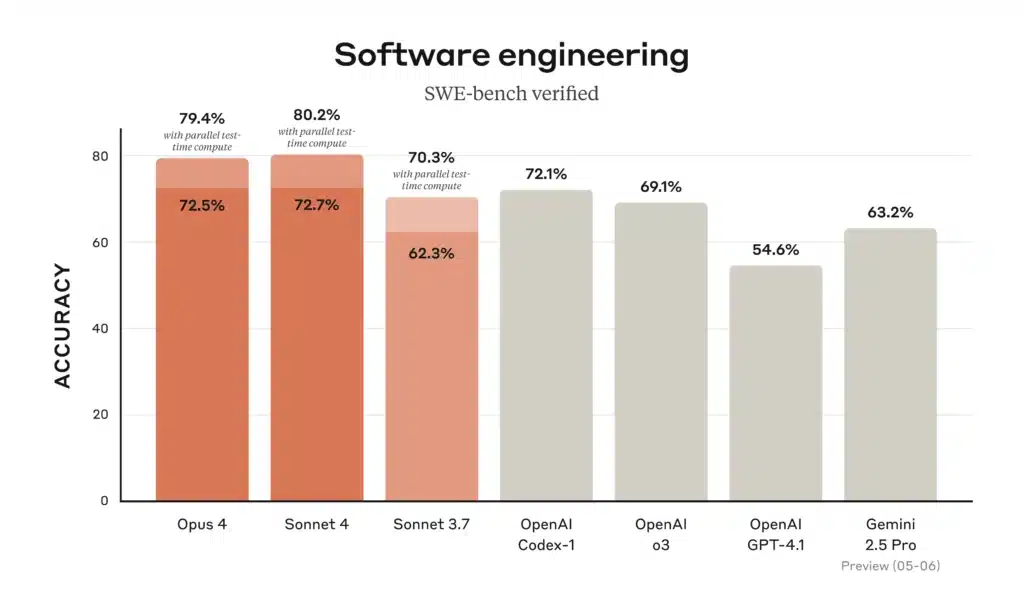

Kodowanie i inżynieria oprogramowania

W rankingach kodowania Gemini 2.5 Pro „przewodzi popularnej platformie WebDev Arena” i prowadzi w popularnych testach porównawczych kodowania dzięki możliwości ładowania i wnioskowania na podstawie całych repozytoriów. Claude Opus 4 zdobył tytuł „najlepszego na świecie modelu kodowania” z wynikiem 72.5% w teście SWE i 43.2% w teście Terminal – testach skupionych na złożonych, długotrwałych zadaniach programistycznych. O3 również wyróżnia się w syntezie i debugowaniu kodu, ale nieznacznie ustępuje Opus 4 i Gemini w wieloetapowych, wielkoskalowych scenariuszach inżynieryjnych. Niemniej jednak, jego intuicyjny mechanizm myślowy sprawia, że jest wysoce niezawodny w przypadku pojedynczych zadań kodowania.

Wykorzystanie narzędzi i integracja multimodalna

Multimodalna konstrukcja Gemini 2.5 Pro – przetwarzanie tekstu, obrazów, dźwięku i wideo – daje mu przewagę w kreatywnych procesach, takich jak interaktywne symulacje, wizualna analiza danych i tworzenie scenorysów wideo. Wykorzystanie narzędzi agentowych Claude Opus 4, w tym interfejsu wiersza poleceń Claude Code CLI i zintegrowanych operacji na systemie plików, doskonale sprawdza się w budowaniu autonomicznych potoków w interfejsach API i bazach danych. O3 obsługuje przeglądanie stron internetowych, analizę plików, wykonywanie kodu Pythona i wnioskowanie na podstawie obrazów, co czyni go wszechstronnym „scyzorykiem” do zadań w różnych formatach, aczkolwiek z krótszymi limitami kontekstowymi niż Gemini 2.5 Pro.

Jak te modele wypadają w rzeczywistych scenariuszach kodowania?

Jeśli chodzi o pomoc w kodowaniu, testy porównawcze to tylko część historii. Programiści szukają precyzyjnego generowania kodu, umiejętności refaktoryzacji i umiejętności zrozumienia kontekstu projektu rozłożonego na wiele plików.

Dokładność i wskaźniki halucynacji

- Claude Opus 4 prowadzi w unikaniu halucynacji, z mniejszą liczbą przypadków nieistniejących odniesień do API lub nieprawidłowych sygnatur bibliotek – kluczowych dla baz kodu o znaczeniu krytycznym. Jego wskaźnik halucynacji jest raportowany na poziomie ~% 12 na temat obszernych audytów kodu w porównaniu ~% 18 dla Bliźniąt i ~% 20 dla o3.

- Bliźnięta 2.5 Pro sprawdza się przy masowych transformacjach (np. migrowaniu wzorców kodu pomiędzy dziesiątkami tysięcy wierszy) dzięki swojemu dużemu oknu kontekstowemu, ale czasami ma problemy z subtelnymi błędami logicznymi w dużych blokach kodu.

- OtwórzAI o3 pozostaje podstawowym narzędziem do szybkiego tworzenia fragmentów kodu, generowania szablonów i interaktywnego debugowania ze względu na stabilne opóźnienie i wysoką dostępność — jednak programiści często przeprowadzają walidację krzyżową z innym modelem, aby wychwycić błędy występujące w skrajnych przypadkach.

Ekosystem narzędzi i API

- Obie o3 oraz Gemini wykorzystaj rozbudowane narzędzia — odpowiednio API wywołujące funkcje OpenAI i zintegrowaną strukturę działań Google — umożliwiające bezproblemową koordynację pobierania danych, zapytań do bazy danych i wywołań zewnętrznego API.

- Claude Opus 4 jest integrowany z frameworkami agentowymi, takimi jak Claude Code (narzędzie CLI firmy Anthropic) i Amazon Bedrock, oferując abstrakcje wysokiego poziomu do tworzenia autonomicznych przepływów pracy bez konieczności ręcznej orkiestracji.

Który model oferuje najlepszy stosunek ceny do jakości?

Zrównoważenie surowych możliwości, długości kontekstu i kosztów prowadzi do różnych wniosków dotyczących „najlepszej wartości” w zależności od charakterystyki obciążenia pracą.

Przypadki użycia o dużej objętości i skoncentrowane na dokumentach

W przypadku przetwarzania obszernych korpusów, takich jak repozytoria dokumentów prawnych, literatura naukowa czy archiwa przedsiębiorstw,Bliźnięta 2.5 Pro często wyłania się jako zwycięzca. Jego 1M-token okno i punkt cenowy $ $ 1.25 2.50- (wejście) i $ $ 10 15- (wyjściowe) tokeny zapewniają bezkonkurencyjną strukturę kosztów dla zadań o długim kontekście.

Głębokie rozumowanie i wieloetapowe przepływy pracy

Gdy liczy się dokładność, wierność ciągłości myśli i długoterminowe możliwości agentów — na przykład w modelowaniu finansowym, sprawdzaniu zgodności z przepisami prawa lub procesach badawczo-rozwojowych —Claude Opus 4, pomimo wyższej ceny, może zmniejszyć obciążenie związane z obsługą błędów i poprawić przepustowość kompleksową poprzez minimalizację ponownych uruchomień i cykli przeglądu przez człowieka.

Zrównoważone wdrażanie rozwiązań dla przedsiębiorstw

Dla zespołów poszukujących niezawodnej, uniwersalnej wydajności bez ekstremalnej skali, OtwórzAI o3 Oferuje rozwiązanie pośrednie. Dzięki szerokiemu wsparciu API, umiarkowanym cenom i solidnym wynikom testów porównawczych, pozostaje atrakcyjnym wyborem dla platform do nauki o danych, automatyzacji obsługi klienta i integracji produktów na wczesnym etapie.

Który model sztucznej inteligencji powinieneś wybrać, aby spełnić swoje konkretne potrzeby?

Ostatecznie Twój idealny model zależy od trzech głównych czynników:

- Skala kontekstu:W przypadku obciążeń wymagających dużych okien wprowadzania danych, Gemini 2.5 Pro jest niezastąpiony.

- Głębokość rozumowania:Jeśli Twoje zadania wymagają wieloetapowej logiki i masz niską tolerancję na błędy, Claude Opus 4 zapewni Ci wyjątkową spójność.

- Wrażliwość na koszty i dopasowanie do ekosystemu:W przypadku zadań ogólnego przeznaczenia w ramach pakietu OpenAI — zwłaszcza gdy ważna jest integracja z istniejącymi potokami danych — o3 stanowi zrównoważoną i ekonomiczną opcję.

Oceniając profil tokenów swojej aplikacji (wejście i wyjście), tolerancję na halucynacje i wymagania dotyczące narzędzi, możesz wybrać model, który optymalnie odpowiada zarówno potrzebom technicznym, jak i ograniczeniom budżetowym.

Oto tabela porównawcza podsumowująca najważniejsze specyfikacje, wskaźniki wydajności, ceny i idealne przypadki użycia dla OpenAI o3, Anthropic Claude Opus 4 i Google Gemini 2.5 Pro:

| Funkcja / Metryka | OtwórzAI o3 | Claude Opus 4 | Bliźnięta 2.5 Pro |

|---|---|---|---|

| Okno kontekstowe (przychodzące/wychodzące) | 200 tys. żetonów / 200 tys. żetonów | 200 tys. żetonów / 32 tys. żetonów | 1 048 576 tokenów / 65 535 tokenów |

| Przepustowość (tokeny/s) | ~ 37.6 | ~ 42.1 | ~ 83.7 |

| Średnie opóźnienie | ~2.8 sek. | ~3.5 sek. | ~2.52 sek. |

| Test porównawczy kodowania (SWE-benchmark) | 69.1% | 72.5% | 63.2% |

| Wskaźnik matematyczny (AIME-2025) | 78.4%¹ | 81.7%¹ | 83.0% |

| Współczynnik halucynacji (audyty kodu) | ~20% | ~12% | ~18% |

| Wejścia multimodalne | Tekst i kod | Tekst i kod | Tekst, kod, obrazy, dźwięk, pliki PDF, wideo |

| Wsparcie „łańcucha myśli” | Standardowa | Myślenie rozszerzone z podsumowaniami | Standardowa |

| API wywoływania funkcji/narzędzi | Tak (funkcje OpenAI) | Tak (za pośrednictwem agentów antropicznych i Bedrock) | Tak (Działania Google) |

| Cennik (tokeny wejściowe) | 2.00 USD / mln tokenów | 15.00 USD / mln tokenów | 1.25–2.50 USD/M tokenów |

| Cennik (tokeny wyjściowe) | 8.00 USD / mln tokenów | 75.00 USD / mln tokenów | 10–15 USD/M tokenów |

| Idealne przypadki użycia | Czatboty ogólnego przeznaczenia, obsługa klienta, szybkie fragmenty kodu | Głębokie rozumowanie, złożone bazy kodów, autonomiczni agenci | Analiza dokumentów na masową skalę, multimodalne przepływy pracy |

Wyniki z matematyki AIME-2025 dla o3 i Opus 4 stanowią przybliżone wartości średnie oparte na raportowanych testach porównawczych.

Jak zacząć

CometAPI to ujednolicona platforma API, która agreguje ponad 500 modeli AI od wiodących dostawców — takich jak seria GPT firmy OpenAI, Gemini firmy Google, Claude firmy Anthropic, Midjourney, Suno i innych — w jednym, przyjaznym dla programistów interfejsie. Oferując spójne uwierzytelnianie, formatowanie żądań i obsługę odpowiedzi, CometAPI radykalnie upraszcza integrację możliwości AI z aplikacjami. Niezależnie od tego, czy tworzysz chatboty, generatory obrazów, kompozytorów muzycznych czy oparte na danych potoki analityczne, CometAPI pozwala Ci szybciej iterować, kontrolować koszty i pozostać niezależnym od dostawcy — wszystko to przy jednoczesnym korzystaniu z najnowszych przełomów w ekosystemie AI.

Deweloperzy mogą uzyskać dostęp Bliźnięta 2.5 Pro,Claude Opus 4 oraz Interfejs API O3 przez Interfejs API CometNajnowsze wersje modeli podane są na dzień publikacji artykułu. Na początek zapoznaj się z możliwościami modelu w Plac zabaw i zapoznaj się z Przewodnik po API aby uzyskać szczegółowe instrukcje. Przed uzyskaniem dostępu upewnij się, że zalogowałeś się do CometAPI i uzyskałeś klucz API. Interfejs API Comet zaoferuj cenę znacznie niższą niż oficjalna, aby ułatwić Ci integrację.

Ostatecznie wybór między serią o3 firmy OpenAI, Claude Opus 4 firmy Anthropic a Gemini 2.5 Pro firmy Google zależy od konkretnych priorytetów organizacji – czy to najwyższej klasy wydajności technicznej, bezpiecznej integracji korporacyjnej, czy płynnego, multimodalnego doświadczenia użytkownika. Dostosowując przypadki użycia do mocnych stron i ekosystemu każdego modelu, możesz wykorzystać najnowocześniejszą sztuczną inteligencję do napędzania innowacji w badaniach, rozwoju, edukacji i nie tylko.

Notka autora: Na dzień 31 lipca 2025 r. każdy z tych modeli będzie stale ewoluował, z częstymi, drobnymi aktualizacjami i usprawnieniami ekosystemu. Przed podjęciem ostatecznej decyzji zawsze zapoznaj się z najnowszą dokumentacją API CometAPI oraz testami wydajności.